AI 투명성

AI 투명성은 인공지능 시스템의 작동 방식과 의사결정 과정을 이해관계자에게 이해할 수 있도록 만드는 실천입니다. 그 중요성, 핵심 요소, 규제 프레임워크, 구현 기법, 과제, 그리고 실제 활용 사례를 알아보세요....

AI 투명성은 인공지능 시스템의 작동 방식과 의사결정 과정을 이해관계자에게 이해할 수 있도록 만드는 실천입니다. 그 중요성, 핵심 요소, 규제 프레임워크, 구현 기법, 과제, 그리고 실제 활용 사례를 알아보세요....

인공지능(AI)에서의 투명성은 AI 시스템이 운영되는 방식, 즉 의사결정 과정, 알고리즘, 데이터에 대한 개방성과 명확성을 의미합니다. 이는 AI 윤리와 거버넌스에 필수적이며, 책임성, 신뢰, 규제 준수를 보장합니다....

설명 가능한 인공지능(XAI)은 AI 모델의 결과를 사람이 이해할 수 있도록 만들어 투명성, 해석 가능성, 책임성을 강화하는 다양한 방법과 프로세스의 모음입니다....

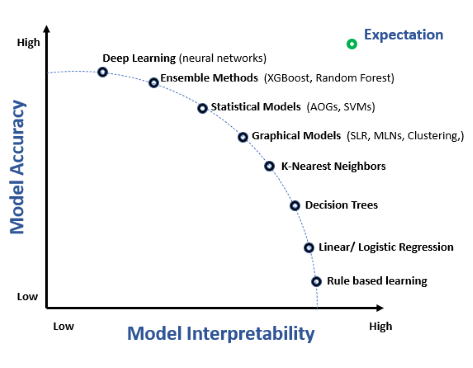

모델 해석 가능성은 기계 학습 모델이 내린 예측과 결정의 근거를 이해하고 설명하며 신뢰할 수 있는 능력을 의미합니다. 이는 AI에서 매우 중요하며, 특히 의료, 금융, 자율 시스템 등에서의 의사결정에 필수적입니다. 복잡한 모델과 인간의 이해 사이의 간극을 연결하는 역할을 합니다....

AI 설명 가능성은 인공지능 시스템이 내리는 결정과 예측을 이해하고 해석할 수 있는 능력을 의미합니다. AI 모델이 점점 더 복잡해짐에 따라, 설명 가능성은 LIME 및 SHAP과 같은 기법을 통해 투명성, 신뢰, 규제 준수, 편향 완화 및 모델 최적화를 보장합니다....