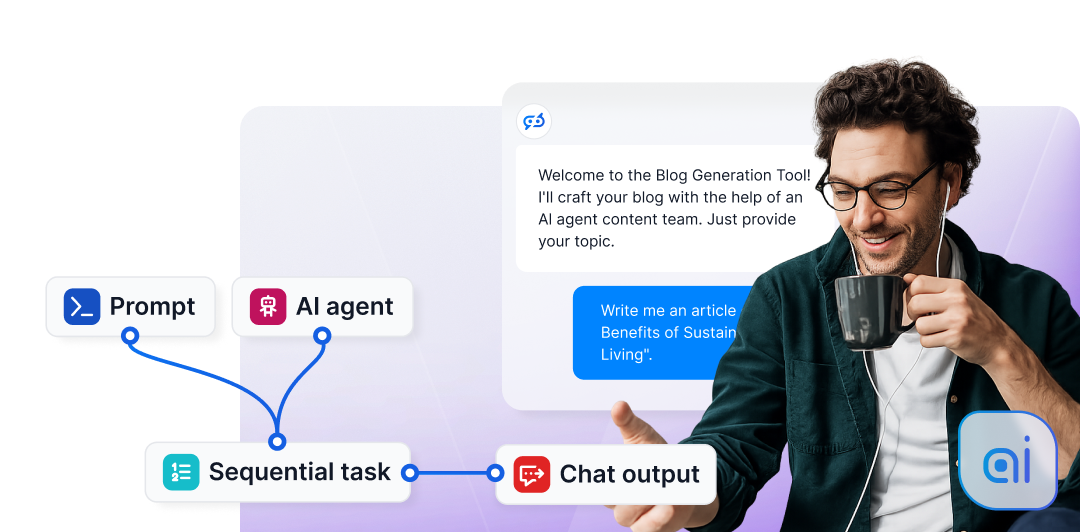

AI 에이전트

FlowHunt에서 AI 에이전트를 구축, 구성 및 조율하는 방법을 알아보세요. 단순 에이전트부터 심화 에이전트 및 전체 크루까지, 필요한 모든 가이드를 여기서 찾을 수 있습니다....

AI 에이전트는 근본적으로 챗봇과 다릅니다. 챗봇은 사용자 입력을 기다리고 응답합니다. 에이전트는 자율적으로 목표를 추구하고, 도구를 호출하고, 문제에 대해 추론하며, 각 단계마다 인간의 입력 없이 행동합니다.

이러한 구분이 중요한 이유는 에이전트가 전체 워크플로우를 자동화할 수 있기 때문입니다. 리드 적격성 평가 에이전트는 잠재 고객을 평가하고, 데이터를 강화하고, 영업 담당자에게 할당합니다—모두 인간의 개입 없이. 콘텐츠 분류 에이전트는 지원 티켓을 분류하고, 전문가에게 라우팅하며, 엣지 케이스를 인간에게 에스컬레이션합니다.

이 가이드에서는 안정적인 에이전트를 설계하고, 비즈니스 시스템과 통합하고, 일반적인 실패를 방지하고, 영향을 측정하는 방법을 배웁니다. 리드 적격성 평가, 문서 처리, 대규모 고객 지원을 자동화하는 회사의 프로덕션에서 사용되는 실제 패턴을 다룰 것입니다.

AI 에이전트는 다음을 수행하는 소프트웨어 시스템입니다:

에이전트는 목표 중심입니다. 목표를 정의하면(“이 리드를 점수 매기고 적격성을 평가하세요”), 에이전트가 이를 달성하는 방법을 파악합니다.

User: "What's the status of my order?"

Chatbot: [Looks up order, responds]

User: "Can you cancel it?"

Chatbot: [Cancels order, responds]

사용자가 모든 상호작용을 주도합니다. 챗봇은 상태가 없으며 각 메시지는 독립적입니다.

Agent goal: "Qualify and score this lead"

1. Agent observes: [Lead data from CRM]

2. Agent reasons: "I need to enrich this data and score them"

3. Agent acts: Calls enrichment API

4. Agent observes: [Enriched data]

5. Agent reasons: "Score is 85, should assign to top sales rep"

6. Agent acts: Updates CRM, sends notification

7. Done. No human input required.

에이전트는 정의된 목표를 향해 작업하며 자율적으로 여러 결정과 도구 호출을 수행합니다.

수동 리드 적격성 평가: 리드당 5분 × 100 리드 = 월 500시간. 비용: 월 $10,000(시간당 $20).

에이전트 기반: 리드당 10초 × 100 리드 = 월 16시간. 비용: $100(에이전트 API 호출). 절감: 99%.

에이전트는 고용 없이 팀의 역량을 배가시킵니다.

복잡한 작업에는 여러 단계가 필요합니다:

에이전트는 이 추론을 자동으로 처리합니다. 목표를 정의하면 에이전트가 이를 단계로 분해합니다.

에이전트는 “손"입니다. API를 호출하여:

단일 에이전트는 워크플로우를 완료하기 위해 5-10개의 도구 호출을 조율할 수 있습니다.

에이전트는 시간이 지남에 따라 개선될 수 있습니다. 에이전트가 문서를 잘못 분류하면 피드백을 제공합니다. 에이전트는 학습하고 프롬프트 전략을 조정합니다.

모든 에이전트의 핵심은 루프입니다:

┌─────────────────────────────────────────┐

│ START: Agent receives goal │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ OBSERVE: Read input, tool results, │

│ memory, environment │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ REASON: LLM decides next action │

│ (which tool to call, or done?) │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ ACT: Execute tool call or complete │

│ task │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ FEEDBACK: Evaluate result, update │

│ memory, check if goal met │

└────────────────┬────────────────────────┘

│

├─→ Goal not met? Loop back to OBSERVE

│

└─→ Goal met or max steps reached? DONE

에이전트는 다음을 읽습니다:

LLM은 다음과 같은 프롬프트를 받습니다:

You are a lead qualification agent. Your goal is to score and qualify this lead.

Available tools:

1. enrich_lead(lead_id) - Get additional data about the lead

2. score_lead(lead_data) - Score based on criteria

3. assign_to_sales_rep(lead_id, rep_id) - Assign lead to a rep

4. send_notification(rep_id, message) - Notify rep

Current state:

- Lead ID: 12345

- Company: Acme Corp

- Revenue: Unknown (need to enrich)

- Status: Not scored yet

What should you do next?

LLM은 응답합니다: “먼저 리드를 강화하여 매출 데이터를 얻은 다음, 점수를 매기고, 할당해야 합니다.”

에이전트는 선택한 도구를 실행합니다:

result = enrich_lead(lead_id=12345)

# Returns: {'revenue': '$10M', 'industry': 'SaaS', 'employees': 150}

에이전트가 확인합니다: 도구 호출이 성공했나요? 목표를 향해 나아갔나요? 메모리를 업데이트하고 루프합니다.

에이전트는 다음이 될 때까지 관찰 → 추론 → 행동 → 피드백을 반복합니다:

도구는 에이전트가 호출할 수 있는 함수입니다. 명확하게 정의하세요:

tools = [

{

"name": "enrich_lead",

"description": "Get additional company data about a lead (revenue, employees, industry)",

"parameters": {

"lead_id": {"type": "string", "description": "Unique identifier of the lead"}

}

},

{

"name": "score_lead",

"description": "Score a lead on a scale of 0-100 based on fit criteria",

"parameters": {

"lead_data": {"type": "object", "description": "Lead information including revenue, industry, etc."}

}

}

]

명확한 설명은 LLM이 올바른 도구를 선택하는 데 도움이 됩니다.

LLM은 도구 호출로 응답합니다:

{

"thought": "I need to enrich this lead to get revenue data",

"action": "enrich_lead",

"action_input": {"lead_id": "12345"}

}

에이전트 프레임워크가 도구를 실행하고 결과를 LLM에 다시 전달합니다.

성공과 실패를 모두 처리합니다:

def execute_tool(tool_name, tool_input):

try:

if tool_name == "enrich_lead":

result = crm_api.enrich(tool_input['lead_id'])

return {"status": "success", "data": result}

except Exception as e:

return {"status": "error", "message": str(e)}

도구가 실패하면 에이전트는 다른 접근 방식을 시도하거나 인간에게 에스컬레이션해야 합니다.

에이전트의 작업 메모리: 현재 입력, 도구 결과, 추론 단계. 일반적으로 컨텍스트 윈도우(프롬프트)에 저장됩니다.

예: 리드 적격성 평가 에이전트는 다음을 기억합니다:

영구 메모리: 과거 결정, 학습된 패턴, 지식베이스.

사용 사례:

시맨틱 검색을 위해 벡터 데이터베이스(Pinecone, Weaviate)로 구현하세요.

LLM은 유한한 컨텍스트 윈도우(4K-128K 토큰)를 가지고 있습니다. 에이전트는 모든 것을 기억할 수 없습니다. 전략:

대부분의 에이전트에는 Claude 또는 오픈소스 모델이 충분하고 더 저렴합니다.

Reflexion 프롬프트 예시:

Agent: "I'll assign this lead to rep John."

Critic: "Wait, did you check if John is already at capacity?"

Agent: "Good point. Let me check John's workload first."

실시간(고객 지원)에는 속도를 선택하세요. 고위험(금융 결정)에는 정확도를 선택하세요.

반응형 에이전트는 단일 결정을 내리고 행동합니다. 다단계 계획이 없습니다.

Input: "What's my account balance?"

→ Agent queries database

→ Agent responds with balance

Done.

def customer_service_agent(question):

# 1. Search knowledge base

articles = search_kb(question)

# 2. LLM picks best article

response = llm.complete(f"""

Question: {question}

Relevant articles: {articles}

Provide an answer based on these articles.

""")

# 3. Return response

return response

지연시간: 1-3초. 비용: 쿼리당 $0.001-0.01.

계획 에이전트는 복잡한 목표를 단계로 분해합니다.

Goal: "Qualify and assign this lead"

→ Agent plans: [enrich, score, assign, notify]

→ Agent executes each step

→ Agent verifies goal achieved

Done.

def lead_qualification_agent(lead_id):

lead = crm.get_lead(lead_id)

# Step 1: Enrich

enriched = enrich_lead(lead)

# Step 2: Score

score = score_lead(enriched)

# Step 3: Assign

best_rep = find_best_sales_rep(score)

crm.assign_lead(lead_id, best_rep)

# Step 4: Notify

send_slack(f"New qualified lead assigned to {best_rep}")

return {"lead_id": lead_id, "score": score, "assigned_to": best_rep}

지연시간: 5-15초. 비용: 리드당 $0.02-0.05.

학습 에이전트는 피드백으로 개선됩니다.

Initial: Agent classifies document as "Invoice" (60% confidence)

Human feedback: "Actually, it's a Receipt"

Agent learns: Adjust classification prompts

Next time: Same document classified as "Receipt" (90% confidence)

def recommendation_agent(user_id):

# Get user history

history = db.get_user_history(user_id)

# LLM recommends based on patterns

recommendation = llm.complete(f"""

User history: {history}

Based on past preferences, what should we recommend?

""")

# Show recommendation, collect feedback

feedback = user_feedback # thumbs up/down

# Store feedback for future recommendations

db.log_feedback(user_id, recommendation, feedback)

return recommendation

시간이 지남에 따라 에이전트가 사용자 선호도를 학습하면서 추천이 개선됩니다.

감독 에이전트가 전문 에이전트를 조정합니다.

Supervisor: "Process this support ticket"

├─ Classifier agent: "This is a billing issue"

├─ Billing specialist agent: "Refund $50"

└─ Notification agent: "Send confirmation email"

def content_pipeline_agent(topic):

# Supervisor delegates

research = research_agent(topic)

draft = writer_agent(research)

edited = editor_agent(draft)

published = publisher_agent(edited)

return {"topic": topic, "status": "published"}

각 전문 에이전트는 자신의 작업에 최적화되어 있습니다. 감독자가 조율합니다.

에이전트의 사고가 얼마나 정교한지. 단순한 에이전트는 chain-of-thought를 사용합니다. 복잡한 에이전트는 계획과 reflexion을 사용합니다.

API, 데이터베이스, CRM 시스템을 쉽게 연결할 수 있나요? 아니면 맞춤 코드가 필요한가요?

개발자가 얼마나 빨리 작동하는 에이전트를 얻을 수 있나요? 노코드 플랫폼이 더 빠르고; Python 프레임워크가 더 유연합니다.

일부 프레임워크는 오픈소스(무료)입니다. 다른 것은 API 호출당 또는 구독으로 청구됩니다.

각 도구가 무엇에 최적화되어 있나요?

| 도구 | 프레임워크 유형 | 추론 능력 | 도구 통합 | 학습 곡선 | 가격 | 최적 |

|---|---|---|---|---|---|---|

| n8n | 시각적 워크플로우 빌더 | Chain-of-thought | 500개 이상의 통합 | 낮음 | 무료 + 유료 | 비기술 사용자, 빠른 설정 |

| CrewAI | Python 프레임워크 | 계획 + reflexion | 맞춤 도구(Python) | 중간 | 오픈소스 | 개발자, 복잡한 에이전트 |

| Autogen | Python 프레임워크 | 다중 에이전트 추론 | 맞춤 도구 | 높음 | 오픈소스 | 연구, 다중 에이전트 시스템 |

| LangGraph | Python 프레임워크 | 계획 + 상태 관리 | LangChain 생태계 | 중간 | 오픈소스 | 복잡한 워크플로우, 상태 추적 |

| FlowHunt | 네이티브 플랫폼 | Chain-of-thought + 계획 | 네이티브 + API 통합 | 낮음 | 구독 | 워크플로우 자동화, 사용 편의성 |

| Lindy.ai | 노코드 플랫폼 | Chain-of-thought | 100개 이상의 통합 | 매우 낮음 | 프리미엄 | 비기술, 빠른 에이전트 |

| Gumloop | 노코드 플랫폼 | Chain-of-thought | 50개 이상의 통합 | 매우 낮음 | 프리미엄 | 단순 자동화, 템플릿 |

주요 차이점:

구체적으로 정하세요. 나쁨: “리드 관리 자동화.” 좋음: “리드를 0-100으로 점수 매기고, 회사 데이터로 강화하고, 용량에 따라 영업 담당자에게 할당.”

트레이드오프:

입력 데이터: 리드 데이터, 문서 텍스트, 고객 질문, 메모리의 컨텍스트.

에이전트가 호출할 API, 데이터베이스, 서비스를 나열하세요.

리드 적격성 평가의 예:

성공 조건을 정의하세요. “리드가 점수 매겨지고 할당되면 멈춥니다.”

또한 무한 루프를 방지하기 위해 최대 단계를 정의하세요. “10단계 후에는 상관없이 멈춥니다.”

CrewAI 예제:

from crewai import Agent, Task, Crew

# Define agents

enrichment_agent = Agent(

role="Data Enrichment Specialist",

goal="Enrich lead data with company information",

tools=[enrich_tool]

)

scoring_agent = Agent(

role="Lead Scoring Expert",

goal="Score leads based on fit criteria",

tools=[score_tool]

)

assignment_agent = Agent(

role="Sales Manager",

goal="Assign leads to best sales rep",

tools=[assign_tool, notify_tool]

)

# Define tasks

enrich_task = Task(

description="Enrich this lead: {lead_id}",

agent=enrichment_agent

)

score_task = Task(

description="Score the enriched lead",

agent=scoring_agent

)

assign_task = Task(

description="Assign lead to best rep and notify",

agent=assignment_agent

)

# Run crew

crew = Crew(agents=[enrichment_agent, scoring_agent, assignment_agent],

tasks=[enrich_task, score_task, assign_task])

result = crew.kickoff(inputs={"lead_id": "12345"})

def test_enrichment_tool():

result = enrich_tool("lead_123")

assert result['revenue'] is not None

assert result['employees'] is not None

def test_scoring_agent():

lead = {"company": "Acme", "revenue": "10M", "employees": 50}

score = score_agent(lead)

assert 0 <= score <= 100

def test_full_loop():

result = lead_qualification_agent("lead_123")

assert result['assigned_to'] is not None

assert result['score'] > 0

def lead_qualification_agent(lead_id):

"""

Autonomous agent that qualifies leads.

1. Fetches lead from CRM

2. Enriches with company data

3. Scores based on fit criteria

4. Assigns to best sales rep

5. Notifies rep

"""

tools = {

"get_lead": crm.get_lead,

"enrich_lead": enrichment_api.enrich,

"score_lead": scoring_model.score,

"find_best_rep": crm.find_available_rep,

"assign_lead": crm.assign,

"send_notification": slack.send

}

# Step 1: Observe

lead = get_lead(lead_id)

print(f"Observing lead: {lead['company']}")

# Step 2: Reason (LLM decides next action)

# LLM: "I need to enrich this lead first"

# Step 3: Act

enriched = enrich_lead(lead)

print(f"Enriched: revenue={enriched['revenue']}")

# Step 4: Feedback + Loop

# LLM: "Now I'll score"

# Step 5: Act

score = score_lead(enriched)

print(f"Score: {score}")

# Step 6: Reason

# LLM: "Score is {score}, should assign to top rep"

# Step 7: Act

best_rep = find_best_rep(score)

assign_lead(lead_id, best_rep)

send_notification(best_rep, f"New lead: {lead['company']}")

print(f"Assigned to {best_rep}")

대부분의 에이전트는 REST API를 호출합니다. 표준 HTTP 클라이언트를 사용하세요:

def call_crm_api(endpoint, method="GET", data=None):

url = f"https://api.crm.com/{endpoint}"

headers = {"Authorization": f"Bearer {api_key}"}

if method == "GET":

response = requests.get(url, headers=headers)

elif method == "POST":

response = requests.post(url, json=data, headers=headers)

return response.json()

이벤트(새 리드, 수신 이메일, 양식 제출)에서 에이전트를 트리거하세요:

@app.post("/webhook/new_lead")

def on_new_lead(lead_data):

# Trigger agent asynchronously

queue.enqueue(lead_qualification_agent, lead_data['id'])

return {"status": "queued"}

from ratelimit import limits, sleep_and_retry

@sleep_and_retry

@limits(calls=100, period=60) # 100 calls per minute

def call_api(endpoint):

return requests.get(f"https://api.example.com/{endpoint}")

에이전트는 고객 데이터, 과거 상호작용, 지식베이스를 읽습니다:

def get_customer_history(customer_id):

query = "SELECT * FROM interactions WHERE customer_id = %s"

return db.execute(query, (customer_id,))

에이전트가 데이터베이스에 결정을 씁니다:

def store_lead_score(lead_id, score, assigned_to):

db.execute(

"UPDATE leads SET score = %s, assigned_to = %s WHERE id = %s",

(score, assigned_to, lead_id)

)

다단계 작업에 트랜잭션을 사용하세요:

with db.transaction():

score = score_lead(lead)

db.update_lead_score(lead_id, score)

rep = find_best_rep(score)

db.assign_lead(lead_id, rep)

# All-or-nothing: if any step fails, rollback

공식 SDK를 사용하세요:

from salesforce import SalesforceAPI

sf = SalesforceAPI(api_key=key)

# Update lead

sf.update_lead(lead_id, {

'score': 85,

'assigned_to': 'john@acme.com',

'status': 'qualified'

})

from slack_sdk import WebClient

slack = WebClient(token=slack_token)

# Notify sales rep

slack.chat_postMessage(

channel="john",

text=f"New qualified lead: {lead['company']} (score: {score})"

)

에이전트가 할 수 있는 것을 제한하려면 OAuth 범위를 사용하세요:

# Agent can only read leads, update scores

# Cannot delete leads or access sensitive data

oauth_scopes = ["leads:read", "leads:update"]

고위험 결정: 금융 거래, 고객 환불, 정책 예외.

if decision_risk_score > 0.7:

# Route to human for approval

escalate_to_human(decision, reason="High risk")

else:

# Agent executes decision

execute_decision(decision)

def lead_qualification_with_escalation(lead_id):

score = score_lead(lead_id)

if score > 80:

# High confidence, assign directly

assign_lead(lead_id, best_rep)

elif 50 < score < 80:

# Medium confidence, route to human

escalate_to_human(lead_id, "Review and assign")

else:

# Low score, reject

reject_lead(lead_id)

@app.post("/feedback/lead_score")

def on_score_feedback(lead_id, actual_score, agent_score):

# Store feedback

db.log_feedback(lead_id, agent_score, actual_score)

# Retrain model on feedback (periodic)

if should_retrain():

retrain_scoring_model()

# Bad: Agent keeps calling same tool

Agent thinks: "I need to get lead data"

→ Calls get_lead()

→ Still doesn't have enriched data

→ Calls get_lead() again

→ Infinite loop

max_steps = 10

steps_taken = 0

while steps_taken < max_steps:

action = llm.decide_next_action()

if action == last_action:

# Same action twice, break loop

break

execute_action(action)

steps_taken += 1

try:

result = agent.run(timeout=30) # 30 second timeout

except TimeoutError:

escalate_to_human("Agent loop timeout")

# Bad: Agent hallucinates tool output

Agent: "I called enrich_lead, got revenue=$100M"

Reality: enrich_lead() returned null (API failed)

Agent made up the result

def execute_tool_safely(tool_name, params):

try:

result = execute_tool(tool_name, params)

# Validate result

if result is None:

return {"error": "Tool returned null"}

if not validate_result(result):

return {"error": "Result failed validation"}

return result

except Exception as e:

return {"error": str(e)}

에이전트를 사실에 기반을 두기 위해 RAG를 사용하세요:

# Instead of: "Summarize this article"

# Use: "Summarize this article, citing specific passages"

knowledge_base = vector_db.search(query)

prompt = f"""

Summarize this article. Only cite specific passages.

Article: {article}

Knowledge base: {knowledge_base}

"""

def robust_agent_call(goal, retries=3):

for attempt in range(retries):

try:

result = agent.run(goal)

# Validate result

if validate(result):

return result

except Exception as e:

if attempt == retries - 1:

escalate_to_human(goal)

else:

time.sleep(2 ** attempt) # Backoff

# Bad: Ambiguous tool description

"update_lead - Update a lead"

# Good: Clear description

"update_lead - Update a lead's score, status, or assigned_to field.

Parameters: lead_id (required), score (0-100), status (qualified/disqualified),

assigned_to (sales rep email)"

# Validate before execution

tool_call = llm.decide_tool_call()

if not validate_tool_call(tool_call):

# Tool call is invalid, ask LLM to fix

llm.correct_tool_call(tool_call)

else:

execute_tool(tool_call)

def validate_tool_call(call):

tool = tools[call['name']]

required_params = tool['required_parameters']

for param in required_params:

if param not in call['params']:

return False

return True

try:

result = execute_tool(tool_call)

except ToolExecutionError as e:

# Suggest correct tool

correct_tool = suggest_correct_tool(e)

llm.suggest_retry(correct_tool)

# Bad: Agent calls same tool multiple times

Agent: "Let me get lead data"

→ Calls get_lead()

→ Calls get_lead() again (forgot it already did)

→ Calls get_lead() a third time

Cost: 3x higher than needed

budget = {"tokens": 10000, "api_calls": 50}

spent = {"tokens": 0, "api_calls": 0}

def execute_with_budget(action):

global spent

if spent['api_calls'] >= budget['api_calls']:

raise BudgetExceededError()

result = execute_action(action)

spent['api_calls'] += 1

return result

캐싱 구현:

cache = {}

def get_lead_cached(lead_id):

if lead_id in cache:

return cache[lead_id]

result = crm_api.get_lead(lead_id)

cache[lead_id] = result

return result

if cost_this_hour > budget_per_hour:

# Switch to cheaper model

switch_to_model("gpt-3.5-turbo") # Cheaper than GPT-4

5개의 연속 API 호출을 각각 1초씩 수행하는 에이전트 = 5+초 지연시간.

# Parallel execution

import asyncio

async def parallel_agent(lead_id):

lead = await get_lead_async(lead_id)

# Call multiple tools in parallel

enrichment, scoring = await asyncio.gather(

enrich_lead_async(lead),

score_lead_async(lead)

)

return (enrichment, scoring)

더 빠른 모델 사용:

# Instead of GPT-4 (slower, more accurate)

# Use GPT-3.5-turbo (faster, still accurate enough)

model = "gpt-3.5-turbo" # 200ms latency vs 500ms for GPT-4

try:

result = agent.run(timeout=5) # 5 second timeout

return result

except TimeoutError:

# Return partial results

return partial_result

# Queue for async completion

queue.enqueue(complete_agent, lead_id)

에이전트 출력을 실제값(인간 검토, 실제 결과)과 비교하세요.

correct = 0

total = 100

for decision in agent_decisions:

if decision == human_review[decision.id]:

correct += 1

accuracy = correct / total * 100 # e.g., 94%

입력에서 출력까지의 엔드투엔드 시간을 측정하세요.

start = time.time()

result = agent.run(input_data)

latency = time.time() - start # e.g., 8.5 seconds

cost = (llm_api_calls * llm_cost) + (tool_calls * tool_cost) + (human_review_rate * hourly_rate)

# e.g., $0.03 per lead

사용자 설문: “에이전트 결정에 얼마나 만족하십니까?”

automated = tasks_completed_by_agent

total = all_tasks

automation_rate = automated / total * 100 # e.g., 87%

Manual lead qualification:

- 100 leads/month

- 5 minutes per lead

- 500 hours/month

- $20/hour = $10,000/month

Agent-driven:

- 100 leads/month

- $0.03 per lead (API calls)

- $3 total API cost

- $500/month human review (10% escalation)

- $100/month infrastructure

Total: $603/month

Savings per month: $10,000 - $603 = $9,397

ROI: 1,557% (9,397 / 603)

Payback period: < 1 month (immediate)

Manual process:

- 500 leads/month

- 5 min per lead = 2,500 hours = $50,000/month

Agent process:

- 500 leads/month

- $0.03 per lead = $15

- 5% escalation (25 leads) = $250 human time

- Infrastructure = $500

Total: $765/month

Savings: $50,000 - $765 = $49,235/month

ROI: 6,436%

# Track daily metrics

daily_metrics = {

'accuracy': 0.94,

'latency': 8.5,

'cost_per_task': 0.03,

'automation_rate': 0.87

}

# Test 1: GPT-4 (more accurate, slower)

# Test 2: GPT-3.5-turbo (faster, slightly less accurate)

# Measure: accuracy, latency, cost

# Choose based on your priorities

# Collect human feedback on agent mistakes

feedback = db.get_feedback()

# Retrain agent (adjust prompts, add examples)

agent.retrain(feedback)

# Measure: accuracy improves from 94% to 96%

ROI를 모니터링하세요. 에이전트가 가치를 제공하지 못하면 폐기하세요. 성공한 에이전트를 다른 팀으로 확장하세요.

FAQ 섹션은 frontmatter에서 자동으로 렌더링되어 아래에 나타납니다.

{{ cta-dark-panel heading=“복잡함 없이 에이전트 구축하기” description=“FlowHunt의 네이티브 에이전트 플랫폼은 도구 통합, 오류 처리, 모니터링을 처리합니다. 몇 주가 아닌 몇 분 안에 자율 워크플로우 구축을 시작하세요.” ctaPrimaryText=“FlowHunt 무료로 시도하기” ctaPrimaryURL=“https://app.flowhunt.io/sign-in" ctaSecondaryText=“데모 예약하기” ctaSecondaryURL=“https://www.flowhunt.io/demo/" gradientStartColor="#7c3aed” gradientEndColor="#ec4899” gradientId=“cta-ai-agents” }}

아르시아는 FlowHunt의 AI 워크플로우 엔지니어입니다. 컴퓨터 과학 배경과 AI에 대한 열정을 바탕으로, 그는 AI 도구를 일상 업무에 통합하여 생산성과 창의성을 높이는 효율적인 워크플로우를 설계하는 데 전문성을 가지고 있습니다.

FlowHunt에서 AI 에이전트를 구축, 구성 및 조율하는 방법을 알아보세요. 단순 에이전트부터 심화 에이전트 및 전체 크루까지, 필요한 모든 가이드를 여기서 찾을 수 있습니다....

FlowHunt에서 AI 에이전트와 툴 콜링 에이전트를 활용하여 작업을 자동화하고, 다양한 도구를 통합하며, 사용자 상호작용을 향상시키는 고급 AI 챗봇을 만드는 가이드입니다....

'ai assist'에 대해 꼭 알아야 할 모든 것—정의, 작동 원리, 활용 사례, 기술, 보안, 그리고 비즈니스에 FlowHunt의 첨단 AI 어시스턴트 솔루션을 도입하는 방법까지 모두 알아보세요....