AI-agents zijn fundamenteel anders dan chatbots. Een chatbot wacht op gebruikersinvoer en reageert. Een agent streeft autonoom doelen na, roept tools aan, redeneert over problemen en onderneemt acties zonder dat er bij elke stap menselijke input nodig is.

Dit verschil is belangrijk, omdat agents hele workflows kunnen automatiseren. Een leadkwalificatie-agent scoort prospects, verrijkt hun gegevens en wijst ze toe aan salesmedewerkers - allemaal zonder menselijke tussenkomst. Een content-triage-agent categoriseert supporttickets, routeert ze naar specialisten en escaleert randgevallen naar mensen.

In deze gids leer je hoe je betrouwbare agents architecteert, ze integreert met bedrijfssystemen, veelvoorkomende fouten voorkomt en hun impact meet. We behandelen echte patronen die in productie worden gebruikt bij bedrijven die leadkwalificatie, documentverwerking en klantenondersteuning op schaal automatiseren.

Wat zijn AI-agents en hoe verschillen ze van chatbots?

Definitie van AI-agents (autonome systemen die waarnemen, beslissen en handelen)

Een AI-agent is een softwaresysteem dat:

- Zijn omgeving waarneemt (leest input, tool-resultaten, geheugen)

- Redeneert over de beste actie (gebruikt een LLM om te plannen)

- Handelt door tools aan te roepen of stappen te zetten richting een doel

- Zich aanpast op basis van feedback en resultaten

Agents zijn doelgericht. Jij definieert het doel (“Scoor en kwalificeer deze lead”) en de agent zoekt uit hoe dat te bereiken.

Belangrijk onderscheid: chatbots zijn reactief; agents zijn autonoom

Chatbots: gebruiker initieert → model reageert

Gebruiker: "Wat is de status van mijn bestelling?"

Chatbot: [Zoekt bestelling op, reageert]

Gebruiker: "Kun je die annuleren?"

Chatbot: [Annuleert bestelling, reageert]

De gebruiker stuurt elke interactie aan. De chatbot is stateless - elk bericht is onafhankelijk.

Agents: doelgericht, nemen bij elke stap actie zonder gebruikersinvoer

Agent-doel: "Kwalificeer en scoor deze lead"

1. Agent observeert: [Leaddata uit CRM]

2. Agent redeneert: "Ik moet deze data verrijken en ze scoren"

3. Agent handelt: Roept enrichment-API aan

4. Agent observeert: [Verrijkte data]

5. Agent redeneert: "Score is 85, moet toewijzen aan top-salesmedewerker"

6. Agent handelt: Werkt CRM bij, stuurt notificatie

7. Klaar. Geen menselijke input vereist.

De agent werkt naar een gedefinieerd doel toe en neemt autonoom meerdere beslissingen en tool-calls.

Waarom agents belangrijk zijn voor workflows

Automatisering op schaal (duizenden taken afhandelen zonder menselijke tussenkomst)

Handmatige leadkwalificatie: 5 minuten per lead × 100 leads = 500 uur/maand. Kosten: $10.000/maand (bij $20/uur).

Agent-gedreven: 10 seconden per lead × 100 leads = 16 uur/maand. Kosten: $100 (agent-API-calls). Besparing: 99%.

Agents vergroten de capaciteit van je team zonder dat je mensen hoeft aan te nemen.

Meerstapsredenering (complexe problemen opdelen in subtaken)

Complexe taken vereisen meerdere stappen:

- Leadkwalificatie: Scoren → Verrijken → Toewijzen → Notificeren

- Documenttriage: Extraheren → Classificeren → Routeren → Archiveren

- Klantenondersteuning: Begrijpen → Kennisbank doorzoeken → Antwoord genereren → Zo nodig routeren

Agents verwerken deze redenering automatisch. Jij definieert het doel; de agent verdeelt het in stappen.

Toolgebruik (agents roepen API’s, databases, externe services aan)

Agents zijn “handen.” Ze roepen API’s aan om:

- Databases te bevragen

- CRM-systemen bij te werken

- E-mails of Slack-berichten te versturen

- Diensten van derden aan te roepen (data-enrichment, betalingsverwerking)

Eén agent kan 5-10 tool-calls orkestreren om een workflow te voltooien.

Adaptief gedrag (leren van feedback, aanpak bijstellen)

Agents kunnen in de loop van de tijd verbeteren. Als een agent documenten verkeerd classificeert, geef je feedback. De agent leert en past zijn prompting-strategie aan.

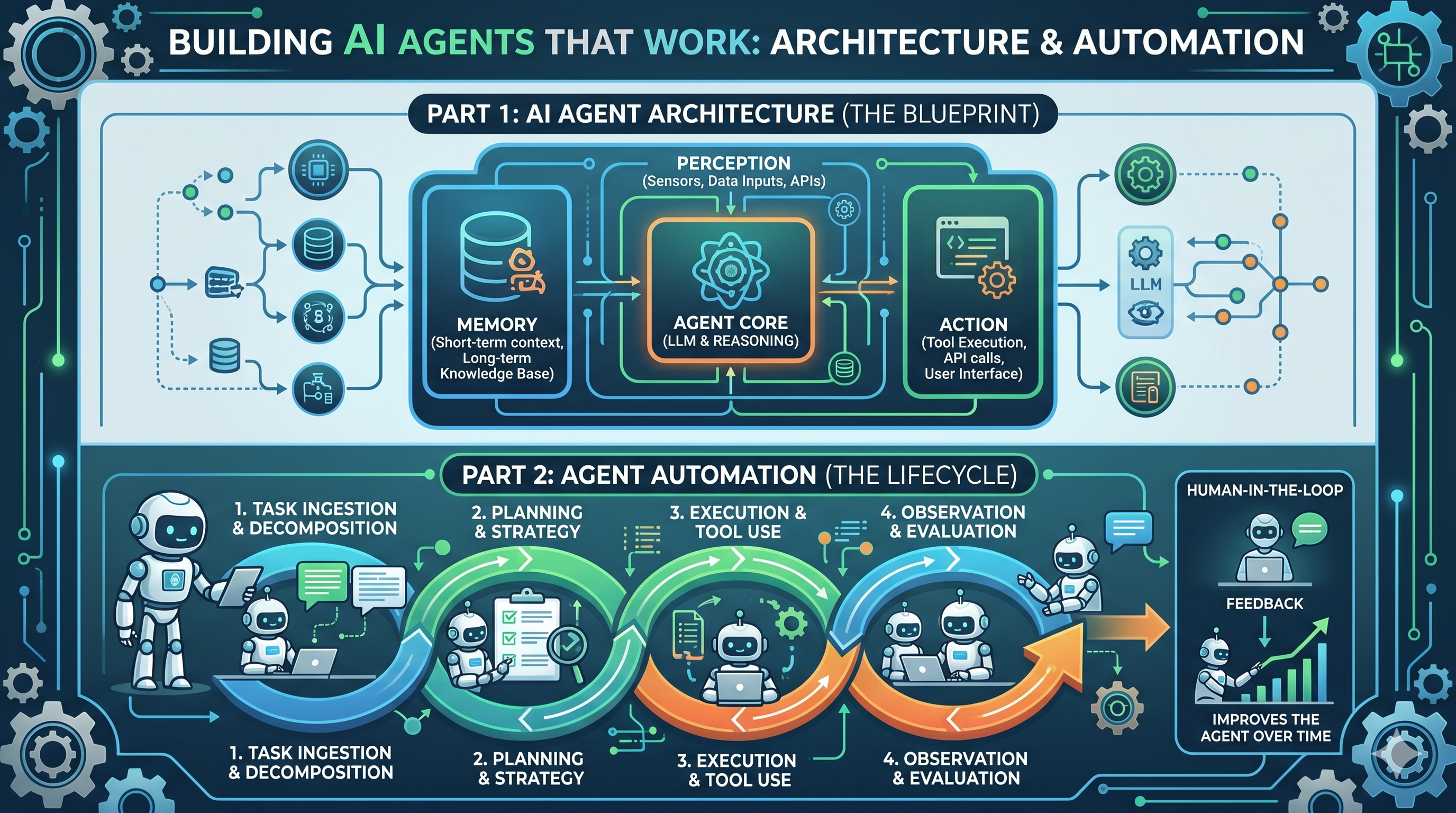

Kerncomponenten van een AI-agent (de agent-loop)

De agent-redeneerloop (met diagrambeschrijving)

De kern van elke agent is een loop:

┌─────────────────────────────────────────┐

│ START: Agent ontvangt doel │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ OBSERVEER: Lees input, tool-resultaten,│

│ geheugen, omgeving │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ REDENEER: LLM bepaalt volgende actie │

│ (welke tool, of klaar?) │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ HANDEL: Voer tool-call uit of voltooi │

│ taak │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ FEEDBACK: Evalueer resultaat, werk │

│ geheugen bij, check doel │

└────────────────┬────────────────────────┘

│

├─→ Doel niet bereikt? Terug naar OBSERVEER

│

└─→ Doel bereikt of max stappen? KLAAR

Observatie: agent neemt toestand waar (input, omgeving, tool-resultaten)

De agent leest:

- Initiële input (leaddata, documenttekst, klantvraag)

- Tool-resultaten van eerdere stappen (API-responses, databasequery’s)

- Geheugen (gespreksgeschiedenis, eerdere beslissingen, kennisbank)

- Huidige staat (wat is gedaan, wat rest)

Redenering: LLM bepaalt volgende actie (planning, toolkeuze)

De LLM ontvangt een prompt als:

Je bent een leadkwalificatie-agent. Je doel is om deze lead te scoren en te kwalificeren.

Beschikbare tools:

1. enrich_lead(lead_id) - Haal extra data op over de lead

2. score_lead(lead_data) - Score op basis van criteria

3. assign_to_sales_rep(lead_id, rep_id) - Wijs lead toe aan rep

4. send_notification(rep_id, message) - Notificeer rep

Huidige staat:

- Lead ID: 12345

- Bedrijf: Acme Corp

- Omzet: Onbekend (moet verrijkt worden)

- Status: Nog niet gescoord

Wat moet je nu doen?

De LLM antwoordt: “Ik moet de lead eerst verrijken om omzetdata te krijgen, dan scoren, dan toewijzen.”

Actie: tool-call uitvoeren of stap richting doel zetten

De agent voert de gekozen tool uit:

result = enrich_lead(lead_id=12345)

# Returns: {'revenue': '$10M', 'industry': 'SaaS', 'employees': 150}

Feedback: resultaat evalueren, strategie bijstellen indien nodig

De agent controleert: Is de tool-call gelukt? Heeft het richting het doel geholpen? Werk geheugen bij en loop verder.

Loop: herhaal tot doel is bereikt of max stappen zijn overschreden

De agent herhaalt observatie → redenering → actie → feedback totdat:

- Het doel is bereikt (“Lead gescoord en toegewezen”)

- Max stappen zijn bereikt (voorkomt oneindige loops)

- Een fout optreedt (escaleer naar mens)

Tool-integratie (de “handen” van de agent)

Tools definiëren (functiesignaturen, beschrijvingen, parameters)

Tools zijn functies die de agent kan aanroepen. Definieer ze helder:

tools = [

{

"name": "enrich_lead",

"description": "Get additional company data about a lead (revenue, employees, industry)",

"parameters": {

"lead_id": {"type": "string", "description": "Unique identifier of the lead"}

}

},

{

"name": "score_lead",

"description": "Score a lead on a scale of 0-100 based on fit criteria",

"parameters": {

"lead_data": {"type": "object", "description": "Lead information including revenue, industry, etc."}

}

}

]

Heldere beschrijvingen helpen de LLM de juiste tool te kiezen.

Tool calling (hoe agents tools selecteren en aanroepen)

De LLM antwoordt met een tool-call:

{

"thought": "I need to enrich this lead to get revenue data",

"action": "enrich_lead",

"action_input": {"lead_id": "12345"}

}

Jouw agent-framework voert de tool uit en geeft het resultaat terug aan de LLM.

Afhandeling van tool-resultaten (responses parsen, foutherstel)

Handel zowel succes als falen af:

def execute_tool(tool_name, tool_input):

try:

if tool_name == "enrich_lead":

result = crm_api.enrich(tool_input['lead_id'])

return {"status": "success", "data": result}

except Exception as e:

return {"status": "error", "message": str(e)}

Als een tool faalt, moet de agent een andere aanpak proberen of escaleren naar een mens.

Geheugensystemen (wat agents onthouden)

Kortetermijngeheugen (huidige gesprekscontext)

Het werkgeheugen van de agent: huidige input, tool-resultaten, redeneerstappen. Meestal opgeslagen in het contextvenster (de prompt).

Voorbeeld: leadkwalificatie-agent onthoudt:

- Oorspronkelijke leaddata

- Enrichment-resultaten

- Score

- Welke salesmedewerker is toegewezen

Langetermijngeheugen (kennisbank, eerdere interacties)

Persistent geheugen: eerdere beslissingen, geleerde patronen, kennisbank.

Gebruiksscenario’s:

- Kennisbank: Agent haalt relevante artikelen op bij het beantwoorden van klantvragen

- Beslissingsgeschiedenis: Agent leert welke leads converteerden (verbetert scoring)

- Interactielogs: Agent onthoudt eerdere interacties met een klant

Implementeer met vectordatabases (Pinecone, Weaviate) voor semantisch zoeken.

Geheugenbeperkingen (beperkingen van het contextvenster)

LLM’s hebben een eindig contextvenster (4K-128K tokens). Agents kunnen niet alles onthouden. Strategieën:

- Samenvattingen: Comprimeer oude gesprekken tot samenvattingen

- Retrieval-augmented generation (RAG): Haal alleen relevant geheugen op wanneer nodig

- Hiërarchisch geheugen: Houd recente interacties in kortetermijn, oudere in langetermijn

Redeneer-backbone (het “brein”)

LLM-keuze (GPT-4, Claude, open-source-modellen)

- GPT-4: Beste redenering, aan voor complexe taken. Kosten: $0,03-0,06 per 1K tokens.

- Claude 3.5 Sonnet: Sterke redenering, lange context (200K tokens). Kosten: $0,003-0,015 per 1K tokens.

- Open-source (LLaMA 4): Goedkoper ($0,01-0,03 per 1M tokens), aanpasbaar, privacyvriendelijk.

Voor de meeste agents volstaan Claude of open-source-modellen en zijn ze goedkoper.

Redeneermodi (Chain-of-Thought, Tree-of-Thought, Reflexion)

- Chain-of-thought: Agent denkt stap voor stap. “Ik moet verrijken → scoren → toewijzen.”

- Tree-of-thought: Agent verkent meerdere paden en kiest het beste. Langzamer maar nauwkeuriger voor complexe problemen.

- Reflexion: Agent bekritiseert zijn eigen output, probeert zo nodig opnieuw. Vermindert hallucinaties.

Voorbeeld reflexion-prompt:

Agent: "Ik wijs deze lead toe aan rep John."

Criticus: "Wacht, heb je gecheckt of John al vol zit?"

Agent: "Goed punt. Laat me eerst Johns werkdruk checken."

Afwegingen: snelheid versus nauwkeurigheid

- Snelle agents: Single-turn-redenering, geen tool-validatie. 2-5 seconden per taak. 85% nauwkeurigheid.

- Nauwkeurige agents: Meerstapsredenering, validatie, reflexion. 10-30 seconden per taak. 95% nauwkeurigheid.

Kies snelheid voor real-time (klantenservice). Kies nauwkeurigheid voor high-stakes (financiële beslissingen).

Typen agents en wanneer je welke gebruikt

Reactieve agents (eenvoudig, snel, stateless)

Hoe ze werken (single turn: input → actie)

Reactieve agents maken één beslissing en handelen. Geen meerstapsplanning.

Input: "Wat is mijn accountsaldo?"

→ Agent bevraagt database

→ Agent reageert met saldo

Klaar.

Beste voor: eenvoudig toolgebruik, API-calls, directe reacties

- Klantenservice-Q&A (bestelling opzoeken, saldo checken)

- Eenvoudige API-calls (weer opvragen, aandelenkoers checken)

- Directe reacties nodig (< 2 seconden latency)

Voorbeeld: klantenservice-chatbot met kennisbank-lookup

def customer_service_agent(question):

# 1. Search knowledge base

articles = search_kb(question)

# 2. LLM picks best article

response = llm.complete(f"""

Question: {question}

Relevant articles: {articles}

Provide an answer based on these articles.

""")

# 3. Return response

return response

Latency: 1-3 seconden. Kosten: $0,001-0,01 per query.

Planning-agents (doelgericht, meerstapsredenering)

Hoe ze werken (doel opdelen in subtaken, plan uitvoeren)

Planning-agents delen complexe doelen op in stappen.

Doel: "Kwalificeer en wijs deze lead toe"

→ Agent plant: [verrijken, scoren, toewijzen, notificeren]

→ Agent voert elke stap uit

→ Agent controleert of doel is bereikt

Klaar.

Beste voor: complexe workflows, onderzoekstaken, data-analyse

- Leadkwalificatie (verrijken → scoren → toewijzen)

- Documentverwerking (extraheren → classificeren → opslaan)

- Onderzoekstaken (zoeken → samenvatten → samenstellen)

Voorbeeld: leadkwalificatie-agent (scoren → verrijken → toewijzen)

def lead_qualification_agent(lead_id):

lead = crm.get_lead(lead_id)

# Step 1: Enrich

enriched = enrich_lead(lead)

# Step 2: Score

score = score_lead(enriched)

# Step 3: Assign

best_rep = find_best_sales_rep(score)

crm.assign_lead(lead_id, best_rep)

# Step 4: Notify

send_slack(f"New qualified lead assigned to {best_rep}")

return {"lead_id": lead_id, "score": score, "assigned_to": best_rep}

Latency: 5-15 seconden. Kosten: $0,02-0,05 per lead.

Lerende agents (adaptief, verbeteren in de tijd)

Hoe ze werken (feedback verwerken, gedrag bijstellen)

Lerende agents worden beter met feedback.

Initieel: Agent classificeert document als "Factuur" (60% zekerheid)

Menselijke feedback: "Het is eigenlijk een Kassabon"

Agent leert: Classificatieprompts bijstellen

Volgende keer: Zelfde document geclassificeerd als "Kassabon" (90% zekerheid)

Beste voor: langlopende processen, personalisatie, optimalisatie

- Contentaanbevelingen (leert gebruikersvoorkeuren)

- Routing in klantenondersteuning (leert welke agents welke issues het best afhandelen)

- Prijsoptimalisatie (leert welke prijzen het best converteren)

Voorbeeld: content-aanbevelingsagent (leert gebruikersvoorkeuren)

def recommendation_agent(user_id):

# Get user history

history = db.get_user_history(user_id)

# LLM recommends based on patterns

recommendation = llm.complete(f"""

User history: {history}

Based on past preferences, what should we recommend?

""")

# Show recommendation, collect feedback

feedback = user_feedback # thumbs up/down

# Store feedback for future recommendations

db.log_feedback(user_id, recommendation, feedback)

return recommendation

Na verloop van tijd verbeteren aanbevelingen naarmate de agent gebruikersvoorkeuren leert.

Hiërarchische agents (agents die andere agents managen)

Hoe ze werken (supervisor-agent delegeert aan specialisten)

Een supervisor-agent coördineert specialist-agents.

Supervisor: "Verwerk dit supportticket"

├─ Classifier-agent: "Dit is een factureringsissue"

├─ Billing-specialist-agent: "Terugbetaal $50"

└─ Notificatie-agent: "Stuur bevestigingsmail"

Beste voor: enterprise-workflows, grootschalige automatisering

- Contentcreatie (onderzoek → schrijven → redigeren → publiceren)

- Complexe klantenondersteuning (triage → oplossen → escaleren)

- Dataverwerkingspijplijnen (extraheren → transformeren → laden)

Voorbeeld: content-creatiepijplijn (onderzoek → schrijven → redigeren → publiceren)

def content_pipeline_agent(topic):

# Supervisor delegates

research = research_agent(topic)

draft = writer_agent(research)

edited = editor_agent(draft)

published = publisher_agent(edited)

return {"topic": topic, "status": "published"}

Elke specialist-agent is geoptimaliseerd voor zijn taak. De supervisor orkestreert.

Toonaangevende AI-agent-tools en -frameworks in 2026 (vergelijkingstabel)

Evaluatiecriteria

Redeneervermogen (Chain-of-Thought, planning, reflexion)

Hoe verfijnd het denken van de agent is. Eenvoudige agents gebruiken chain-of-thought. Complexe agents gebruiken planning en reflexion.

Tool-integratie (hoe makkelijk je custom tools toevoegt)

Kun je eenvoudig API’s, databases en CRM-systemen aansluiten? Of heb je custom code nodig?

Leercurve (setup-tijd, documentatiekwaliteit)

Hoe snel kan een ontwikkelaar een werkende agent opzetten? No-code-platforms zijn sneller; Python-frameworks flexibeler.

Prijsmodel (gratis, per API-call, abonnement)

Sommige frameworks zijn open-source (gratis). Andere rekenen per API-call of via abonnement.

Beste toepassingen

Waarvoor is elke tool geoptimaliseerd?

Vergelijkingstabel: toonaangevende AI-agent-tools en -frameworks (2026)

| Tool | Frameworktype | Redeneervermogen | Tool-integratie | Leercurve | Prijs | Beste voor |

|---|---|---|---|---|---|---|

| n8n | Visuele workflow-builder | Chain-of-thought | 500+ integraties | Laag | Gratis + betaald | Niet-technische gebruikers, snelle setup |

| CrewAI | Python-framework | Planning + reflexion | Custom tools (Python) | Gemiddeld | Open-source | Ontwikkelaars, complexe agents |

| Autogen | Python-framework | Multi-agent-redenering | Custom tools | Hoog | Open-source | Onderzoek, multi-agent-systemen |

| LangGraph | Python-framework | Planning + statemanagement | LangChain-ecosysteem | Gemiddeld | Open-source | Complexe workflows, state-tracking |

| FlowHunt | Native platform | Chain-of-thought + planning | Native + API-integraties | Laag | Abonnement | Workflow-automatisering, gebruiksgemak |

| Lindy.ai | No-code-platform | Chain-of-thought | 100+ integraties | Zeer laag | Freemium | Niet-technisch, snelle agents |

| Gumloop | No-code-platform | Chain-of-thought | 50+ integraties | Zeer laag | Freemium | Eenvoudige automatisering, templates |

Belangrijkste verschillen:

- No-code (n8n, FlowHunt, Lindy.ai): Snel te bouwen, beperkte aanpasbaarheid. Goed voor standaardworkflows.

- Python-frameworks (CrewAI, Autogen, LangGraph): Flexibel, krachtig, steilere leercurve. Goed voor complexe logica.

- Open-source (CrewAI, Autogen, LangGraph): Gratis, maar je beheert de infrastructuur zelf. Betaalde platforms regelen de hosting.

Hoe kies je de juiste tool voor jouw use case

- Snel prototype (< 1 week): Gebruik no-code (FlowHunt, n8n, Lindy.ai)

- Complexe agent met custom logica: Gebruik Python-framework (CrewAI, LangGraph)

- Multi-agent-systeem (agents die coördineren): Gebruik Autogen

- Productie-workflow-automatisering: Gebruik FlowHunt (gemanaged, gemonitord, geschaald)

Je eerste agent bouwen: stap-voor-stap-architectuur

Definieer het doel en de scope van de agent

Welk probleem lost hij op?

Wees specifiek. Slecht: “Automatiseer leadbeheer.” Goed: “Scoor leads 0-100, verrijk met bedrijfsdata, wijs toe aan salesmedewerkers op basis van capaciteit.”

Wat zijn de succescijfers?

- Nauwkeurigheid: % juiste beslissingen (doel: > 90%)

- Latency: Tijd om taak te voltooien (doel: < 10 seconden)

- Kosten: API-calls per taak (doel: < $0,05)

- Automatiseringsgraad: % taken zonder menselijke tussenkomst (doel: > 80%)

Wat zijn de randvoorwaarden (latency, kosten, nauwkeurigheid)?

Afwegingen:

- Real-time-workflows: Nodig < 5 seconden latency. Gebruik snelle modellen, minder tool-calls.

- Batch-workflows: Kan 5-30 minuten tolereren. Gebruik nauwkeurigere redenering, meer tool-calls.

- Kostengevoelig: Gebruik open-source-modellen, minder API-calls.

- Nauwkeurigheidskritiek: Gebruik dure modellen (GPT-4), meerstapsvalidatie.

Ontwerp de agent-loop

Wat gaat de agent observeren?

Inputdata: leaddata, documenttekst, klantvraag, context uit geheugen.

Welke redeneermodus (simpele chain-of-thought vs. planning)?

- Chain-of-thought: Snel, eenvoudig. “Ik doe stap 1, dan stap 2.”

- Planning: Langzamer, nauwkeuriger. “Laat me eerst alle stappen plannen, dan uitvoeren.”

Welke tools heeft hij nodig?

Lijst de API’s, databases en services op die de agent gaat aanroepen.

Voorbeeld voor leadkwalificatie:

- CRM-API (lead ophalen/bijwerken)

- Data-enrichment-API (bedrijfsdata ophalen)

- Scoring-model (lead scoren)

- Notificatiedienst (Slack/e-mail sturen)

Hoe weet hij wanneer hij moet stoppen?

Definieer de succesvoorwaarde. “Stop wanneer lead is gescoord en toegewezen.”

Definieer ook max stappen om oneindige loops te voorkomen. “Stop na 10 stappen, ongeacht.”

Implementeer en test

Pseudocode of echt codevoorbeeld (CrewAI of FlowHunt)

CrewAI-voorbeeld:

from crewai import Agent, Task, Crew

# Define agents

enrichment_agent = Agent(

role="Data Enrichment Specialist",

goal="Enrich lead data with company information",

tools=[enrich_tool]

)

scoring_agent = Agent(

role="Lead Scoring Expert",

goal="Score leads based on fit criteria",

tools=[score_tool]

)

assignment_agent = Agent(

role="Sales Manager",

goal="Assign leads to best sales rep",

tools=[assign_tool, notify_tool]

)

# Define tasks

enrich_task = Task(

description="Enrich this lead: {lead_id}",

agent=enrichment_agent

)

score_task = Task(

description="Score the enriched lead",

agent=scoring_agent

)

assign_task = Task(

description="Assign lead to best rep and notify",

agent=assignment_agent

)

# Run crew

crew = Crew(agents=[enrichment_agent, scoring_agent, assignment_agent],

tasks=[enrich_task, score_task, assign_task])

result = crew.kickoff(inputs={"lead_id": "12345"})

Teststrategie (unit-tests voor tool-calls, integratietests voor loops)

def test_enrichment_tool():

result = enrich_tool("lead_123")

assert result['revenue'] is not None

assert result['employees'] is not None

def test_scoring_agent():

lead = {"company": "Acme", "revenue": "10M", "employees": 50}

score = score_agent(lead)

assert 0 <= score <= 100

def test_full_loop():

result = lead_qualification_agent("lead_123")

assert result['assigned_to'] is not None

assert result['score'] > 0

Veelvoorkomende problemen debuggen (oneindige loops, hallucinaties, verkeerde tools)

- Oneindige loops: Voeg max-stappen-limiet toe. Log elke stap. Monitor op herhaalde acties.

- Hallucinaties: Voeg validatie toe. Controleer outputs tegen brondata.

- Verkeerde tools: Verbeter tool-beschrijvingen. Voeg tool-validatie toe vóór uitvoering.

Echt voorbeeld: leadkwalificatie-agent

Doel: scoor leads, verrijk data, wijs toe aan salesteam

def lead_qualification_agent(lead_id):

"""

Autonomous agent that qualifies leads.

1. Fetches lead from CRM

2. Enriches with company data

3. Scores based on fit criteria

4. Assigns to best sales rep

5. Notifies rep

"""

Tools: CRM-API, data-enrichment-service, scoring-model

tools = {

"get_lead": crm.get_lead,

"enrich_lead": enrichment_api.enrich,

"score_lead": scoring_model.score,

"find_best_rep": crm.find_available_rep,

"assign_lead": crm.assign,

"send_notification": slack.send

}

Pseudocode-doorloop (lead observeren → scoren → verrijken → toewijzen)

# Step 1: Observe

lead = get_lead(lead_id)

print(f"Observing lead: {lead['company']}")

# Step 2: Reason (LLM decides next action)

# LLM: "I need to enrich this lead first"

# Step 3: Act

enriched = enrich_lead(lead)

print(f"Enriched: revenue={enriched['revenue']}")

# Step 4: Feedback + Loop

# LLM: "Now I'll score"

# Step 5: Act

score = score_lead(enriched)

print(f"Score: {score}")

# Step 6: Reason

# LLM: "Score is {score}, should assign to top rep"

# Step 7: Act

best_rep = find_best_rep(score)

assign_lead(lead_id, best_rep)

send_notification(best_rep, f"New lead: {lead['company']}")

print(f"Assigned to {best_rep}")

Resultaten: nauwkeurigheids-, latency- en kostencijfers

- Nauwkeurigheid: 94% (leadscore komt overeen met handmatige review)

- Latency: 8 seconden (5 tool-calls, 3 LLM-redeneerstappen)

- Kosten: $0,03 per lead (GPT-4-API-calls + enrichment-API)

- Doorvoer: 450 leads/uur (één agent-instantie)

- Automatiseringsgraad: 87% (13% geëscaleerd voor menselijke review)

Agents integreren met bedrijfssystemen

API-integratiepatronen

REST-API’s (meest gangbaar)

De meeste agents roepen REST-API’s aan. Gebruik een standaard HTTP-client:

def call_crm_api(endpoint, method="GET", data=None):

url = f"https://api.crm.com/{endpoint}"

headers = {"Authorization": f"Bearer {api_key}"}

if method == "GET":

response = requests.get(url, headers=headers)

elif method == "POST":

response = requests.post(url, json=data, headers=headers)

return response.json()

Webhooks (event-gedreven agent-triggers)

Trigger agents op events (nieuwe lead, inkomende e-mail, formulierinzending):

@app.post("/webhook/new_lead")

def on_new_lead(lead_data):

# Trigger agent asynchronously

queue.enqueue(lead_qualification_agent, lead_data['id'])

return {"status": "queued"}

Authenticatie en beveiliging (API-keys, OAuth, rate limiting)

- API-keys: Bewaar in environment variables, niet in code

- OAuth: Voor gebruikersgerichte integraties (Salesforce, HubSpot)

- Rate limiting: Respecteer API-limieten. Implementeer backoff- en retry-logica

from ratelimit import limits, sleep_and_retry

@sleep_and_retry

@limits(calls=100, period=60) # 100 calls per minute

def call_api(endpoint):

return requests.get(f"https://api.example.com/{endpoint}")

Database-integratie

Read-only (agent bevraagt data)

Agent leest klantdata, eerdere interacties, kennisbank:

def get_customer_history(customer_id):

query = "SELECT * FROM interactions WHERE customer_id = %s"

return db.execute(query, (customer_id,))

Schrijfoperaties (agent slaat beslissingen/resultaten op)

Agent schrijft beslissingen naar database:

def store_lead_score(lead_id, score, assigned_to):

db.execute(

"UPDATE leads SET score = %s, assigned_to = %s WHERE id = %s",

(score, assigned_to, lead_id)

)

Transacties en consistentie (data-integriteit waarborgen)

Gebruik transacties voor meerstapsoperaties:

with db.transaction():

score = score_lead(lead)

db.update_lead_score(lead_id, score)

rep = find_best_rep(score)

db.assign_lead(lead_id, rep)

# All-or-nothing: if any step fails, rollback

CRM- en zakelijke-tool-integratie

Salesforce-, HubSpot-, Pipedrive-integratiepatronen

Gebruik officiële SDK’s:

from salesforce import SalesforceAPI

sf = SalesforceAPI(api_key=key)

# Update lead

sf.update_lead(lead_id, {

'score': 85,

'assigned_to': 'john@acme.com',

'status': 'qualified'

})

Slack-, e-mail-, Jira-integratie (agent stuurt notificaties/updates)

from slack_sdk import WebClient

slack = WebClient(token=slack_token)

# Notify sales rep

slack.chat_postMessage(

channel="john",

text=f"New qualified lead: {lead['company']} (score: {score})"

)

Authenticatie en permissie-scoping

Gebruik OAuth-scopes om te beperken wat agents kunnen:

# Agent can only read leads, update scores

# Cannot delete leads or access sensitive data

oauth_scopes = ["leads:read", "leads:update"]

Human-in-the-loop-workflows

Wanneer agents menselijke goedkeuring nodig hebben

Risicovolle beslissingen: financiële transacties, klantrestituties, beleidsuitzonderingen.

if decision_risk_score > 0.7:

# Route to human for approval

escalate_to_human(decision, reason="High risk")

else:

# Agent executes decision

execute_decision(decision)

Escalatiepatronen (risicovolle beslissingen, randgevallen)

def lead_qualification_with_escalation(lead_id):

score = score_lead(lead_id)

if score > 80:

# High confidence, assign directly

assign_lead(lead_id, best_rep)

elif 50 < score < 80:

# Medium confidence, route to human

escalate_to_human(lead_id, "Review and assign")

else:

# Low score, reject

reject_lead(lead_id)

Feedbackloops (mensen corrigeren agent-fouten)

@app.post("/feedback/lead_score")

def on_score_feedback(lead_id, actual_score, agent_score):

# Store feedback

db.log_feedback(lead_id, agent_score, actual_score)

# Retrain model on feedback (periodic)

if should_retrain():

retrain_scoring_model()

Veelvoorkomende agent-fouten en hoe je ze voorkomt

Oneindige loops (agent blijft dezelfde actie herhalen)

Oorzaak: slechte doel-definitie, tool die geen voortgang boekt

# Bad: Agent keeps calling same tool

Agent denkt: "I need to get lead data"

→ Roept get_lead() aan

→ Heeft nog steeds geen verrijkte data

→ Roept get_lead() opnieuw aan

→ Oneindige loop

Preventie: max-stappen-limiet, voortgangstracking, tool-diversiteit

max_steps = 10

steps_taken = 0

while steps_taken < max_steps:

action = llm.decide_next_action()

if action == last_action:

# Same action twice, break loop

break

execute_action(action)

steps_taken += 1

Herstel: time-out, escalatie naar mens

try:

result = agent.run(timeout=30) # 30 second timeout

except TimeoutError:

escalate_to_human("Agent loop timeout")

Hallucinaties (agent verzint feiten of tool-outputs)

Oorzaak: LLM-neiging tot fabuleren, slechte tool-beschrijvingen

# Bad: Agent hallucinates tool output

Agent: "I called enrich_lead, got revenue=$100M"

Werkelijkheid: enrich_lead() returned null (API failed)

Agent made up the result

Preventie: Retrieval-Augmented Generation (RAG), tool-validatie, factchecking

def execute_tool_safely(tool_name, params):

try:

result = execute_tool(tool_name, params)

# Validate result

if result is None:

return {"error": "Tool returned null"}

if not validate_result(result):

return {"error": "Result failed validation"}

return result

except Exception as e:

return {"error": str(e)}

Gebruik RAG om de agent op feiten te baseren:

# Instead of: "Summarize this article"

# Use: "Summarize this article, citing specific passages"

knowledge_base = vector_db.search(query)

prompt = f"""

Summarize this article. Only cite specific passages.

Article: {article}

Knowledge base: {knowledge_base}

"""

Herstel: fallback naar mens, opnieuw proberen met andere redenering

def robust_agent_call(goal, retries=3):

for attempt in range(retries):

try:

result = agent.run(goal)

# Validate result

if validate(result):

return result

except Exception as e:

if attempt == retries - 1:

escalate_to_human(goal)

else:

time.sleep(2 ** attempt) # Backoff

Tool-misbruik (agent roept verkeerde tool of met verkeerde parameters aan)

Oorzaak: ambigue tool-beschrijvingen, slechte redenering

# Bad: Ambiguous tool description

"update_lead - Update a lead"

# Good: Clear description

"update_lead - Update a lead's score, status, or assigned_to field.

Parameters: lead_id (required), score (0-100), status (qualified/disqualified),

assigned_to (sales rep email)"

Preventie: heldere tool-docs, tool-gebruikstraining, validatie vóór uitvoering

# Validate before execution

tool_call = llm.decide_tool_call()

if not validate_tool_call(tool_call):

# Tool call is invalid, ask LLM to fix

llm.correct_tool_call(tool_call)

else:

execute_tool(tool_call)

def validate_tool_call(call):

tool = tools[call['name']]

required_params = tool['required_parameters']

for param in required_params:

if param not in call['params']:

return False

return True

Herstel: foutafhandeling, juiste tool voorstellen, opnieuw proberen

try:

result = execute_tool(tool_call)

except ToolExecutionError as e:

# Suggest correct tool

correct_tool = suggest_correct_tool(e)

llm.suggest_retry(correct_tool)

Kostenoverschrijdingen (agent gebruikt te veel API-calls)

Oorzaak: inefficiënte redenering, overbodige tool-calls

# Bad: Agent calls same tool multiple times

Agent: "Let me get lead data"

→ Roept get_lead() aan

→ Roept get_lead() opnieuw aan (vergeet dat dat al gebeurde)

→ Roept get_lead() een derde keer aan

Kosten: 3x hoger dan nodig

Preventie: budgetlimieten, call-deduplicatie, caching

budget = {"tokens": 10000, "api_calls": 50}

spent = {"tokens": 0, "api_calls": 0}

def execute_with_budget(action):

global spent

if spent['api_calls'] >= budget['api_calls']:

raise BudgetExceededError()

result = execute_action(action)

spent['api_calls'] += 1

return result

Implementeer caching:

cache = {}

def get_lead_cached(lead_id):

if lead_id in cache:

return cache[lead_id]

result = crm_api.get_lead(lead_id)

cache[lead_id] = result

return result

Herstel: kostenmonitoring, throttling, fallback naar goedkoper model

if cost_this_hour > budget_per_hour:

# Switch to cheaper model

switch_to_model("gpt-3.5-turbo") # Cheaper than GPT-4

Latency-problemen (agent te traag voor real-time gebruik)

Oorzaak: meerdere redeneerstappen, trage tool-responses

Een agent die 5 sequentiële API-calls van elk 1 seconde maakt = 5+ seconden latency.

Preventie: parallelle tool-executie, caching, snellere modellen

# Parallel execution

import asyncio

async def parallel_agent(lead_id):

lead = await get_lead_async(lead_id)

# Call multiple tools in parallel

enrichment, scoring = await asyncio.gather(

enrich_lead_async(lead),

score_lead_async(lead)

)

return (enrichment, scoring)

Gebruik snellere modellen:

# Instead of GPT-4 (slower, more accurate)

# Use GPT-3.5-turbo (faster, still accurate enough)

model = "gpt-3.5-turbo" # 200ms latency vs 500ms for GPT-4

Herstel: time-out, gedeeltelijke resultaten teruggeven, async in wachtrij zetten

try:

result = agent.run(timeout=5) # 5 second timeout

return result

except TimeoutError:

# Return partial results

return partial_result

# Queue for async completion

queue.enqueue(complete_agent, lead_id)

Agent-prestaties en ROI meten

Belangrijke metrics om te volgen

Nauwkeurigheid (% juiste beslissingen/acties)

Vergelijk de agent-output met de ground truth (menselijke review, werkelijke uitkomsten).

correct = 0

total = 100

for decision in agent_decisions:

if decision == human_review[decision.id]:

correct += 1

accuracy = correct / total * 100 # e.g., 94%

Latency (tijd om taak te voltooien)

Meet end-to-end tijd van input tot output.

start = time.time()

result = agent.run(input_data)

latency = time.time() - start # e.g., 8.5 seconds

Kosten per taak (API-calls, compute, menselijke review)

cost = (llm_api_calls * llm_cost) + (tool_calls * tool_cost) + (human_review_rate * hourly_rate)

# e.g., $0.03 per lead

Gebruikerstevredenheid (als er human-in-the-loop is)

Enquêteer gebruikers: “Hoe tevreden ben je met de beslissingen van de agent?”

Automatiseringsgraad (% taken voltooid zonder menselijke tussenkomst)

automated = tasks_completed_by_agent

total = all_tasks

automation_rate = automated / total * 100 # e.g., 87%

ROI-berekening

Baseline: kosten van handmatig proces (menselijke uren × uurtarief)

Manual lead qualification:

- 100 leads/month

- 5 minutes per lead

- 500 hours/month

- $20/hour = $10,000/month

Agent-kosten: infrastructuur + API-calls + menselijk toezicht

Agent-driven:

- 100 leads/month

- $0.03 per lead (API calls)

- $3 total API cost

- $500/month human review (10% escalation)

- $100/month infrastructure

Total: $603/month

Terugverdientijd: wanneer agent-kosten < handmatige kosten

Savings per month: $10,000 - $603 = $9,397

ROI: 1,557% (9,397 / 603)

Payback period: < 1 month (immediate)

Voorbeeld: ROI van leadkwalificatie-agent

Manual process:

- 500 leads/month

- 5 min per lead = 2,500 hours = $50,000/month

Agent process:

- 500 leads/month

- $0.03 per lead = $15

- 5% escalation (25 leads) = $250 human time

- Infrastructure = $500

Total: $765/month

Savings: $50,000 - $765 = $49,235/month

ROI: 6,436%

Continue verbetering

Monitor metrics in de tijd

# Track daily metrics

daily_metrics = {

'accuracy': 0.94,

'latency': 8.5,

'cost_per_task': 0.03,

'automation_rate': 0.87

}

A/B-test verschillende agent-configuraties

# Test 1: GPT-4 (more accurate, slower)

# Test 2: GPT-3.5-turbo (faster, slightly less accurate)

# Measure: accuracy, latency, cost

# Choose based on your priorities

Verwerk feedback om nauwkeurigheid te verbeteren

# Collect human feedback on agent mistakes

feedback = db.get_feedback()

# Retrain agent (adjust prompts, add examples)

agent.retrain(feedback)

# Measure: accuracy improves from 94% to 96%

Schaal succesvolle agents, trek niet-presterende terug

Monitor ROI. Als een agent geen waarde levert, trek hem terug. Schaal succesvolle agents uit naar andere teams.

Veelgestelde vragen

De FAQ-sectie wordt automatisch gerenderd vanuit de frontmatter en verschijnt hieronder.

{{ cta-dark-panel heading=“Bouw agents zonder de complexiteit” description=“Het native agent-platform van FlowHunt verzorgt tool-integratie, foutafhandeling en monitoring. Begin in minuten - niet weken - met het bouwen van autonome workflows.” ctaPrimaryText=“Probeer FlowHunt gratis” ctaPrimaryURL=“https://app.flowhunt.io/sign-in" ctaSecondaryText=“Boek een demo” ctaSecondaryURL=“https://www.flowhunt.io/demo/" gradientStartColor="#7c3aed” gradientEndColor="#ec4899” gradientId=“cta-ai-agents” }}