LLM Gemini

FlowHunt ondersteunt tientallen AI-modellen, waaronder Google Gemini. Leer hoe je Gemini gebruikt in je AI-tools en chatbots, schakel tussen modellen en beheer ...

LLM DeepSeek van FlowHunt geeft je toegang tot en laat je top AI-modellen zoals DeepSeek R1 aanpassen voor tekst- en beeldgeneratie in je chatbots en AI-tools, allemaal vanuit één dashboard.

Componentbeschrijving

The LLM DeepSeek component connects the DeepSeek models to your Flow. While the Generators and Agents are where the actual magic happens, LLM components allow you to swap and control the model used.

Remember that connecting an LLM Component is optional. All components that use an LLM come with ChatGPT-4o as the default. The LLM components allow you to change the model and control model settings.

Tokens represent the individual units of text the model processes and generates. Token usage varies with models, and a single token can be anything from words or subwords to a single character. Models are usually priced in millions of tokens.

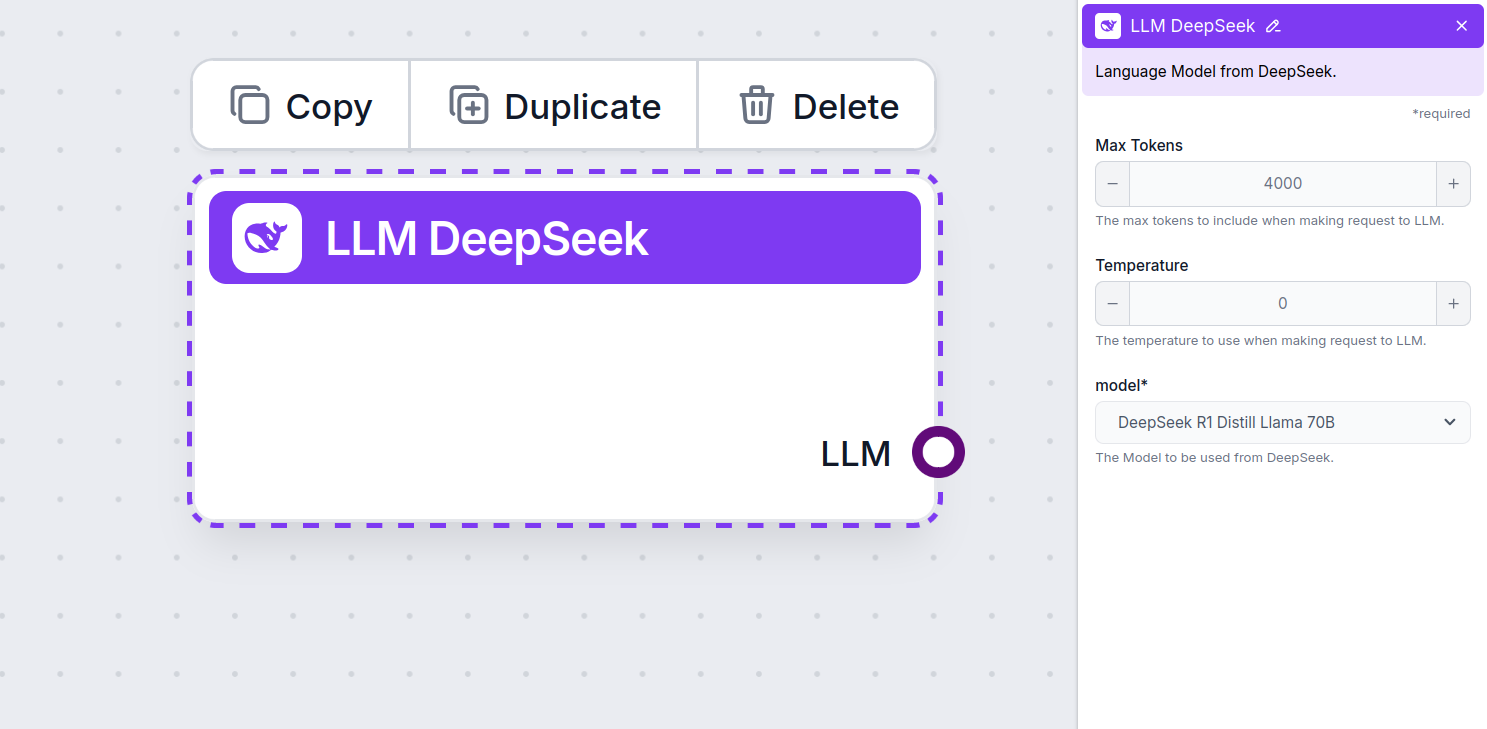

The max tokens setting limits the total number of tokens that can be processed in a single interaction or request, ensuring the responses are generated within reasonable bounds. The default limit is 4,000 tokens, the optimal size for summarizing documents and several sources to generate an answer.

Temperature controls the variability of answers, ranging from 0 to 1.

A temperature of 0.1 will make the responses very to the point but potentially repetitive and deficient.

A high temperature of 1 allows for maximum creativity in answers but creates the risk of irrelevant or even hallucinatory responses.

For example, the recommended temperature for a customer service bot is between 0.2 and 0.5. This level should keep the answers relevant and to the script while allowing for a natural response variation.

This is the model picker. Here, you’ll find all the supported DeepSeek models. We support all the latest Gemini models:

You’ll notice that all LLM components only have an output handle. Input doesn’t pass through the component, as it only represents the model, while the actual generation happens in AI Agents and Generators.

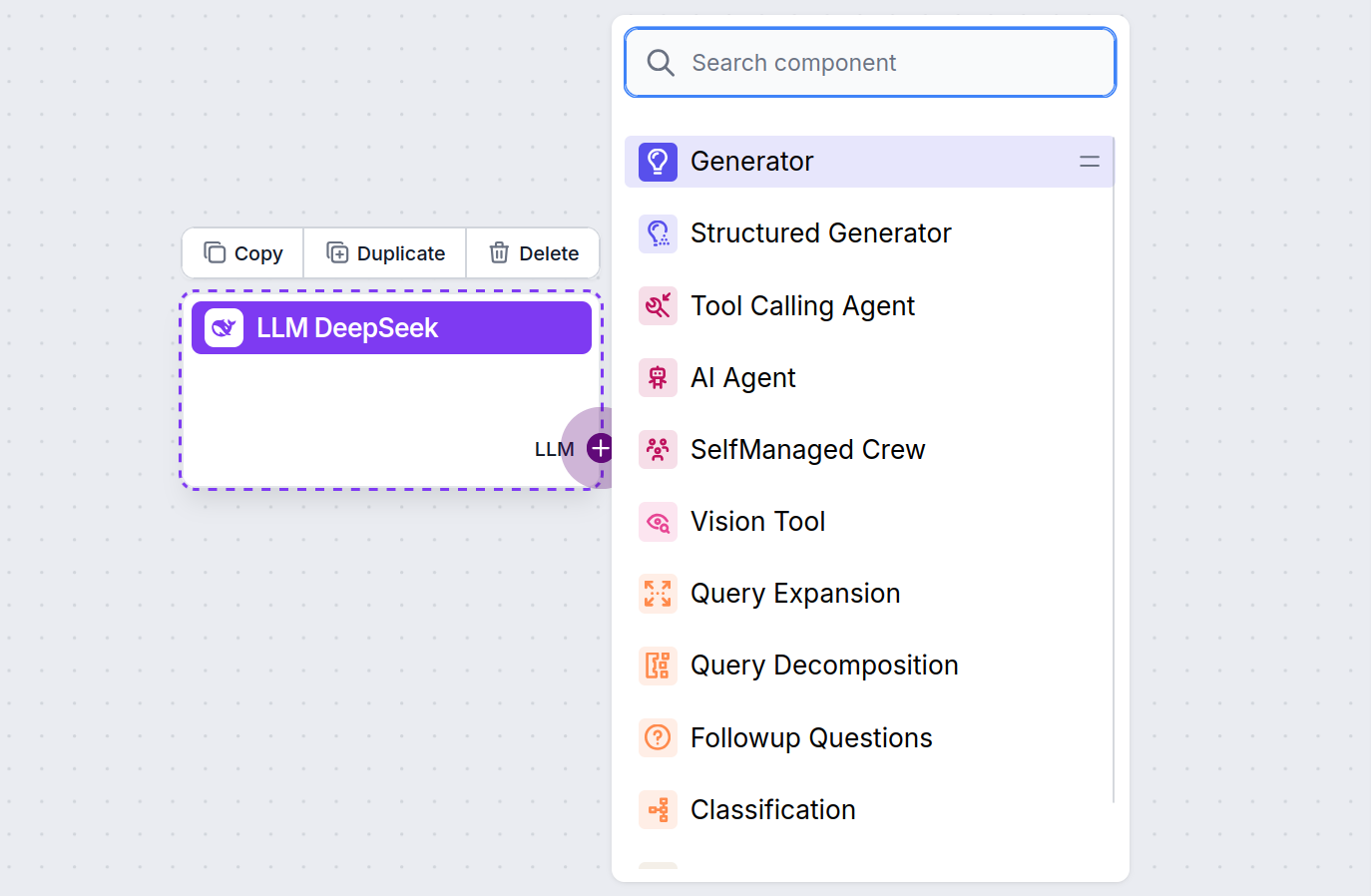

The LLM handle is always purple. The LLM input handle is found on any component that uses AI to generate text or process data. You can see the options by clicking the handle:

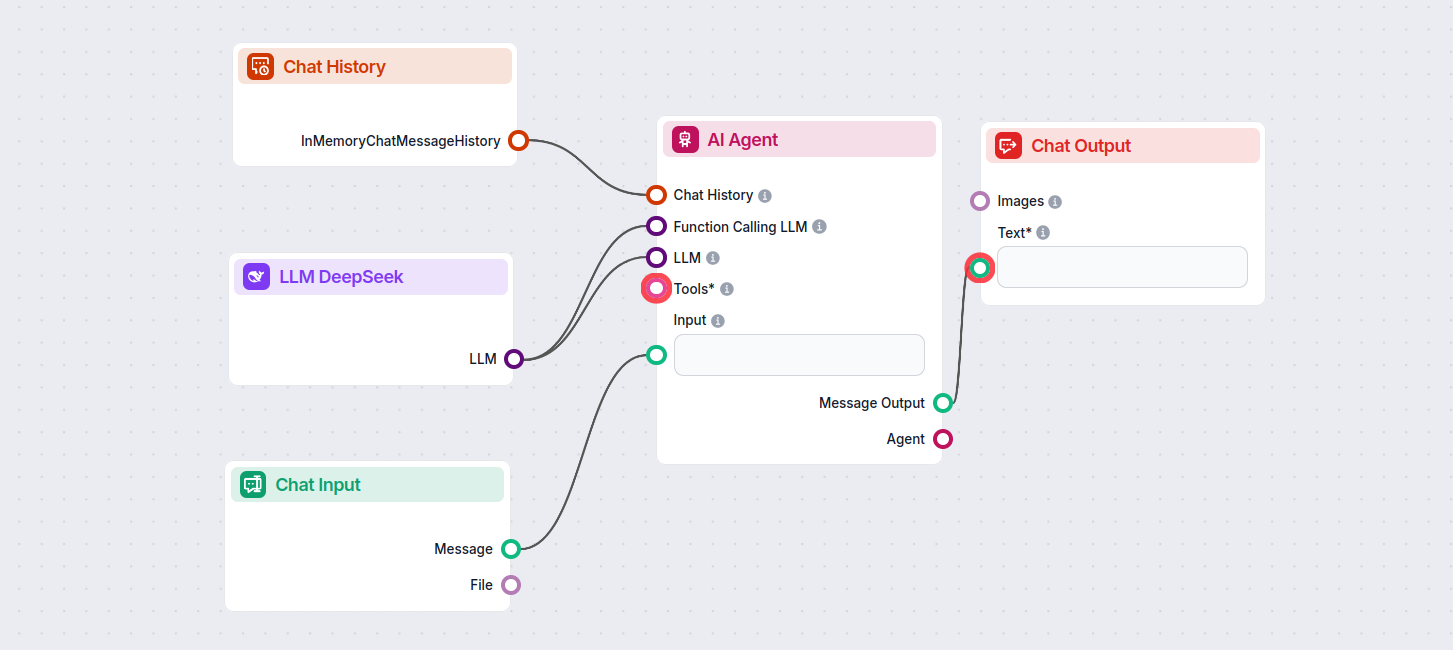

This allows you to create all sorts of tools. Let’s see the component in action. Here’s a simple AI Agent chatbot Flow using DeepSeek R1 to generate responses. You can think of it as a basic DeepSeek chatbot.

This simple Chatbot Flow includes:

LLM DeepSeek is een component in FlowHunt waarmee je DeepSeek AI-modellen voor tekst- en beeldgeneratie kunt verbinden en aansturen, wat krachtige chatbots en geautomatiseerde flows mogelijk maakt.

FlowHunt ondersteunt alle nieuwste DeepSeek-modellen, waaronder DeepSeek R1, bekend om zijn snelheid en prestaties, vooral in vergelijking met andere toonaangevende AI-modellen.

Je kunt het maximum aantal tokens voor de responslengte en de temperatuur voor de creativiteit van antwoorden aanpassen, evenals schakelen tussen beschikbare DeepSeek-modellen direct in je FlowHunt-dashboard.

Nee, het koppelen van een LLM-component is optioneel. Standaard gebruikt FlowHunt ChatGPT-4o, maar door LLM DeepSeek toe te voegen kun je wisselen en bepalen welk AI-model je flows aanstuurt.

Begin met het bouwen van slimmere AI-chatbots en automatiseringstools met geavanceerde DeepSeek-modellen—zonder complexe installatie of meerdere abonnementen.

FlowHunt ondersteunt tientallen AI-modellen, waaronder Google Gemini. Leer hoe je Gemini gebruikt in je AI-tools en chatbots, schakel tussen modellen en beheer ...

FlowHunt ondersteunt tientallen tekstgeneratiemodellen, waaronder modellen van xAI. Hier lees je hoe je de xAI-modellen gebruikt in je AI-tools en chatbots.

FlowHunt ondersteunt tientallen tekstgeneratiemodellen, waaronder de Llama-modellen van Meta. Leer hoe je Llama integreert in je AI-tools en chatbots, pas inste...