Transformers

Transformers zijn een revolutionaire neurale netwerkarchitectuur die kunstmatige intelligentie heeft getransformeerd, vooral op het gebied van natuurlijke taalv...

Transformers zijn neurale netwerken die aandachtmechanismen gebruiken om sequentiële data efficiënt te verwerken en uitblinken in NLP, spraakherkenning, genomica en meer.

Een transformermodel is een type neuraal netwerk dat speciaal is ontworpen om sequentiële data te verwerken, zoals tekst, spraak of tijdreeksdata. In tegenstelling tot traditionele modellen zoals Recurrent Neural Networks (RNN’s) en Convolutional Neural Networks (CNN’s), maken transformers gebruik van een mechanisme dat bekend staat als “aandacht” of “zelf-attentie” om het belang van verschillende elementen in de invoersequentie te wegen. Hierdoor kan het model lange-afstandsafhankelijkheden en relaties binnen de data vastleggen, waardoor het uitzonderlijk krachtig is voor een breed scala aan toepassingen.

In het hart van een transformermodel ligt het aandachtmechanisme, waarmee het model zich kan richten op verschillende delen van de invoersequentie bij het doen van voorspellingen. Dit mechanisme evalueert de relevantie van ieder element in de sequentie, waardoor het model complexe patronen en afhankelijkheden kan vastleggen die traditionele modellen mogelijk missen.

Zelf-aandacht is een speciale vorm van aandacht die binnen transformers wordt gebruikt. Het stelt het model in staat om de gehele invoersequentie tegelijkertijd te beschouwen, in plaats van deze sequentieel te verwerken. Deze parallelle verwerkingsmogelijkheid verbetert niet alleen de computationele efficiëntie, maar vergroot ook het vermogen van het model om complexe relaties in de data te begrijpen.

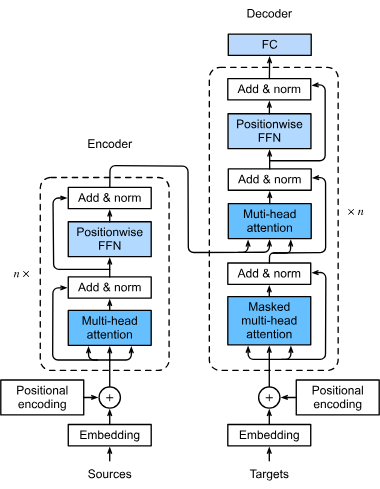

Een typisch transformermodel bestaat uit een encoder en een decoder:

Zowel de encoder als de decoder bestaan uit meerdere lagen van zelf-aandacht en feedforward neurale netwerken, die op elkaar gestapeld worden om een diep en krachtig model te creëren.

Transformers zijn de ruggengraat geworden van moderne NLP-taken. Ze worden gebruikt voor:

Transformers maken realtime spraakvertaling en transcriptie mogelijk, waardoor vergaderingen en klaslokalen toegankelijker worden voor diverse en slechthorende deelnemers.

Door het analyseren van de sequenties van genen en eiwitten versnellen transformers het proces van medicijnontwerp en gepersonaliseerde geneeskunde.

Transformers kunnen patronen en afwijkingen in grote datasets herkennen, waardoor ze van onschatbare waarde zijn voor het opsporen van frauduleuze activiteiten en het genereren van gepersonaliseerde aanbevelingen in e-commerce en streamingdiensten.

Transformers profiteren van een deugdzame cirkel: doordat ze in diverse toepassingen worden ingezet, genereren ze enorme hoeveelheden data, die vervolgens gebruikt kunnen worden om nog nauwkeurigere en krachtigere modellen te trainen. Deze cyclus van datageneratie en modelverbetering blijft de stand van zaken in AI vooruitstuwen, wat door sommige onderzoekers het “tijdperk van transformer-AI” wordt genoemd.

In tegenstelling tot RNN’s, die data sequentieel verwerken, verwerken transformers de hele sequentie tegelijk, wat zorgt voor meer parallelisatie en efficiëntie.

Hoewel CNN’s uitstekend zijn voor beelddata, blinken transformers uit in het verwerken van sequentiële data. Ze bieden een veelzijdiger en krachtiger architectuur voor een breder scala aan toepassingen.

Een transformermodel is een neuraal netwerkarchitectuur die is ontworpen om sequentiële data te verwerken met behulp van een aandachtmechanisme, waardoor het efficiënt relaties en afhankelijkheden binnen de data kan vastleggen.

In tegenstelling tot RNN's, die data sequentieel verwerken, verwerken transformers de hele invoersequentie tegelijk, wat zorgt voor meer efficiëntie. Terwijl CNN's goed geschikt zijn voor beelddata, blinken transformers uit in het verwerken van sequentiële data zoals tekst en spraak.

Transformers worden veel gebruikt in natuurlijke taalverwerking, spraakherkenning en -synthese, genomica, medicijnontwikkeling, fraudedetectie en aanbevelingssystemen vanwege hun vermogen om complexe sequentiële data te verwerken.

Probeer FlowHunt om aangepaste AI-chatbots en tools te maken, gebruikmakend van geavanceerde modellen zoals transformers voor jouw zakelijke behoeften.

Transformers zijn een revolutionaire neurale netwerkarchitectuur die kunstmatige intelligentie heeft getransformeerd, vooral op het gebied van natuurlijke taalv...

Een Generative Pre-trained Transformer (GPT) is een AI-model dat gebruikmaakt van deep learning-technieken om tekst te produceren die sterk lijkt op menselijke ...

Een Groot Taalmodel (LLM) is een type AI dat is getraind op enorme hoeveelheden tekstuele data om menselijke taal te begrijpen, genereren en manipuleren. LLM's ...