AI-agenter

Lær hvordan du bygger, konfigurerer og orkestrerer AI-agenter i FlowHunt. Fra enkle agenter til deep agents og fulle crew, finn alle veiledningene du trenger he...

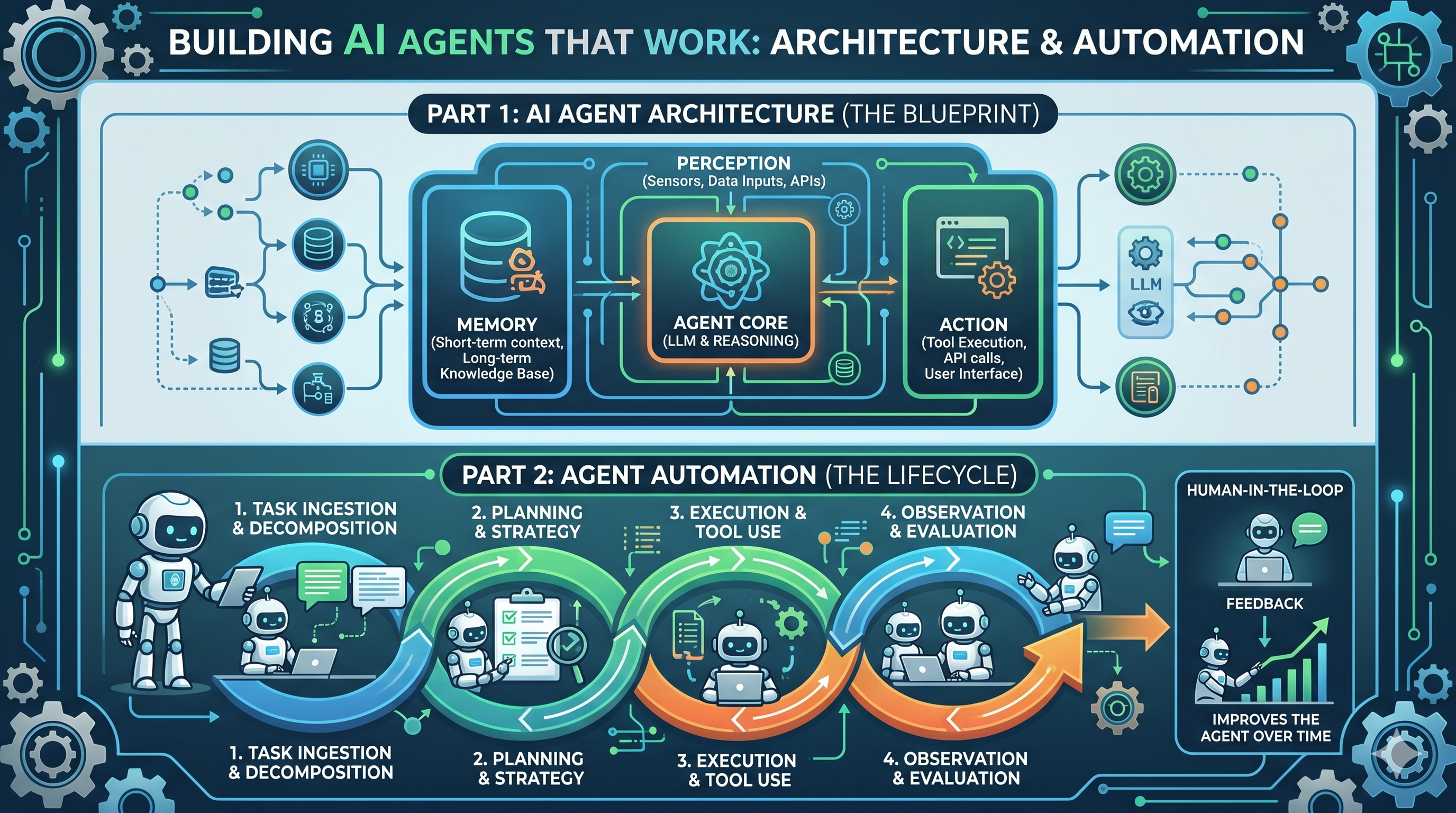

Lær hvordan du bygger pålitelige AI-agenter med riktig arkitektur, verktøyintegrasjon og feilforebygging. Sammenlign rammeverk, mønstre og eksempler fra virkeligheten.

AI-agenter er fundamentalt forskjellige fra chatboter. En chatbot venter på brukerinput og svarer. En agent forfølger mål autonomt, kaller verktøy, resonnerer om problemer og utfører handlinger uten menneskelig input ved hvert steg.

Dette skillet er viktig fordi agenter kan automatisere hele arbeidsflyter. En agent for lead-kvalifisering scorer prospekter, beriker dataene deres og tildeler dem til salgsrepresentanter - alt uten menneskelig inngripen. En agent for innholdssortering kategoriserer supporthenvendelser, ruter dem til spesialister og eskalerer kanttilfeller til mennesker.

I denne guiden lærer du hvordan du arkitekterer pålitelige agenter, integrerer dem med forretningssystemer, forhindrer vanlige feil og måler effekten deres. Vi dekker reelle mønstre som brukes i produksjon hos selskaper som automatiserer lead-kvalifisering, dokumentbehandling og kundestøtte i stor skala.

En AI-agent er et programvaresystem som:

Agenter er måldrevne. Du definerer målet (“Score og kvalifiser denne leaden”), og agenten finner ut hvordan den skal oppnå det.

Bruker: "Hva er statusen på ordren min?"

Chatbot: [Slår opp ordre, svarer]

Bruker: "Kan du kansellere den?"

Chatbot: [Kansellerer ordre, svarer]

Brukeren driver hver interaksjon. Chatboten er tilstandsløs - hver melding er uavhengig.

Agentmål: "Kvalifiser og score denne leaden"

1. Agent observerer: [Lead-data fra CRM]

2. Agent resonnerer: "Jeg må berike disse dataene og score dem"

3. Agent handler: Kaller berikelses-API

4. Agent observerer: [Berikede data]

5. Agent resonnerer: "Score er 85, bør tildele toppselger"

6. Agent handler: Oppdaterer CRM, sender varsel

7. Ferdig. Ingen menneskelig input kreves.

Agenten jobber mot et definert mål og tar flere beslutninger og verktøykall autonomt.

Manuell lead-kvalifisering: 5 minutter per lead × 100 leads = 500 timer/måned. Kostnad: $10 000/måned (ved $20/time).

Agent-drevet: 10 sekunder per lead × 100 leads = 16 timer/måned. Kostnad: $100 (agent-API-kall). Besparelse: 99%.

Agenter mangedobler teamets kapasitet uten ansettelser.

Komplekse oppgaver krever flere steg:

Agenter håndterer denne resonneringen automatisk. Du definerer målet; agenten bryter det ned i steg.

Agenter er “hender”. De kaller API-er for å:

En enkelt agent kan orkestrere 5-10 verktøykall for å fullføre en arbeidsflyt.

Agenter kan forbedre seg over tid. Hvis en agent feilklassifiserer dokumenter, gir du tilbakemelding. Agenten lærer og justerer prompt-strategien.

Kjernen i enhver agent er en løkke:

┌─────────────────────────────────────────┐

│ START: Agent mottar mål │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ OBSERVER: Les input, verktøyresultater,│

│ minne, omgivelser │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ RESONNER: LLM bestemmer neste handling │

│ (hvilket verktøy, eller fer- │

│ dig?) │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ HANDLE: Utfør verktøykall eller full- │

│ før oppgave │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ TILBAKEMELDING: Evaluer resultat, │

│ oppdater minne, sjekk │

│ mål │

└────────────────┬────────────────────────┘

│

├─→ Mål ikke nådd? Gå tilbake til OBSERVER

│

└─→ Mål nådd eller maks steg? FERDIG

Agenten leser:

LLM-en mottar en prompt som:

Du er en lead-kvalifiseringsagent. Målet ditt er å score og kvalifisere denne leaden.

Tilgjengelige verktøy:

1. enrich_lead(lead_id) - Hent ekstra data om leaden

2. score_lead(lead_data) - Score basert på kriterier

3. assign_to_sales_rep(lead_id, rep_id) - Tildel lead til selger

4. send_notification(rep_id, message) - Varsle selger

Nåværende tilstand:

- Lead ID: 12345

- Selskap: Acme Corp

- Omsetning: Ukjent (må berikes)

- Status: Ikke scoret ennå

Hva bør du gjøre nå?

LLM-en svarer: “Jeg bør berike leaden først for å få omsetningsdata, så score, så tildele.”

Agenten utfører det valgte verktøyet:

result = enrich_lead(lead_id=12345)

# Returns: {'revenue': '$10M', 'industry': 'SaaS', 'employees': 150}

Agenten sjekker: Lyktes verktøykallet? Beveget det oss mot målet? Oppdater minne og fortsett løkken.

Agenten gjentar observasjon → resonnering → handling → tilbakemelding inntil:

Verktøy er funksjoner agenten kan kalle. Definer dem tydelig:

tools = [

{

"name": "enrich_lead",

"description": "Get additional company data about a lead (revenue, employees, industry)",

"parameters": {

"lead_id": {"type": "string", "description": "Unique identifier of the lead"}

}

},

{

"name": "score_lead",

"description": "Score a lead on a scale of 0-100 based on fit criteria",

"parameters": {

"lead_data": {"type": "object", "description": "Lead information including revenue, industry, etc."}

}

}

]

Tydelige beskrivelser hjelper LLM-en å velge riktig verktøy.

LLM-en svarer med et verktøykall:

{

"thought": "I need to enrich this lead to get revenue data",

"action": "enrich_lead",

"action_input": {"lead_id": "12345"}

}

Agent-rammeverket ditt utfører verktøyet og sender resultatet tilbake til LLM-en.

Håndter både suksess og feil:

def execute_tool(tool_name, tool_input):

try:

if tool_name == "enrich_lead":

result = crm_api.enrich(tool_input['lead_id'])

return {"status": "success", "data": result}

except Exception as e:

return {"status": "error", "message": str(e)}

Hvis et verktøy feiler, bør agenten prøve en annen tilnærming eller eskalere til et menneske.

Agentens arbeidsminne: nåværende input, verktøyresultater, resonneringssteg. Vanligvis lagret i kontekstvinduet (prompten).

Eksempel: lead-kvalifiseringsagenten husker:

Vedvarende minne: tidligere beslutninger, lærte mønstre, kunnskapsbase.

Brukstilfeller:

Implementer med vektordatabaser (Pinecone, Weaviate) for semantisk søk.

LLM-er har begrensede kontekstvinduer (4K-128K tokens). Agenter kan ikke huske alt. Strategier:

For de fleste agenter er Claude eller åpen kildekode-modeller tilstrekkelige og billigere.

Eksempel på reflexion-prompt:

Agent: "Jeg tildeler denne leaden til selger John."

Kritiker: "Vent, sjekket du om John allerede er på maks kapasitet?"

Agent: "Godt poeng. La meg sjekke Johns arbeidsbelastning først."

Velg hastighet for sanntid (kundestøtte). Velg nøyaktighet for høy innsats (finansielle beslutninger).

Reaktive agenter tar én beslutning og handler. Ingen flerstegsplanlegging.

Input: "Hva er kontosaldoen min?"

→ Agent spør database

→ Agent svarer med saldo

Ferdig.

def customer_service_agent(question):

# 1. Search knowledge base

articles = search_kb(question)

# 2. LLM picks best article

response = llm.complete(f"""

Question: {question}

Relevant articles: {articles}

Provide an answer based on these articles.

""")

# 3. Return response

return response

Latens: 1-3 sekunder. Kostnad: $0,001-0,01 per spørring.

Planleggingsagenter bryter komplekse mål ned i steg.

Mål: "Kvalifiser og tildel denne leaden"

→ Agent planlegger: [berike, score, tildele, varsle]

→ Agent utfører hvert steg

→ Agent verifiserer at målet er nådd

Ferdig.

def lead_qualification_agent(lead_id):

lead = crm.get_lead(lead_id)

# Step 1: Enrich

enriched = enrich_lead(lead)

# Step 2: Score

score = score_lead(enriched)

# Step 3: Assign

best_rep = find_best_sales_rep(score)

crm.assign_lead(lead_id, best_rep)

# Step 4: Notify

send_slack(f"New qualified lead assigned to {best_rep}")

return {"lead_id": lead_id, "score": score, "assigned_to": best_rep}

Latens: 5-15 sekunder. Kostnad: $0,02-0,05 per lead.

Lærende agenter blir bedre med tilbakemeldinger.

Initiell: Agent klassifiserer dokument som "Faktura" (60% konfidens)

Menneskelig tilbakemelding: "Det er faktisk en Kvittering"

Agent lærer: Justerer klassifiseringsprompter

Neste gang: Samme dokument klassifisert som "Kvittering" (90% konfidens)

def recommendation_agent(user_id):

# Get user history

history = db.get_user_history(user_id)

# LLM recommends based on patterns

recommendation = llm.complete(f"""

User history: {history}

Based on past preferences, what should we recommend?

""")

# Show recommendation, collect feedback

feedback = user_feedback # thumbs up/down

# Store feedback for future recommendations

db.log_feedback(user_id, recommendation, feedback)

return recommendation

Over tid forbedres anbefalingene etter hvert som agenten lærer brukerpreferansene.

En supervisor-agent koordinerer spesialist-agenter.

Supervisor: "Behandle denne supporthenvendelsen"

├─ Klassifiserer-agent: "Dette er en faktureringssak"

├─ Faktureringsspesialist-agent: "Refunder $50"

└─ Varslingsagent: "Send bekreftelses-e-post"

def content_pipeline_agent(topic):

# Supervisor delegates

research = research_agent(topic)

draft = writer_agent(research)

edited = editor_agent(draft)

published = publisher_agent(edited)

return {"topic": topic, "status": "published"}

Hver spesialist-agent er optimalisert for sin oppgave. Supervisor orkestrerer.

Hvor sofistikert agentens tenkning er. Enkle agenter bruker chain-of-thought. Komplekse agenter bruker planlegging og reflexion.

Kan du enkelt koble til API-er, databaser, CRM-systemer? Eller trenger du egen kode?

Hvor raskt kan en utvikler få en fungerende agent? No-code-plattformer er raskere; Python-rammeverk er mer fleksible.

Noen rammeverk er åpen kildekode (gratis). Andre tar betalt per API-kall eller abonnement.

Hva er hvert verktøy optimalisert for?

| Verktøy | Rammeverktype | Resonneringsevne | Verktøyintegrasjon | Læringskurve | Pris | Best for |

|---|---|---|---|---|---|---|

| n8n | Visuell arbeidsflyt-bygger | Chain-of-thought | 500+ integrasjoner | Lav | Gratis + betalt | Ikke-tekniske brukere, rask oppsett |

| CrewAI | Python-rammeverk | Planlegging + reflexion | Egendefinerte verktøy (Python) | Middels | Åpen kildekode | Utviklere, komplekse agenter |

| Autogen | Python-rammeverk | Multi-agent-resonnering | Egendefinerte verktøy | Høy | Åpen kildekode | Forskning, multi-agent-systemer |

| LangGraph | Python-rammeverk | Planlegging + tilstandsstyring | LangChain-økosystem | Middels | Åpen kildekode | Komplekse arbeidsflyter, tilstandssporing |

| FlowHunt | Native plattform | Chain-of-thought + planlegging | Native + API-integrasjoner | Lav | Abonnement | Arbeidsflyt-automatisering, brukervennlighet |

| Lindy.ai | No-code-plattform | Chain-of-thought | 100+ integrasjoner | Svært lav | Freemium | Ikke-teknisk, raske agenter |

| Gumloop | No-code-plattform | Chain-of-thought | 50+ integrasjoner | Svært lav | Freemium | Enkel automatisering, maler |

Nøkkelforskjeller:

Vær spesifikk. Dårlig: “Automatiser lead-håndtering.” Bra: “Score leads 0-100, berike med selskapsdata, tildel selgere basert på kapasitet.”

Avveininger:

Inputdata: lead-data, dokumenttekst, kundespørsmål, kontekst fra minne.

List opp API-er, databaser, tjenester agenten vil kalle.

Eksempel for lead-kvalifisering:

Definer suksessbetingelsen. “Stopp når leaden er scoret og tildelt.”

Definer også maks steg for å forhindre uendelige løkker. “Stopp etter 10 steg, uansett.”

CrewAI-eksempel:

from crewai import Agent, Task, Crew

# Define agents

enrichment_agent = Agent(

role="Data Enrichment Specialist",

goal="Enrich lead data with company information",

tools=[enrich_tool]

)

scoring_agent = Agent(

role="Lead Scoring Expert",

goal="Score leads based on fit criteria",

tools=[score_tool]

)

assignment_agent = Agent(

role="Sales Manager",

goal="Assign leads to best sales rep",

tools=[assign_tool, notify_tool]

)

# Define tasks

enrich_task = Task(

description="Enrich this lead: {lead_id}",

agent=enrichment_agent

)

score_task = Task(

description="Score the enriched lead",

agent=scoring_agent

)

assign_task = Task(

description="Assign lead to best rep and notify",

agent=assignment_agent

)

# Run crew

crew = Crew(agents=[enrichment_agent, scoring_agent, assignment_agent],

tasks=[enrich_task, score_task, assign_task])

result = crew.kickoff(inputs={"lead_id": "12345"})

def test_enrichment_tool():

result = enrich_tool("lead_123")

assert result['revenue'] is not None

assert result['employees'] is not None

def test_scoring_agent():

lead = {"company": "Acme", "revenue": "10M", "employees": 50}

score = score_agent(lead)

assert 0 <= score <= 100

def test_full_loop():

result = lead_qualification_agent("lead_123")

assert result['assigned_to'] is not None

assert result['score'] > 0

def lead_qualification_agent(lead_id):

"""

Autonomous agent that qualifies leads.

1. Fetches lead from CRM

2. Enriches with company data

3. Scores based on fit criteria

4. Assigns to best sales rep

5. Notifies rep

"""

tools = {

"get_lead": crm.get_lead,

"enrich_lead": enrichment_api.enrich,

"score_lead": scoring_model.score,

"find_best_rep": crm.find_available_rep,

"assign_lead": crm.assign,

"send_notification": slack.send

}

# Step 1: Observe

lead = get_lead(lead_id)

print(f"Observing lead: {lead['company']}")

# Step 2: Reason (LLM decides next action)

# LLM: "I need to enrich this lead first"

# Step 3: Act

enriched = enrich_lead(lead)

print(f"Enriched: revenue={enriched['revenue']}")

# Step 4: Feedback + Loop

# LLM: "Now I'll score"

# Step 5: Act

score = score_lead(enriched)

print(f"Score: {score}")

# Step 6: Reason

# LLM: "Score is {score}, should assign to top rep"

# Step 7: Act

best_rep = find_best_rep(score)

assign_lead(lead_id, best_rep)

send_notification(best_rep, f"New lead: {lead['company']}")

print(f"Assigned to {best_rep}")

De fleste agenter kaller REST API-er. Bruk standard HTTP-klient:

def call_crm_api(endpoint, method="GET", data=None):

url = f"https://api.crm.com/{endpoint}"

headers = {"Authorization": f"Bearer {api_key}"}

if method == "GET":

response = requests.get(url, headers=headers)

elif method == "POST":

response = requests.post(url, json=data, headers=headers)

return response.json()

Utløs agenter ved hendelser (ny lead, innkommende e-post, skjemainnsending):

@app.post("/webhook/new_lead")

def on_new_lead(lead_data):

# Trigger agent asynchronously

queue.enqueue(lead_qualification_agent, lead_data['id'])

return {"status": "queued"}

from ratelimit import limits, sleep_and_retry

@sleep_and_retry

@limits(calls=100, period=60) # 100 calls per minute

def call_api(endpoint):

return requests.get(f"https://api.example.com/{endpoint}")

Agent leser kundedata, tidligere interaksjoner, kunnskapsbase:

def get_customer_history(customer_id):

query = "SELECT * FROM interactions WHERE customer_id = %s"

return db.execute(query, (customer_id,))

Agent skriver beslutninger til database:

def store_lead_score(lead_id, score, assigned_to):

db.execute(

"UPDATE leads SET score = %s, assigned_to = %s WHERE id = %s",

(score, assigned_to, lead_id)

)

Bruk transaksjoner for flerstegsoperasjoner:

with db.transaction():

score = score_lead(lead)

db.update_lead_score(lead_id, score)

rep = find_best_rep(score)

db.assign_lead(lead_id, rep)

# All-or-nothing: if any step fails, rollback

Bruk offisielle SDK-er:

from salesforce import SalesforceAPI

sf = SalesforceAPI(api_key=key)

# Update lead

sf.update_lead(lead_id, {

'score': 85,

'assigned_to': 'john@acme.com',

'status': 'qualified'

})

from slack_sdk import WebClient

slack = WebClient(token=slack_token)

# Notify sales rep

slack.chat_postMessage(

channel="john",

text=f"New qualified lead: {lead['company']} (score: {score})"

)

Bruk OAuth-scopes for å begrense hva agenter kan gjøre:

# Agent can only read leads, update scores

# Cannot delete leads or access sensitive data

oauth_scopes = ["leads:read", "leads:update"]

Høyrisikobeslutninger: finansielle transaksjoner, kunderefusjoner, policy-unntak.

if decision_risk_score > 0.7:

# Route to human for approval

escalate_to_human(decision, reason="High risk")

else:

# Agent executes decision

execute_decision(decision)

def lead_qualification_with_escalation(lead_id):

score = score_lead(lead_id)

if score > 80:

# High confidence, assign directly

assign_lead(lead_id, best_rep)

elif 50 < score < 80:

# Medium confidence, route to human

escalate_to_human(lead_id, "Review and assign")

else:

# Low score, reject

reject_lead(lead_id)

@app.post("/feedback/lead_score")

def on_score_feedback(lead_id, actual_score, agent_score):

# Store feedback

db.log_feedback(lead_id, agent_score, actual_score)

# Retrain model on feedback (periodic)

if should_retrain():

retrain_scoring_model()

# Bad: Agent keeps calling same tool

Agent tenker: "I need to get lead data"

→ Kaller get_lead()

→ Har fortsatt ikke berikede data

→ Kaller get_lead() igjen

→ Uendelig løkke

max_steps = 10

steps_taken = 0

while steps_taken < max_steps:

action = llm.decide_next_action()

if action == last_action:

# Same action twice, break loop

break

execute_action(action)

steps_taken += 1

try:

result = agent.run(timeout=30) # 30 second timeout

except TimeoutError:

escalate_to_human("Agent loop timeout")

# Bad: Agent hallucinates tool output

Agent: "I called enrich_lead, got revenue=$100M"

Virkelighet: enrich_lead() returned null (API failed)

Agent made up the result

def execute_tool_safely(tool_name, params):

try:

result = execute_tool(tool_name, params)

# Validate result

if result is None:

return {"error": "Tool returned null"}

if not validate_result(result):

return {"error": "Result failed validation"}

return result

except Exception as e:

return {"error": str(e)}

Bruk RAG for å forankre agenten i fakta:

# Instead of: "Summarize this article"

# Use: "Summarize this article, citing specific passages"

knowledge_base = vector_db.search(query)

prompt = f"""

Summarize this article. Only cite specific passages.

Article: {article}

Knowledge base: {knowledge_base}

"""

def robust_agent_call(goal, retries=3):

for attempt in range(retries):

try:

result = agent.run(goal)

# Validate result

if validate(result):

return result

except Exception as e:

if attempt == retries - 1:

escalate_to_human(goal)

else:

time.sleep(2 ** attempt) # Backoff

# Bad: Ambiguous tool description

"update_lead - Update a lead"

# Good: Clear description

"update_lead - Update a lead's score, status, or assigned_to field.

Parameters: lead_id (required), score (0-100), status (qualified/disqualified),

assigned_to (sales rep email)"

# Validate before execution

tool_call = llm.decide_tool_call()

if not validate_tool_call(tool_call):

# Tool call is invalid, ask LLM to fix

llm.correct_tool_call(tool_call)

else:

execute_tool(tool_call)

def validate_tool_call(call):

tool = tools[call['name']]

required_params = tool['required_parameters']

for param in required_params:

if param not in call['params']:

return False

return True

try:

result = execute_tool(tool_call)

except ToolExecutionError as e:

# Suggest correct tool

correct_tool = suggest_correct_tool(e)

llm.suggest_retry(correct_tool)

# Bad: Agent calls same tool multiple times

Agent: "Let me get lead data"

→ Kaller get_lead()

→ Kaller get_lead() igjen (glemte at det allerede var gjort)

→ Kaller get_lead() en tredje gang

Kostnad: 3x høyere enn nødvendig

budget = {"tokens": 10000, "api_calls": 50}

spent = {"tokens": 0, "api_calls": 0}

def execute_with_budget(action):

global spent

if spent['api_calls'] >= budget['api_calls']:

raise BudgetExceededError()

result = execute_action(action)

spent['api_calls'] += 1

return result

Implementer caching:

cache = {}

def get_lead_cached(lead_id):

if lead_id in cache:

return cache[lead_id]

result = crm_api.get_lead(lead_id)

cache[lead_id] = result

return result

if cost_this_hour > budget_per_hour:

# Switch to cheaper model

switch_to_model("gpt-3.5-turbo") # Cheaper than GPT-4

En agent som gjør 5 sekvensielle API-kall med 1 sekund hvert = 5+ sekunders latens.

# Parallel execution

import asyncio

async def parallel_agent(lead_id):

lead = await get_lead_async(lead_id)

# Call multiple tools in parallel

enrichment, scoring = await asyncio.gather(

enrich_lead_async(lead),

score_lead_async(lead)

)

return (enrichment, scoring)

Bruk raskere modeller:

# Instead of GPT-4 (slower, more accurate)

# Use GPT-3.5-turbo (faster, still accurate enough)

model = "gpt-3.5-turbo" # 200ms latency vs 500ms for GPT-4

try:

result = agent.run(timeout=5) # 5 second timeout

return result

except TimeoutError:

# Return partial results

return partial_result

# Queue for async completion

queue.enqueue(complete_agent, lead_id)

Sammenlign agent-output med fasit (menneskelig gjennomgang, faktiske utfall).

correct = 0

total = 100

for decision in agent_decisions:

if decision == human_review[decision.id]:

correct += 1

accuracy = correct / total * 100 # e.g., 94%

Mål ende-til-ende-tid fra input til output.

start = time.time()

result = agent.run(input_data)

latency = time.time() - start # e.g., 8.5 seconds

cost = (llm_api_calls * llm_cost) + (tool_calls * tool_cost) + (human_review_rate * hourly_rate)

# e.g., $0.03 per lead

Undersøk brukere: “Hvor fornøyd er du med agentens beslutninger?”

automated = tasks_completed_by_agent

total = all_tasks

automation_rate = automated / total * 100 # e.g., 87%

Manual lead qualification:

- 100 leads/month

- 5 minutes per lead

- 500 hours/month

- $20/hour = $10,000/month

Agent-driven:

- 100 leads/month

- $0.03 per lead (API calls)

- $3 total API cost

- $500/month human review (10% escalation)

- $100/month infrastructure

Total: $603/month

Savings per month: $10,000 - $603 = $9,397

ROI: 1,557% (9,397 / 603)

Payback period: < 1 month (immediate)

Manual process:

- 500 leads/month

- 5 min per lead = 2,500 hours = $50,000/month

Agent process:

- 500 leads/month

- $0.03 per lead = $15

- 5% escalation (25 leads) = $250 human time

- Infrastructure = $500

Total: $765/month

Savings: $50,000 - $765 = $49,235/month

ROI: 6,436%

# Track daily metrics

daily_metrics = {

'accuracy': 0.94,

'latency': 8.5,

'cost_per_task': 0.03,

'automation_rate': 0.87

}

# Test 1: GPT-4 (more accurate, slower)

# Test 2: GPT-3.5-turbo (faster, slightly less accurate)

# Measure: accuracy, latency, cost

# Choose based on your priorities

# Collect human feedback on agent mistakes

feedback = db.get_feedback()

# Retrain agent (adjust prompts, add examples)

agent.retrain(feedback)

# Measure: accuracy improves from 94% to 96%

Overvåk ROI. Hvis en agent ikke leverer verdi, pensjoner den. Skaler vellykkede agenter til andre team.

FAQ-seksjonen rendres automatisk fra frontmatter og vises nedenfor.

{{ cta-dark-panel heading=“Bygg agenter uten kompleksiteten” description=“FlowHunts native agent-plattform håndterer verktøyintegrasjon, feilhåndtering og overvåkning. Kom i gang med å bygge autonome arbeidsflyter på minutter - ikke uker.” ctaPrimaryText=“Prøv FlowHunt gratis” ctaPrimaryURL=“https://app.flowhunt.io/sign-in" ctaSecondaryText=“Book en demo” ctaSecondaryURL=“https://www.flowhunt.io/demo/" gradientStartColor="#7c3aed” gradientEndColor="#ec4899” gradientId=“cta-ai-agents” }}

Arshia er en AI Workflow Engineer hos FlowHunt. Med bakgrunn i informatikk og en lidenskap for kunstig intelligens, spesialiserer han seg på å lage effektive arbeidsflyter som integrerer AI-verktøy i daglige oppgaver, og dermed øker produktivitet og kreativitet.

FlowHunts native agent-plattform håndterer verktøyintegrasjon, feilhåndtering og overvåkning. Kom i gang med å bygge autonome arbeidsflyter på minutter.

Lær hvordan du bygger, konfigurerer og orkestrerer AI-agenter i FlowHunt. Fra enkle agenter til deep agents og fulle crew, finn alle veiledningene du trenger he...

En guide til å bruke AI-agenter og verktøykallende agenter i FlowHunt for å lage avanserte AI-chatboter som automatiserer oppgaver, integrerer flere verktøy og ...

Lær hvordan du lager autonome AI-agenter som jobber sammen for å håndtere komplekse oppgaver. Bygg et live agent-handlingspunktsammendrag på få minutter.