Slack-integrasjon

FlowHunts Slack-integrasjon muliggjør sømløst AI-samarbeid direkte i ditt Slack-arbeidsområde. Ta med enhver Flow inn i Slack, automatiser arbeidsflyter, gi san...

Koble enhver LLM (Claude, GPT, Gemini, Grok, Llama, Mistral) til Slack med FlowHunts no-code flytbygger. Oppsettet er det samme for hver modell — velg den modellen som passer ditt bruksområde, og driftsett på minutter.

Å legge til en AI-assistent i Slack pleide å bety å velge en leverandør, skrive integrasjonskode og bygge alt på nytt når en bedre modell kom seks måneder senere. Med FlowHunt er integrasjonen frikoblet fra modellen: du bygger Slack-flyten én gang, kobler på den LLM-en du vil ha — Claude, GPT, Gemini, Grok, Llama, Mistral — og bytter den ut når som helst uten å røre resten.

Denne guiden går gjennom hele oppsettet. Første halvdel er den samme for hver modell. Andre halvdel forklarer hvilken modell man skal velge for hvilket bruksområde, med notater spesifikke for hver LLM-familie. Hopp til avsnittet som passer din stack, eller les fra ende til annen hvis du starter fra null.

Slack er der team stiller spørsmål. En AI-agent som lever der besvarer dem umiddelbart — uten å bytte kontekst til et separat chatverktøy, dashbord eller kunnskapsbase. Vanlige utrullinger:

Boten lever i Slack, så adopsjonen er automatisk — ingen må lære et nytt verktøy.

Oppsettet er identisk uansett hvilken AI-modell du velger. Velg modell i trinn 4; alt annet forblir det samme.

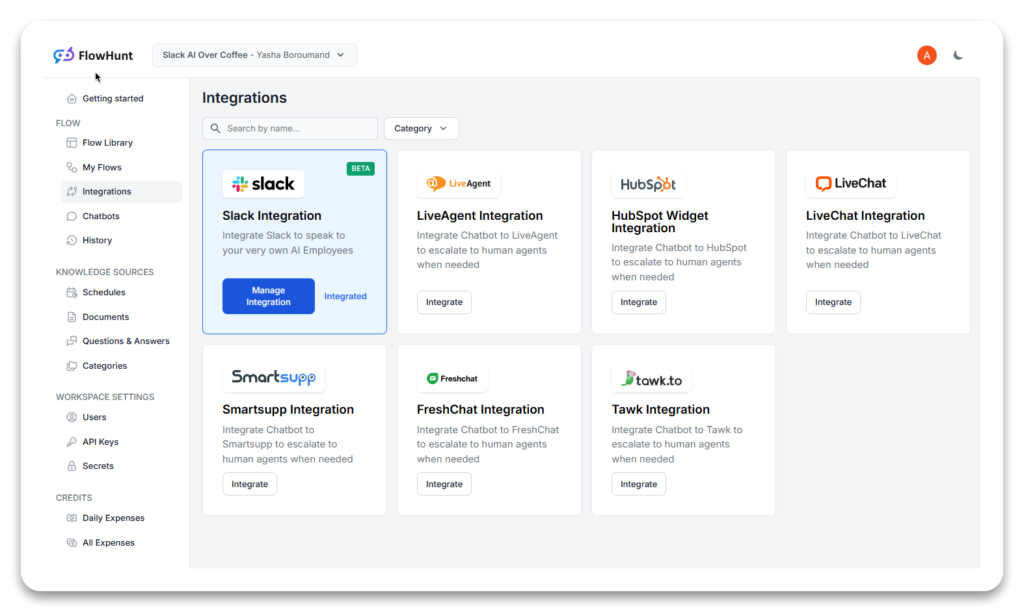

Logg inn på din FlowHunt -konto og åpne fanen Integrations. Velg Slack, klikk Connect, og autoriser appen på Slacks OAuth-skjerm. Gi de lese-/skrivetillatelsene FlowHunt ber om — de lar boten motta meldinger og poste svar i arbeidsområdet ditt.

URL-en til arbeidsområdet ditt vises i øvre venstre hjørne av Slack-skrivebords- eller webappen — kopier den derfra hvis FlowHunt spør. Når den er autorisert, er Slack koblet til og klar til bruk i enhver flyt.

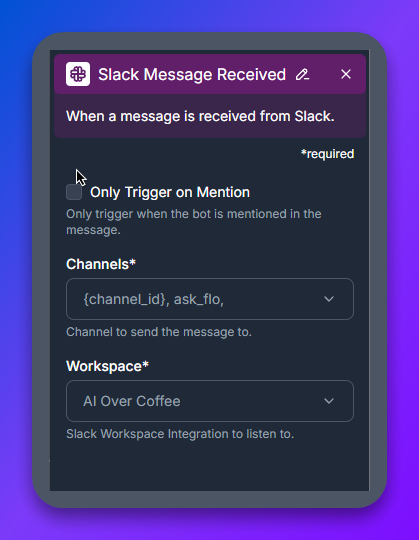

I FlowHunts flytbygger, slipp en Slack Message Received-komponent på lerretet. Denne blokken lytter etter innkommende Slack-meldinger og utløser resten av flyten.

Konfigurer to innstillinger:

#ai-assistant-kanal er det reneste oppsettet.

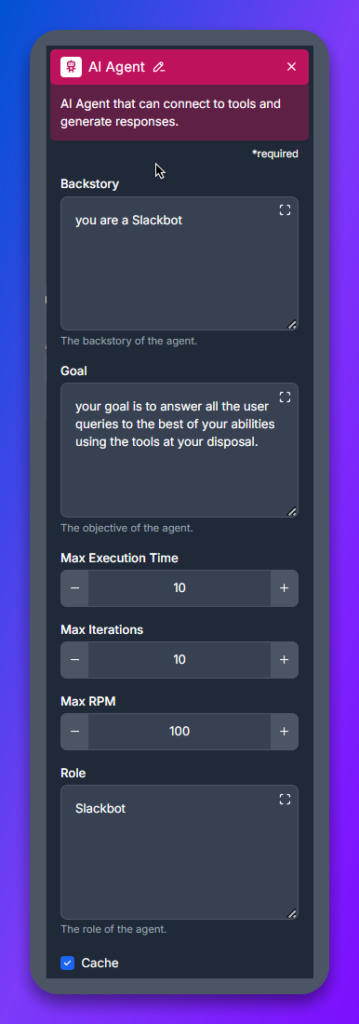

AI Agent-blokken er botens resonnementslag. Den tar brukerens melding, bestemmer hvilke verktøy som skal brukes, og utformer svaret.

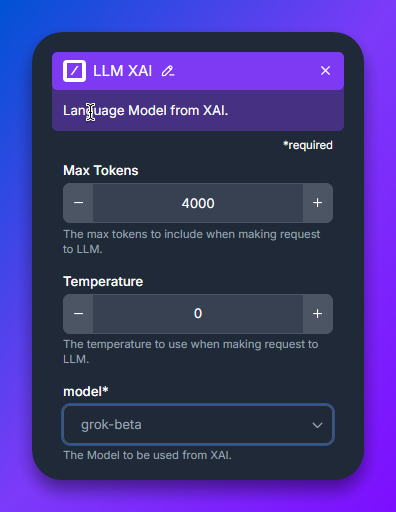

Koble en LLM-komponent til AI-agenten. Det er her du velger hvilken AI-modell som driver boten. FlowHunt har en separat LLM-komponent for hver leverandør — LLM OpenAI, LLM Anthropic, LLM Google, LLM Meta, LLM Mistral, LLM xAI — og inne i hver velger du den spesifikke modellvarianten.

Dette er det eneste trinnet som er forskjellig per modell. Hopp til avsnittet Velg riktig AI-modell nedenfor for en sammenligning og notater per familie.

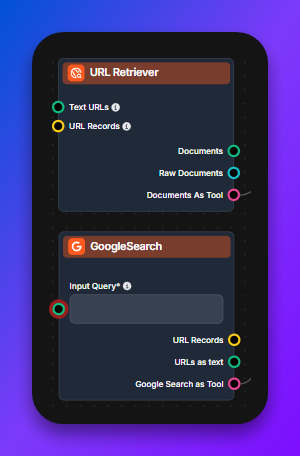

AI-agenten blir dramatisk mer nyttig når den kan bruke verktøy. Vanlige er:

Verktøy er modell-agnostiske. Enhver LLM du velger i trinn 4 kan bruke ethvert verktøy du kobler inn.

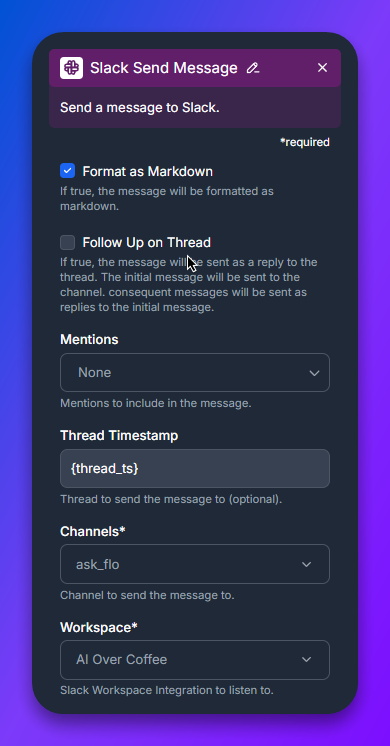

Avslutt flyten med en Slack Send Message-komponent, konfigurert for samme kanal og arbeidsområde som trinn 2. Lagre flyten, åpne Slack, og @-nevn boten i testkanalen din. Boten skal svare ved hjelp av modellen du valgte i trinn 4.

Det er hele oppsettet. Å bytte modell senere er en ett-klikks-endring i trinn 4 — ingen kodeendringer, ingen ombygging av flyten.

Alle store LLM-familier fungerer i FlowHunts Slack-flyt. Forskjellene handler om kostnad, latens, kontekstvindu, resonnementsdybde og kvalitet på tool-calling. Bruk tabellen til å lage en kortliste, og les deretter det familiespesifikke avsnittet for oppsettsnotater.

| Modellfamilie | Best for | Latens | Kostnad | Notater |

|---|---|---|---|---|

| Claude (Anthropic) | Lang-kontekst-analyse, nøye resonnering, kodegjennomgang | Middels | Middels–Høy | Sterk på å følge nyanserte instruksjoner; utmerket for intern Q&A over dokumenter |

| GPT / o-serien (OpenAI) | Generelt formål, bredt verktøyøkosystem, multimodal | Lav–Middels | Lav (mini) – Høy (o-serie) | GPT-4o Mini er standard sweet spot; o1 / o3 for hard resonnering |

| Gemini (Google) | Massive kontekstvinduer, rask multimodal, søkebasert | Lav | Lav–Middels | 1.5 Pro håndterer 1M+ tokens; flott for hel-dokument Slack-Q&A |

| Grok (xAI) | Sanntid / nyhetsbevisste forespørsler, X (Twitter)-data, uformell tone | Lav | Middels | Best når boten trenger bevissthet om aktuelle hendelser |

| Llama (Meta) | Selv-hostede / private utrullinger, kostnadssensitive arbeidsmengder | Avhenger av host | Lav (selv-hostet) | Åpne vekter — bruk når dataresidens betyr noe |

| Mistral | Open-weight, balansert kostnad/kvalitet, EU-vennlig hosting | Lav | Lav–Middels | Mistral Large konkurrerer med GPT-4o til lavere kostnad |

Velg én å starte med. Å bytte modell i FlowHunt er en ett-klikks-endring i LLM-komponenten, så det lønner seg ikke å overtenke det første valget — driftsett med et fornuftig standardvalg, mål kvalitet på reell Slack-trafikk, iterer.

Hvert avsnitt nedenfor er selvstendig. Velg avsnittet for modellfamilien du kobler til, og følg notatene.

Claude er Anthropics familie av LLM-er, godt egnet for Slackbots som håndterer nyansert intern Q&A, dokumentoppsummering, kodegjennomgang og nøye instruksjonsoppfølging. For å koble Claude til Slack, slipp LLM Anthropic-komponenten i trinn 4 og velg varianten:

For interne kunnskapsslackbots over Notion eller Confluence er Claude 3.5 Sonnet pluss en Document Retriever det mest pålitelige utgangspunktet.

OpenAIs GPT- og o-serie-modeller er det bredeste valget for Slack — sterk generell ytelse, den mest modne tool-callingen og multimodal input (visjon, lyd). Slipp LLM OpenAI-komponenten i trinn 4 og velg varianten:

For de fleste team: start med GPT-4o Mini. Oppgrader til GPT-4o eller o1 kun på flyter der brukerne klager på svarkvaliteten.

Google Gemini er det sterkeste valget når kontekstvinduet betyr noe — Gemini 1.5 Pro håndterer over 1M tokens, nok til å slippe hele kodebaser eller dokumentsett inn i én enkelt Slack-forespørsel. Slipp LLM Google-komponenten i trinn 4 og velg varianten:

Hvis Slackboten din må resonnere over hele kunnskapsbasen i én passering (uten retrieval-trinn), er Gemini Pros kontekstvindu det reneste svaret.

xAI Grok er innebygd i FlowHunts Slack-flyt på samme måte som de andre modellene — slipp LLM xAI-komponenten (eller bruk LLM OpenAI-komponenten som peker på Grok-endepunktet, avhengig av FlowHunt-versjonen din) og velg Grok-varianten. Groks særtrekk er sanntidsbevissthet — den har tilgang til live informasjon, inkludert X (Twitter)-data, noe som gjør den til det beste valget når Slackboten trenger kontekst om aktuelle hendelser: nyheter, markedsdata, breaking news. Par den med Google Search Tool for enda bredere webtilgang.

Metas Llama-familie er open-weight-alternativet — bruk det når dataresidens, selv-hosting eller kostnad per token utelukker hostede API-er. Slipp LLM Meta-komponenten i trinn 4 og velg varianten:

Llama er det rette svaret når sikkerhets- eller compliance-teamet krever at modellen kjører på infrastruktur du kontrollerer, eller når høyt meldingsvolum gjør hostede API-kostnader uoverkommelige.

Mistral er den europeiske open-weight-utfordreren — sterke modeller, EU-vennlig hosting og god pris-ytelse. Slipp LLM Mistral-komponenten i trinn 4 og velg varianten:

Velg Mistral når EU-dataresidens betyr noe, eller når du vil ha open-weight-fleksibilitet med kvalitet nærmere frontier enn Llama 3.x i noen benchmarks.

Tre flytmønstre dekker de fleste Slack-utrullinger. Bygg hvilken som helst av dem oppå oppsettet ovenfor ved å justere AI-agentens verktøy og prompt:

Disse mønstrene legger seg rent oppå hverandre: én enkelt Slack-flyt kan kombinere kunnskapsbase-retrieval, live websøk og interne API-kall, der LLM-en velger riktig verktøy per forespørsel.

Boten svarer ikke på meldinger. Sjekk at “Only Trigger on Mention” matcher hvordan du tester — hvis det er aktivert, må du @-nevne boten. Bekreft at kanalen i Slack Message Received matcher kanalen du poster i.

Boten svarer, men svaret er dårlig. Iterer på AI-agentens backstory og goal først — de har større effekt enn å bytte modell. Hvis kvaliteten fortsatt er dårlig etter prompt-iterasjon, oppgrader til en sterkere modell i LLM-komponenten (Mini → standard → toppklasse).

Tillatelsesfeil etter Slack-auth. Koble til Slack-integrasjonen på nytt i FlowHunts Integrations-fane og gi tillatelser igjen. Slack ugyldiggjør av og til tokens etter endringer i arbeidsområdets eier.

Lange svar avkortes i Slack. Slack har en grense for tegn per melding. Legg til et etterbehandlingstrinn i flyten for å dele opp lange svar, eller instruer AI-agenten i målet sitt om å holde svar under 3 000 tegn ved posting til Slack.

Hele oppsettet — å koble til Slack, bygge flyten, velge modell — er et kveldsprosjekt i FlowHunt. Flyten du bygger i dag fungerer med enhver fremtidig modell: når GPT-6 eller Claude 5 kommer, bytter du LLM-komponenten, og resten av flyten fortsetter å kjøre.

Start med FlowHunts gratisnivå , koble til Slack, og lanser en fungerende AI-Slackbot før lunsj.

Arshia er en AI Workflow Engineer hos FlowHunt. Med bakgrunn i informatikk og en lidenskap for kunstig intelligens, spesialiserer han seg på å lage effektive arbeidsflyter som integrerer AI-verktøy i daglige oppgaver, og dermed øker produktivitet og kreativitet.

FlowHunts no-code flytbygger kobler Slack til alle store LLM-er — Claude, GPT, Gemini, Grok, Llama, Mistral — gjennom én konsistent flyt. Ingen kode, ingen infrastruktur å håndtere.

FlowHunts Slack-integrasjon muliggjør sømløst AI-samarbeid direkte i ditt Slack-arbeidsområde. Ta med enhver Flow inn i Slack, automatiser arbeidsflyter, gi san...

FlowHunt 2.6.12 introduserer Slack-integrasjon, intensjonsklassifisering og Gemini-modellen, som forbedrer AI-chatbotens funksjonalitet, kundeinnsikt og teamarb...

Integrer FlowHunt med Slack for å automatisere meldinger, utløse arbeidsflyter og holde teamet ditt oppdatert med AI-drevne flyter.