LLM-sikkerhet

LLM-sikkerhet omfatter praksiser, teknikker og kontroller som brukes for å beskytte utrullinger av store språkmodeller mot en unik klasse av AI-spesifikke trusl...

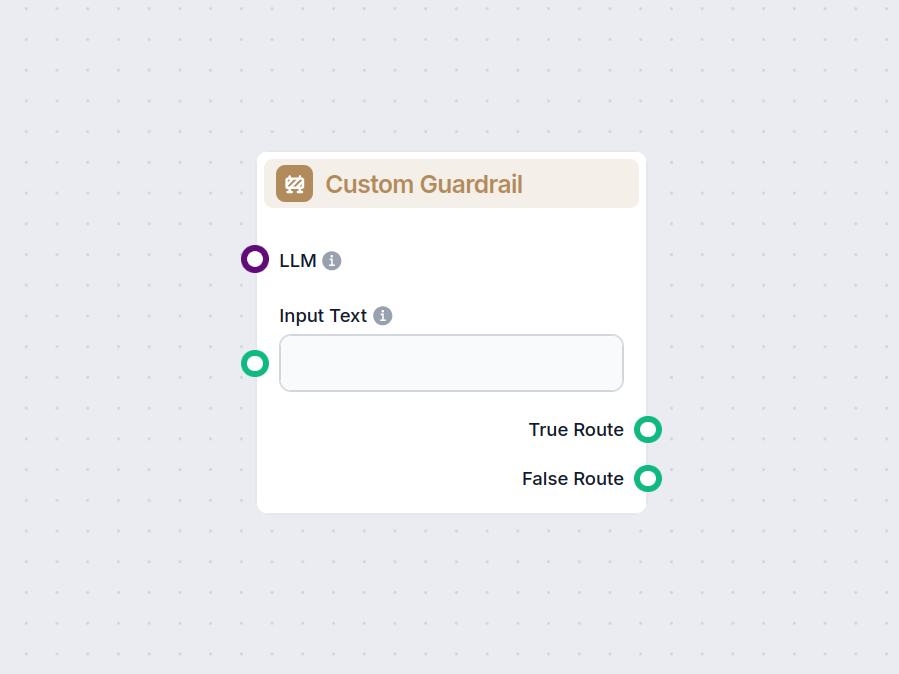

Egendefinert Sikkerhetsbarriere bruker en AI-modell og prompt for å validere brukerinput, slik at kun relevante temaer slipper gjennom arbeidsflyten din.

Komponentbeskrivelse

Komponenten Egendefinert Sikkerhetsbarriere fungerer som et intelligent filter i en AI-arbeidsflyt, og sikrer at brukerinput samsvarer med spesifikke kriterier satt av arbeidsflytdesigneren. Denne komponenten benytter en språkmodell (LLM) i kombinasjon med en tilpassbar prompt for å validere og kontrollere flyten av samtale eller data.

I sin kjerne fungerer Egendefinert Sikkerhetsbarriere som en portvokter for brukerinput. Den bruker en prompt (“Sikkerhetsbarriereprompten”) for å instruere LLM om hva som anses som akseptabelt innhold. For eksempel begrenser standardprompten samtaler strengt til sportstemaer og blokkerer alt som er utenfor tema eller meningsløst (tull). Denne mekanismen sikrer at AI-arbeidsflyten forblir fokusert og ikke avviker fra sitt tiltenkte formål.

| Navn | Type | Beskrivelse |

|---|---|---|

| LLM | HandleInput | Språkmodellen som brukes til å evaluere og håndheve sikkerhetsbarrieren. |

| Sikkerhetsbarriereprompt | PromptInput | Instruksjonen gitt til LLM om hvilket innhold som er tillatt. |

| Innputtekst | Melding | Brukerens melding eller innhold som skal valideres. |

| Navn | Type | Beskrivelse |

|---|---|---|

| True-rute | Melding | Output hvis innputteksten passerer sikkerhetsbarrieresjekken (dvs. oppfyller kriteriene). |

| False-rute | Melding | Output hvis innputteksten ikke møter kriteriene og blir filtrert ut/avvist. |

Ved å integrere Egendefinert Sikkerhetsbarriere i din AI-arbeidsflyt får du detaljert kontroll over hvilket innhold som aksepteres, og sikrer at AI-systemet ditt oppfører seg som ønsket og leverer pålitelige, relevante resultater.

Beskytt AI-arbeidsflytene dine og form brukerinteraksjoner med Egendefinert Sikkerhetsbarriere—laget for presis inputfiltrering og temakontroll.

LLM-sikkerhet omfatter praksiser, teknikker og kontroller som brukes for å beskytte utrullinger av store språkmodeller mot en unik klasse av AI-spesifikke trusl...