Hva er LLM DeepSeek-komponenten?

LLM DeepSeek-komponenten kobler DeepSeek-modellene til din Flow. Mens Generatorer og Agenter er der den faktiske magien skjer, lar LLM-komponentene deg bytte og kontrollere hvilken modell som brukes.

Husk at det er valgfritt å koble til en LLM-komponent. Alle komponenter som bruker en LLM har ChatGPT-4o som standard. LLM-komponentene lar deg endre modellen og kontrollere modellinnstillingene.

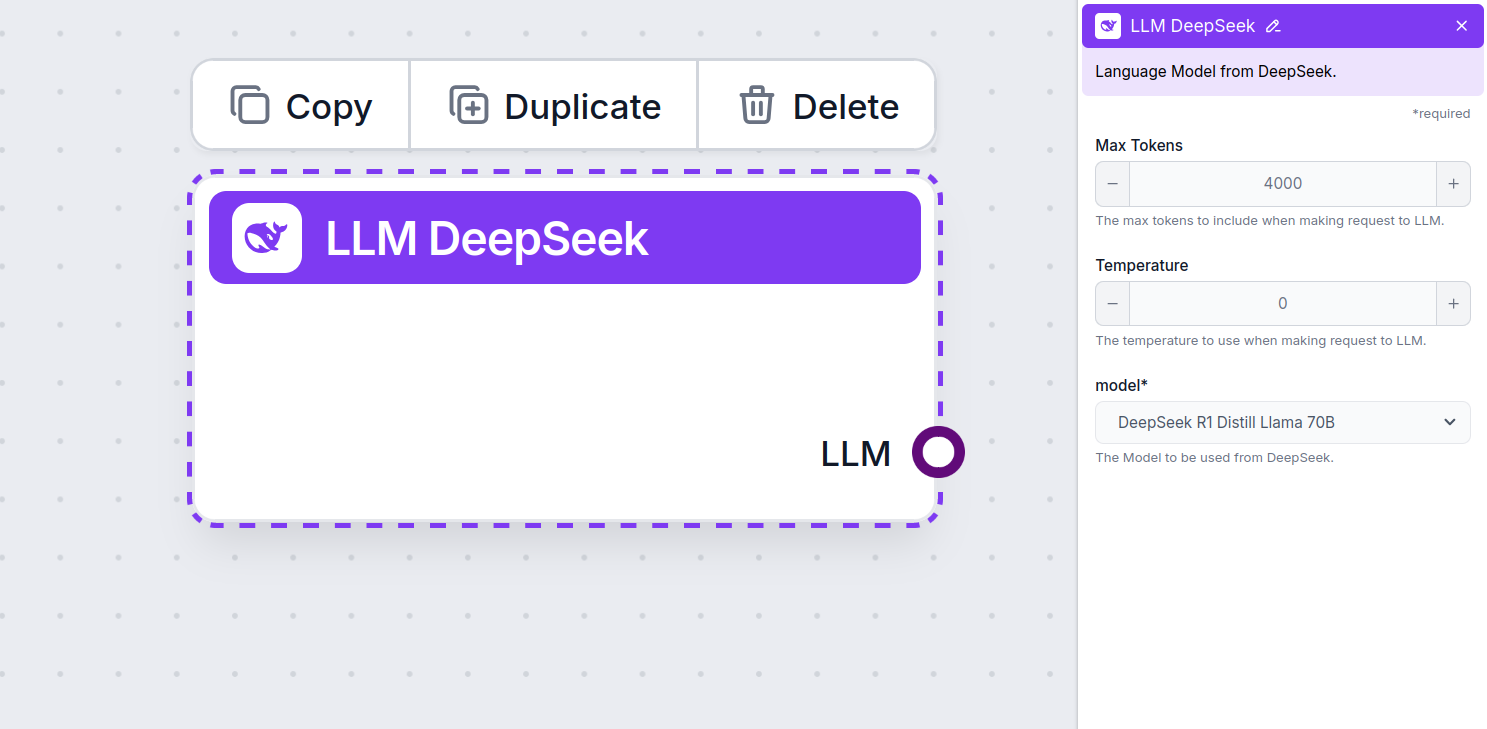

Innstillinger for LLM Gemini-komponenten

Maks tokens

Tokens representerer de individuelle enhetene av tekst modellen prosesserer og genererer. Tokenforbruket varierer mellom modeller, og en enkelt token kan være alt fra ord eller delord til ett enkelt tegn. Modeller prises vanligvis i millioner av tokens.

Innstillingen for maks tokens begrenser det totale antallet tokens som kan behandles i én enkelt interaksjon eller forespørsel, slik at svarene genereres innenfor rimelige rammer. Standardgrensen er 4 000 tokens, som er en optimal størrelse for å oppsummere dokumenter og flere kilder for å generere et svar.

Temperatur

Temperatur styrer variasjonen i svarene, og varierer fra 0 til 1.

En temperatur på 0,1 gjør svarene svært presise, men kan føre til gjentakelser og mangelfulle svar.

En høy temperatur på 1 tillater maksimal kreativitet i svarene, men øker risikoen for irrelevante eller til og med hallusinerte svar.

For eksempel er anbefalt temperatur for en kundeservicebot mellom 0,2 og 0,5. Dette nivået holder svarene relevante og til manus, samtidig som det gir rom for naturlig variasjon.

Modell

Dette er modellvelgeren. Her finner du alle støttede DeepSeek-modeller. Vi støtter alle de nyeste Gemini-modellene:

- DeepSeek R1: Den kinesiske lettvekts, åpne kildekode-modellen som tok verden med storm tidlig i 2025. Det er for øyeblikket den raskeste og beste DeepSeek-modellen, som enkelt overgår OpenAI’s o1-modell.

Hvordan legge til LLM DeepSeek i din Flow

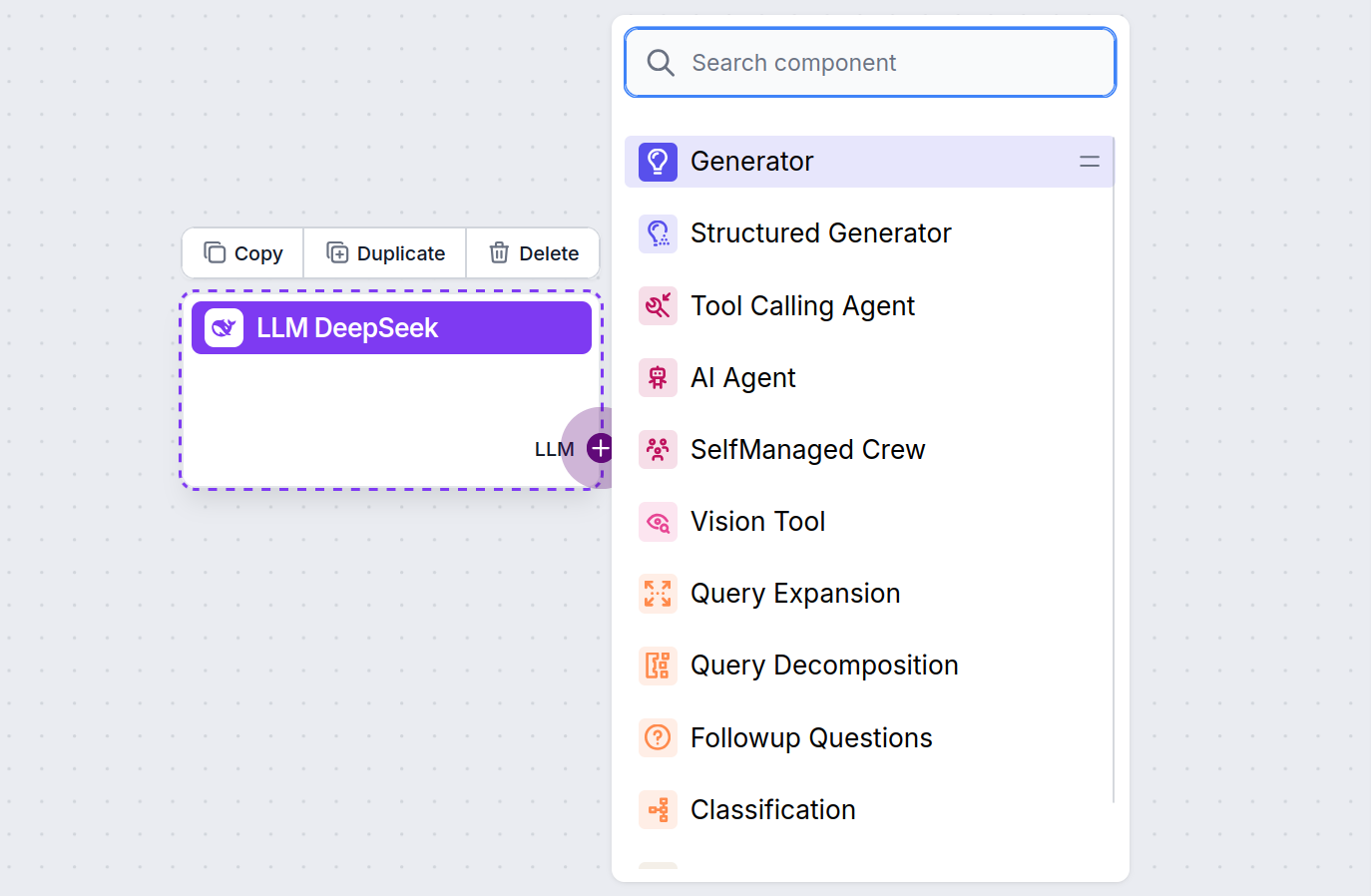

Du vil merke at alle LLM-komponenter kun har en utgangskontakt. Inndata går ikke gjennom komponenten, da den bare representerer modellen, mens selve genereringen skjer i AI-agenter og generatorer.

LLM-kontakten er alltid lilla. LLM-inngangskontakten finnes på enhver komponent som bruker AI for å generere tekst eller behandle data. Du kan se alternativene ved å klikke på kontakten:

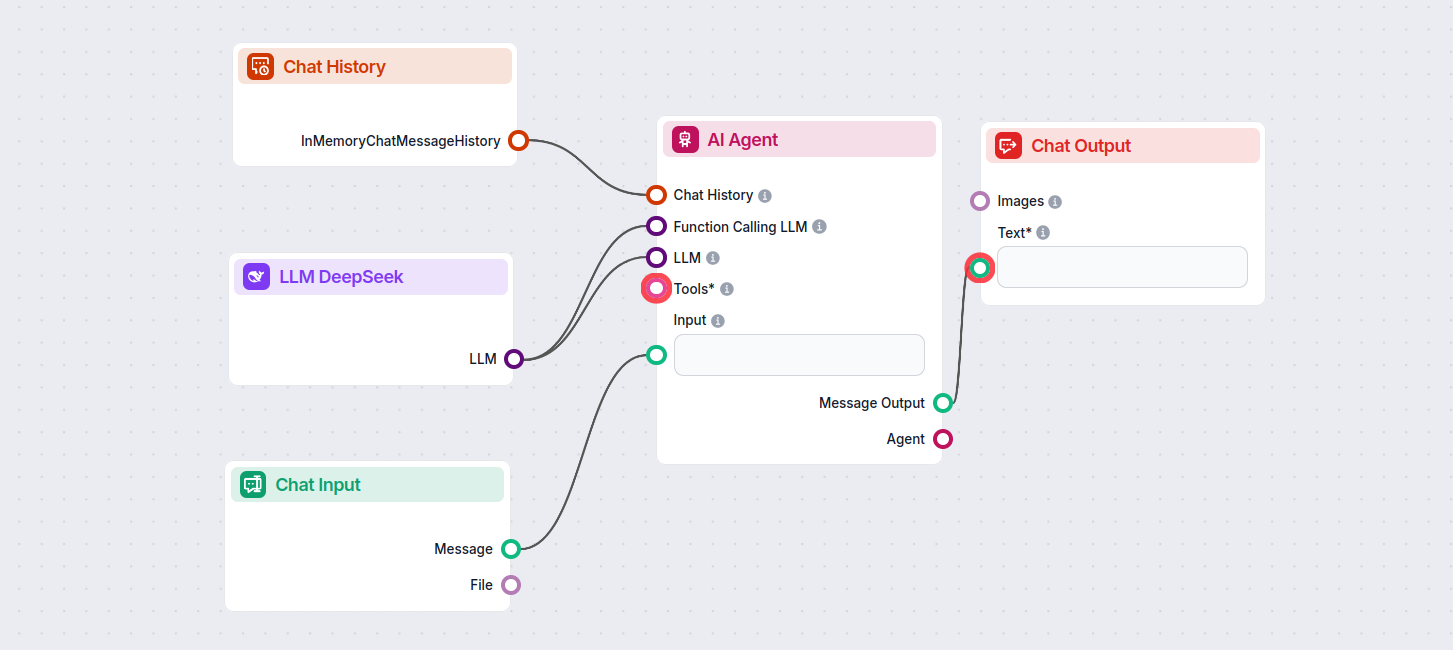

Dette lar deg lage alle slags verktøy. La oss se komponenten i aksjon. Her er en enkel AI Agent chatbot Flow som bruker DeepSeek R1 til å generere svar. Du kan tenke på det som en grunnleggende DeepSeek-chatbot.

Denne enkle Chatbot Flow inneholder:

- Chat-inndata: Representerer meldingen en bruker sender i chatten.

- Chat-historikk: Sørger for at chatboten kan huske og ta hensyn til tidligere svar.

- Chat-utdata: Representerer chatbotens endelige svar.

- AI-agent: En autonom AI-agent som genererer svar.

- LLM DeepSeek: Tilkoblingen til DeepSeek generasjonsmodeller.