AI Bloggidegenerator for Konkurrent- og Trendanalyse

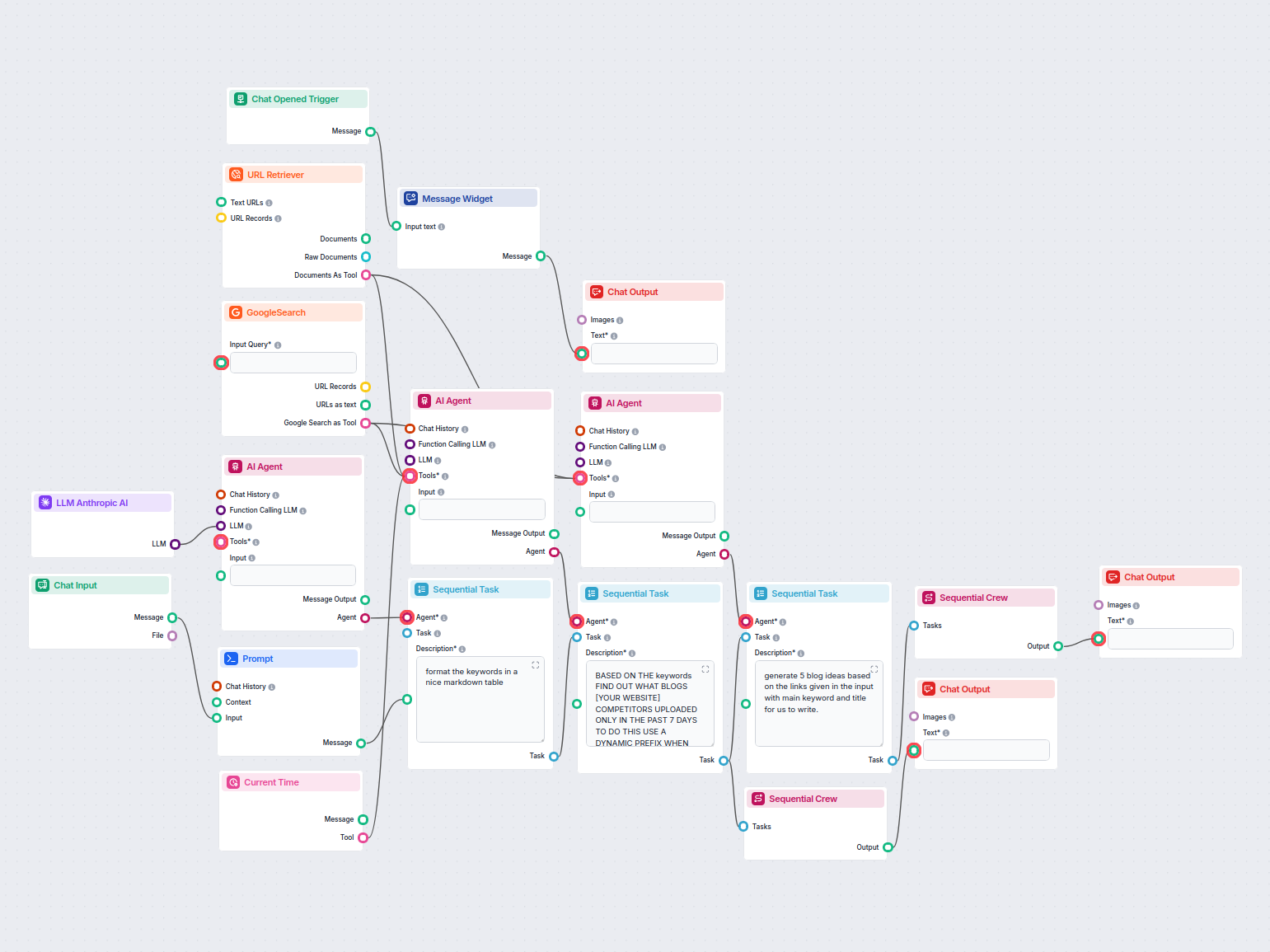

Denne AI-drevne arbeidsflyten undersøker konkurrenter og trendende temaer for å generere effektfulle, SEO-optimaliserte bloggideer for FlowHunt.io. Ved å bruke ...

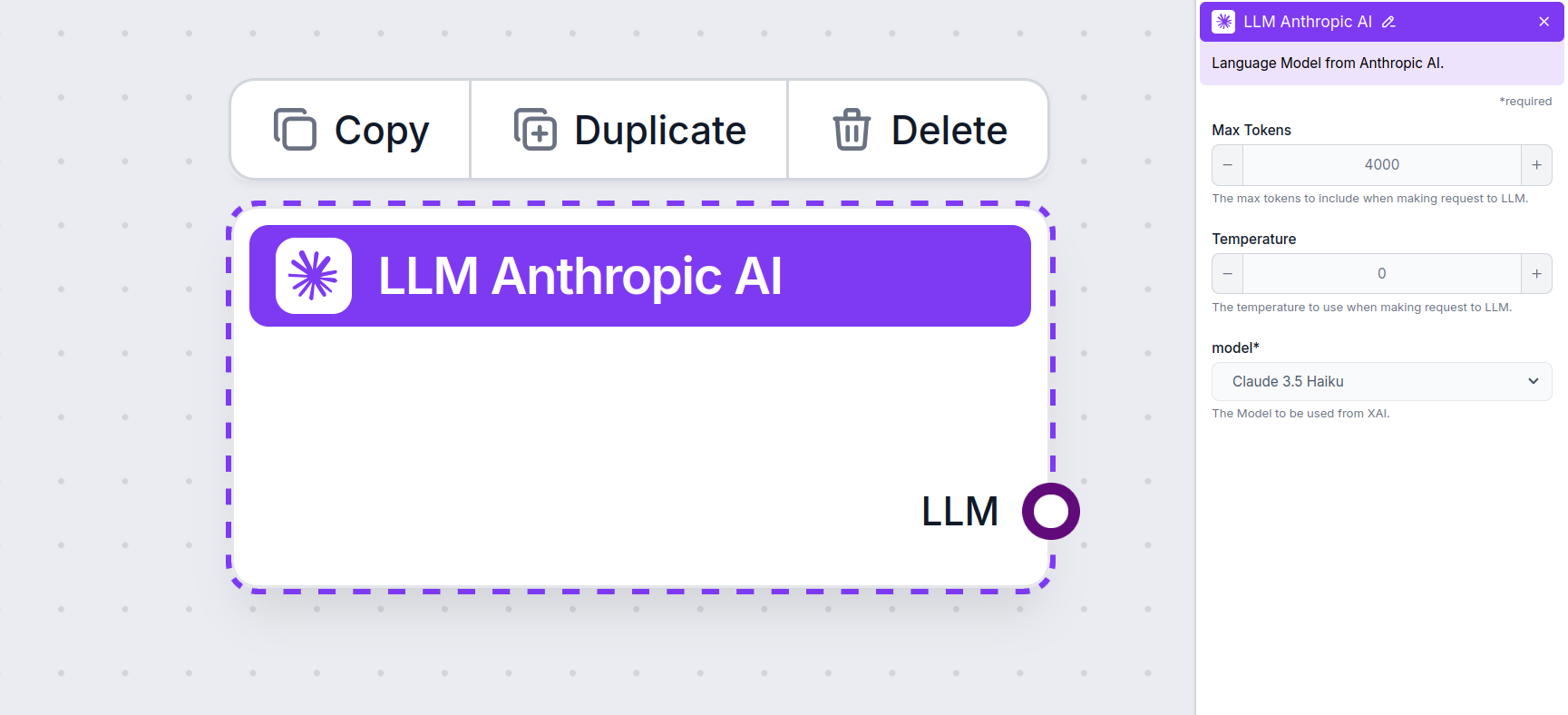

Koble Anthropic sine Claude-modeller til ditt FlowHunt-dashboard for fleksibel AI-tekstgenerering og chatbot-løsninger, med kontroll over tokens, temperatur og modellvalg.

Komponentbeskrivelse

Ulike oppgaver krever ulike modeller, og FlowHunt er forpliktet til å gi deg det beste av AI uten behov for å tegne utallige abonnement. I stedet får du dusinvis av tekst- og bildegenereringsmodeller i ett enkelt dashbord. LLM-typen av komponenter huser tekstgenerering og deres ulike bruksområder innen AI, innholdsproduksjon og automatisering—modeller er gruppert etter leverandør, slik at du kan bytte AI-modell når som helst.

LLM Anthropic AI-komponenten kobler Claude-familien av modeller til din flow. Selv om Generatorer og Agenter er der selve magien skjer, lar LLM-komponentene deg kontrollere hvilken modell som brukes. Alle komponenter leveres med ChatGPT-4 som standard. Du kan koble til denne komponenten hvis du ønsker å endre modell eller få mer kontroll over den.

Husk at tilkobling av en LLM-komponent er valgfritt. Alle komponenter som bruker en LLM, leveres med ChatGPT-4o som standard. LLM-komponentene lar deg endre modell og styre modellinnstillinger.

Tokens representerer de individuelle enhetene av tekst modellen behandler og genererer. Token-bruk varierer mellom modeller, og én enkelt token kan være alt fra ord eller delord til et enkelt tegn. Modellene prises vanligvis i millioner av tokens.

Maks tokens-innstillingen begrenser det totale antallet tokens som kan behandles i én enkelt interaksjon eller forespørsel, og sørger for at svarene genereres innenfor rimelige rammer. Standardgrensen er 4 000 tokens, som er optimal størrelse for å oppsummere dokumenter og flere kilder for å generere et svar.

Temperatur styrer variasjonen i svarene, og varierer fra 0 til 1.

For eksempel er anbefalt temperatur for en kundeservicebot mellom 0,2 og 0,5. Dette nivået holder svarene relevante og til poenget, samtidig som det gir en naturlig variasjon i svarene.

Dette er modellvelgeren. Her finner du alle de støttede modellene fra Anthropic. Vi støtter for øyeblikket alle de nyeste modellene fra Claude-familien:

Du vil legge merke til at alle LLM-komponentene kun har et output-håndtak. Input går ikke gjennom komponenten, ettersom den kun representerer modellen, mens selve genereringen skjer i AI-agenter og generatorer.

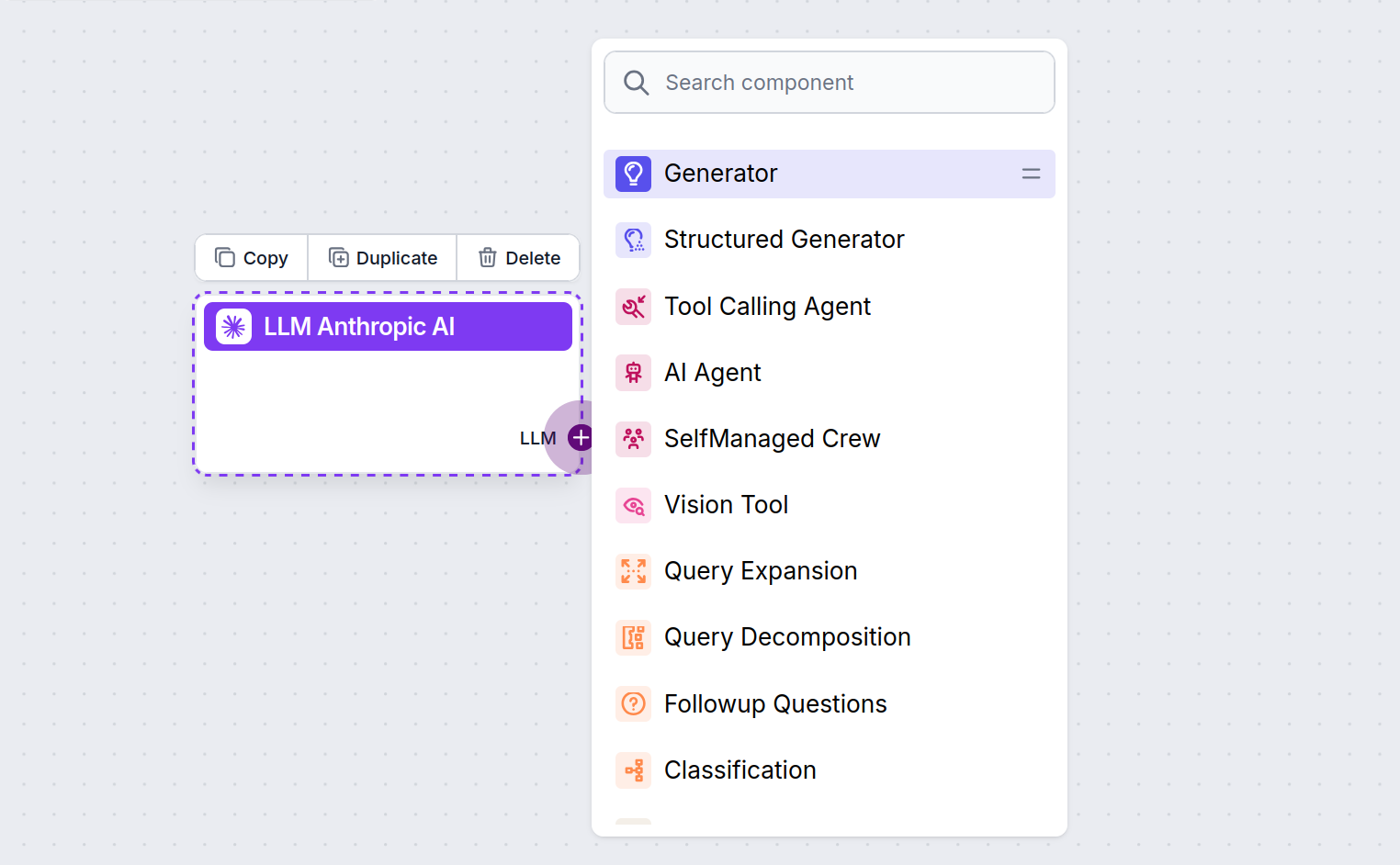

LLM-håndtaket er alltid lilla. LLM input-håndtaket finnes på alle komponenter som bruker AI til å generere tekst eller behandle data. Du kan se alternativene ved å klikke på håndtaket:

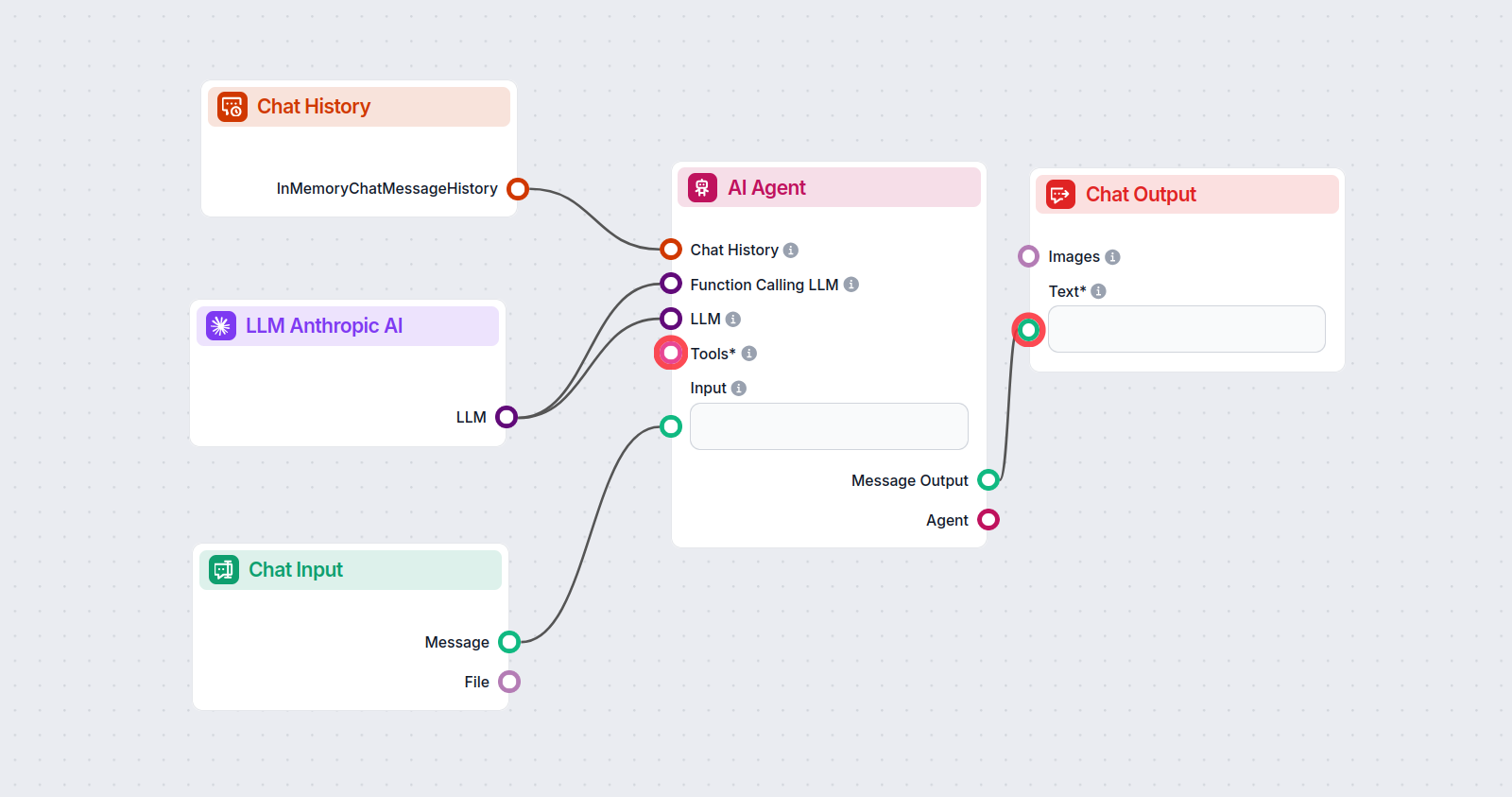

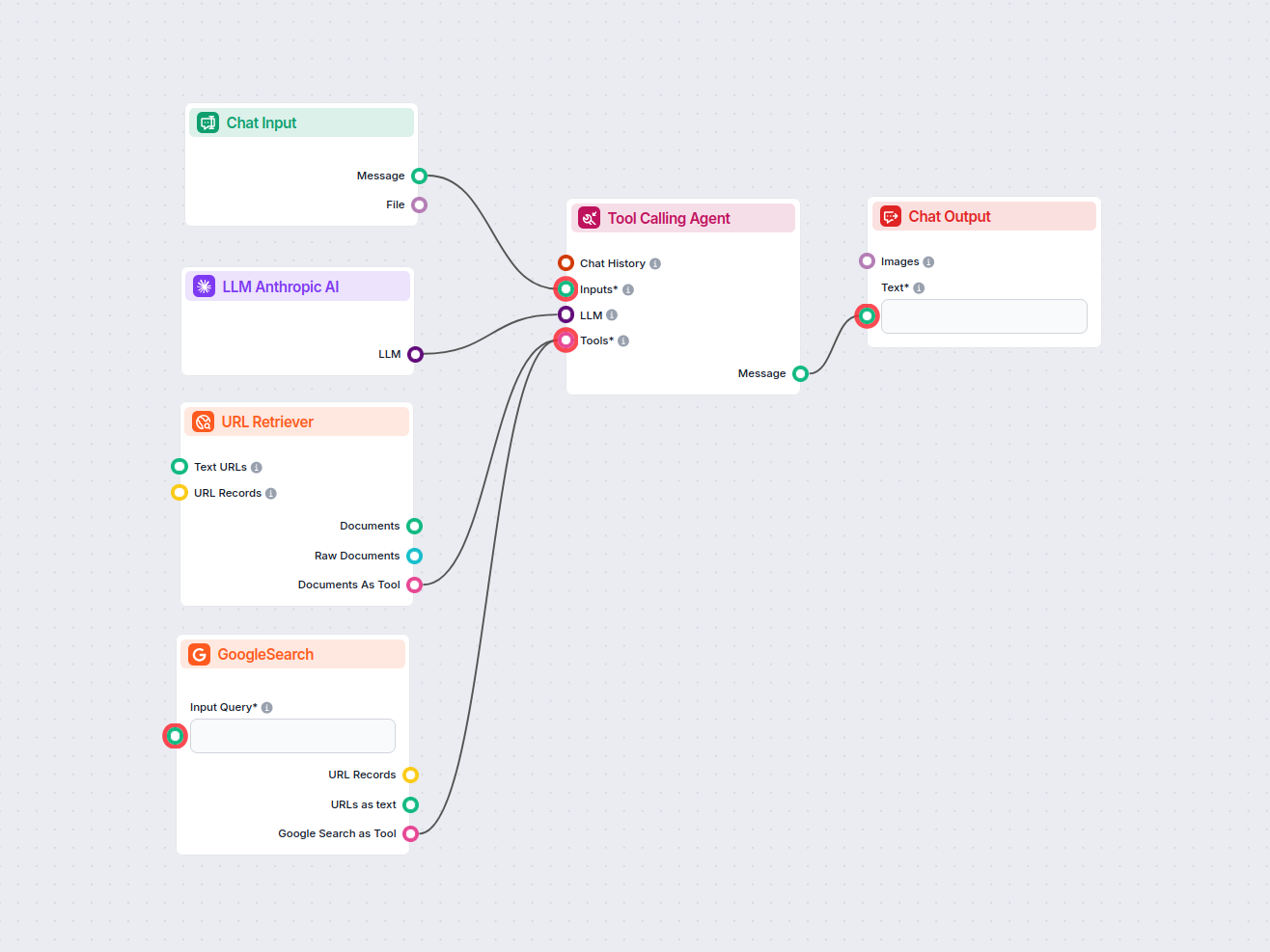

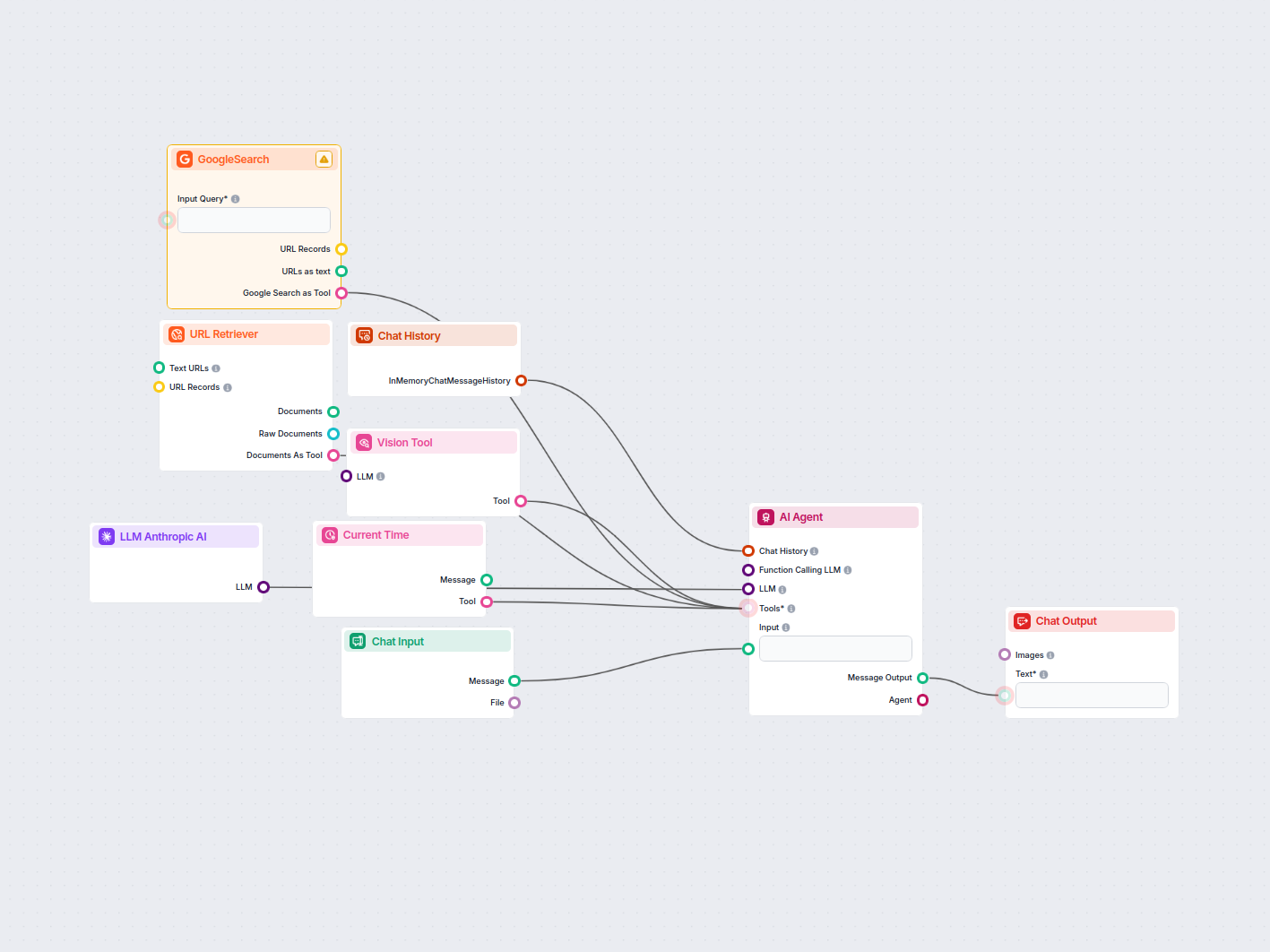

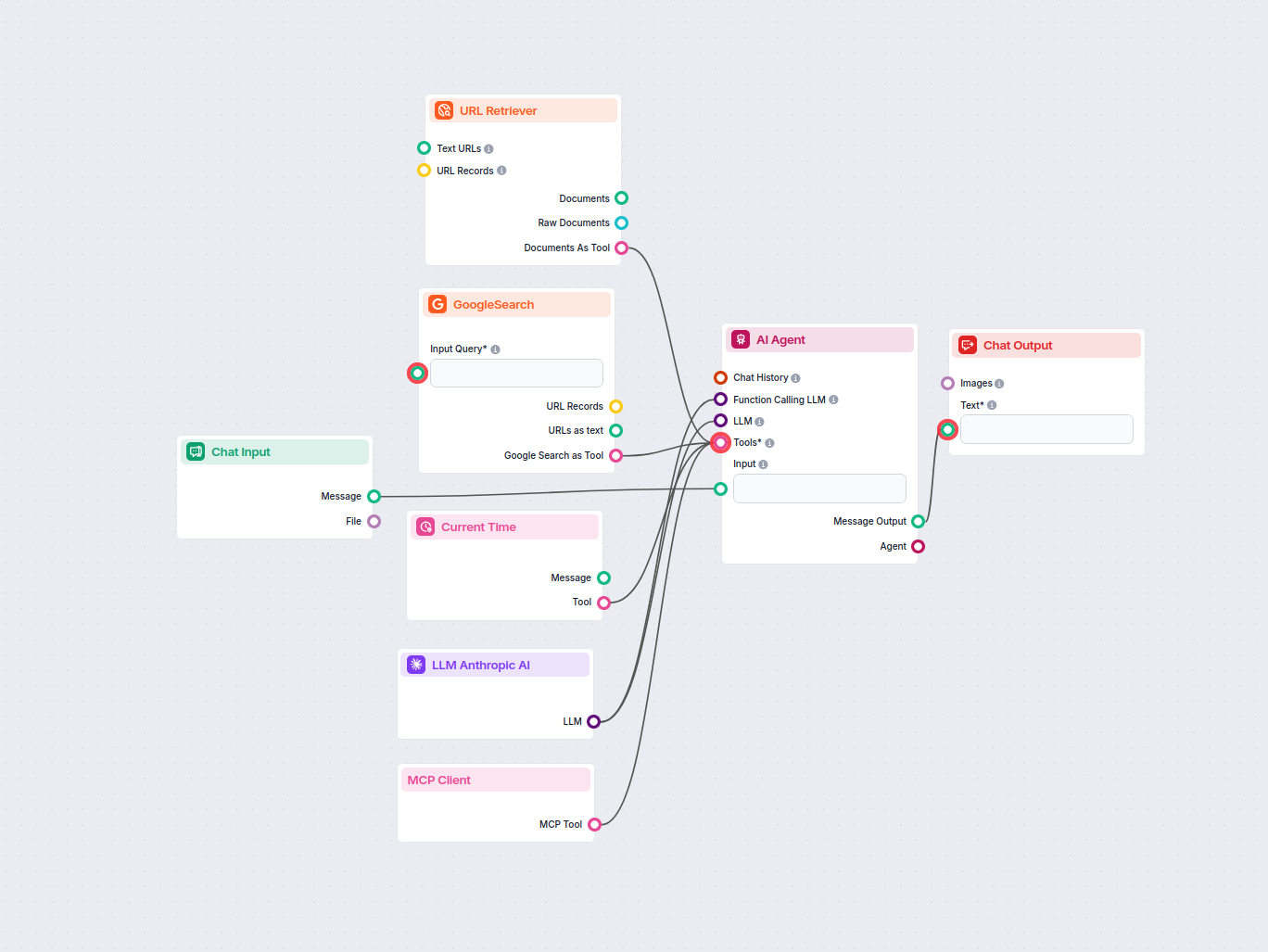

Dette lar deg lage alle slags verktøy. La oss se komponenten i aksjon. Her er en enkel AI Agent chatbot-flow som bruker Anthropic’s Claude 3.5 Sonnet til å generere svar. Du kan tenke på det som en grunnleggende Anthropic-chatbot.

Denne enkle Chatbot Flow inkluderer:

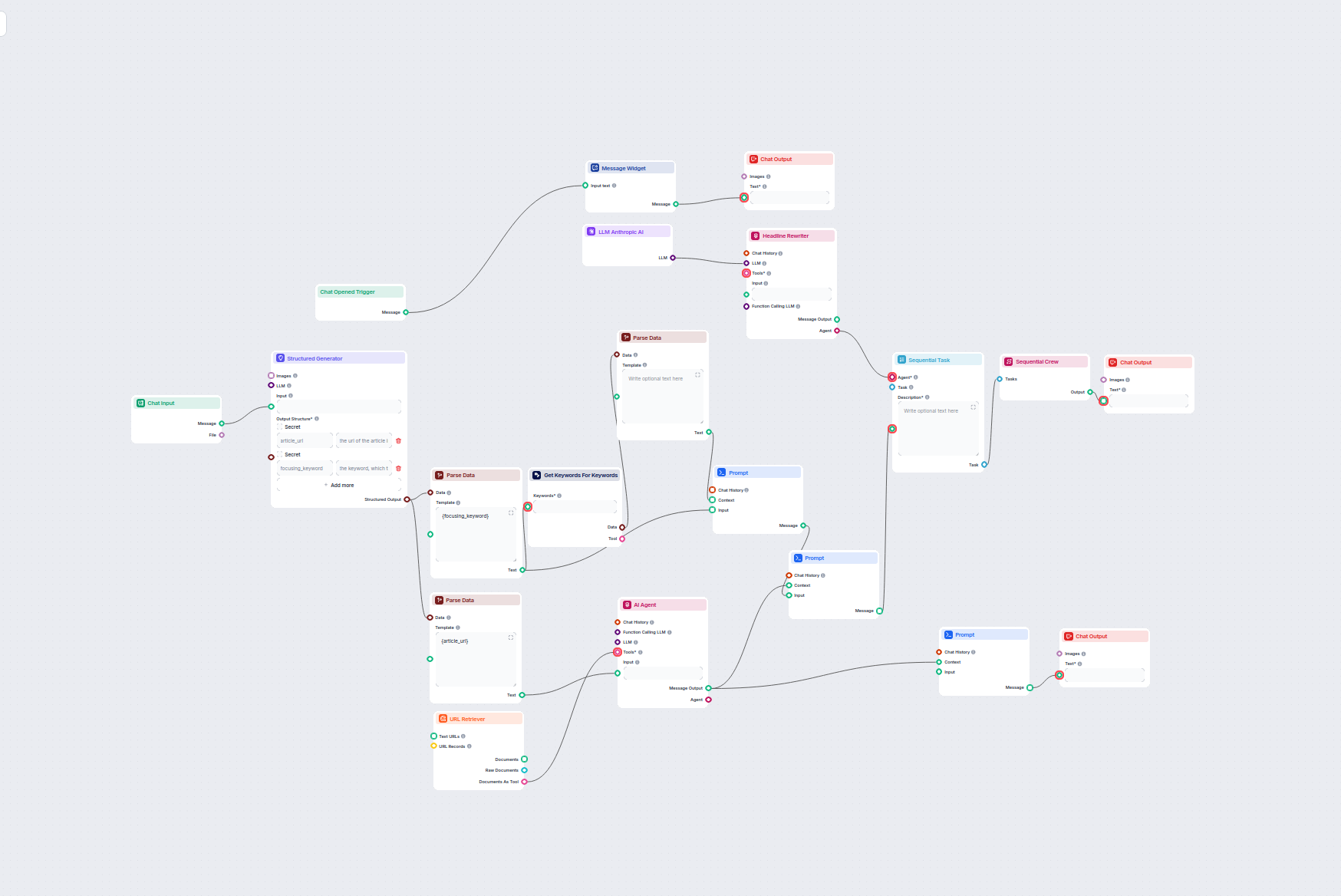

For å hjelpe deg med å komme raskt i gang, har vi forberedt flere eksempel-flow-maler som demonstrerer hvordan du bruker LLM Anthropic AI-komponenten effektivt. Disse malene viser forskjellige brukstilfeller og beste praksis, noe som gjør det lettere for deg å forstå og implementere komponenten i dine egne prosjekter.

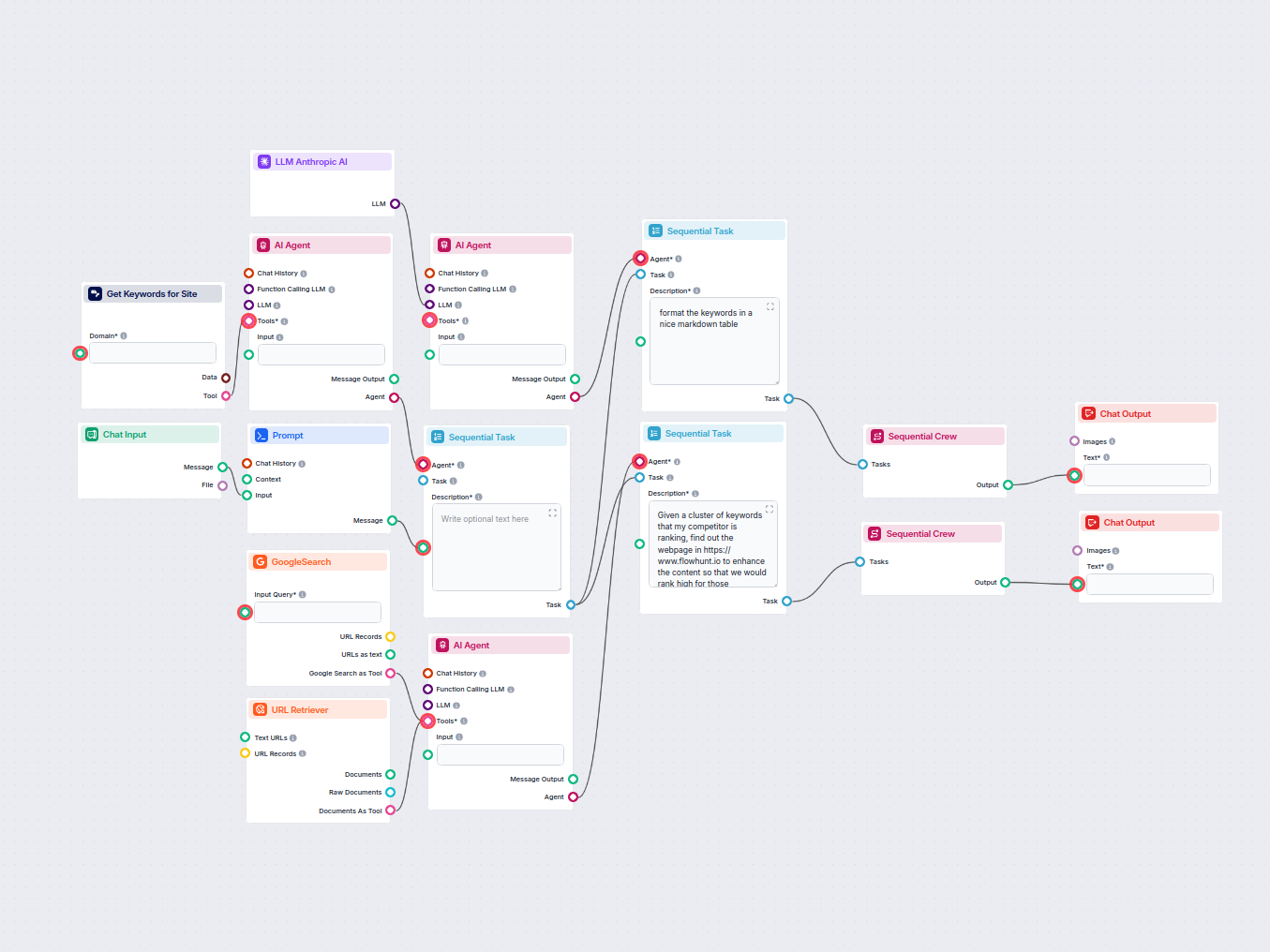

Denne AI-drevne arbeidsflyten undersøker konkurrenter og trendende temaer for å generere effektfulle, SEO-optimaliserte bloggideer for FlowHunt.io. Ved å bruke ...

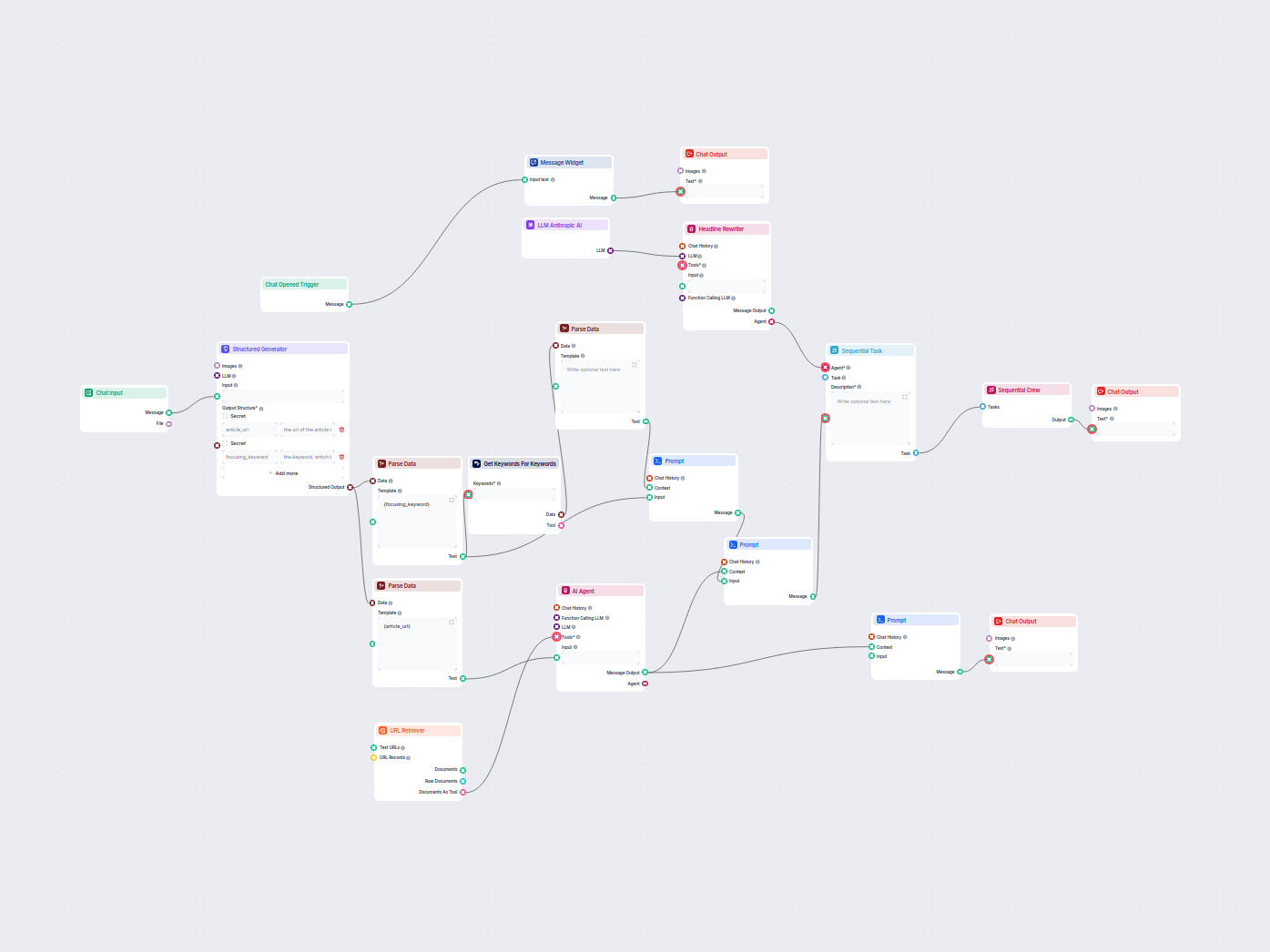

Denne AI-drevne arbeidsflyten finner de beste SEO-nøkkelordene for blogginnlegget ditt og omskriver overskriftene automatisk for å rette seg mot disse nøkkelord...

Generer automatisk SEO-optimaliserte beskrivelser for kategorisider i nettbutikker ved hjelp av AI. Oppgi bare en kategori-URL, så undersøker arbeidsflyten kate...

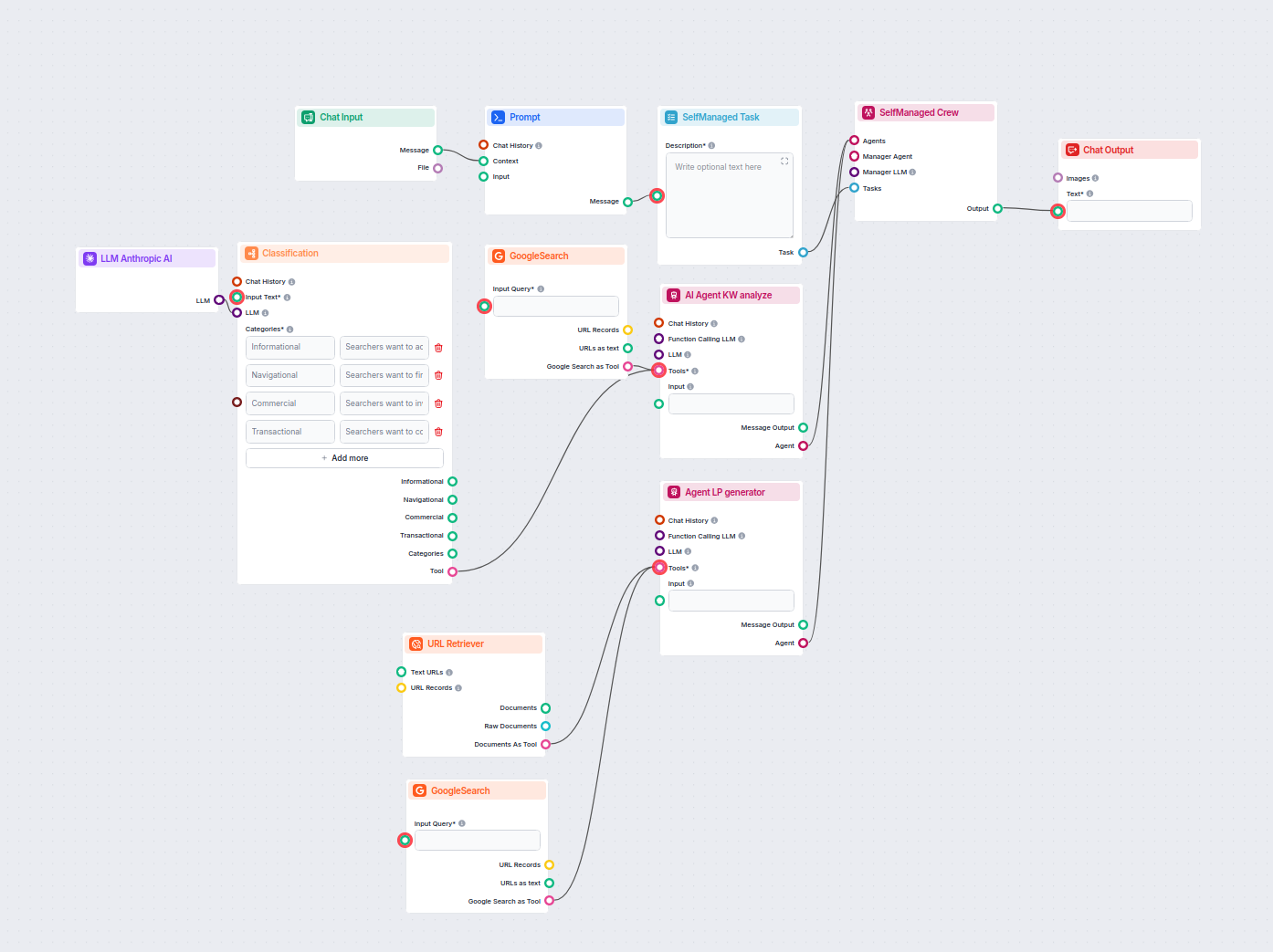

Analyser automatisk din konkurrents hjemmeside-URL for å oppdage deres topp rangerte nøkkelord, samle nøkkelorddata fra Google, og motta handlingsrettede anbefa...

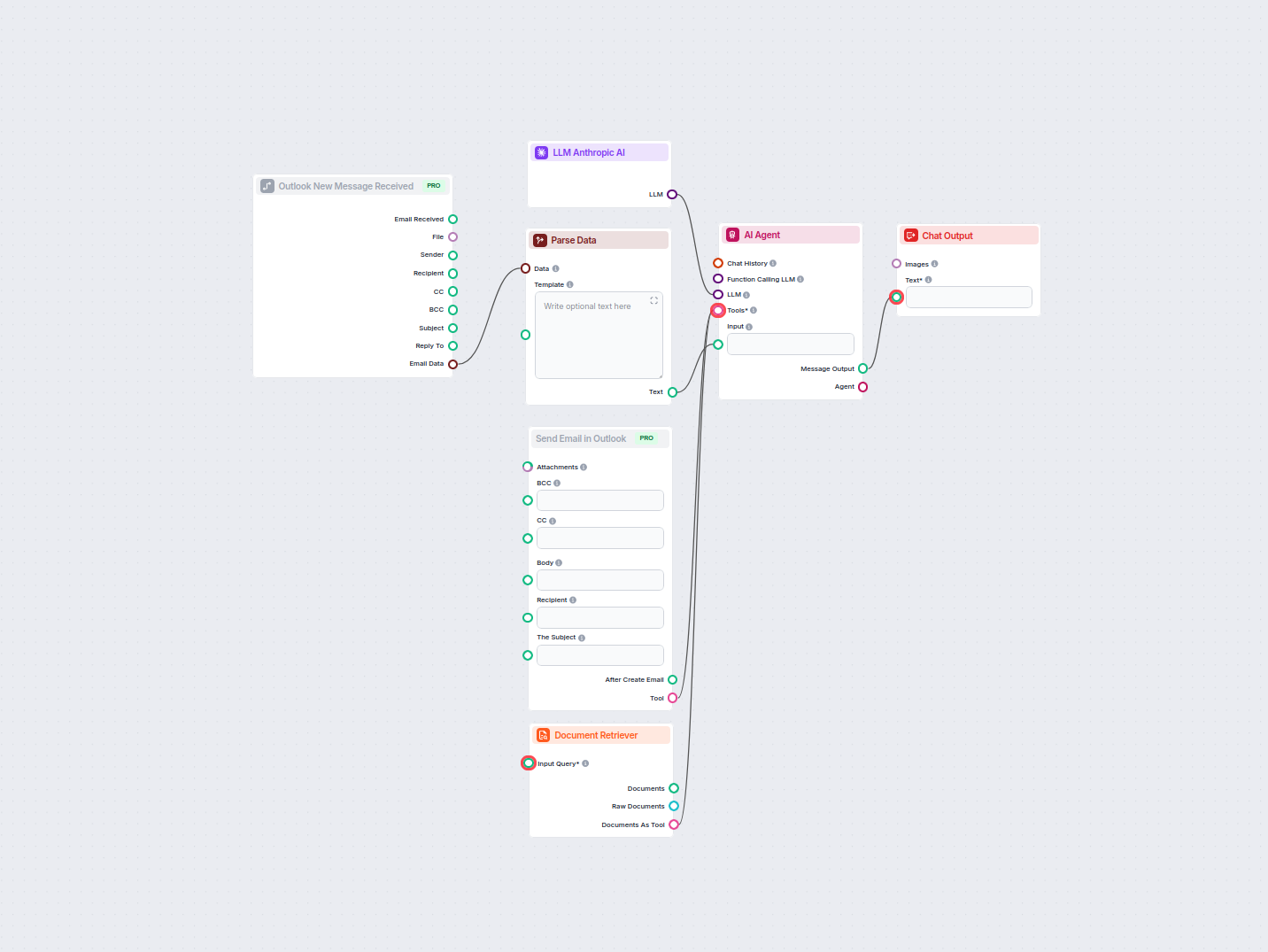

Automatiser profesjonelle e-postsvar i Outlook ved hjelp av en AI-agent som utnytter organisasjonens kunnskapskilder. Innkommende e-poster mottas, tolkes og bes...

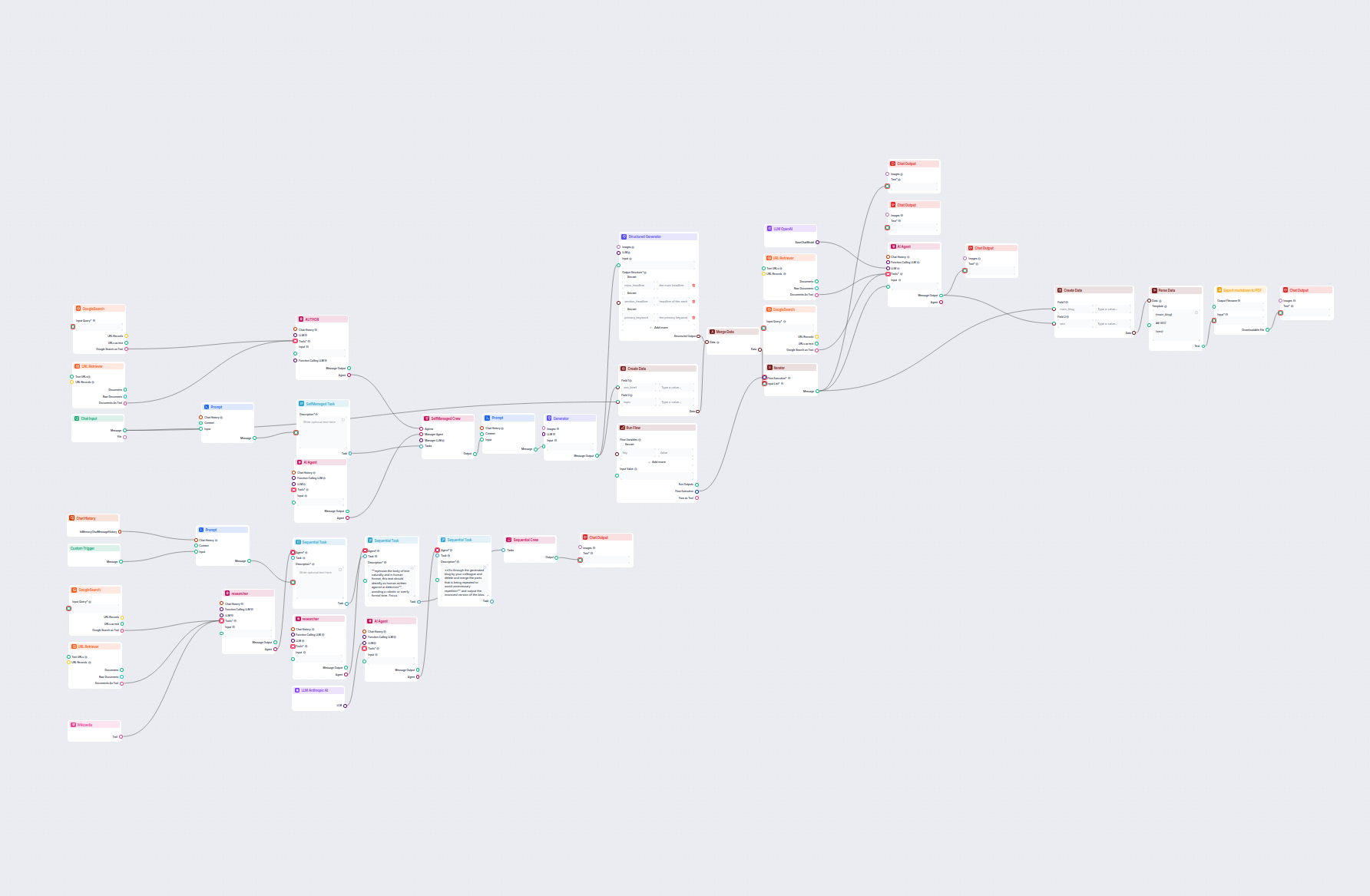

Generer omfattende, SEO-optimaliserte blogginnlegg med avansert struktur og høy ordtelling ved hjelp av flere AI-agenter. Arbeidsflyten inkluderer automatisk re...

Analyser automatisk topprangerte konkurrentblogger fra forrige uke og generer nye bloggidéer for ditt nettsted. Denne AI-arbeidsflyten undersøker konkurrentinnh...

Denne arbeidsflyten automatiserer LinkedIn annonsemarkedsundersøkelser ved å identifisere toppkonkurrenter for et nøkkelord, analysere annonsetekst og bilder, o...

Optimaliser automatisk artikkelens overskrifter og tittel for et bestemt søkeord eller søkeordsklynge for å forbedre SEO-ytelsen. Denne arbeidsflyten analyserer...

Denne AI-drevne arbeidsflyten forbedrer Shopify-produktbeskrivelser basert på produktnavn eller URL gitt av brukeren. Den benytter LLM-er, henter produktinnhold...

Dette AI-drevne arbeidsflyten klassifiserer søkefraser etter intensjon, undersøker topprangerte URL-er og genererer en svært optimalisert landingsside for PPC- ...

LLM Anthropic AI-komponenten kobler Anthropic sine Claude-modeller til dine FlowHunt-flows, slik at du kan tilpasse hvilken modell som brukes til tekstgenerering og kontrollere innstillinger som maks tokens og temperatur.

FlowHunt støtter alle de nyeste modellene fra Claude-familien, inkludert Claude 3.5 Sonnet, Claude 3 Sonnet, Claude 3 Haiku og Claude 2.

Maks tokens setter lengdegrensen for hvert svar, mens temperatur styrer tilfeldigheten—lavere verdier gir fokuserte svar, høyere verdier øker kreativiteten.

Nei, å koble til LLM Anthropic AI-komponenten er valgfritt. Som standard bruker komponentene ChatGPT-4o, men du kan legge til denne komponenten for å bytte til Claude-modeller og finjustere innstillinger.

Begynn å bygge tilpassede AI-verktøy og chatboter ved å bruke Anthropic sine Claude-modeller med enkel flytintegrasjon og kraftig konfigurering.

FlowHunt støtter dusinvis av tekstgenereringsmodeller, inkludert modeller fra OpenAI. Her er hvordan du bruker ChatGPT i dine AI-verktøy og chatboter.

FlowHunt støtter dusinvis av tekstgenereringsmodeller, inkludert Metas Llama-modeller. Lær hvordan du integrerer Llama i dine AI-verktøy og chatboter, tilpasser...

FlowHunt støtter dusinvis av tekstgenereringsmodeller, inkludert modeller fra xAI. Her er hvordan du bruker xAI-modellene i AI-verktøyene og chatbotene dine.