Python-biblioteker for utvikling av Model Context Protocol (MCP) Server

Raskt eksempel på hvordan du kan utvikle din egen MCP-server med Python.

MCP standardiserer sikker LLM-tilgang til eksterne data, verktøy og plugins, og muliggjør fleksibel, kraftig AI-integrasjon og interoperabilitet.

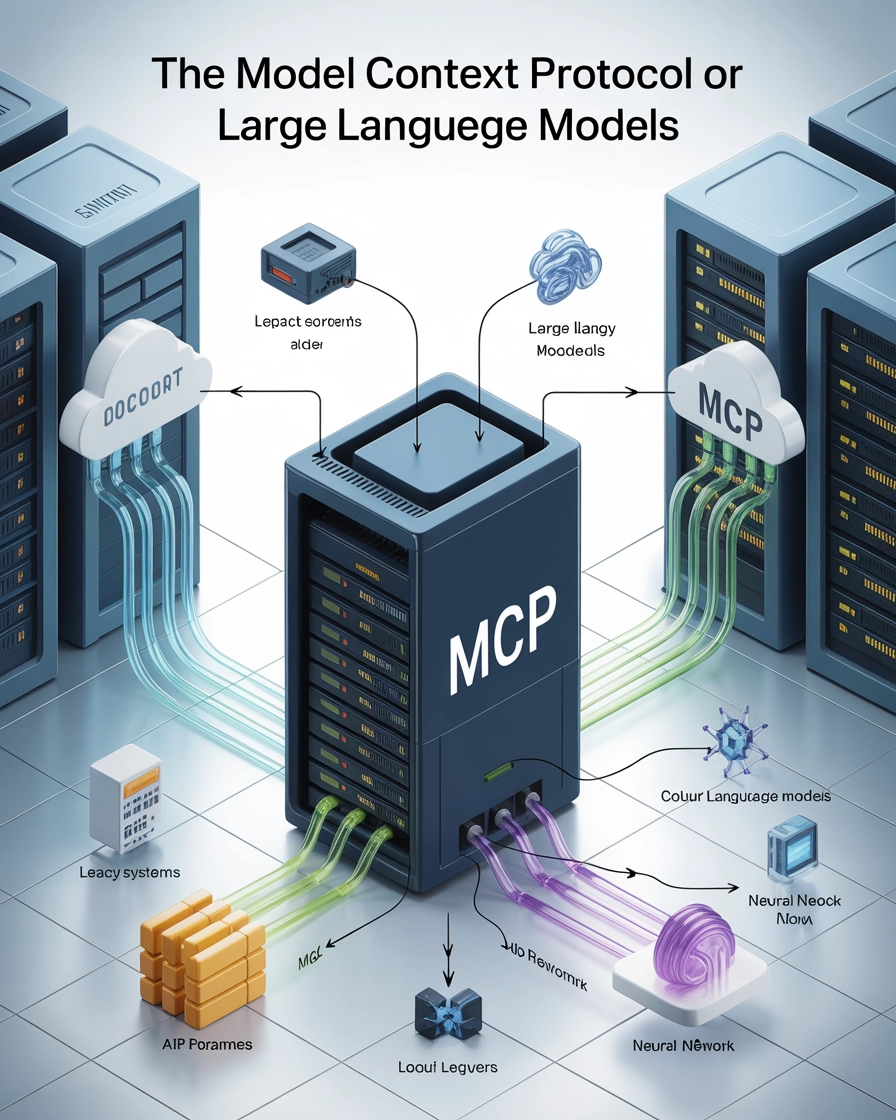

Modellkontekstprotokollen (MCP) er et åpent standardgrensesnitt som gjør det mulig for store språkmodeller (LLM-er) å få sikker og konsistent tilgang til eksterne datakilder, verktøy og funksjoner. Den etablerer et standardisert kommunikasjonslag mellom AI-applikasjoner og ulike kontekstsleverandører, og fungerer som «USB-C» for AI-systemer.

MCP følger en klient-server-arkitektur:

MCP definerer tre grunnleggende primitiver som utgjør byggesteinene i protokollen:

Ressurser representerer data og innhold som MCP-servere gjør tilgjengelig for LLM-er.

Eksempel på bruk: En MCP-server som eksponerer en loggfil som ressurs med URI file:///logs/app.log

Prompt er forhåndsdefinerte maler eller arbeidsflyter som servere tilbyr for å veilede LLM-interaksjoner.

Eksempel på bruk: En git commit-melding-generator som aksepterer kodeendringer som input

Verktøy eksponerer kjørbare funksjoner som LLM-er kan påkalle (vanligvis med brukerens godkjenning) for å utføre handlinger.

Eksempel på bruk: Et kalkulatorverktøy som utfører matematiske operasjoner på input fra modellen

// Server som eksponerer en enkelt loggfil som ressurs

const server = new Server({ /* config */ }, { capabilities: { resources: {} } });

// List opp tilgjengelige ressurser

server.setRequestHandler(ListResourcesRequestSchema, async () => {

return {

resources: [

{

uri: "file:///logs/app.log",

name: "Applikasjonslogger",

mimeType: "text/plain"

}

]

};

});

// Gi ressursinnhold

server.setRequestHandler(ReadResourceRequestSchema, async (request) => {

if (request.params.uri === "file:///logs/app.log") {

const logContents = await readLogFile();

return {

contents: [{

uri: request.params.uri,

mimeType: "text/plain",

text: logContents

}]

};

}

throw new Error("Ressurs ikke funnet");

});

const server = new Server({ /* config */ }, { capabilities: { tools: {} } });

// List opp tilgjengelige verktøy

server.setRequestHandler(ListToolsRequestSchema, async () => {

return {

tools: [{

name: "calculate_sum",

description: "Legg sammen to tall",

inputSchema: {

type: "object",

properties: {

a: { type: "number", description: "Første tall" },

b: { type: "number", description: "Andre tall" }

},

required: ["a", "b"]

},

annotations: {

title: "Beregn Sum",

readOnlyHint: true,

openWorldHint: false

}

}]

};

});

// Håndter verktøykjøring

server.setRequestHandler(CallToolRequestSchema, async (request) => {

if (request.params.name === "calculate_sum") {

try {

const { a, b } = request.params.arguments;

if (typeof a !== 'number' || typeof b !== 'number') {

throw new Error("Ugyldig input: 'a' og 'b' må være tall.");

}

const sum = a + b;

return {

content: [{ type: "text", text: String(sum) }]

};

} catch (error: any) {

return {

isError: true,

content: [{ type: "text", text: `Feil ved beregning av sum: ${error.message}` }]

};

}

}

throw new Error("Verktøy ikke funnet");

});

MCP er et åpent standardgrensesnitt som lar LLM-er få sikker og konsistent tilgang til eksterne datakilder, verktøy og funksjoner, og skaper et standardisert kommunikasjonslag mellom AI-applikasjoner og kontekstsleverandører.

MCP består av verter, klienter, servere og datakilder. Den bruker kjerneprimitiver—ressurser, prompt og verktøy—for å muliggjøre fleksible og sikre interaksjoner mellom LLM-er og eksterne systemer.

MCP forenkler AI-integrasjon, forbedrer sikkerheten, reduserer leverandørbinding og gir sømløs tilgang til variert informasjon og verktøy for både utviklere og organisasjoner.

MCP kan implementeres gjennom servere som eksponerer ressurser eller verktøy (f.eks. loggfiltilgang, kalkulatorverktøy) ved hjelp av et standardisert grensesnitt, noe som forenkler tilkoblingen med AI-modeller.

MCP standardiserer prosessen med at LLM-er kaller eksterne funksjoner eller verktøy, på samme måte som plugins utvider funksjonaliteten til nettlesere eller programvare.

Begynn å bygge kraftige AI-systemer med standardiserte integrasjoner, sikker datatilgang og fleksibel verktøytilkobling ved å bruke FlowHunt.

Raskt eksempel på hvordan du kan utvikle din egen MCP-server med Python.

Agentisk AI redefinerer arbeidsflytautomatisering med Model Context Protocol (MCP), som muliggjør skalerbar, dynamisk integrasjon av AI-agenter med ulike ressur...

Oppdag hvordan Model Context Protocol (MCP) muliggjør sikre filsystemoperasjoner for AI-assistenter og utviklingsverktøy. Denne omfattende guiden forklarer MCPs...