Random Forest-regresjon

Random Forest-regresjon er en kraftig maskinlæringsalgoritme som brukes til prediktiv analyse. Den konstruerer flere beslutningstrær og gjennomsnittliggjør dere...

Monte Carlo-metoder bruker tilfeldig utvalg for å løse komplekse problemer innen blant annet finans, ingeniørfag og AI, og muliggjør usikkerhetsmodellering og risikoanalyse.

Monte Carlo-metoder bruker tilfeldig utvalg for å løse komplekse problemer, og er til hjelp i fag som finans, ingeniørfag og kunstig intelligens (AI). De modellerer usikkerhet, optimaliserer beslutninger og vurderer risiko, men krever betydelig beregningskraft og kvalitet på tilfeldige tall.

Monte Carlo-metoder, også kalt Monte Carlo-eksperimenter, er en klasse av beregningsalgoritmer som baserer seg på gjentatt tilfeldig utvalg for å finne numeriske løsninger på komplekse problemer. Det grunnleggende prinsippet bak Monte Carlo-metoder er å utnytte tilfeldighet for å løse problemer som ellers kunne vært deterministiske. Metoden har fått navn etter Monte Carlo Casino i Monaco, ettersom tilfeldighet står sentralt i disse teknikkene. Konseptet ble utviklet av matematikeren Stanislaw Ulam, som lot seg inspirere av gamblingens stokastiske natur. Monte Carlo-metoder er avgjørende i fag som krever optimalisering, numerisk integrasjon og utvalg fra sannsynlighetsfordelinger.

Monte Carlo-metoder er mye brukt innen ulike områder som fysikk, finans, ingeniørfag og kunstig intelligens (AI), særlig der de hjelper med beslutningsprosesser under usikkerhet. Fleksibiliteten til Monte Carlo-simuleringer til å modellere fenomen med usikre variabler gjør dem uvurderlige for risikovurdering og sannsynlighetsprognoser.

Opprinnelsen til Monte Carlo-metoder går tilbake til 1940-tallet, under utviklingen av atomvåpen i Manhattan-prosjektet. Ulam og John von Neumann brukte disse metodene for å løse komplekse integraler relatert til nøytrondiffusjon. Tilnærmingen fikk raskt fotfeste på tvers av vitenskapsdisipliner på grunn av sin allsidighet og effektivitet ved problemer som involverer tilfeldighet og usikkerhet.

Kjernen i Monte Carlo-metoder er prosessen med tilfeldig utvalg. Dette innebærer å generere tilfeldige tall for å simulere ulike scenarier og vurdere potensielle utfall. Påliteligheten til Monte Carlo-resultater avhenger i stor grad av kvaliteten på disse tilfeldige tallene, som vanligvis produseres med pseudo-tilfeldige tallgeneratorer. Disse gir en balanse mellom hastighet og effektivitet sammenlignet med tradisjonelle tabeller over tilfeldige tall. Robustheten til resultatene kan forbedres betydelig ved å benytte teknikker som variansreduksjon og quasi-tilfeldige sekvenser.

Monte Carlo-simuleringer bruker sannsynlighetsfordelinger for å modellere variabelatferd. Vanlige fordelinger inkluderer normalfordelingen, preget av sin klokkeformede, symmetriske kurve, og uniformfordelingen, der alle utfall er like sannsynlige. Valg av riktig fordeling er avgjørende, da det påvirker simuleringens nøyaktighet og relevans for virkelige situasjoner. Avanserte anvendelser kan bruke fordelinger som Poisson- eller eksponentialfordelingen for å modellere spesifikke typer tilfeldige prosesser.

I Monte Carlo-simuleringer er inndata-variabler, ofte behandlet som tilfeldige variabler, de uavhengige variablene som påvirker systemets atferd. Utdatavariabler er resultatene av simuleringen og representerer mulige utfall basert på inndataene. Disse variablene kan være kontinuerlige eller diskrete, og er essensielle for å definere modellens omfang og begrensninger. Sensitivitetsanalyse gjennomføres ofte for å bestemme innvirkningen av hver inndata-variabel på utdataene, noe som styrer modellutvikling og validering.

Standardavvik og varians er viktige statistiske mål for å forstå spredningen og påliteligheten til simuleringsresultatene. Standardavvik gir innsikt i variasjonen fra gjennomsnittet, mens varians måler graden av spredning i en verdimengde. Disse målene er avgjørende for å tolke simuleringsresultater, særlig ved vurdering av risiko og usikkerhet knyttet til ulike utfall.

Monte Carlo-simuleringer følger en strukturert metode:

Avanserte Monte Carlo-simuleringer kan benytte teknikker som Markov Chain Monte Carlo (MCMC), som er spesielt nyttig for utvalg fra komplekse sannsynlighetsfordelinger. MCMC-metoder brukes blant annet i bayesiansk statistikk og maskinlæring for å tilnærme posteriordistribusjoner for modellparametere.

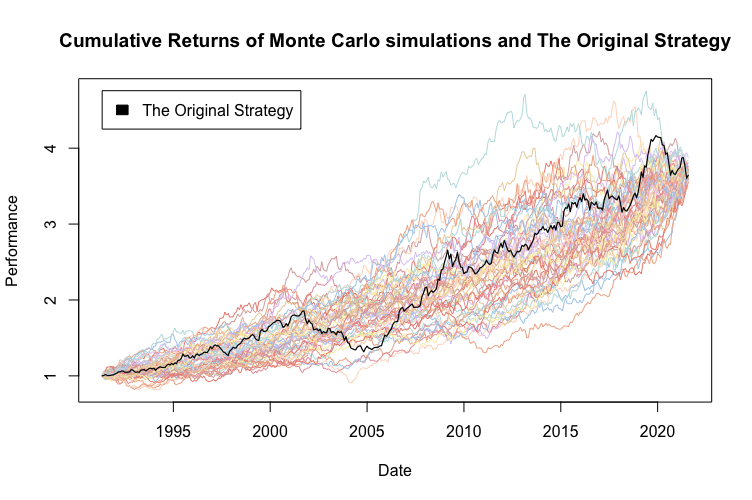

Monte Carlo-simuleringer er uunnværlige i finansiell modellering, der de brukes til å estimere sannsynligheten for investeringsavkastning, vurdere porteføljerisiko og prise derivater. Ved å simulere tusenvis av markedsscenarier kan finansanalytikere forutsi potensielle gevinster eller tap og utvikle strategier for å begrense risiko. Denne tilnærmingen er avgjørende for stresstesting av finansielle modeller og vurdering av hvordan markedssvingninger påvirker investeringsporteføljer.

I ingeniørfag brukes Monte Carlo-metoder til å simulere påliteligheten og ytelsen til systemer under varierende forhold. For eksempel kan de forutsi feilrater for komponenter i mekaniske systemer for å sikre at produkter oppfyller krav til sikkerhet og holdbarhet. Slike simuleringer benyttes også i kvalitetskontroll og prosessoptimalisering for å avdekke potensielle feil og ineffektiviteter.

Innen AI forbedrer Monte Carlo-metoder beslutningsalgoritmer, spesielt i miljøer preget av høy usikkerhet. Disse metodene hjelper AI-systemer med å evaluere mulige utfall av ulike handlinger, noe som gir bedre evne til å forutsi og tilpasse seg endringer. Monte Carlo Tree Search (MCTS) er et kjent eksempel innen spill og beslutningstaking, der AI kan ta informerte avgjørelser selv med ufullstendig informasjon.

Prosjektledere bruker Monte Carlo-simuleringer for å forutsi prosjektforløp og budsjetter, medregnet usikkerheter som forsinkelser og kostnadsoverskridelser. Dette hjelper i planlegging og ressursallokering ved å gi sannsynlighetsbaserte estimater for ferdigstillelse. Monte Carlo-metoder er særlig nyttige i risikostyring, der de bidrar til å identifisere og kvantifisere potensielle risikoer som kan påvirke prosjektmålene.

Miljøforskere benytter Monte Carlo-simuleringer til å modellere komplekse økologiske systemer og forutsi virkningen av endringer i miljøvariabler. Dette er avgjørende for risikovurdering og utvikling av effektive bevaringsstrategier. Monte Carlo-metoder brukes i klimamodellering, vurdering av biologisk mangfold og miljøkonsekvensanalyser, og gir innsikt i mulige konsekvenser av menneskelig aktivitet på naturmiljøet.

Selv om Monte Carlo-metoder har store fordeler, innebærer de også noen utfordringer:

Innen kunstig intelligens er Monte Carlo-metoder sentrale for utvikling av intelligente systemer som kan resonnere under usikkerhet. Disse metodene utfyller maskinlæring ved å tilby sannsynlighetsbaserte rammeverk som øker robustheten og tilpasningsevnen til AI-modeller.

Monte Carlo Tree Search (MCTS) er for eksempel en populær algoritme i AI, særlig innen spill og beslutningstaking. MCTS bruker tilfeldig utvalg for å evaluere mulige trekk i et spill, slik at AI kan ta velbegrunnede avgjørelser selv uten full informasjon. Denne teknikken har vært avgjørende for å utvikle AI-systemer som kan mestre avanserte spill som Go og sjakk.

Videre åpner integreringen av Monte Carlo-simuleringer med AI-teknologier som dyp læring og forsterkende læring nye muligheter for å utvikle intelligente systemer som kan tolke store datamengder, gjenkjenne mønstre og forutsi fremtidige trender med høyere presisjon. Disse synergieffektene forsterker AI-modellers evne til å lære av usikre data og forbedre beslutningstaking i dynamiske miljøer.

Monte Carlo-metoder er en kraftfull samling av beregningsalgoritmer brukt til å simulere og forstå komplekse systemer. Disse metodene baserer seg på gjentatt tilfeldig utvalg for å oppnå numeriske resultater, og er mye brukt i fag som fysikk, finans og ingeniørfag. Nedenfor er noen viktige vitenskapelige artikler som tar for seg ulike aspekter av Monte Carlo-metoder:

Fast Orthogonal Transforms for Multi-level Quasi-Monte Carlo Integration

Forfattere: Christian Irrgeher, Gunther Leobacher

Denne artikkelen tar for seg en metode for å kombinere raske ortogonale transformasjoner med quasi-Monte Carlo-integrasjon, noe som øker effektiviteten til sistnevnte. Forfatterne viser at denne kombinasjonen kan forbedre beregningseffektiviteten i fler-nivå Monte Carlo-metoder betydelig. Studien gir eksempler som validerer den økte effektiviteten, og er et verdifullt bidrag til beregningsmatematikk. Les mer

The Derivation of Particle Monte Carlo Methods for Plasma Modeling from Transport Equations

Forfatter: Savino Longo

Denne forskningen gir en detaljert analyse av utledning av partikkel- og Monte Carlo-metoder fra transportlikninger, spesielt for plasmasimulering. Den dekker teknikker som Particle in Cell (PIC) og Monte Carlo (MC), og gir innsikt i det matematiske grunnlaget for disse simuleringsmetodene. Artikkelen er viktig for å forstå anvendelsen av Monte Carlo-metoder i plasmafysikk. Les mer

Projected Multilevel Monte Carlo Method for PDE with Random Input Data

Forfattere: Myoungnyoun Kim, Imbo Sim

Forfatterne introduserer en projisert fler-nivå Monte Carlo-metode for å redusere beregningskompleksitet og samtidig opprettholde feilkonsistens. Studien fremhever at fler-nivå Monte Carlo-metoder kan gi ønsket nøyaktighet med mindre beregningstid sammenlignet med tradisjonelle Monte Carlo-metoder. Numeriske eksperimenter er inkludert for å underbygge de teoretiske påstandene. Les mer

Inference with Hamiltonian Sequential Monte Carlo Simulators

Forfatter: Remi Daviet

Denne artikkelen foreslår en ny Monte Carlo-simulator som kombinerer styrkene til sekvensielle Monte Carlo- og Hamiltonian Monte Carlo-simulatorer. Den er spesielt effektiv for inferens i komplekse og multimodale scenarier. Artikkelen inkluderer flere eksempler som demonstrerer hvor robust metoden er til å håndtere vanskelige sannsynlighetsfordelinger og målfunksjoner. Les mer

Antithetic Riemannian Manifold and Quantum-Inspired Hamiltonian Monte Carlo

Forfattere: Wilson Tsakane Mongwe, Rendani Mbuvha, Tshilidzi Marwala

Forskningen presenterer nye algoritmer som forbedrer Hamiltonian Monte Carlo-metoder ved å innføre antitetisk utvalg og kvanteinspirerte teknikker. Disse innovasjonene gir bedre utvalgsrater og lavere varians i estimeringer. Metodene anvendes på finansmarkedsdata og bayesiansk logistisk regresjon og viser betydelige forbedringer i utvalgseffektivitet. Les mer

Monte Carlo-metoder er en klasse av beregningsalgoritmer som bruker gjentatt tilfeldig utvalg for å oppnå numeriske løsninger på komplekse problemer, ofte knyttet til usikkerhet og sannsynlighetsmodellering.

De brukes mye innen finans for risikovurdering og porteføljeoptimalisering, i ingeniørfag for pålitelighet og kvalitetskontroll, i kunstig intelligens for beslutningstaking under usikkerhet, samt i prosjektledelse og miljøvitenskap for prognoser og risikovurdering.

Hovedfordelen er evnen til å modellere usikkerhet og simulere et bredt spekter av mulige utfall, noe som gir verdifull innsikt for beslutningstaking i komplekse systemer.

Monte Carlo-metoder kan være ressurskrevende, krever høykvalitets tilfeldig tallgenerering, og kan møte utfordringer som dimensjonalitetsforbannelsen når modellkompleksiteten øker.

Utforsk hvordan Monte Carlo-metoder og AI-drevne verktøy kan forbedre beslutningstaking, risikoanalyse og komplekse simuleringer for din virksomhet eller forskning.

Random Forest-regresjon er en kraftig maskinlæringsalgoritme som brukes til prediktiv analyse. Den konstruerer flere beslutningstrær og gjennomsnittliggjør dere...

Mønsterxadgjenkjenning er en beregningsprosess for å identifisere mønstre og regulariteter i data, avgjørende innen felt som KI, informatikk, psykologi og dataa...

Boosting er en maskinlæringsteknikk som kombinerer prediksjonene til flere svake lærere for å skape en sterk lærer, noe som forbedrer nøyaktigheten og håndterer...