Retrieval Augmented Generation (RAG)

Retrieval Augmented Generation (RAG) er et avansert AI-rammeverk som kombinerer tradisjonelle informasjonshentingssystemer med generative store språkmodeller (L...

Dokument-omrangering er prosessen med å omorganisere hentede dokumenter basert på hvor relevante de er for en brukers søk, slik at søkeresultater forbedres ved å prioritere den mest relevante informasjonen. Det er et nøkkelsteg i Retrieval-Augmented Generation (RAG)-systemer, ofte kombinert med spørsmålsutvidelse for å øke både tilbakekalling og presisjon i AI-drevne søk og chatboter.

Dokument-omrangering omorganiserer hentede dokumenter basert på søkerelevans, og forbedrer søkeresultater. Spørsmålsutvidelse forbedrer søk ved å legge til relaterte termer, øker tilbakekalling og reduserer tvetydighet. Kombinasjon av disse teknikkene i RAG-systemer øker nøyaktigheten på henting og svar.

Dokument-omrangering er prosessen med å omorganisere hentede dokumenter basert på hvor relevante de er for brukerens søk. Etter en første henting forbedrer omrangering resultatene ved å vurdere hvert dokuments relevans mer presist, og sørger for at de mest relevante dokumentene prioriteres.

Retrieval-Augmented Generation (RAG) er et avansert rammeverk som kombinerer evnene til store språkmodeller (LLMs) med informasjonsgjenfinningssystemer. I RAG, når en bruker sender inn et søk, henter systemet relevante dokumenter fra en stor kunnskapsbase og gir denne informasjonen til LLM-en for å generere informerte og kontekstuelt nøyaktige svar. Denne tilnærmingen øker nøyaktigheten og relevansen til AI-generert innhold ved å forankre det i faktabasert data.

Definisjon

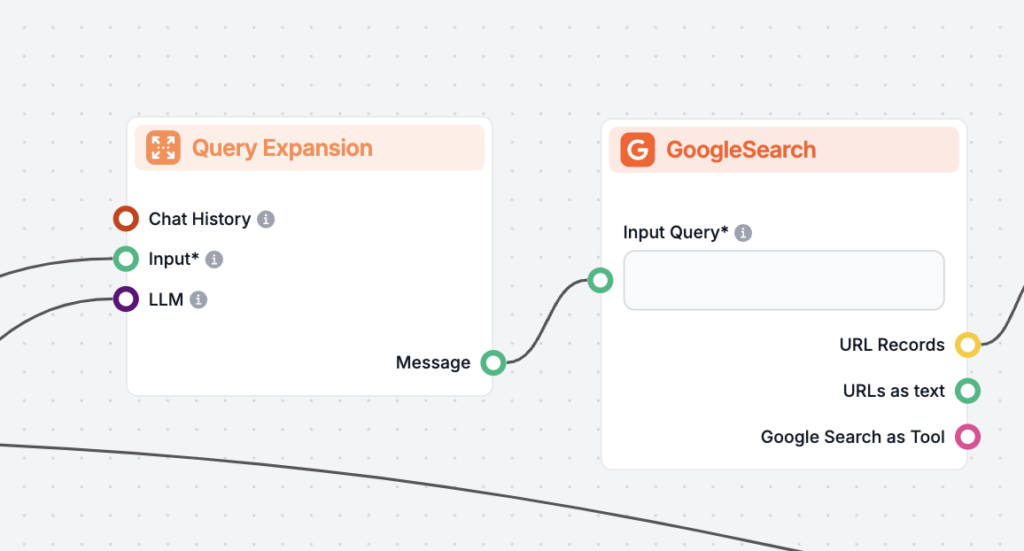

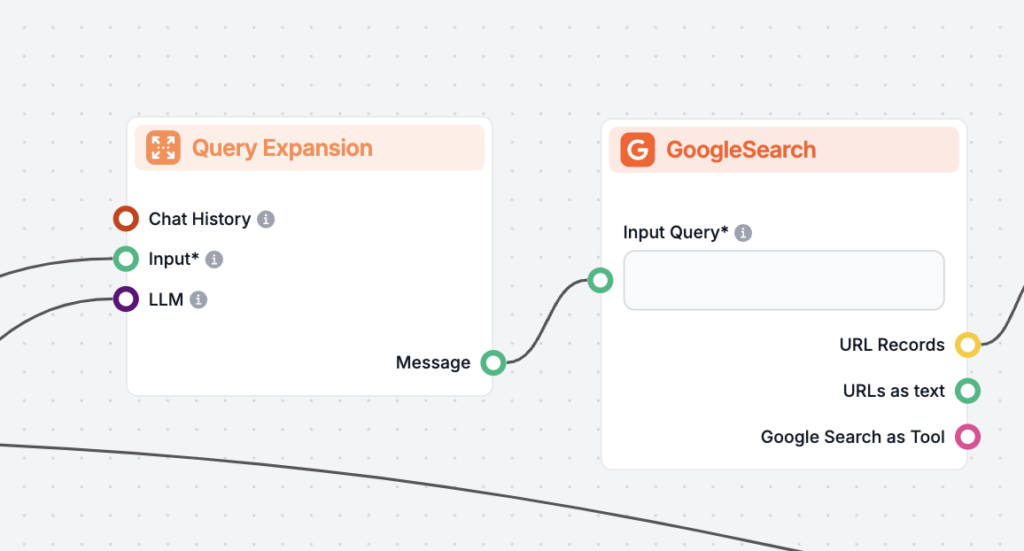

Spørsmålsutvidelse er en teknikk brukt i informasjonsgjenfinning for å forbedre effektiviteten til søk. Det innebærer å utvide det opprinnelige søket med ekstra ord eller fraser som er semantisk relaterte. Hovedmålet er å bygge bro mellom brukerens hensikt og språket brukt i relevante dokumenter, og dermed forbedre henting av relevant informasjon.

Hvordan det fungerer

I praksis kan spørsmålsutvidelse oppnås gjennom ulike metoder:

Ved å utvide søket kan hentesystemet kaste et bredere nett og fange opp dokumenter som ellers ville blitt oversett på grunn av variasjoner i terminologi eller formulering.

Forbedring av tilbakekalling

Tilbakekalling refererer til systemets evne til å finne alle relevante dokumenter. Spørsmålsutvidelse forbedrer tilbakekalling ved å:

Håndtering av tvetydighet

Brukere sender ofte inn korte eller tvetydige søk. Spørsmålsutvidelse hjelper med å:

Forbedret dokumentmatching

Ved å inkludere flere relevante termer øker systemet sannsynligheten for å matche søket med dokumenter som bruker ulike ord, og forbedrer dermed den totale effektiviteten til henting.

Hva er PRF?

Pseudo-relevance feedback er en automatisk metode for spørsmålsutvidelse der systemet antar at de høyest rangerte dokumentene fra et første søk er relevante. Det trekker ut viktige termer fra disse dokumentene for å forbedre det opprinnelige søket.

Hvordan PRF fungerer

Fordeler og ulemper

Utnyttelse av store språkmodeller

Med fremskritt innen AI kan LLM-er som GPT-3 og GPT-4 generere avanserte spørsmålsutvidelser ved å forstå kontekst og semantikk.

Hvordan LLM-basert utvidelse fungerer

Eksempel

Opprinnelig søk:

“Hva var de viktigste faktorene som bidro til økt omsetning?”

LLM-generert svar:

“I regnskapsåret bidro flere nøkkelfaktorer til en betydelig økning i selskapets omsetning, inkludert vellykkede markedsføringskampanjer, produktdiversifisering, tiltak for kundetilfredshet, strategisk prising og investeringer i teknologi.”

Utvidet søk:

“Opprinnelig søk: Hva var de viktigste faktorene som bidro til økt omsetning?

Hypotetisk svar: [LLM-generert svar]”

Fordeler

Utfordringer

Steg-for-steg prosess

Fordeler i RAG-systemer

Hvorfor omrangering er nødvendig

Oversikt

Cross-encoders er nevrale nettverksmodeller som tar et par av inputs (søket og et dokument) og gir en relevansscore. I motsetning til bi-encoders, som koder søk og dokument separat, prosesserer cross-encoders dem sammen, som gir rikere interaksjon.

Hvordan cross-encoders fungerer

Fordeler

Utfordringer

Hva er ColBERT?

ColBERT (Contextualized Late Interaction over BERT) er en hentemodell designet for å balansere effektivitet og kvalitet. Den bruker en mekanisme for sen interaksjon som gir detaljert sammenligning mellom søke- og dokumenttokens uten tunge regnekostnader.

Hvordan ColBERT fungerer

Fordeler

Bruksområder

Oversikt

FlashRank er et lettvekts og raskt omrangeringsbibliotek som bruker toppmoderne cross-encoders. Det er laget for enkel integrasjon i eksisterende arbeidsflyter og forbedrer omrangeringsytelse med minimalt tillegg.

Egenskaper

Eksempel på bruk

from flashrank import Ranker, RerankRequest

query = 'What were the most important factors that contributed to increases in revenue?'

ranker = Ranker(model_name="ms-marco-MiniLM-L-12-v2")

rerank_request = RerankRequest(query=query, passages=documents)

results = ranker.rerank(rerank_request)

Fordeler

Prosess

Vurderinger

Utfyllende teknikker

Fordeler med å kombinere

Eksempel arbeidsflyt

Spørsmålsutvidelse med LLM:

def expand_query(query):

prompt = f"Provide additional related queries for: '{query}'"

expanded_queries = llm.generate(prompt)

expanded_query = ' '.join([query] + expanded_queries)

return expanded_query

Første henting:

documents = vector_db.retrieve_documents(expanded_query)

Dokument-omrangering:

from sentence_transformers import CrossEncoder

cross_encoder = CrossEncoder('cross-encoder/ms-marco-MiniLM-L-6-v2')

pairs = [[query, doc.text] for doc in documents]

scores = cross_encoder.predict(pairs)

ranked_docs = [doc for _, doc in sorted(zip(scores, documents), reverse=True)]

Velge toppdokumenter:

top_documents = ranked_docs[:top_k]

Generere svar med LLM:

context = '\n'.join([doc.text for doc in top_documents])

prompt = f"Answer the following question using the context provided:\n\nQuestion: {query}\n\nContext:\n{context}"

response = llm.generate(prompt)

Overvåking og optimalisering

Scenario

Et selskap bruker en AI-chatbot for å håndtere kundehenvendelser om sine produkter og tjenester. Kunder stiller ofte spørsmål på ulike måter, med forskjellige uttrykk og formuleringer.

Utfordringer

Implementering

Fordeler

Scenario

Forskere bruker en AI-assistent for å finne relevante akademiske artikler, data og innsikt til sitt arbeid.

Utfordringer

Implementering

Oppdag hvordan dokument-omrangering og spørsmålsutvidelse kan forbedre nøyaktighet og relevans i dine AI-chatboter og automasjonsflyter. Bygg smartere AI med FlowHunt.

Retrieval Augmented Generation (RAG) er et avansert AI-rammeverk som kombinerer tradisjonelle informasjonshentingssystemer med generative store språkmodeller (L...

Oppdag de viktigste forskjellene mellom Retrieval-Augmented Generation (RAG) og Cache-Augmented Generation (CAG) innen AI. Lær hvordan RAG henter sanntidsinform...

Oppdag hvordan Retrieval-Augmented Generation (RAG) transformerer bedrifts-AI, fra grunnleggende prinsipper til avanserte agentiske arkitekturer som FlowHunt. L...