Spørsmål og svar

Spørsmål og svar med Retrieval-Augmented Generation (RAG) kombinerer informasjonsinnhenting og naturlig språk-generering for å forbedre store språkmodeller (LLM...

Forsterkende læring fra menneskelig tilbakemelding (RLHF) er en maskinlæringsteknikk som integrerer menneskelig innspill for å styre treningsprosessen til forsterkende læringsalgoritmer. I motsetning til tradisjonell forsterkende læring, som utelukkende baserer seg på forhåndsdefinerte belønningssignaler, benytter RLHF menneskelige vurderinger for å forme og finjustere atferden til AI-modeller. Denne tilnærmingen sikrer at AI-en tilpasses menneskelige verdier og preferanser, noe som gjør den spesielt nyttig i komplekse og subjektive oppgaver.

Forsterkende læring fra menneskelig tilbakemelding (RLHF) er en maskinlæringsteknikk som integrerer menneskelig innspill for å styre treningsprosessen til forsterkende læringsalgoritmer. I motsetning til tradisjonell forsterkende læring, som utelukkende baserer seg på forhåndsdefinerte belønningssignaler, benytter RLHF menneskelige vurderinger for å forme og finjustere atferden til AI-modeller. Denne tilnærmingen sikrer at AI-en tilpasses menneskelige verdier og preferanser, noe som gjør den spesielt nyttig i komplekse og subjektive oppgaver der automatiserte signaler kan være utilstrekkelige.

RLHF er viktig av flere grunner:

RLHF-prosessen følger vanligvis disse trinnene:

Innen generativ AI brukes RLHF til å forbedre modeller som genererer tekst, bilder eller annet innhold. For eksempel bruker språkmodeller som GPT-3 RLHF for å produsere mer sammenhengende og kontekstuelt relevant tekst ved å inkorporere menneskelig tilbakemelding på genererte resultater.

Robotikk kan dra nytte av RLHF ved å inkorporere menneskelig tilbakemelding for å forbedre robotens samhandling med omgivelsene. Dette kan føre til mer effektive og sikrere roboter som kan utføre komplekse oppgaver i dynamiske miljøer.

RLHF kan forbedre anbefalingssystemer ved å tilpasse dem tettere til brukerens preferanser. Menneskelig tilbakemelding hjelper til med å finjustere algoritmene slik at anbefalingene blir mer relevante og tilfredsstillende for brukerne.

Innen generativ AI er RLHF avgjørende for å forbedre modeller som genererer kreativt innhold, som tekst, bilder og musikk. Ved å integrere menneskelig tilbakemelding kan disse modellene produsere resultater som ikke bare er teknisk korrekte, men også estetisk tiltalende og kontekstuelt passende. Dette er spesielt viktig i applikasjoner som chatboter, innholdsskaping og kunstneriske prosjekter, der subjektiv kvalitet er avgjørende.

Start å bygge AI-løsninger som samsvarer med menneskelige verdier ved å bruke FlowHunt sin plattform. Opplev kraften av RLHF i dine prosjekter.

Spørsmål og svar med Retrieval-Augmented Generation (RAG) kombinerer informasjonsinnhenting og naturlig språk-generering for å forbedre store språkmodeller (LLM...

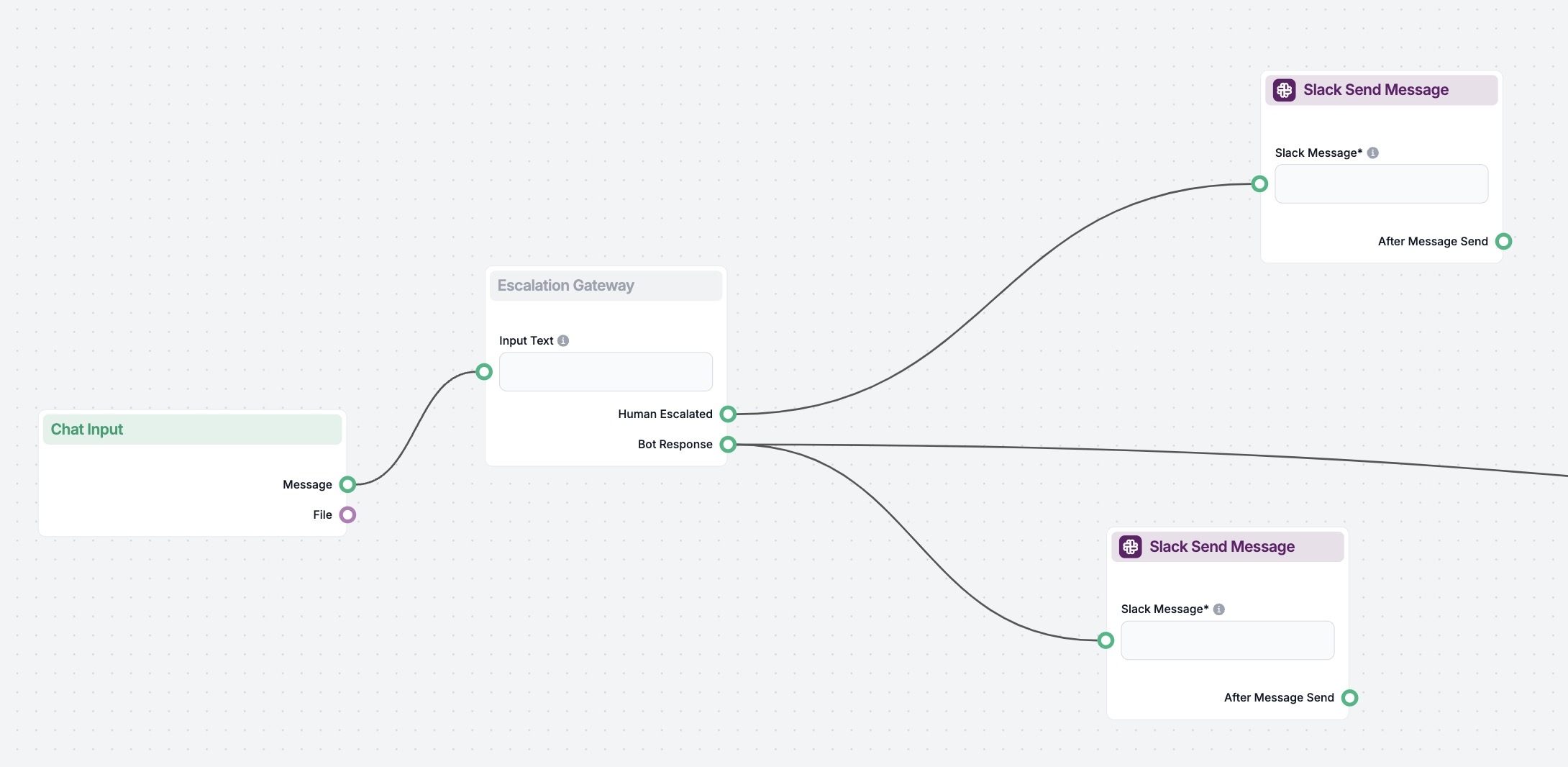

Oppdag viktigheten og bruksområdene for Human in the Loop (HITL) i AI-chatboter, der menneskelig ekspertise forbedrer AI-systemene for økt nøyaktighet, etiske s...

Human-in-the-Loop (HITL) er en tilnærming innen AI og maskinlæring som integrerer menneskelig ekspertise i trening, justering og bruk av AI-systemer, for å øke ...