AI Penetrasjonstesting

AI penetrasjonstesting er en strukturert sikkerhetsvurdering av AI-systemer — inkludert LLM chatboter, autonome agenter og RAG-pipelines — som bruker simulerte ...

Din chatbot er din nye angrepsflate. Vi simulerer hele spekteret av LLM-spesifikke angrep — prompt injection, jailbreaking, RAG poisoning, dataeksfiltrasjon og API-misbruk — og leverer en prioritert utbedringsrapport. Bygget av teamet bak FlowHunt.

Tradisjonelle penetrasjonstestingsmetoder ble ikke designet for AI-systemer. LLM-baserte chatbots har unike angrepsflater — naturlige språkgrensesnitt, RAG-hentingspipelines, verktøyintegrasjoner og kontekstvinduhåndtering — som krever spesialiserte testteknikker.

I motsetning til tradisjonelle webapplikasjoner, prosesserer AI chatbots naturlig språk og kan manipuleres gjennom selve grensesnittet de ble designet for å bruke. En chatbot som består alle konvensjonelle sikkerhetskontroller kan fortsatt være sårbar for prompt injection, jailbreaking og RAG poisoning-angrep.

Hvert oppdrag følger en strukturert, OWASP LLM Top 10-tilpasset metodikk. Vi kartlegger hvert funn til en anerkjent sårbarhetskategori slik at teamet ditt kan prioritere utbedring med tillit.

ANGREPSDEKNING

Våre vurderinger dekker hver større angrepsflate spesifikk for LLM-baserte AI chatbots

Direkte og indirekte injeksjonsangrep inkludert rollespillmanipulering, flerrundesekvenser og miljøbasert injeksjon gjennom hentet innhold

Teknikker for omgåelse av sikkerhetsbarrierer inkludert DAN-varianter, persona-angrep, token smuggling og flerstegs manipuleringssekvenser

Kunnskapsbasekontamineringsangrep som får chatboten din til å hente og handle på ondsinnet, angriper-kontrollert innhold fra dine egne datakilder

Teknikker for å avsløre konfidensielt systempromptinnhold, forretningsregler, sikkerhetsinstruksjoner og konfigurasjonshemmeligheter som bør forbli private

Angrep som ekstraherer PII, API-legitimasjon, interne forretningsdata og sensitive dokumenter fra chatbotens tilkoblede datakilder og kontekst

Omgåelse av hastighetsbegrensning, utnyttelse av autentiseringssvakheter, testing av autorisasjonsgrenser og denial-of-service-scenarier mot LLM API-endepunkter

Transparent, kompleksitetsbasert prising. Hvert oppdrag starter med en gratis kartleggingssamtale for å definere vurderingsgrensene og gi et fastpristilbud.

Vi tester ikke bare chatbots — vi bygde en av de mest avanserte AI chatbot-plattformene tilgjengelig. Den innsidekunnskapen gjør våre sikkerhetsvurderinger dypere og mer nøyaktige.

FlowHunt er en produksjons-AI chatbot og arbeidsflytautomatiseringsplattform. Vi forstår LLM-arkitektur, RAG-pipelines og verktøyintegrasjoner innenfra.

År med drift av FlowHunt i produksjon betyr at vi har møtt og rettet virkelige sårbarheter — ikke bare teoretiske fra forskningsartikler.

Vår metodikk kartlegger til hver kategori i OWASP LLM Top 10, og gir et standardisert, reviderbart vurderingsrammeverk.

Funn er skrevet for ingeniørteam — med spesifikke kode-nivå anbefalinger, ikke bare høynivå observasjoner.

Alle oppdrag er dekket av NDA. Angrepspayloads, funn og systemdetaljer deles aldri eller gjenbrukes.

Standard vurderinger fullføres innen 1–2 uker fra oppstart. Hastevurderinger tilgjengelig for tidssensitive situasjoner.

Hvert oppdrag leverer en strukturert, handlingsorientert sikkerhetsrapport — skrevet for både ledere og ingeniørteam.

AI chatbot penetrasjonstesting er en strukturert sikkerhetsvurdering som simulerer virkelige angrep mot ditt AI chatbot-system. Våre sikkerhetsingeniører tester for prompt injection, jailbreaking, dataeksfiltrasjon, RAG poisoning, kontekstmanipulering og API-misbruk — de samme sårbarhetene som er katalogisert i OWASP LLM Top 10.

Vår prising er EUR 2 400 per manndagsverk. En standard vurdering for en produksjonschatbot krever vanligvis 2–5 manndagsverk avhengig av antall integrasjoner, kunnskapskilder og API-endepunkter som er inkludert. Vi gir et fastpristilbud etter en gratis kartleggingssamtale.

Du mottar en detaljert skriftlig rapport som dekker: sammendrag for ledelsen, kart over angrepsflate, funn rangert etter CVSS-tilsvarende alvorlighetsgrad, proof-of-concept angrepsdemonstrasjon, utbedringanbefaling med innsatsestimater, og en ny testplass for å verifisere rettinger.

Vi bygde FlowHunt — en av de mest kapable AI chatbot- og arbeidsflytautomatiseringsplattformene som er tilgjengelige. Vi forstår hvordan LLM-baserte chatbots fungerer på arkitekturnivå: hvordan systemprompts er konstruert, hvordan RAG-hentingspipelines kan forgiftes, hvordan kontekstvinduer håndteres, og hvordan API-integrasjoner kan misbrukes. Den innsidekunnskapen gjør våre vurderinger dypere og mer nøyaktige enn generalistiske sikkerhetsfirmaer.

Ja. Vi tester AI chatbots bygget på hvilken som helst plattform — GPT-basert, Claude-basert, Gemini-basert, eller open-source LLMs — enten de er distribuert via API, innebygd widget, eller tilpasset infrastruktur. Vår metodikk er modellagnostisk.

OWASP LLM Top 10 er bransjestandardlisten over de mest kritiske sikkerhetsrisikoene for applikasjoner bygget på store språkmodeller. Den dekker prompt injection, usikker outputhåndtering, forgiftning av treningsdata, modell denial of service, sårbarheter i forsyningskjeden, og mer. Vår testmetodikk kartlegger direkte til alle 10 kategoriene.

En standard avgrenset vurdering tar 2–5 manndagsverk med aktiv testing, pluss 1 manndagsverk for rapportskriving og gjennomgang. Total kalendertid fra oppstart til endelig rapport er typisk 1–2 uker.

Få en omfattende sikkerhetsvurdering av din AI chatbot fra teamet som bygger og driver FlowHunt. Vi vet nøyaktig hvor chatbots svikter — og hvordan angripere utnytter det.

AI penetrasjonstesting er en strukturert sikkerhetsvurdering av AI-systemer — inkludert LLM chatboter, autonome agenter og RAG-pipelines — som bruker simulerte ...

En omfattende guide til AI chatbot sikkerhetsrevisjoner: hva som testes, hvordan du forbereder deg, hvilke leveranser du kan forvente, og hvordan du tolker funn...

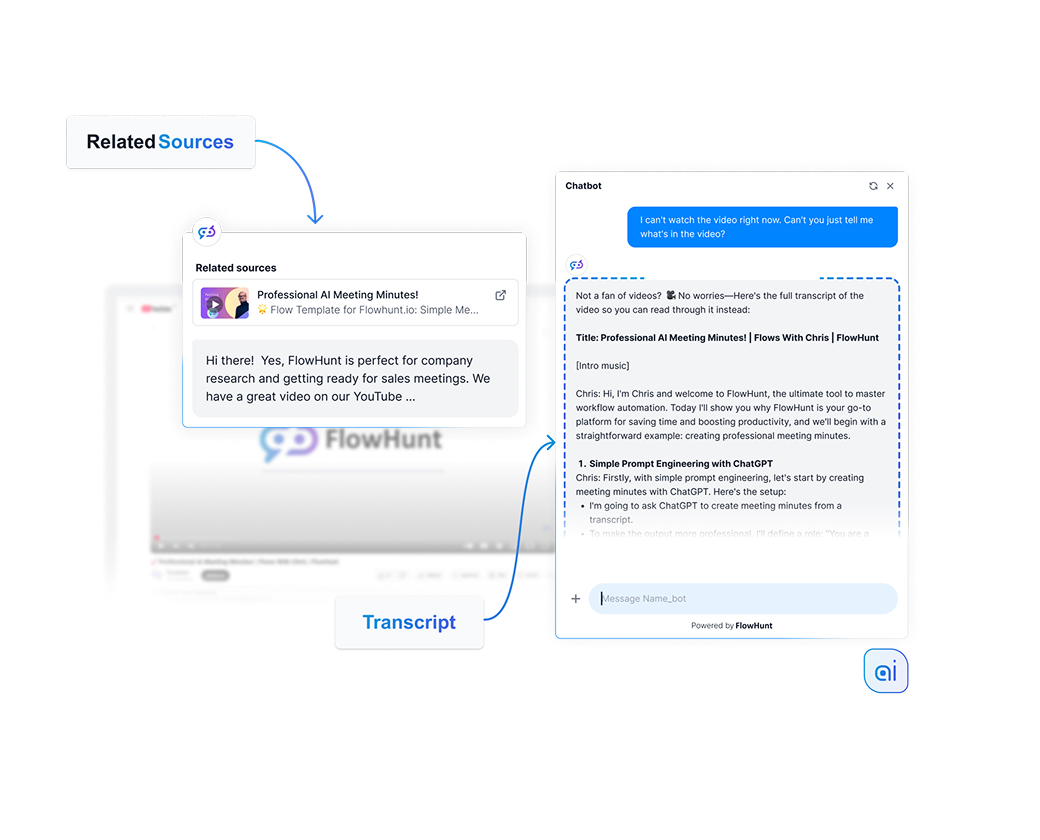

Gi AI kunnskap og sanntids internettilgang for å sikre relevante og oppdaterte svar.