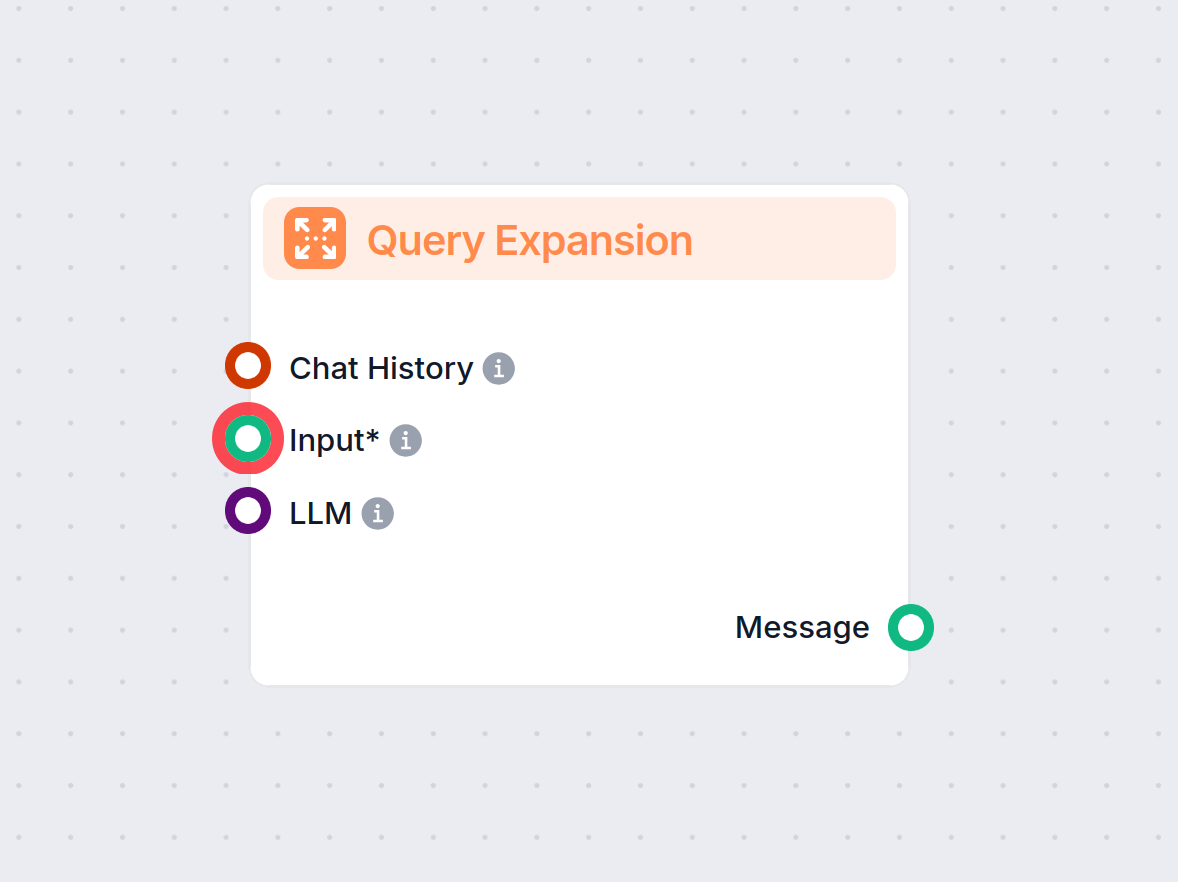

Rozszerzanie zapytań

Rozszerzanie zapytań w FlowHunt zwiększa zrozumienie chatbota, znajdując synonimy, poprawiając błędy ortograficzne oraz zapewniając spójne i dokładne odpowiedzi...

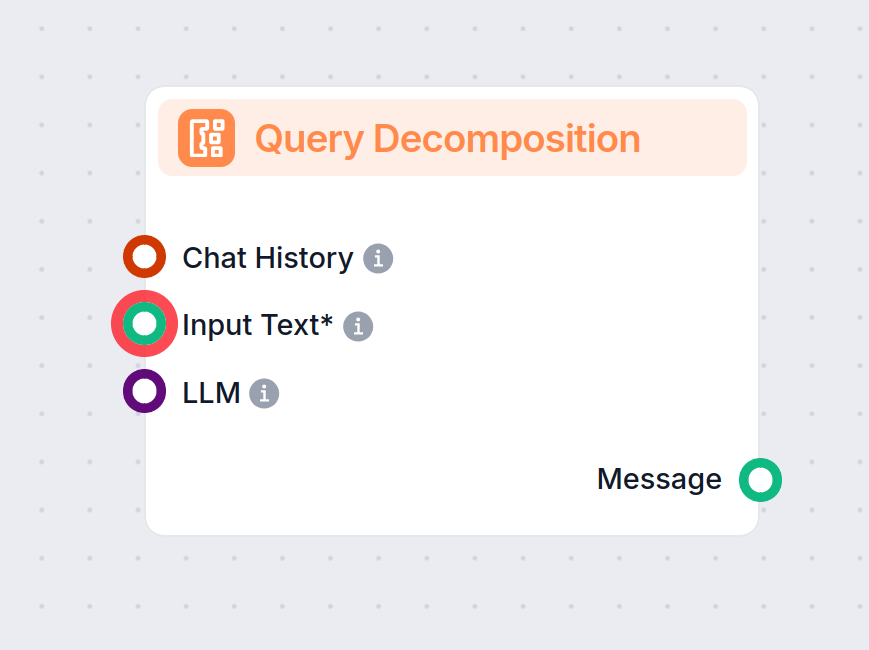

Dekonstrukcja zadań rozbija złożone zapytania na mniejsze podzapytania, pomagając chatbotom AI udzielać dokładniejszych i bardziej precyzyjnych odpowiedzi.

Opis komponentu

Query Decomposition is a flow component designed to enhance the precision and effectiveness of AI-driven workflows by breaking down complex input queries into distinct, manageable sub-queries. This process helps ensure that each aspect of a user’s original question is addressed, leading to more thorough and accurate responses.

The primary function of the Query Decomposition component is to take an input text—typically a complex or multi-part question—and split it into several alternative or sub-queries. These sub-queries represent the individual pieces of information that need to be resolved in order to fully answer the original query. This approach is especially useful in scenarios where a question is broad, ambiguous, or composed of several intertwined elements.

| Input Name | Type | Required | Description |

|---|---|---|---|

| Input Text | Message | Yes | The main text or question that you want to split into multiple alternative queries. |

| Chat History | InMemoryChatMessageHistory | No | Previous chat messages to provide context for generating more precise sub-queries. |

| LLM (Model) | BaseChatModel | No | The language model used for generating alternative queries. |

| Include Original Query | Boolean | No | Option to include the original query in the list of alternative queries. |

| System Message | String | No | Additional system-level instruction that can be appended to the prompt for customizing behavior. |

Query Decomposition is valuable in complex AI workflows where single queries may cover multiple topics or require multi-step reasoning. By breaking queries down, you can:

| Feature | Description |

|---|---|

| Input | Complex user query (text) |

| Output | List of alternative/sub-queries (as a message object) |

| Context Support | Yes (via chat history) |

| Model Selection | Yes (custom LLM can be specified) |

| Advanced Options | Include original query, custom system message |

By integrating Query Decomposition into your AI workflow, you enable smarter, more granular handling of complex queries, leading to improved outcomes and a better user experience.

Dekonstrukcja zapytań rozbija złożone i złożone zapytania na proste podzapytania, które są łatwiejsze do rozwiązania. W ten sposób może zapewnić bardziej szczegółowe i precyzyjne odpowiedzi.

Dekonstrukcja zapytań nie jest niezbędna do wszystkich Flow. Jej głównym zastosowaniem jest tworzenie botów obsługi klienta oraz wszędzie tam, gdzie wejście wymaga podejścia krok po kroku do złożonego zapytania. Użycie Dekonstrukcji Zadań zapewnia szczegółowe i bardzo trafne odpowiedzi. Bez tego bot może udzielać ogólnikowych odpowiedzi.

Oba pomagają botowi lepiej zrozumieć zapytanie. Dekonstrukcja zapytań bierze złożone lub złożone zapytania i rozkłada je na mniejsze, wykonalne kroki. Z kolei Rozszerzanie Zapytania uzupełnia niekompletne lub błędne zapytania, czyniąc je jasnymi i kompletnymi.

Zacznij budować inteligentniejsze chatboty AI i automatyzuj złożone zapytania dzięki komponentowi Dekonstrukcji Zapytania w FlowHunt.

Rozszerzanie zapytań w FlowHunt zwiększa zrozumienie chatbota, znajdując synonimy, poprawiając błędy ortograficzne oraz zapewniając spójne i dokładne odpowiedzi...

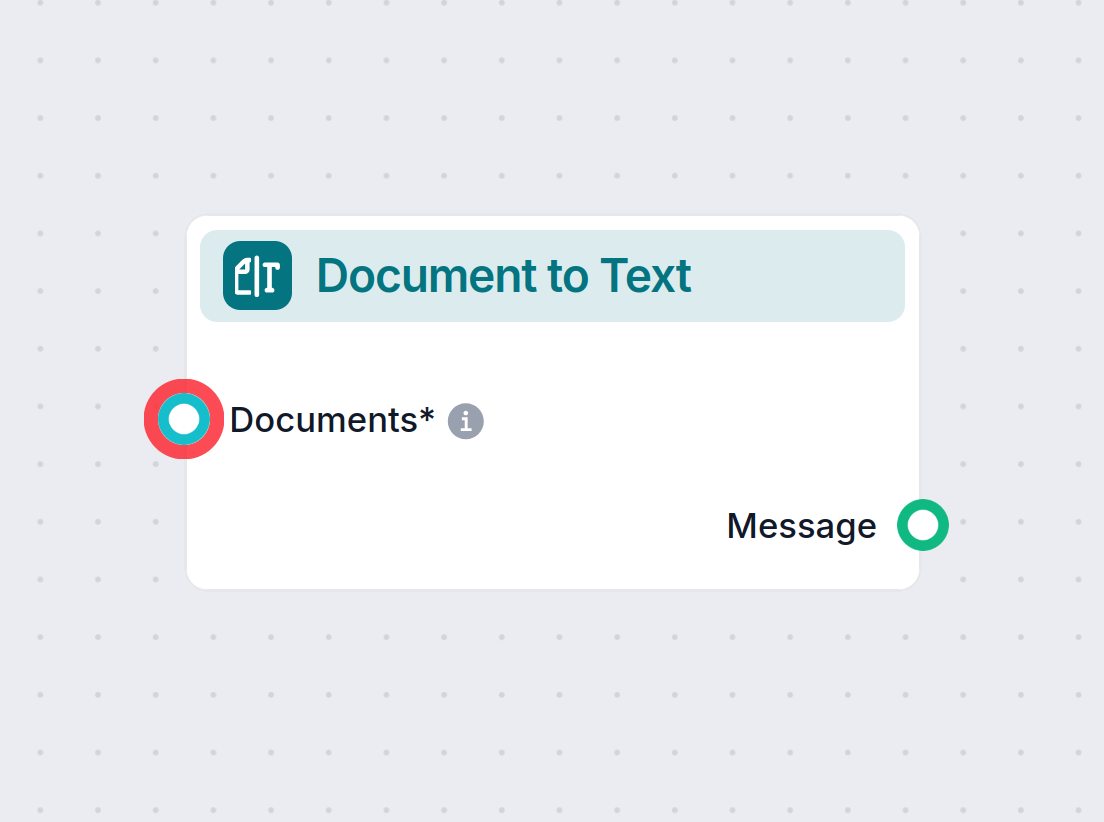

Komponent Dokument na tekst FlowHunt przekształca ustrukturyzowane dane z retrieverów w czytelny tekst markdown, dając Ci precyzyjną kontrolę nad tym, jak dane ...

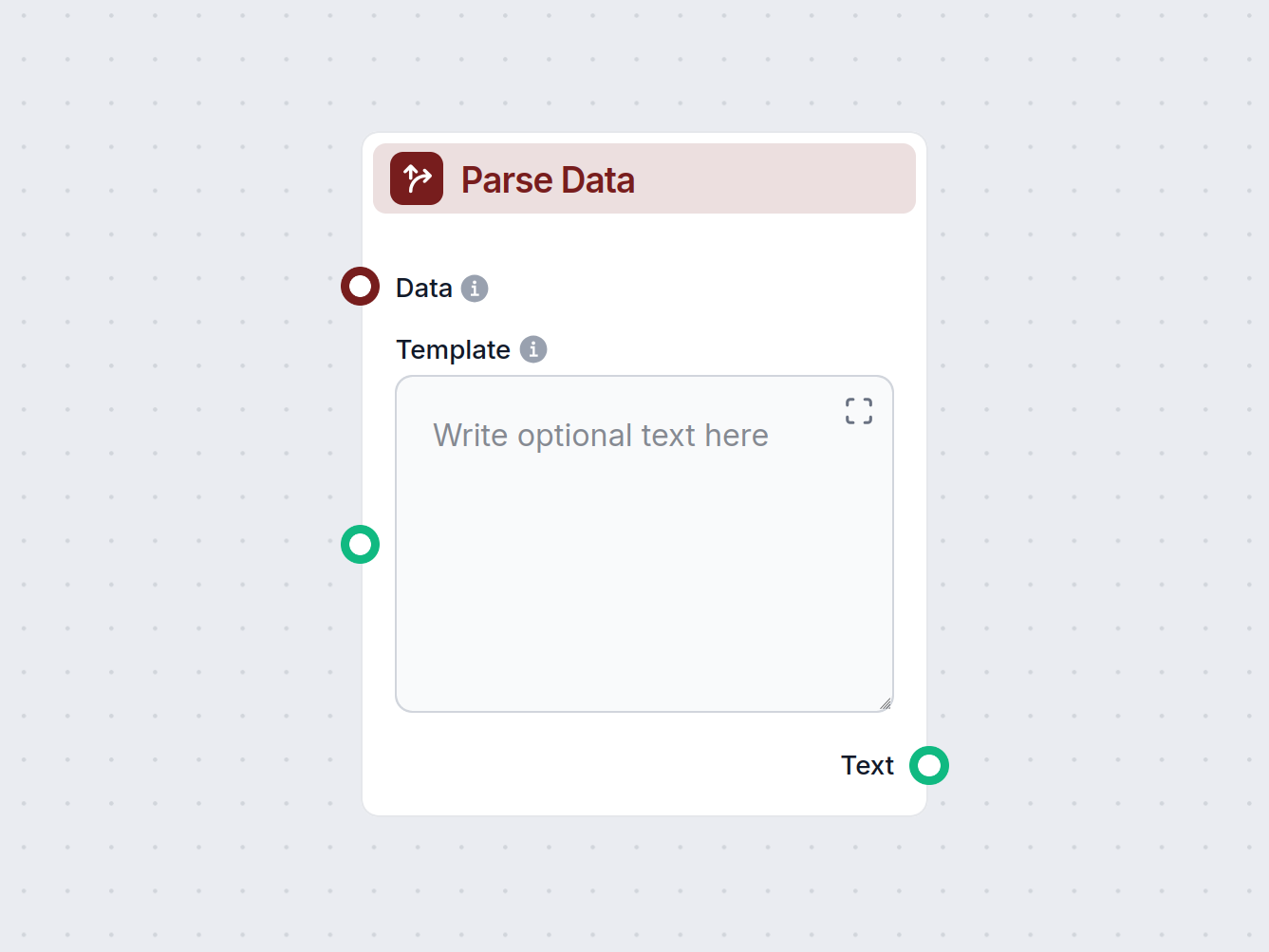

Komponent Parsowanie danych przekształca dane strukturalne w zwykły tekst za pomocą konfigurowalnych szablonów. Umożliwia elastyczne formatowanie i konwersję da...