LLM Meta AI

FlowHunt obsługuje dziesiątki modeli generowania tekstu, w tym modele Llama firmy Meta. Dowiedz się, jak zintegrować Llama z własnymi narzędziami AI i chatbotam...

LLM xAI od FlowHunt umożliwia integrację modeli generowania tekstu xAI, takich jak Grok-beta, z Twoimi chatbotami i narzędziami AI, z elastycznymi ustawieniami tokenów, temperatury i wyboru modelu.

Opis komponentu

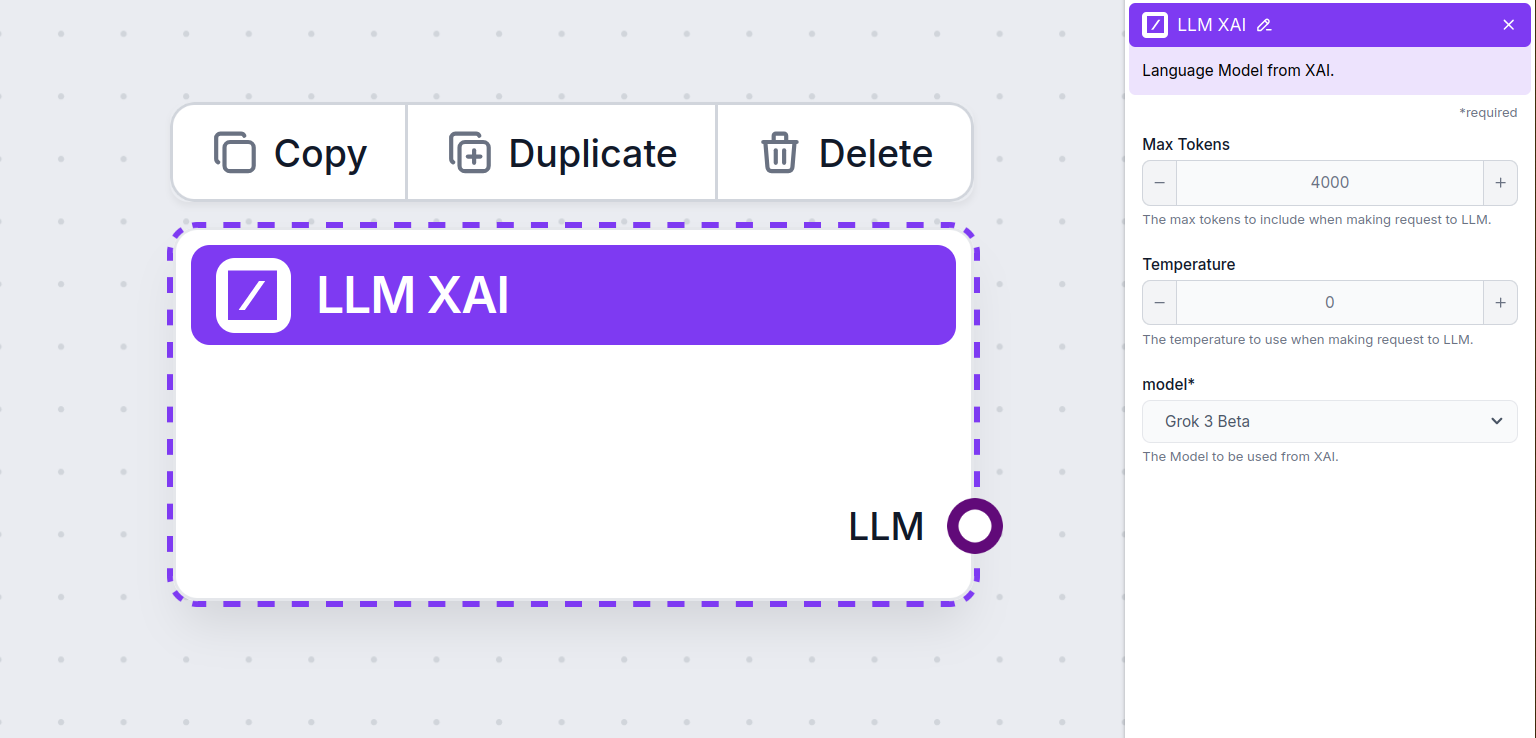

The LLM xAI component connects the Grok model to your flow. While the Generators and Agents are where the actual magic happens, LLM components allow you to control the model used. All components come with ChatGPT-4 by default. You can connect this component if you wish to change the model or gain more control over it.

Remember that connecting an LLM Component is optional. All components that use an LLM come with ChatGPT-4o as the default. The LLM components allow you to change the model and control model settings.

Tokens represent the individual units of text the model processes and generates. Token usage varies with models, and a single token can be anything from words or subwords to a single character. Models are usually priced in millions of tokens.

The max tokens setting limits the total number of tokens that can be processed in a single interaction or request, ensuring the responses are generated within reasonable bounds. The default limit is 4,000 tokens, which is the optimal size for summarizing documents and several sources to generate an answer.

Temperature controls the variability of answers, ranging from 0 to 1.

A temperature of 0.1 will make the responses very to the point but potentially repetitive and deficient.

A high temperature of 1 allows for maximum creativity in answers but creates the risk of irrelevant or even hallucinatory responses.

For example, the recommended temperature for a customer service bot is between 0.2 and 0.5. This level should keep the answers relevant and to the script while allowing for a natural response variation.

This is the model picker. Here, you’ll find all the supported models from the xAI provider. xAI’s flagship text model is called Grok. Currently, we only support the grok-beta model, as it is the only one that has been released for public API use.

Want to learn more about Grok-beta and see how it compares to other models? Check out this article.

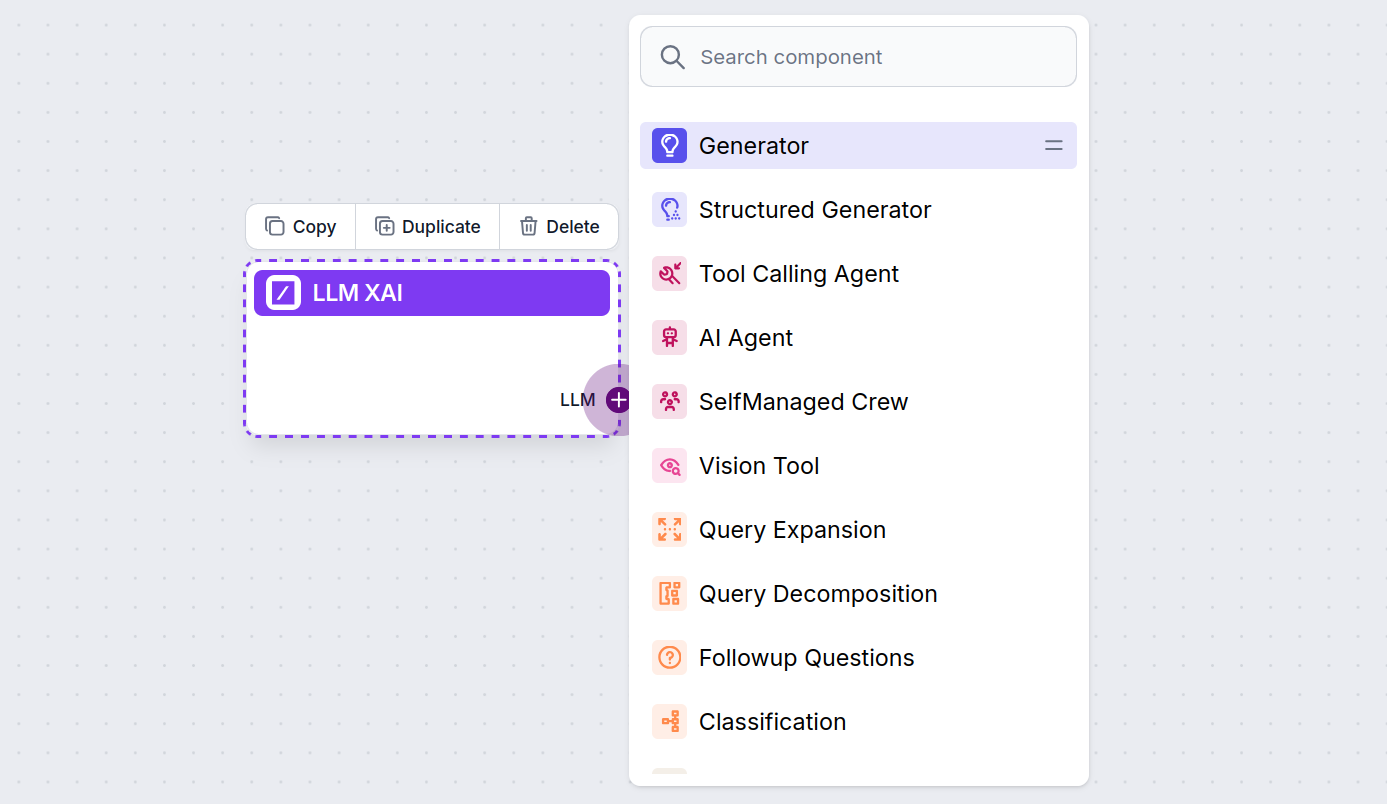

You’ll notice that all LLM components only have an output handle. Input doesn’t pass through the component, as it only represents the model, while the actual generation happens in AI Agents and Generators.

The LLM handle is always purple. The LLM input handle is found on any component that uses AI to generate text or process data. You can see the options by clicking the handle:

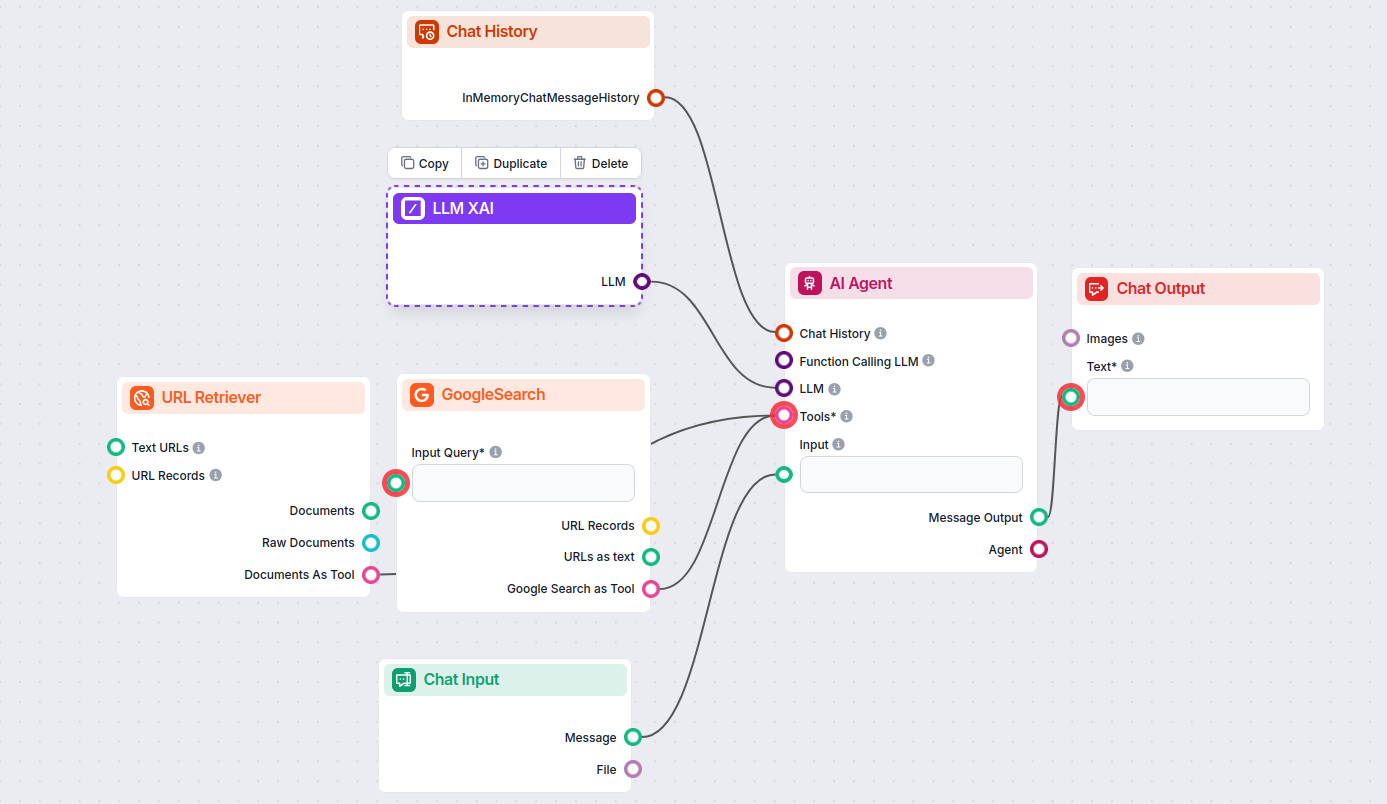

This allows you to create all sorts of tools. Let’s see the component in action. Here’s a simple AI Agent chatbot Flow that’s using xAI’s grok-beta to generate responses. You can think of it as a basic xAI chatbot.

This simple Chatbot Flow includes:

LLM xAI to komponent FlowHunt, który pozwala połączyć i kontrolować modele generowania tekstu dostawców xAI, takie jak Grok-beta, w Twoich przepływach AI i chatbotach.

Obecnie FlowHunt obsługuje model grok-beta od xAI, a kolejne modele będą dodawane, gdy tylko staną się dostępne poprzez publiczne API.

Możesz dostosować maksymalną liczbę tokenów, temperaturę (zmienność odpowiedzi) oraz wybrać dostępne modele xAI, aby dopasować zachowanie chatbota lub narzędzia AI.

Nie, to opcjonalne. Domyślnie komponenty korzystają z ChatGPT-4o, ale możesz podłączyć LLM xAI, aby przełączyć się na modele xAI lub uzyskać większą kontrolę.

Po prostu dodaj komponent LLM do przepływu; pełni on rolę selektora modelu. Właściwe generowanie tekstu odbywa się w AI Agentach i Generatorach połączonych z tym komponentem.

Buduj inteligentniejsze chatboty i narzędzia AI z FlowHunt. Połącz się z topowymi modelami xAI, takimi jak Grok-beta, w elastycznym panelu bez kodowania.

FlowHunt obsługuje dziesiątki modeli generowania tekstu, w tym modele Llama firmy Meta. Dowiedz się, jak zintegrować Llama z własnymi narzędziami AI i chatbotam...

FlowHunt obsługuje dziesiątki modeli AI, w tym rewolucyjne modele DeepSeek. Oto jak korzystać z DeepSeek w swoich narzędziach AI i chatbotach.

FlowHunt obsługuje dziesiątki modeli tekstowych AI, w tym modele Mistral. Dowiedz się, jak używać Mistral w swoich narzędziach AI i chatbotach.