Regresja lasów losowych

Regresja lasów losowych to potężny algorytm uczenia maszynowego wykorzystywany w analizie predykcyjnej. Buduje wiele drzew decyzyjnych i uśrednia ich wyniki, co...

Metody Monte Carlo wykorzystują losowe próbkowanie do rozwiązywania złożonych problemów w takich dziedzinach jak finanse, inżynieria i AI, umożliwiając modelowanie niepewności i analizę ryzyka.

Metody Monte Carlo wykorzystują losowe próbkowanie do rozwiązywania złożonych problemów, wspierając takie dziedziny jak finanse, inżynieria i AI. Pozwalają modelować niepewność, optymalizować decyzje i oceniać ryzyko, ale wymagają dużej mocy obliczeniowej i dobrej jakości liczb losowych.

Metody Monte Carlo, nazywane również eksperymentami Monte Carlo, to klasa algorytmów obliczeniowych opierających się na powtarzalnym losowym próbkowaniu w celu uzyskania numerycznych rozwiązań złożonych problemów. Podstawową zasadą metod Monte Carlo jest wykorzystanie losowości do rozwiązywania problemów, które mogą mieć charakter deterministyczny. Nazwa pochodzi od kasyna Monte Carlo w Monako, co odzwierciedla centralny element losowości w tych technikach. Koncepcję tę zapoczątkował matematyk Stanislaw Ulam, zainspirowany stochastyczną naturą hazardu. Metody Monte Carlo mają kluczowe znaczenie w dziedzinach wymagających optymalizacji, całkowania numerycznego oraz próbkowania z rozkładów prawdopodobieństwa.

Metody Monte Carlo są szeroko stosowane w różnych obszarach, takich jak fizyka, finanse, inżynieria i sztuczna inteligencja (AI), zwłaszcza tam, gdzie wspierają procesy decyzyjne w warunkach niepewności. Elastyczność symulacji Monte Carlo umożliwia modelowanie zjawisk o niepewnych zmiennych, co czyni je nieocenionymi w ocenie ryzyka i prognozowaniu probabilistycznym.

Początki metod Monte Carlo sięgają lat 40. XX wieku, kiedy to były wykorzystywane przy opracowywaniu broni jądrowej w ramach Projektu Manhattan. Ulam i John von Neumann zastosowali te metody do rozwiązywania złożonych całek związanych z dyfuzją neutronów. Szybko zyskały popularność w różnych dziedzinach nauki ze względu na swoją wszechstronność i skuteczność w rozwiązywaniu problemów związanych z losowością i niepewnością.

Sednem metod Monte Carlo jest proces losowego próbkowania. Polega on na generowaniu liczb losowych w celu symulowania różnych scenariuszy i oceny potencjalnych wyników. Wiarygodność wyników Monte Carlo w dużej mierze zależy od jakości tych liczb losowych, które zazwyczaj generuje się za pomocą generatorów liczb pseudolosowych. Generatory te oferują kompromis pomiędzy szybkością a wydajnością w porównaniu do tradycyjnych tabel liczb losowych. Rzetelność wyników można znacznie poprawić, stosując techniki takie jak redukcja wariancji czy sekwencje quasi-losowe.

Symulacje Monte Carlo wykorzystują rozkłady prawdopodobieństwa do modelowania zachowania zmiennych. Do najczęściej stosowanych należą rozkład normalny, charakteryzujący się dzwonowatym, symetrycznym wykresem, oraz rozkład jednostajny, w którym wszystkie wyniki są równie prawdopodobne. Wybór odpowiedniego rozkładu jest kluczowy, ponieważ wpływa na dokładność symulacji oraz jej przydatność w rzeczywistych zastosowaniach. Zaawansowane zastosowania mogą wykorzystywać rozkłady takie jak Poissona czy wykładniczy do modelowania określonych rodzajów procesów losowych.

W symulacjach Monte Carlo zmienne wejściowe, często traktowane jako zmienne losowe, to zmienne niezależne wpływające na zachowanie systemu. Zmienne wyjściowe to wyniki symulacji, reprezentujące potencjalne rezultaty na podstawie wejść. Zmienne te mogą być ciągłe lub dyskretne i są niezbędne do określenia zakresu oraz ograniczeń modelu. Często przeprowadza się analizę wrażliwości, aby określić wpływ poszczególnych zmiennych wejściowych na wyniki, co pomaga w udoskonaleniu i walidacji modelu.

Odchylenie standardowe i wariancja to kluczowe miary statystyczne pozwalające zrozumieć rozrzut i wiarygodność wyników symulacji. Odchylenie standardowe informuje o zmienności względem średniej, a wariancja mierzy stopień rozproszenia danych. Te wskaźniki są niezwykle ważne przy interpretacji wyników symulacji, szczególnie podczas oceny ryzyka i niepewności związanych z różnymi scenariuszami.

Symulacje Monte Carlo przebiegają według uporządkowanej metodologii:

Zaawansowane symulacje Monte Carlo mogą wykorzystywać techniki takie jak Markov Chain Monte Carlo (MCMC), które są szczególnie przydatne do próbkowania złożonych rozkładów prawdopodobieństwa. Metody MCMC znajdują zastosowanie w statystyce bayesowskiej i uczeniu maszynowym, gdzie pomagają w aproksymacji rozkładu a posteriori parametrów modeli.

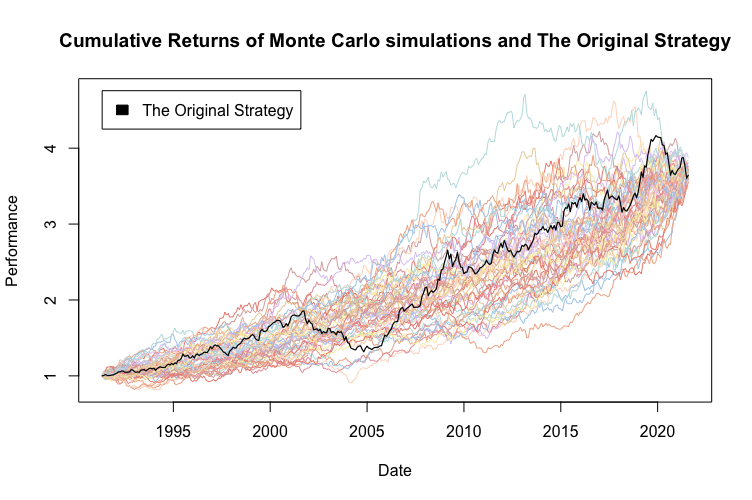

Symulacje Monte Carlo są nieocenione w modelowaniu finansowym — służą do szacowania prawdopodobieństwa zwrotów z inwestycji, oceny ryzyka portfela i wyceny instrumentów pochodnych. Symulując tysiące scenariuszy rynkowych, analitycy finansowi mogą przewidzieć potencjalne zyski lub straty oraz opracować strategie minimalizowania ryzyka. Metoda ta jest kluczowa do testowania odporności modeli finansowych i oceny wpływu zmienności rynku na portfele inwestycyjne.

W inżynierii metody Monte Carlo służą do symulacji niezawodności i wydajności systemów w różnych warunkach. Na przykład mogą przewidywać wskaźniki awaryjności komponentów w systemach mechanicznych, zapewniając spełnienie norm bezpieczeństwa i trwałości produktów. Symulacje te wykorzystuje się również w kontroli jakości i optymalizacji procesów, pomagając identyfikować potencjalne defekty oraz nieefektywności.

W AI metody Monte Carlo usprawniają algorytmy decyzyjne, zwłaszcza w środowiskach o wysokiej niepewności. Pomagają systemom AI ocenić potencjalne konsekwencje różnych działań, zwiększając ich zdolność do przewidywania i adaptacji. Monte Carlo Tree Search (MCTS) to znane zastosowanie w grach i zadaniach decyzyjnych, gdzie umożliwia AI podejmowanie świadomych decyzji nawet przy niepełnych danych.

Kierownicy projektów wykorzystują symulacje Monte Carlo do prognozowania harmonogramów i budżetów, uwzględniając niepewności takie jak opóźnienia czy przekroczenia kosztów. Podejście to wspomaga planowanie i alokację zasobów poprzez probabilistyczne szacunki czasu realizacji. Metody Monte Carlo są szczególnie przydatne w zarządzaniu ryzykiem, gdzie pomagają identyfikować i kwantyfikować potencjalne zagrożenia dla celów projektu.

Naukowcy środowiskowi stosują symulacje Monte Carlo do modelowania złożonych ekosystemów i przewidywania wpływu zmian zmiennych środowiskowych. Jest to kluczowe dla oceny ryzyka i opracowywania skutecznych strategii ochrony. Metody Monte Carlo znajdują zastosowanie w modelowaniu klimatu, ocenie bioróżnorodności i analizach oddziaływania na środowisko, dostarczając wglądu w potencjalne skutki działalności człowieka na ekosystemy naturalne.

Mimo licznych zalet metody Monte Carlo wiążą się też z pewnymi wyzwaniami:

W dziedzinie sztucznej inteligencji metody Monte Carlo są niezbędne do budowy systemów potrafiących wnioskować w warunkach niepewności. Uzupełniają uczenie maszynowe, dostarczając probabilistycznych ram zwiększających odporność i elastyczność modeli AI.

Na przykład, Monte Carlo Tree Search (MCTS) to popularny algorytm AI, zwłaszcza w grach i zadaniach decyzyjnych. MCTS wykorzystuje losowe próbkowanie do oceny potencjalnych ruchów w grze, umożliwiając AI podejmowanie świadomych decyzji nawet przy niepełnych informacjach. Technika ta odegrała kluczową rolę w rozwoju systemów AI potrafiących grać w złożone gry, takie jak Go czy szachy.

Ponadto integracja symulacji Monte Carlo z technologiami AI, takimi jak deep learning i uczenie przez wzmacnianie, otwiera nowe możliwości budowy inteligentnych systemów potrafiących interpretować ogromne ilości danych, rozpoznawać wzorce i przewidywać trendy z większą dokładnością. Te synergie zwiększają zdolność modeli AI do uczenia się na niepewnych danych i usprawniają procesy decyzyjne w dynamicznych środowiskach.

Metody Monte Carlo to potężny zestaw algorytmów obliczeniowych służących do symulacji i analizy złożonych systemów. Opierają się na powtarzalnym losowym próbkowaniu w celu uzyskania wyników numerycznych i są szeroko wykorzystywane w takich dziedzinach jak fizyka, finanse oraz inżynieria. Poniżej przedstawiamy wybrane ważne publikacje naukowe dotyczące różnych aspektów metod Monte Carlo:

Fast Orthogonal Transforms for Multi-level Quasi-Monte Carlo Integration

Autorzy: Christian Irrgeher, Gunther Leobacher

Artykuł opisuje metodę łączącą szybkie transformaty ortogonalne z integracją quasi-Monte Carlo, poprawiając wydajność tej drugiej. Autorzy pokazują, że takie połączenie znacząco usprawnia wydajność obliczeniową wielopoziomowych metod Monte Carlo. Praca zawiera przykłady potwierdzające tę poprawę i stanowi cenny wkład w matematykę obliczeniową. Czytaj więcej

The Derivation of Particle Monte Carlo Methods for Plasma Modeling from Transport Equations

Autor: Savino Longo

Badanie to przedstawia szczegółową analizę wyprowadzenia metod Particle i Monte Carlo z równań transportu, zwłaszcza dla symulacji plazmy. Omawia techniki takie jak Particle in Cell (PIC) i Monte Carlo (MC), oferując wgląd w matematyczne podstawy tych metod symulacyjnych. Praca jest kluczowa dla zrozumienia zastosowań metod Monte Carlo w fizyce plazmy. Czytaj więcej

Projected Multilevel Monte Carlo Method for PDE with Random Input Data

Autorzy: Myoungnyoun Kim, Imbo Sim

Autorzy przedstawiają projektowaną wielopoziomową metodę Monte Carlo mającą na celu zmniejszenie złożoności obliczeniowej przy zachowaniu tempa zbieżności błędu. Badanie pokazuje, że wielopoziomowe metody Monte Carlo mogą osiągnąć pożądaną dokładność przy mniejszym nakładzie czasu obliczeniowego w porównaniu do tradycyjnych metod Monte Carlo. Praca zawiera eksperymenty numeryczne potwierdzające teoretyczne założenia. Czytaj więcej

Inference with Hamiltonian Sequential Monte Carlo Simulators

Autor: Remi Daviet

Artykuł proponuje nowy symulator Monte Carlo łączący zalety Sequential Monte Carlo oraz Hamiltonian Monte Carlo. Jest szczególnie skuteczny w wnioskowaniu w złożonych i wielomodalnych przypadkach. Praca zawiera liczne przykłady, które pokazują odporność metody na trudne funkcje wiarygodności i funkcje celu. Czytaj więcej

Antithetic Riemannian Manifold and Quantum-Inspired Hamiltonian Monte Carlo

Autorzy: Wilson Tsakane Mongwe, Rendani Mbuvha, Tshilidzi Marwala

Praca prezentuje nowe algorytmy usprawniające metody Hamiltonian Monte Carlo dzięki zastosowaniu próbkowania antytetycznego i technik inspirowanych kwantowo. Innowacje te poprawiają tempo próbkowania i obniżają wariancję estymacji. Badania te wykorzystano na danych rynków finansowych i w regresji logistycznej bayesowskiej, wykazując znaczącą poprawę efektywności próbkowania. Czytaj więcej

Metody Monte Carlo to klasa algorytmów obliczeniowych wykorzystujących powtarzalne losowe próbkowanie w celu uzyskania numerycznych rozwiązań złożonych problemów, często związanych z niepewnością i modelowaniem probabilistycznym.

Są szeroko wykorzystywane w finansach do analizy ryzyka i optymalizacji portfela, w inżynierii do oceny niezawodności i kontroli jakości, w AI do podejmowania decyzji w warunkach niepewności oraz w zarządzaniu projektami i naukach środowiskowych do prognozowania i oceny ryzyka.

Główną zaletą jest zdolność do modelowania niepewności i symulowania szerokiego zakresu możliwych wyników, co zapewnia cenne wskazówki przy podejmowaniu decyzji w złożonych systemach.

Metody Monte Carlo mogą być obciążające obliczeniowo, wymagają wysokiej jakości generatorów liczb losowych i mogą napotykać problemy takie jak klątwa wymiarowości wraz ze wzrostem złożoności modelu.

Odkryj, jak metody Monte Carlo i narzędzia oparte na AI mogą usprawnić podejmowanie decyzji, analizę ryzyka i złożone symulacje w Twojej firmie lub badaniach.

Regresja lasów losowych to potężny algorytm uczenia maszynowego wykorzystywany w analizie predykcyjnej. Buduje wiele drzew decyzyjnych i uśrednia ich wyniki, co...

Boosting to technika uczenia maszynowego, która łączy predykcje wielu słabych uczących się w celu stworzenia silnego modelu, zwiększając dokładność i umożliwiaj...

Dostrajanie modelu dostosowuje wstępnie wytrenowane modele do nowych zadań poprzez drobne korekty, zmniejszając zapotrzebowanie na dane i zasoby. Dowiedz się, j...