Metaprompt

Metaprompt w sztucznej inteligencji to instrukcja wysokiego poziomu zaprojektowana do generowania lub ulepszania innych promptów dla dużych modeli językowych (L...

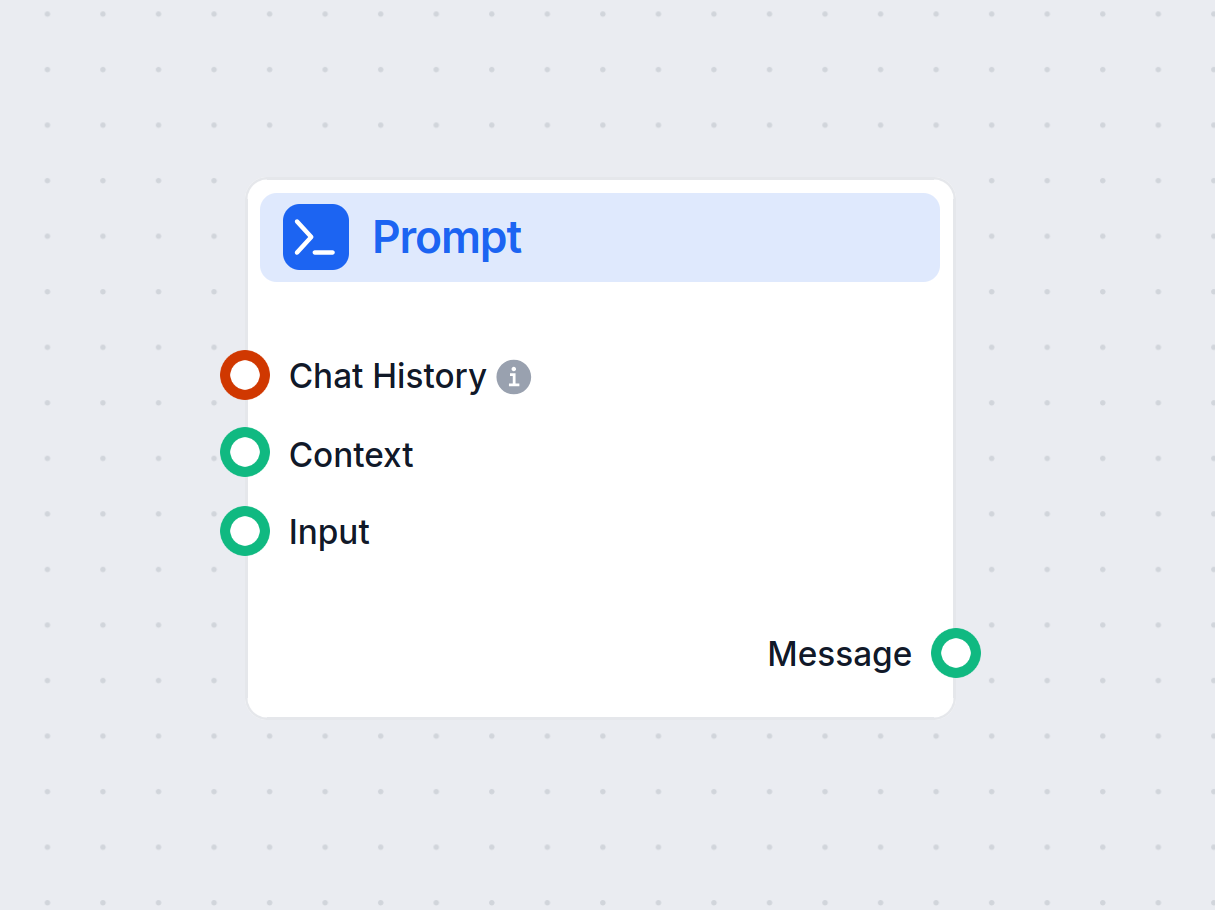

Prompt to tekst wejściowy, który określa, jak LLM odpowiada. Jasność, precyzja i techniki takie jak few-shot czy chain-of-thought poprawiają jakość generowanej odpowiedzi AI.

Prompty odgrywają kluczową rolę w funkcjonowaniu dużych modeli językowych (LLM). Stanowią główny mechanizm, dzięki któremu użytkownicy komunikują się z tymi modelami. Odpowiednie sformułowanie zapytania lub polecenia znacząco wpływa na jakość i trafność odpowiedzi generowanych przez LLM. Dobre prompty są niezbędne, aby w pełni wykorzystać potencjał LLM — czy to w zastosowaniach biznesowych, tworzeniu treści, czy badaniach naukowych.

Prompty są wykorzystywane na różne sposoby, by ukierunkować odpowiedź LLM. Oto najczęstsze podejścia:

Tworzenie skutecznych promptów wymaga jasności i precyzji. Oto wskazówki:

Badania pokazują, że podanie przykładów (few-shot prompting) lub włączenie szczegółowych kroków rozumowania (chain-of-thought prompting) znacząco poprawia skuteczność modelu. Na przykład:

Strukturyzowanie promptu w przemyślany sposób może pomóc LLM generować trafniejsze i dokładniejsze odpowiedzi. Na przykład, jeśli zadaniem jest obsługa klienta, można rozpocząć od komunikatu systemowego: „Jesteś przyjaznym agentem AI, który może pomóc klientowi w sprawie ostatniego zamówienia.”

Prompt to tekst wejściowy przekazywany dużemu modelowi językowemu (LLM), który kieruje jego odpowiedzią. Może to być pytanie, polecenie lub kontekst pomagający modelowi wygenerować trafną odpowiedź.

Zero-shot prompting polega na zadaniu modelowi zadania bez przykładów. One-shot daje jeden przykład, a few-shot dostarcza kilka przykładów, by ukierunkować odpowiedź LLM.

Używaj jasnego i precyzyjnego języka, zapewnij odpowiedni kontekst i formułuj instrukcje pozytywnie. Dodanie przykładów lub rozumowania krok po kroku może poprawić jakość odpowiedzi.

Chain-of-thought prompting polega na uwzględnieniu w promptcie szczegółowych kroków rozumowania, aby poprowadzić LLM do przemyślanych i trafnych odpowiedzi.

Inteligentne chatboty i narzędzia AI w jednym miejscu. Połącz intuicyjne bloki, aby zamienić pomysły w zautomatyzowane Flows.

Metaprompt w sztucznej inteligencji to instrukcja wysokiego poziomu zaprojektowana do generowania lub ulepszania innych promptów dla dużych modeli językowych (L...

Dowiedz się, jak FlowHunt wykorzystał one-shot prompting do nauczenia LLM-ów wyszukiwania i osadzania odpowiednich filmów z YouTube w WordPressie. Ta technika z...

Dowiedz się, jak komponent Prompt w FlowHunt pozwala definiować rolę i zachowanie Twojego bota AI, zapewniając trafne i spersonalizowane odpowiedzi. Dostosuj pr...