Wektor osadzenia

Wektor osadzenia to gęsta, numeryczna reprezentacja danych w przestrzeni wielowymiarowej, odzwierciedlająca relacje semantyczne i kontekstowe. Dowiedz się, jak ...

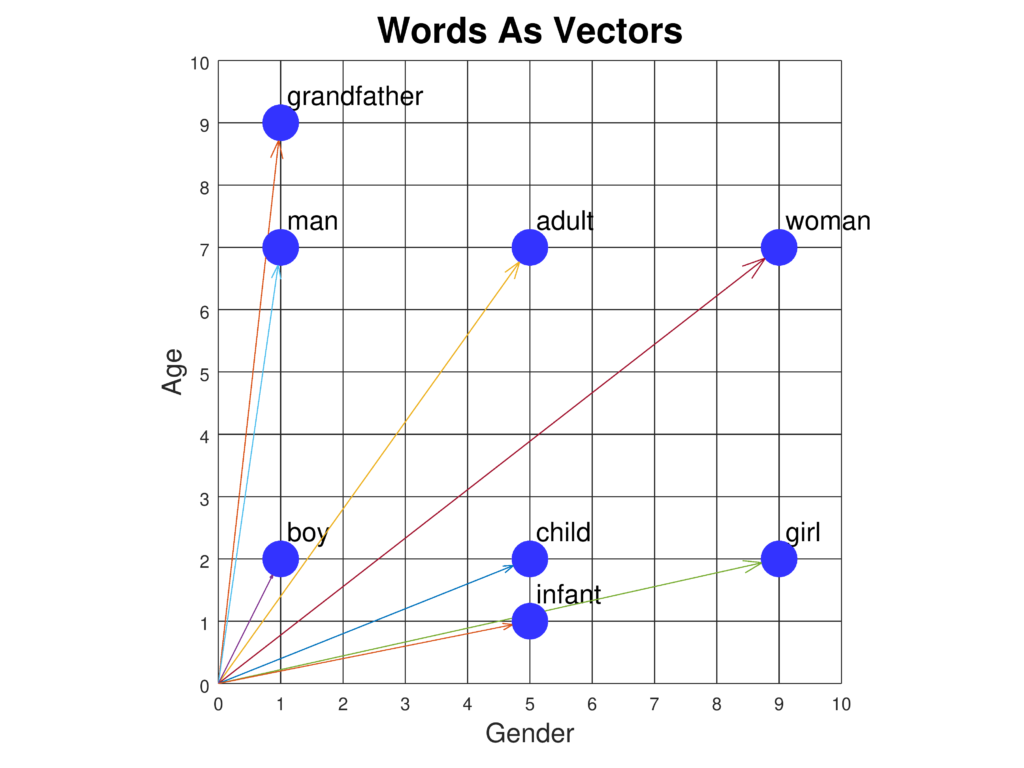

Osadzenia wyrazów odwzorowują słowa na wektory w ciągłej przestrzeni, uchwytując ich znaczenie i kontekst dla lepszych zastosowań NLP.

Osadzenia wyrazów odgrywają kluczową rolę w NLP, stanowiąc pomost między interakcją człowieka z komputerem. Poznaj ich kluczowe aspekty, działanie i zastosowania już dziś!

Badania nad osadzeniami wyrazów w NLP

Learning Word Sense Embeddings from Word Sense Definitions

Qi Li, Tianshi Li, Baobao Chang (2016) proponują metodę radzenia sobie z wyzwaniem polisemi i homonimii w osadzeniach wyrazów poprzez tworzenie jednego osadzenia dla każdego znaczenia słowa na podstawie jego definicji. Ich podejście wykorzystuje trening korpusowy do osiągnięcia wysokiej jakości osadzeń znaczeń słów. Wyniki eksperymentów wykazują poprawę w zadaniach mierzących podobieństwo słów i rozróżnianie znaczeń. Badanie pokazuje potencjał osadzeń znaczeń słów w usprawnianiu zastosowań NLP. Czytaj więcej

Neural-based Noise Filtering from Word Embeddings

Kim Anh Nguyen, Sabine Schulte im Walde, Ngoc Thang Vu (2016) przedstawiają dwa modele poprawiające osadzenia wyrazów poprzez filtrację szumu. Identyfikują niepotrzebne informacje zawarte w tradycyjnych osadzeniach i proponują techniki uczenia nienadzorowanego do tworzenia osadzeń odszumiających. Modele te wykorzystują głęboką sieć neuronową do wzmacniania istotnych informacji przy jednoczesnej minimalizacji szumu. Wyniki wskazują na lepszą skuteczność osadzeń odszumiających w zadaniach referencyjnych. Czytaj więcej

A Survey On Neural Word Embeddings

Erhan Sezerer, Selma Tekir (2021) przedstawiają kompleksowy przegląd osadzeń neuronowych wyrazów, śledząc ich ewolucję i wpływ na NLP. Przegląd obejmuje teorie podstawowe oraz analizuje różne typy osadzeń, takie jak osadzenia znaczeń, morfemów czy kontekstowe. Artykuł omawia również referencyjne zbiory danych i oceny skuteczności, podkreślając przełomowy wpływ osadzeń neuronowych na zadania NLP. Czytaj więcej

Improving Interpretability via Explicit Word Interaction Graph Layer

Arshdeep Sekhon, Hanjie Chen, Aman Shrivastava, Zhe Wang, Yangfeng Ji, Yanjun Qi (2023) skupiają się na zwiększeniu interpretowalności modeli NLP poprzez WIGRAPH – warstwę sieci neuronowej budującą globalny graf interakcji między słowami. Warstwa ta może być zintegrowana z dowolnym klasyfikatorem tekstu NLP, poprawiając zarówno interpretowalność, jak i skuteczność predykcji. Badanie podkreśla znaczenie interakcji słów dla zrozumienia decyzji modelu. Czytaj więcej

Word Embeddings for Banking Industry

Avnish Patel (2023) bada zastosowanie osadzeń wyrazów w sektorze bankowym, podkreślając ich rolę w takich zadaniach jak analiza sentymentu czy klasyfikacja tekstu. Badanie analizuje wykorzystanie zarówno statycznych osadzeń (np. Word2Vec, GloVe), jak i modeli kontekstowych, podkreślając ich wpływ na zadania NLP specyficzne dla branży. Czytaj więcej

Osadzenia wyrazów to gęste reprezentacje wektorowe słów, mapujące semantycznie podobne słowa do bliskich punktów w ciągłej przestrzeni, co umożliwia modelom rozumienie kontekstu i relacji językowych.

Usprawniają zadania NLP poprzez uchwycenie relacji semantycznych i składniowych, redukcję wymiarowości, umożliwiają transfer learning oraz poprawiają obsługę rzadkich słów.

Popularne techniki to Word2Vec, GloVe, FastText i TF-IDF. Modele neuronowe, takie jak Word2Vec i GloVe, uczą się osadzeń z dużych korpusów tekstowych, a FastText uwzględnia informację o subwyrazach.

Klasyczne osadzenia mają trudności z polisemią (słowa o wielu znaczeniach), mogą utrwalać uprzedzenia z danych oraz wymagają znacznych zasobów obliczeniowych do trenowania na dużych korpusach.

Wykorzystuje się je w klasyfikacji tekstu, tłumaczeniu maszynowym, rozpoznawaniu nazwanych jednostek, wyszukiwaniu informacji i systemach odpowiadania na pytania w celu poprawy dokładności i zrozumienia kontekstu.

Zacznij budować zaawansowane rozwiązania AI z intuicyjnymi narzędziami do NLP, w tym osadzeniami wyrazów i nie tylko.

Wektor osadzenia to gęsta, numeryczna reprezentacja danych w przestrzeni wielowymiarowej, odzwierciedlająca relacje semantyczne i kontekstowe. Dowiedz się, jak ...

Przetwarzanie Języka Naturalnego (NLP) to poddziedzina sztucznej inteligencji (AI), która umożliwia komputerom rozumienie, interpretację i generowanie języka lu...

Okienkowanie w sztucznej inteligencji odnosi się do przetwarzania danych w segmentach, czyli „okienkach”, aby efektywnie analizować informacje sekwencyjne. Niez...