AI Red Teaming vs Tradycyjne Testy Penetracyjne: Kluczowe Różnice

AI red teaming i tradycyjne testy penetracyjne odnoszą się do różnych aspektów bezpieczeństwa AI. Ten przewodnik wyjaśnia kluczowe różnice, kiedy stosować każde...

AI red teaming to ustrukturyzowane ćwiczenie bezpieczeństwa oparte na podejściu adwersaryjnym, w którym specjaliści systematycznie badają systemy AI — chatboty LLM, agenty i potoki przetwarzania — używając realistycznych technik ataku w celu identyfikacji podatności zanim zrobią to złośliwi aktorzy.

AI red teaming stosuje militarną koncepcję ćwiczeń adwersaryjnych „czerwony zespół kontra niebieski zespół" do oceny bezpieczeństwa systemów sztucznej inteligencji. Czerwony zespół specjalistów przyjmuje sposób myślenia i techniki atakujących, badając system AI w celu znalezienia podatności możliwych do wykorzystania, naruszeń polityki i trybów awarii.

Termin „red teaming" pochodzi ze strategii wojskowej — oznaczając grupę, której zadaniem jest kwestionowanie założeń i symulowanie zachowań przeciwnika. W cyberbezpieczeństwie czerwone zespoły przeprowadzają testy adwersaryjne systemów i organizacji. AI red teaming rozszerza tę praktykę na unikalne cechy systemów opartych na LLM.

Po głośnych incydentach związanych z manipulacją chatbotami, jailbreakingiem i eksfiltracji danych, organizacje takie jak Microsoft, Google, OpenAI i rząd USA zainwestowały znacznie w AI red teaming jako praktykę bezpieczeństwa i ochrony.

Chociaż są ze sobą powiązane, AI red teaming i tradycyjne testy penetracyjne odnoszą się do różnych modeli zagrożeń:

| Aspekt | AI Red Teaming | Tradycyjne testy penetracyjne |

|---|---|---|

| Główny interfejs | Język naturalny | Protokoły sieciowe/aplikacyjne |

| Wektory ataku | Wstrzykiwanie promptów, jailbreaking, manipulacja modelem | SQL injection, XSS, omijanie uwierzytelniania |

| Tryby awarii | Naruszenia polityki, halucynacje, dryfowanie behawioralne | Uszkodzenie pamięci, eskalacja uprawnień |

| Narzędzia | Niestandardowe prompty, zestawy danych adwersaryjnych | Narzędzia skanujące, frameworki exploitów |

| Wymagana ekspertyza | Architektura LLM + bezpieczeństwo | Bezpieczeństwo sieciowe/webowe |

| Rezultaty | Ustalenia behawioralne + podatności techniczne | Podatności techniczne |

Większość wdrożeń AI w przedsiębiorstwach korzysta z obu: tradycyjnych testów penetracyjnych dla infrastruktury i bezpieczeństwa API, AI red teaming dla podatności specyficznych dla LLM.

Systematyczny red teaming wykorzystuje wyselekcjonowane biblioteki ataków dostosowane do frameworków takich jak OWASP LLM Top 10 lub MITRE ATLAS. Każda kategoria jest testowana wyczerpująco, zapewniając, że pokrycie nie zależy od indywidualnej kreatywności.

Skuteczny red teaming to nie jedno przejście. Udane ataki są udoskonalane i eskalowane, aby sprawdzić, czy środki zaradcze są skuteczne. Nieudane ataki są analizowane, aby zrozumieć, jakie zabezpieczenia im zapobiegły.

Zautomatyzowane narzędzia mogą testować tysiące wariantów promptów na dużą skalę. Ale najbardziej wyrafinowane ataki — wieloturowa manipulacja, inżynieria społeczna specyficzna dla kontekstu, nowatorskie kombinacje technik — wymagają ludzkiego osądu i kreatywności.

Ćwiczenia red teamingu powinny opierać się na realistycznym modelowaniu zagrożeń: kim są prawdopodobni atakujący (ciekawi użytkownicy, konkurenci, złośliwi insiderzy), jakie są ich motywacje i jak wyglądałby udany atak z perspektywy wpływu na biznes?

Dla organizacji wdrażających AI na dużą skalę, ciągły program red teamingu obejmuje:

AI red teaming to ćwiczenie bezpieczeństwa oparte na podejściu adwersaryjnym, w którym specjaliści wcielają się w rolę atakujących i systematycznie badają system AI pod kątem podatności, naruszeń polityki i trybów awarii. Celem jest identyfikacja słabości zanim zrobią to prawdziwi atakujący — a następnie ich naprawa.

Tradycyjne testy penetracyjne koncentrują się na technicznych podatnościach w oprogramowaniu i infrastrukturze. AI red teaming dodaje wektory ataku w języku naturalnym — wstrzykiwanie promptów, jailbreaking, inżynierię społeczną modelu — i zajmuje się trybami awarii specyficznymi dla AI, takimi jak halucynacje, nadmierne poleganie i omijanie polityki. Obie dyscypliny są komplementarne.

AI red teaming jest najbardziej skuteczny, gdy przeprowadzają go specjaliści, którzy rozumieją zarówno architekturę AI/LLM, jak i techniki bezpieczeństwa ofensywnego. Zespoły wewnętrzne mają cenny kontekst, ale mogą mieć martwe punkty; zewnętrzne zespoły red team wnoszą świeże perspektywy i aktualną wiedzę o atakach.

Nasze ćwiczenia AI red team wykorzystują aktualne techniki ataku, aby znaleźć podatności w twoim chatbocie zanim zrobią to atakujący — i dostarczamy jasną mapę drogową naprawczą.

AI red teaming i tradycyjne testy penetracyjne odnoszą się do różnych aspektów bezpieczeństwa AI. Ten przewodnik wyjaśnia kluczowe różnice, kiedy stosować każde...

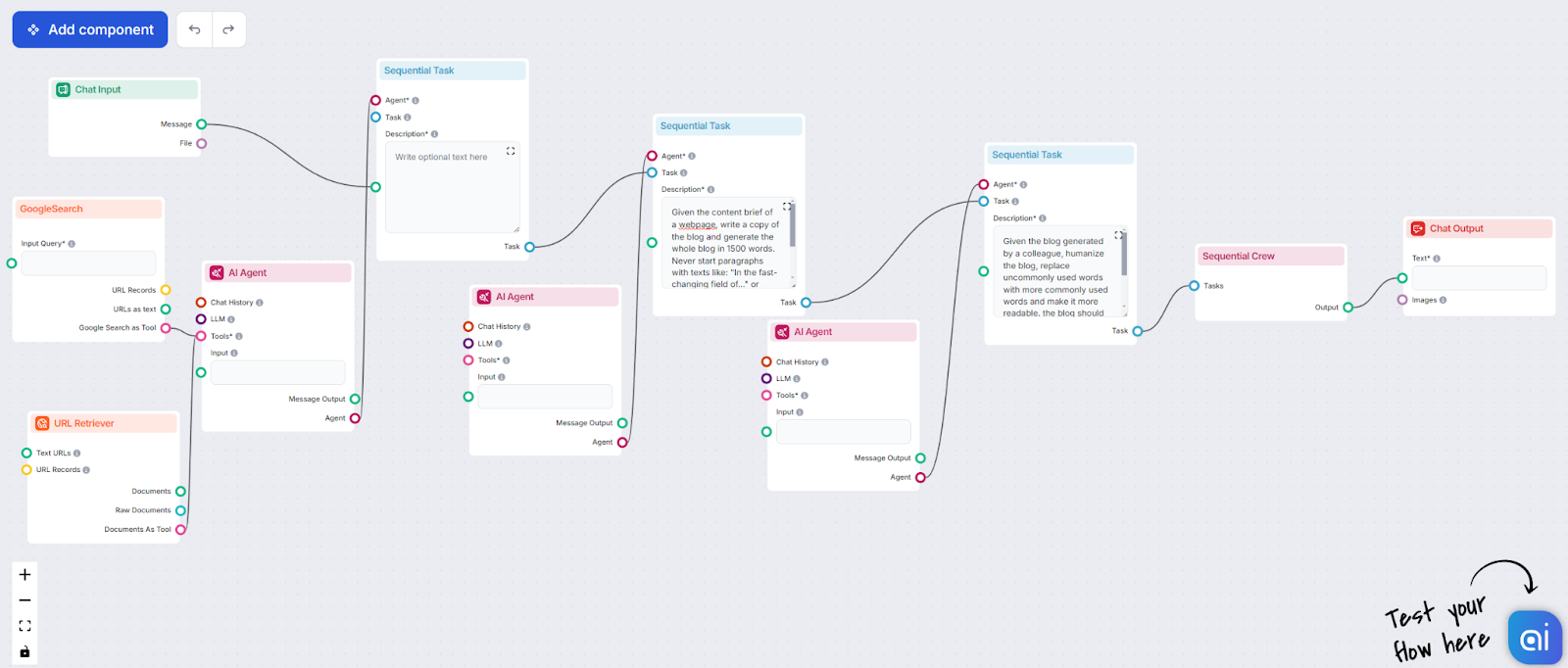

Pozwól całym zespołom współpracujących agentów AI realizować złożone zadania. Dowiedz się więcej o tworzeniu załóg agentów przy użyciu komponentu Załoga Sekwenc...

Bagging, czyli Bootstrap Aggregating, to podstawowa technika uczenia zespołowego w AI i uczeniu maszynowym, która zwiększa dokładność i odporność modeli poprzez...