mcp-local-rag MCP Server

Serwer mcp-local-rag MCP umożliwia lokalne, dbające o prywatność wyszukiwanie internetowe Retrieval-Augmented Generation (RAG) dla LLM-ów. Pozwala asystentom AI...

Serwer mcp-local-rag MCP umożliwia lokalne, dbające o prywatność wyszukiwanie internetowe Retrieval-Augmented Generation (RAG) dla LLM-ów. Pozwala asystentom AI...

Context Portal (ConPort) to serwer MCP typu memory bank, który wspiera asystentów AI oraz narzędzia deweloperskie przez zarządzanie ustrukturyzowanym kontekstem...

Integruj FlowHunt z bazami danych wektorowych Pinecone za pomocą serwera Pinecone MCP. Umożliwiaj wyszukiwanie semantyczne, Retrieval-Augmented Generation (RAG)...

Serwer RAG Web Browser MCP wyposaża asystentów AI i modele językowe LLM w możliwości wyszukiwania na żywo w internecie oraz ekstrakcji treści, umożliwiając retr...

Agentset MCP Server to otwartoźródłowa platforma umożliwiająca Retrieval-Augmented Generation (RAG) z funkcjami agentowymi, pozwalająca asystentom AI na łączeni...

Serwer Inkeep MCP łączy asystentów AI oraz narzędzia deweloperskie z aktualną dokumentacją produktów zarządzaną w Inkeep, umożliwiając bezpośrednie, bezpieczne ...

Serwer mcp-rag-local MCP umożliwia asystentom AI korzystanie z pamięci semantycznej, pozwalając na zapisywanie i wyszukiwanie fragmentów tekstu na podstawie zna...

Vectara MCP Server to otwartoźródłowy most łączący asystentów AI z platformą Trusted RAG firmy Vectara, umożliwiający bezpieczne i wydajne Retrieval-Augmented G...

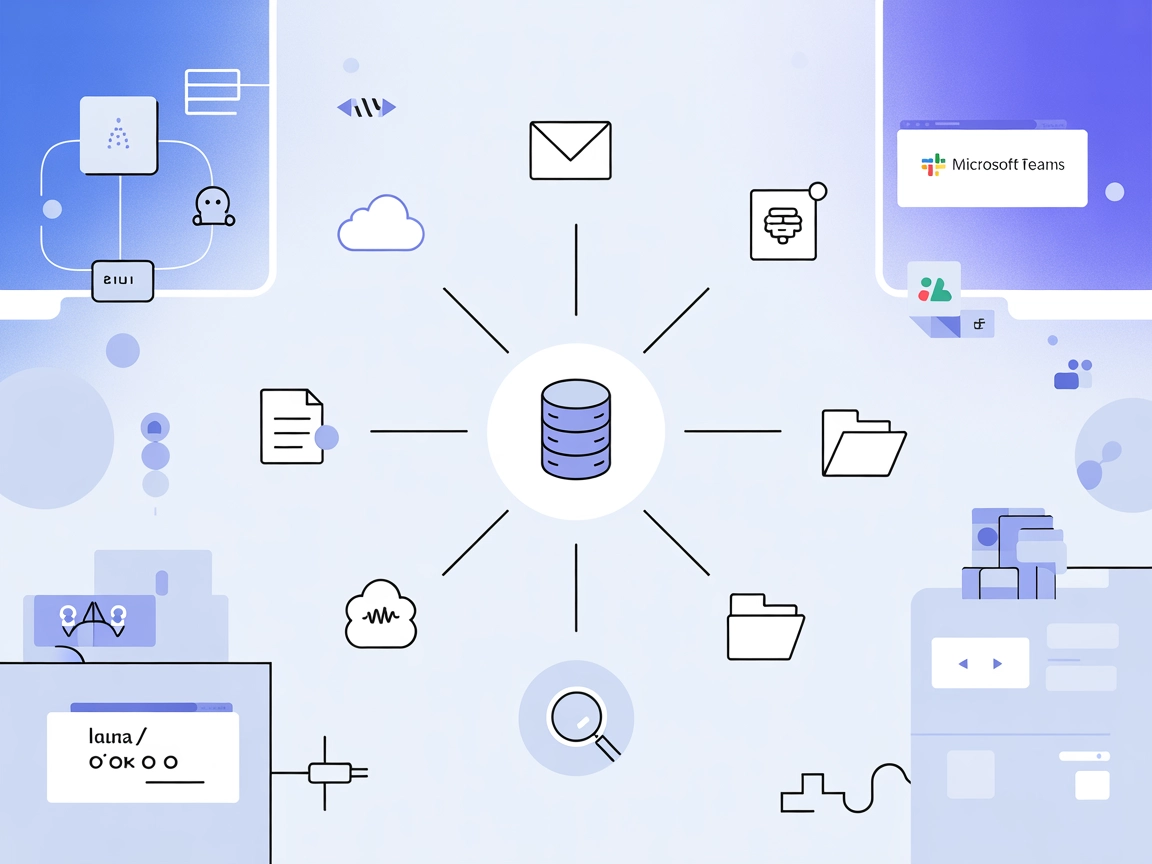

Serwer Graphlit MCP łączy FlowHunt i inne klientów MCP z zunifikowaną platformą wiedzy, umożliwiając płynne pobieranie, agregację i wyszukiwanie dokumentów, wia...

Cache Augmented Generation (CAG) to nowatorskie podejście do zwiększania możliwości dużych modeli językowych (LLM) poprzez wcześniejsze załadowanie wiedzy w pos...

Poznaj kluczowe różnice między generowaniem wspomaganym wyszukiwaniem (RAG) a generowaniem wspomaganym pamięcią podręczną (CAG) w AI. Dowiedz się, jak RAG dynam...

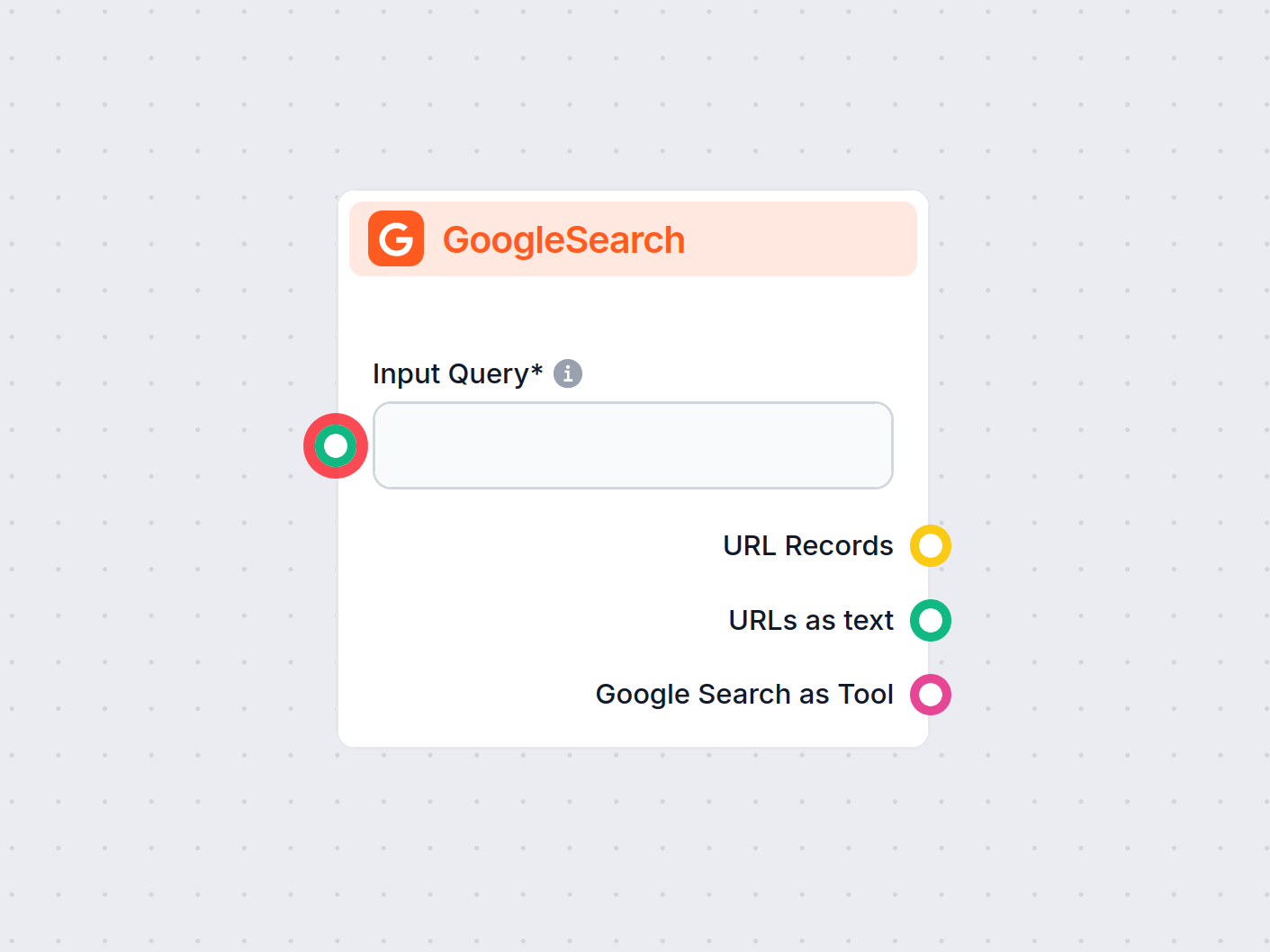

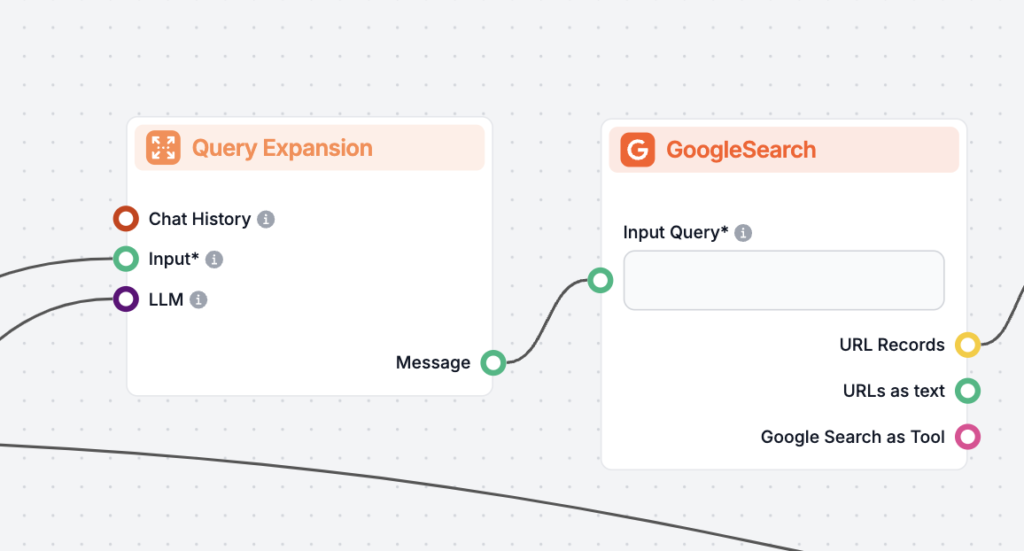

Komponent GoogleSearch platformy FlowHunt zwiększa dokładność chatbotów, wykorzystując Retrieval-Augmented Generation (RAG) do pozyskiwania najnowszej wiedzy z ...

LazyGraphRAG to innowacyjne podejście do Retrieval-Augmented Generation (RAG), optymalizujące wydajność i obniżające koszty pozyskiwania danych przez AI dzięki ...

Ocenianie dokumentów w Retrieval-Augmented Generation (RAG) to proces oceny i klasyfikowania dokumentów na podstawie ich trafności i jakości w odpowiedzi na zap...

Odpowiadanie na pytania z wykorzystaniem Retrieval-Augmented Generation (RAG) łączy wyszukiwanie informacji oraz generowanie języka naturalnego, aby ulepszyć du...

Dowiedz się, czym jest pipeline wyszukiwania informacji dla chatbotów, jakie są jego komponenty, zastosowania oraz jak Retrieval-Augmented Generation (RAG) i ze...

Przerejestrowanie dokumentów to proces zmiany kolejności pobranych dokumentów na podstawie ich trafności względem zapytania użytkownika, co pozwala na doprecyzo...

Poznaj, jak zaawansowane możliwości rozumowania i uczenie przez wzmacnianie w OpenAI O1 przewyższają GPT4o pod kątem dokładności RAG, poparte benchmarkami i ana...

Retrieval Augmented Generation (RAG) to zaawansowane ramy AI, które łączą tradycyjne systemy wyszukiwania informacji z generatywnymi dużymi modelami językowymi ...

Rozszerzanie zapytań to proces ulepszania pierwotnego zapytania użytkownika przez dodanie terminów lub kontekstu, co poprawia wyszukiwanie dokumentów i pozwala ...

Zwiększ dokładność AI dzięki RIG! Dowiedz się, jak tworzyć chatboty, które weryfikują odpowiedzi zarówno na podstawie własnych, jak i ogólnych źródeł danych, za...

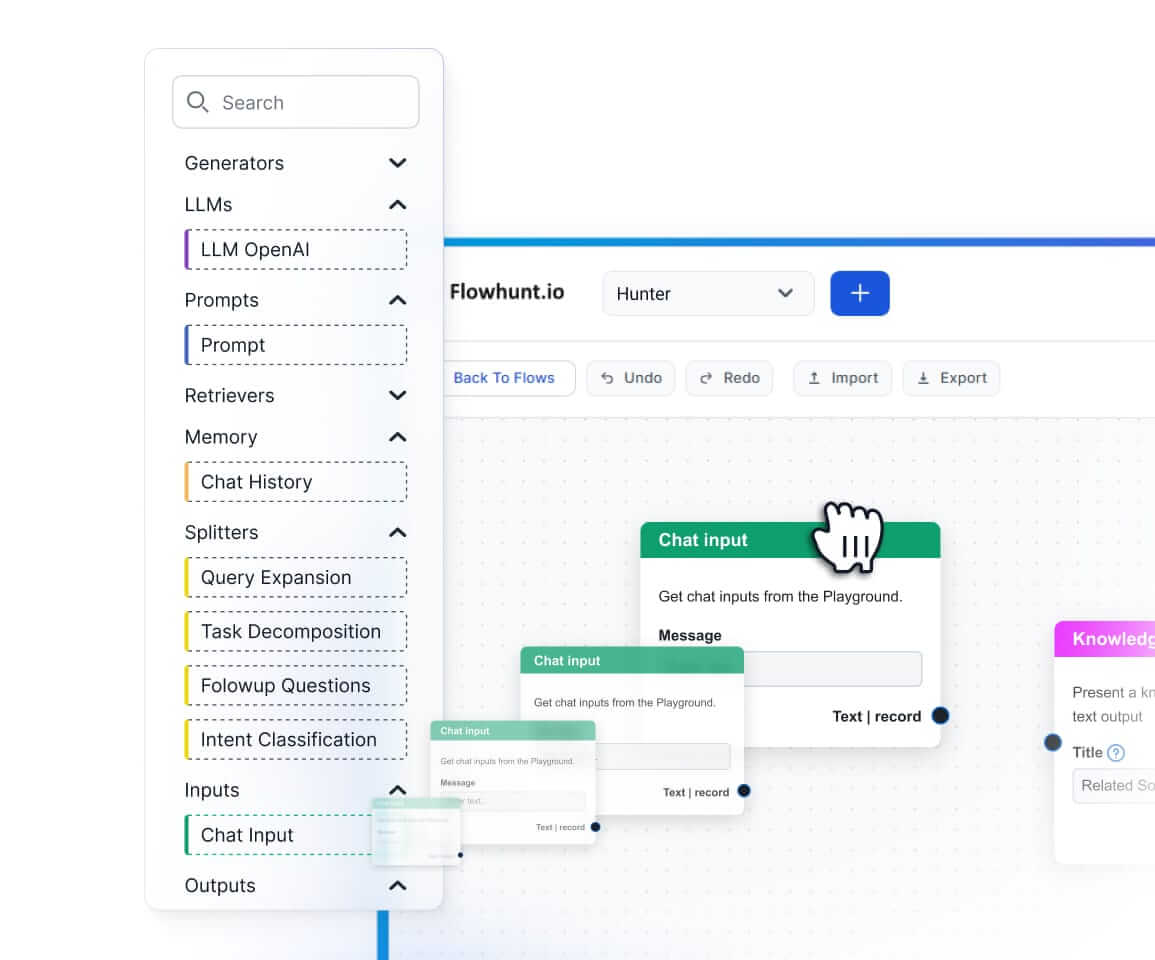

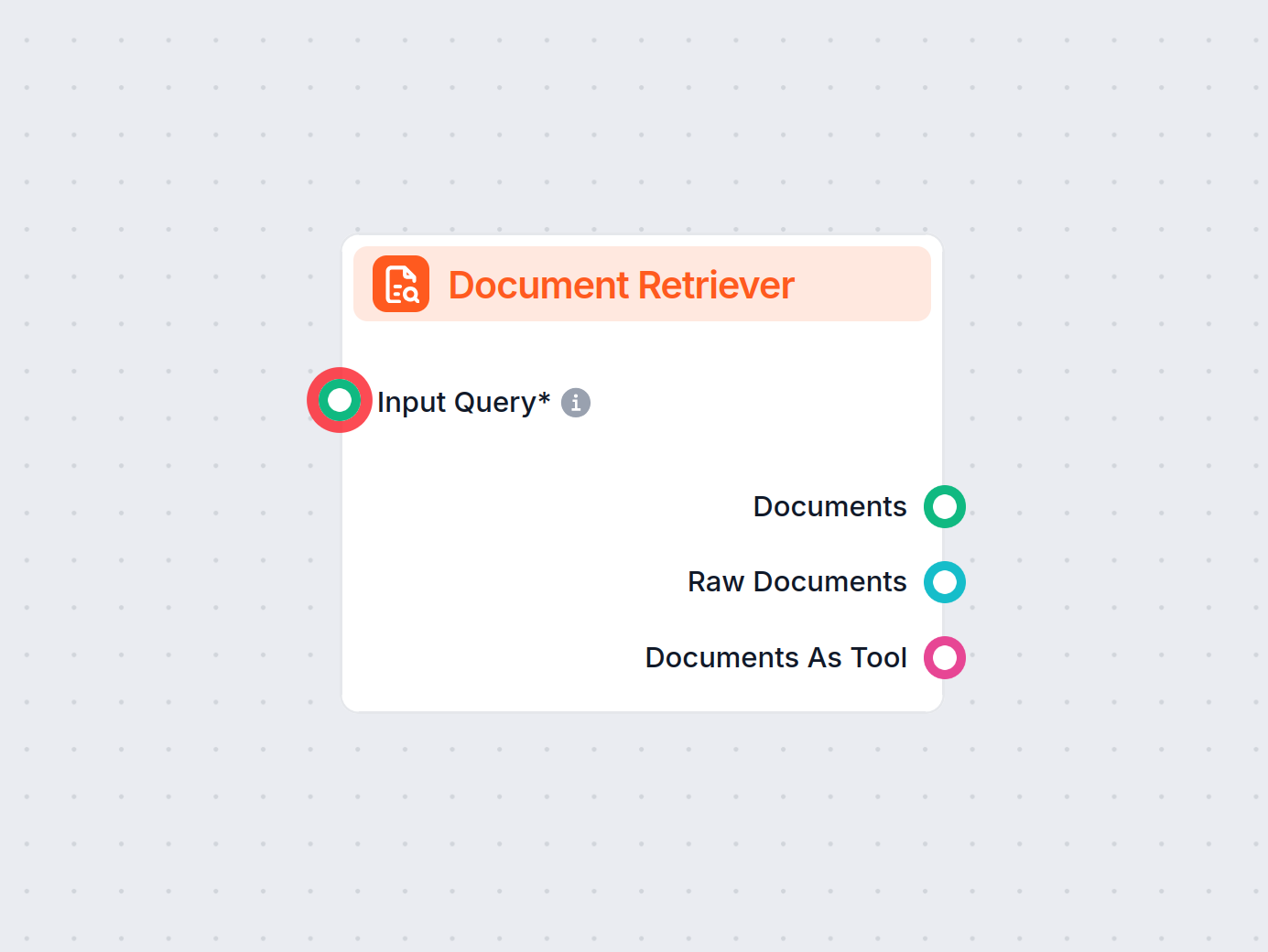

Wyszukiwarka Dokumentów FlowHunt zwiększa dokładność AI, łącząc modele generatywne z Twoimi aktualnymi dokumentami i adresami URL, zapewniając wiarygodne i traf...

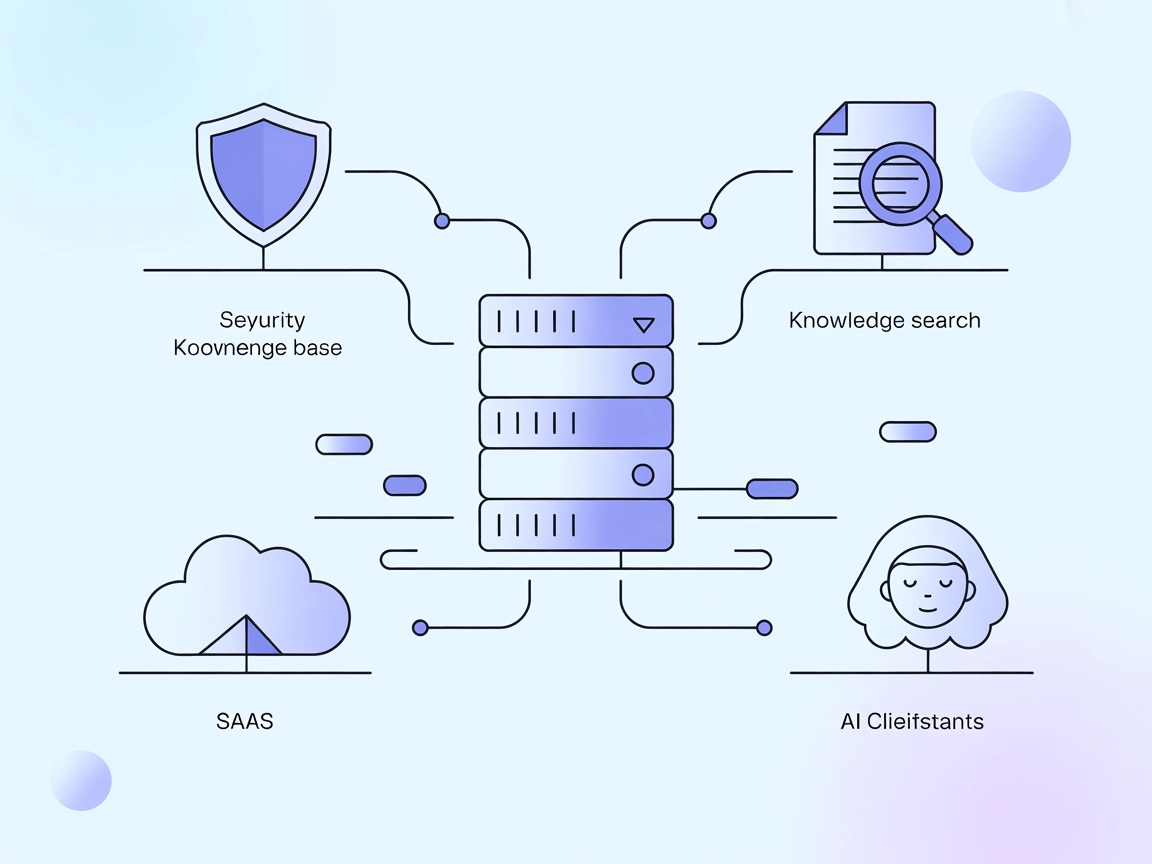

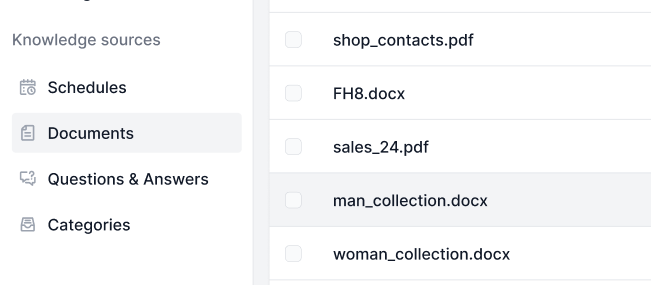

Źródła wiedzy sprawiają, że nauczanie AI według Twoich potrzeb jest niezwykle proste. Odkryj wszystkie sposoby łączenia wiedzy z FlowHunt. Łatwo połącz strony i...