Agentes de IA são fundamentalmente diferentes de chatbots. Um chatbot espera pelo input do usuário e responde. Um agente persegue objetivos de forma autônoma, chamando ferramentas, raciocinando sobre problemas e tomando ações sem input humano a cada etapa.

Essa distinção é importante porque os agentes podem automatizar fluxos de trabalho inteiros. Um agente de qualificação de leads pontua prospects, enriquece seus dados e os atribui a vendedores - tudo sem intervenção humana. Um agente de triagem de conteúdo categoriza tickets de suporte, os roteia para especialistas e escala casos limite para humanos.

Neste guia, você aprenderá a arquitetar agentes confiáveis, integrá-los a sistemas de negócio, prevenir falhas comuns e medir seu impacto. Abordaremos padrões reais usados em produção em empresas que automatizam qualificação de leads, processamento de documentos e suporte ao cliente em grande escala.

O que são agentes de IA e como se diferenciam dos chatbots?

Definição de agentes de IA (sistemas autônomos que percebem, decidem, agem)

Um agente de IA é um sistema de software que:

- Percebe seu ambiente (lê entrada, resultados de ferramentas, memória)

- Raciocina sobre a melhor ação (usa um LLM para planejar)

- Age chamando ferramentas ou avançando em direção a um objetivo

- Se adapta com base em feedback e resultados

Agentes são orientados por objetivos. Você define o objetivo (“Pontue e qualifique este lead”) e o agente descobre como alcançá-lo.

Distinção fundamental: chatbots são reativos; agentes são autônomos

Chatbots: usuário inicia → modelo responde

Usuário: "Qual é o status do meu pedido?"

Chatbot: [Consulta pedido, responde]

Usuário: "Pode cancelá-lo?"

Chatbot: [Cancela pedido, responde]

O usuário conduz cada interação. O chatbot é stateless - cada mensagem é independente.

Agentes: orientados por objetivos, tomam ações sem input do usuário a cada etapa

Objetivo do agente: "Qualificar e pontuar este lead"

1. Agente observa: [Dados do lead do CRM]

2. Agente raciocina: "Preciso enriquecer esses dados e pontuá-lo"

3. Agente age: Chama API de enriquecimento

4. Agente observa: [Dados enriquecidos]

5. Agente raciocina: "Pontuação 85, atribuir ao melhor vendedor"

6. Agente age: Atualiza CRM, envia notificação

7. Pronto. Nenhum input humano necessário.

O agente trabalha em direção a um objetivo definido, tomando múltiplas decisões e chamadas de ferramentas de forma autônoma.

Por que os agentes são importantes para fluxos de trabalho

Automação em escala (lide com milhares de tarefas sem intervenção humana)

Qualificação manual de leads: 5 minutos por lead × 100 leads = 500 horas/mês. Custo: US$ 10.000/mês (a US$ 20/hora).

Guiado por agente: 10 segundos por lead × 100 leads = 16 horas/mês. Custo: US$ 100 (chamadas de API do agente). Economia: 99%.

Agentes multiplicam a capacidade da sua equipe sem contratações.

Raciocínio em múltiplas etapas (divida problemas complexos em subtarefas)

Tarefas complexas exigem múltiplas etapas:

- Qualificação de leads: Pontuar → Enriquecer → Atribuir → Notificar

- Triagem de documentos: Extrair → Classificar → Rotear → Arquivar

- Suporte ao cliente: Entender → Pesquisar base de conhecimento → Gerar resposta → Rotear se necessário

Agentes fazem esse raciocínio automaticamente. Você define o objetivo; o agente o divide em etapas.

Uso de ferramentas (agentes chamam APIs, bancos de dados, serviços externos)

Agentes são “mãos”. Eles chamam APIs para:

- Consultar bancos de dados

- Atualizar sistemas CRM

- Enviar e-mails ou mensagens do Slack

- Chamar serviços de terceiros (enriquecimento de dados, processamento de pagamentos)

Um único agente pode orquestrar 5-10 chamadas de ferramentas para concluir um fluxo de trabalho.

Comportamento adaptativo (aprende com feedback, ajusta abordagem)

Agentes podem melhorar ao longo do tempo. Se um agente classifica documentos incorretamente, você fornece feedback. O agente aprende e ajusta sua estratégia de prompt.

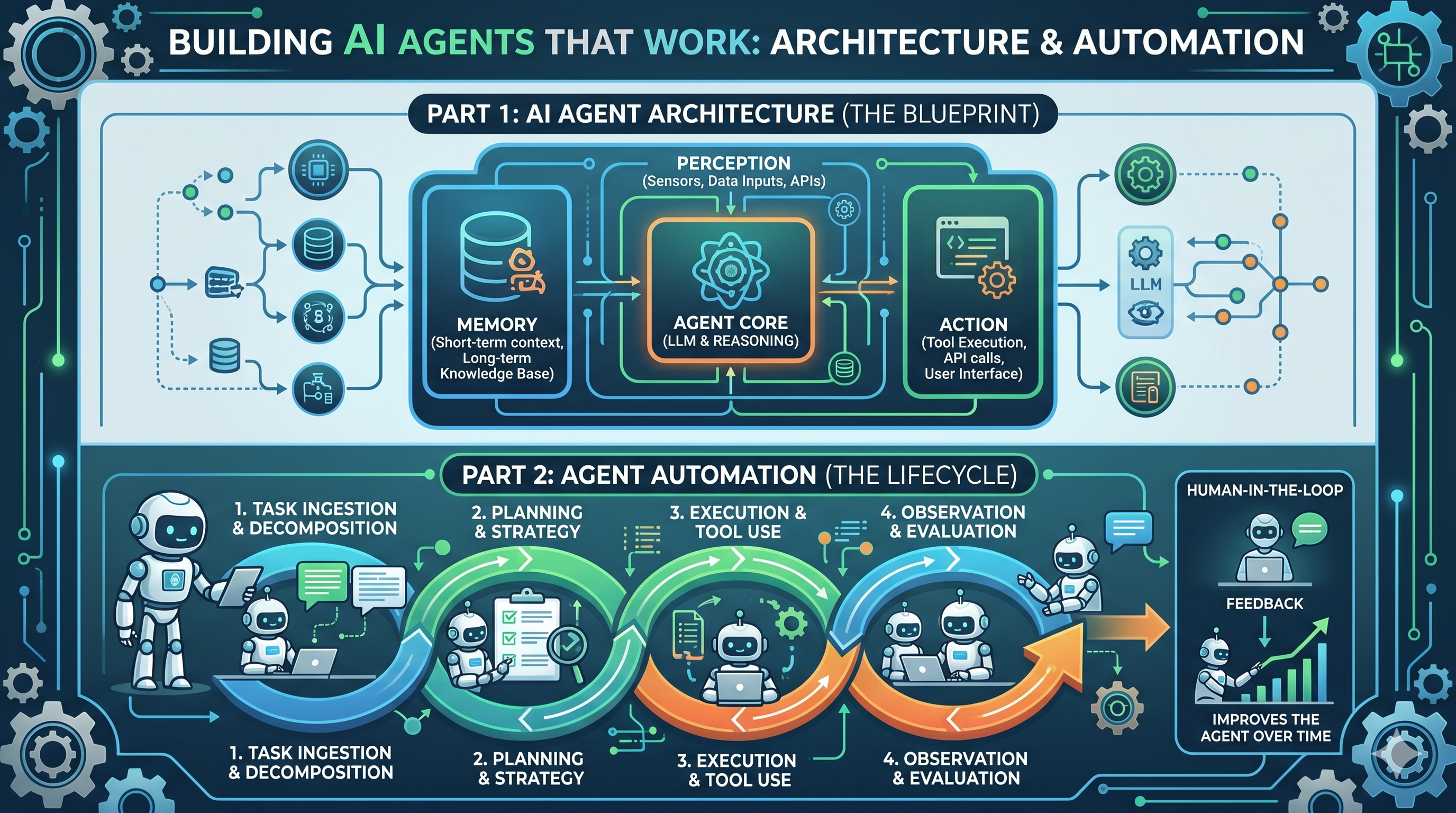

Componentes principais de um agente de IA (o loop do agente)

O loop de raciocínio do agente (com descrição de diagrama)

O núcleo de todo agente é um loop:

┌─────────────────────────────────────────┐

│ INÍCIO: Agente recebe objetivo │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ OBSERVAR: Ler entrada, resultados de │

│ ferramentas, memória, │

│ ambiente │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ RACIOCINAR: LLM decide próxima ação │

│ (qual ferramenta, ou fim?) │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ AGIR: Executar chamada de ferramenta │

│ ou concluir tarefa │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ FEEDBACK: Avaliar resultado, atualizar │

│ memória, verificar objetivo │

└────────────────┬────────────────────────┘

│

├─→ Objetivo não atingido? Volta a OBSERVAR

│

└─→ Objetivo atingido ou máx etapas? FIM

Observação: agente percebe o estado (entrada, ambiente, resultados de ferramentas)

O agente lê:

- Entrada inicial (dados do lead, texto do documento, pergunta do cliente)

- Resultados de ferramentas de etapas anteriores (respostas de API, consultas de banco)

- Memória (histórico da conversa, decisões anteriores, base de conhecimento)

- Estado atual (o que foi feito, o que falta)

Raciocínio: LLM decide a próxima ação (planejamento, seleção de ferramenta)

O LLM recebe um prompt como:

Você é um agente de qualificação de leads. Seu objetivo é pontuar e qualificar este lead.

Ferramentas disponíveis:

1. enrich_lead(lead_id) - Obter dados adicionais sobre o lead

2. score_lead(lead_data) - Pontuar com base em critérios

3. assign_to_sales_rep(lead_id, rep_id) - Atribuir lead a um vendedor

4. send_notification(rep_id, message) - Notificar vendedor

Estado atual:

- Lead ID: 12345

- Empresa: Acme Corp

- Receita: Desconhecida (precisa enriquecer)

- Status: Ainda não pontuado

O que você deve fazer em seguida?

O LLM responde: “Devo enriquecer o lead primeiro para obter dados de receita, depois pontuar, depois atribuir.”

Ação: executar chamada de ferramenta ou avançar em direção ao objetivo

O agente executa a ferramenta selecionada:

result = enrich_lead(lead_id=12345)

# Returns: {'revenue': '$10M', 'industry': 'SaaS', 'employees': 150}

Feedback: avaliar resultado, ajustar estratégia se necessário

O agente verifica: A chamada de ferramenta teve sucesso? Aproximou do objetivo? Atualize a memória e continue o loop.

Loop: repetir até o objetivo ser alcançado ou as etapas máximas serem atingidas

O agente repete observação → raciocínio → ação → feedback até que:

- O objetivo seja alcançado (“Lead pontuado e atribuído”)

- Etapas máximas sejam atingidas (previne loops infinitos)

- Ocorra um erro (escalar para humano)

Integração de ferramentas (as “mãos” do agente)

Definindo ferramentas (assinaturas de funções, descrições, parâmetros)

Ferramentas são funções que o agente pode chamar. Defina-as claramente:

tools = [

{

"name": "enrich_lead",

"description": "Get additional company data about a lead (revenue, employees, industry)",

"parameters": {

"lead_id": {"type": "string", "description": "Unique identifier of the lead"}

}

},

{

"name": "score_lead",

"description": "Score a lead on a scale of 0-100 based on fit criteria",

"parameters": {

"lead_data": {"type": "object", "description": "Lead information including revenue, industry, etc."}

}

}

]

Descrições claras ajudam o LLM a escolher a ferramenta correta.

Chamada de ferramenta (como agentes selecionam e invocam ferramentas)

O LLM responde com uma chamada de ferramenta:

{

"thought": "I need to enrich this lead to get revenue data",

"action": "enrich_lead",

"action_input": {"lead_id": "12345"}

}

Seu framework de agente executa a ferramenta e passa o resultado de volta ao LLM.

Tratamento de resultados de ferramentas (parsing de respostas, recuperação de erros)

Trate tanto sucesso quanto falha:

def execute_tool(tool_name, tool_input):

try:

if tool_name == "enrich_lead":

result = crm_api.enrich(tool_input['lead_id'])

return {"status": "success", "data": result}

except Exception as e:

return {"status": "error", "message": str(e)}

Se uma ferramenta falhar, o agente deve tentar uma abordagem diferente ou escalar para um humano.

Sistemas de memória (o que os agentes lembram)

Memória de curto prazo (contexto atual da conversa)

A memória de trabalho do agente: entrada atual, resultados de ferramentas, etapas de raciocínio. Normalmente armazenada na janela de contexto (o prompt).

Exemplo: agente de qualificação de leads lembra:

- Dados originais do lead

- Resultados de enriquecimento

- Pontuação

- Qual vendedor foi atribuído

Memória de longo prazo (base de conhecimento, interações passadas)

Memória persistente: decisões anteriores, padrões aprendidos, base de conhecimento.

Casos de uso:

- Base de conhecimento: Agente busca artigos relevantes ao responder perguntas dos clientes

- Histórico de decisões: Agente aprende quais leads converteram (melhora a pontuação)

- Logs de interação: Agente lembra interações passadas com um cliente

Implemente com bancos vetoriais (Pinecone, Weaviate) para busca semântica.

Limitações de memória (restrições da janela de contexto)

LLMs têm janelas de contexto finitas (4K-128K tokens). Agentes não podem lembrar de tudo. Estratégias:

- Sumarização: Comprima conversas antigas em resumos

- Retrieval-augmented generation (RAG): Busque apenas a memória relevante quando necessário

- Memória hierárquica: Mantenha interações recentes em curto prazo, antigas em longo prazo

Espinha dorsal de raciocínio (o “cérebro”)

Seleção do LLM (GPT-4, Claude, modelos open source)

- GPT-4: Melhor raciocínio, lida com tarefas complexas. Custo: US$ 0,03-0,06 por 1K tokens.

- Claude 3.5 Sonnet: Raciocínio forte, contexto longo (200K tokens). Custo: US$ 0,003-0,015 por 1K tokens.

- Open source (LLaMA 4): Mais barato (US$ 0,01-0,03 por 1M tokens), personalizável, amigável à privacidade.

Para a maioria dos agentes, Claude ou modelos open source são suficientes e mais baratos.

Modos de raciocínio (Chain-of-Thought, Tree-of-Thought, Reflexion)

- Chain-of-thought: Agente pensa passo a passo. “Preciso enriquecer → pontuar → atribuir.”

- Tree-of-thought: Agente explora múltiplos caminhos e escolhe o melhor. Mais lento mas mais preciso para problemas complexos.

- Reflexion: Agente critica sua própria saída, tenta novamente se necessário. Reduz alucinações.

Exemplo de prompt reflexion:

Agente: "Vou atribuir este lead ao vendedor John."

Crítico: "Espera, você verificou se John já está em capacidade máxima?"

Agente: "Bom ponto. Deixe-me verificar a carga do John primeiro."

Trade-offs: velocidade vs. acurácia

- Agentes rápidos: Raciocínio single-turn, sem validação de ferramentas. 2-5 segundos por tarefa. 85% de acurácia.

- Agentes precisos: Raciocínio em múltiplas etapas, validação, reflexion. 10-30 segundos por tarefa. 95% de acurácia.

Escolha velocidade para tempo real (suporte ao cliente). Escolha acurácia para alto risco (decisões financeiras).

Tipos de agentes e quando usar cada um

Agentes reativos (simples, rápidos, stateless)

Como funcionam (turno único: entrada → ação)

Agentes reativos tomam uma decisão e agem. Sem planejamento em múltiplas etapas.

Entrada: "Qual é o saldo da minha conta?"

→ Agente consulta o banco de dados

→ Agente responde com o saldo

Pronto.

Melhor para: uso simples de ferramentas, chamadas de API, respostas imediatas

- Q&A de atendimento (consulta de pedido, saldo)

- Chamadas simples de API (obter clima, cotação de ações)

- Respostas imediatas necessárias (< 2 segundos de latência)

Exemplo: chatbot de atendimento com busca em base de conhecimento

def customer_service_agent(question):

# 1. Search knowledge base

articles = search_kb(question)

# 2. LLM picks best article

response = llm.complete(f"""

Question: {question}

Relevant articles: {articles}

Provide an answer based on these articles.

""")

# 3. Return response

return response

Latência: 1-3 segundos. Custo: US$ 0,001-0,01 por consulta.

Agentes de planejamento (orientados por objetivos, raciocínio em múltiplas etapas)

Como funcionam (decompõem objetivo em subtarefas, executam plano)

Agentes de planejamento dividem objetivos complexos em etapas.

Objetivo: "Qualificar e atribuir este lead"

→ Agente planeja: [enriquecer, pontuar, atribuir, notificar]

→ Agente executa cada etapa

→ Agente verifica se o objetivo foi atingido

Pronto.

Melhor para: fluxos complexos, tarefas de pesquisa, análise de dados

- Qualificação de leads (enriquecer → pontuar → atribuir)

- Processamento de documentos (extrair → classificar → armazenar)

- Tarefas de pesquisa (buscar → resumir → compilar)

Exemplo: agente de qualificação de leads (pontuar → enriquecer → atribuir)

def lead_qualification_agent(lead_id):

lead = crm.get_lead(lead_id)

# Step 1: Enrich

enriched = enrich_lead(lead)

# Step 2: Score

score = score_lead(enriched)

# Step 3: Assign

best_rep = find_best_sales_rep(score)

crm.assign_lead(lead_id, best_rep)

# Step 4: Notify

send_slack(f"New qualified lead assigned to {best_rep}")

return {"lead_id": lead_id, "score": score, "assigned_to": best_rep}

Latência: 5-15 segundos. Custo: US$ 0,02-0,05 por lead.

Agentes de aprendizado (adaptativos, melhoram ao longo do tempo)

Como funcionam (incorporam feedback, ajustam comportamento)

Agentes de aprendizado ficam melhores com feedback.

Inicial: Agente classifica documento como "Fatura" (60% de confiança)

Feedback humano: "Na verdade, é um Recibo"

Agente aprende: Ajusta prompts de classificação

Próxima vez: Mesmo documento classificado como "Recibo" (90% de confiança)

Melhor para: processos de longa duração, personalização, otimização

- Recomendação de conteúdo (aprende preferências do usuário)

- Roteamento de suporte (aprende quais agentes lidam melhor com quais problemas)

- Otimização de preços (aprende quais preços convertem melhor)

Exemplo: agente de recomendação de conteúdo (aprende preferências do usuário)

def recommendation_agent(user_id):

# Get user history

history = db.get_user_history(user_id)

# LLM recommends based on patterns

recommendation = llm.complete(f"""

User history: {history}

Based on past preferences, what should we recommend?

""")

# Show recommendation, collect feedback

feedback = user_feedback # thumbs up/down

# Store feedback for future recommendations

db.log_feedback(user_id, recommendation, feedback)

return recommendation

Com o tempo, as recomendações melhoram à medida que o agente aprende as preferências do usuário.

Agentes hierárquicos (agentes gerenciando outros agentes)

Como funcionam (agente supervisor delega a especialistas)

Um agente supervisor coordena agentes especialistas.

Supervisor: "Processar este ticket de suporte"

├─ Agente classificador: "Isto é um problema de faturamento"

├─ Agente especialista em faturamento: "Reembolsar US$ 50"

└─ Agente de notificação: "Enviar e-mail de confirmação"

Melhor para: fluxos corporativos, automação em larga escala

- Criação de conteúdo (pesquisa → redação → edição → publicação)

- Suporte ao cliente complexo (triagem → resolução → escalonamento)

- Pipelines de processamento de dados (extrair → transformar → carregar)

Exemplo: pipeline de criação de conteúdo (pesquisa → redação → edição → publicação)

def content_pipeline_agent(topic):

# Supervisor delegates

research = research_agent(topic)

draft = writer_agent(research)

edited = editor_agent(draft)

published = publisher_agent(edited)

return {"topic": topic, "status": "published"}

Cada agente especialista é otimizado para sua tarefa. O supervisor orquestra.

Principais ferramentas e frameworks de agentes de IA em 2026 (tabela comparativa)

Critérios de avaliação

Capacidade de raciocínio (Chain-of-Thought, planejamento, reflexion)

Quão sofisticado é o pensamento do agente. Agentes simples usam chain-of-thought. Agentes complexos usam planejamento e reflexion.

Integração de ferramentas (quão fácil é adicionar ferramentas personalizadas)

Você consegue conectar APIs, bancos de dados, sistemas CRM facilmente? Ou precisa de código personalizado?

Curva de aprendizado (tempo de setup, qualidade da documentação)

Quão rapidamente um desenvolvedor consegue um agente funcional? Plataformas no-code são mais rápidas; frameworks Python são mais flexíveis.

Modelo de preços (gratuito, por chamada de API, assinatura)

Alguns frameworks são open source (gratuitos). Outros cobram por chamada de API ou assinatura.

Melhores casos de uso

Para o que cada ferramenta está otimizada?

Tabela comparativa: principais ferramentas e frameworks de agentes de IA (2026)

| Ferramenta | Tipo de framework | Capacidade de raciocínio | Integração de ferramentas | Curva de aprendizado | Preço | Melhor para |

|---|---|---|---|---|---|---|

| n8n | Construtor visual de workflow | Chain-of-thought | 500+ integrações | Baixa | Grátis + pago | Usuários não técnicos, setup rápido |

| CrewAI | Framework Python | Planejamento + reflexion | Ferramentas personalizadas (Python) | Média | Open source | Desenvolvedores, agentes complexos |

| Autogen | Framework Python | Raciocínio multi-agente | Ferramentas personalizadas | Alta | Open source | Pesquisa, sistemas multi-agente |

| LangGraph | Framework Python | Planejamento + gerenciamento de estado | Ecossistema LangChain | Média | Open source | Fluxos complexos, rastreamento de estado |

| FlowHunt | Plataforma nativa | Chain-of-thought + planejamento | Integrações nativas + API | Baixa | Assinatura | Automação de fluxos, facilidade de uso |

| Lindy.ai | Plataforma no-code | Chain-of-thought | 100+ integrações | Muito baixa | Freemium | Não técnico, agentes rápidos |

| Gumloop | Plataforma no-code | Chain-of-thought | 50+ integrações | Muito baixa | Freemium | Automação simples, templates |

Principais diferenças:

- No-code (n8n, FlowHunt, Lindy.ai): Rápidos de construir, customização limitada. Bons para fluxos padrão.

- Frameworks Python (CrewAI, Autogen, LangGraph): Flexíveis, poderosos, curva de aprendizado mais íngreme. Bons para lógica complexa.

- Open source (CrewAI, Autogen, LangGraph): Gratuitos, mas você gerencia a infraestrutura. Plataformas pagas cuidam da hospedagem.

Como escolher a ferramenta certa para seu caso de uso

- Protótipo rápido (< 1 semana): Use no-code (FlowHunt, n8n, Lindy.ai)

- Agente complexo com lógica personalizada: Use framework Python (CrewAI, LangGraph)

- Sistema multi-agente (agentes coordenando): Use Autogen

- Automação de fluxo em produção: Use FlowHunt (gerenciado, monitorado, escalado)

Construindo seu primeiro agente: arquitetura passo a passo

Defina o objetivo e o escopo do agente

Qual problema ele resolve?

Seja específico. Ruim: “Automatizar gestão de leads.” Bom: “Pontuar leads de 0-100, enriquecer com dados da empresa, atribuir a vendedores com base em capacidade.”

Quais são as métricas de sucesso?

- Acurácia: % de decisões corretas (meta: > 90%)

- Latência: Tempo para concluir tarefa (meta: < 10 segundos)

- Custo: Chamadas de API por tarefa (meta: < US$ 0,05)

- Taxa de automação: % de tarefas concluídas sem intervenção humana (meta: > 80%)

Quais são as restrições (latência, custo, acurácia)?

Trade-offs:

- Fluxos em tempo real: Precisam de < 5 segundos de latência. Use modelos rápidos, menos chamadas de ferramentas.

- Fluxos em batch: Podem tolerar 5-30 minutos. Use raciocínio mais preciso, mais chamadas de ferramentas.

- Sensível a custo: Use modelos open source, menos chamadas de API.

- Crítico em acurácia: Use modelos caros (GPT-4), validação em múltiplas etapas.

Projete o loop do agente

O que o agente vai observar?

Dados de entrada: dados do lead, texto do documento, pergunta do cliente, contexto da memória.

Qual modo de raciocínio (chain-of-thought simples vs. planejamento)?

- Chain-of-thought: Rápido, simples. “Farei a etapa 1, depois a 2.”

- Planejamento: Mais lento, mais preciso. “Deixe-me planejar todas as etapas primeiro, depois executar.”

De quais ferramentas ele precisa?

Liste APIs, bancos de dados, serviços que o agente chamará.

Exemplo para qualificação de leads:

- API CRM (obter/atualizar lead)

- API de enriquecimento (obter dados da empresa)

- Modelo de pontuação (pontuar lead)

- Serviço de notificação (enviar Slack/e-mail)

Como ele sabe quando parar?

Defina a condição de sucesso. “Pare quando o lead estiver pontuado e atribuído.”

Também defina etapas máximas para evitar loops infinitos. “Pare após 10 etapas, independentemente.”

Implemente e teste

Pseudocódigo ou exemplo de código real (CrewAI ou FlowHunt)

Exemplo CrewAI:

from crewai import Agent, Task, Crew

# Define agents

enrichment_agent = Agent(

role="Data Enrichment Specialist",

goal="Enrich lead data with company information",

tools=[enrich_tool]

)

scoring_agent = Agent(

role="Lead Scoring Expert",

goal="Score leads based on fit criteria",

tools=[score_tool]

)

assignment_agent = Agent(

role="Sales Manager",

goal="Assign leads to best sales rep",

tools=[assign_tool, notify_tool]

)

# Define tasks

enrich_task = Task(

description="Enrich this lead: {lead_id}",

agent=enrichment_agent

)

score_task = Task(

description="Score the enriched lead",

agent=scoring_agent

)

assign_task = Task(

description="Assign lead to best rep and notify",

agent=assignment_agent

)

# Run crew

crew = Crew(agents=[enrichment_agent, scoring_agent, assignment_agent],

tasks=[enrich_task, score_task, assign_task])

result = crew.kickoff(inputs={"lead_id": "12345"})

Estratégia de testes (testes unitários para chamadas de ferramentas, testes de integração para loops)

def test_enrichment_tool():

result = enrich_tool("lead_123")

assert result['revenue'] is not None

assert result['employees'] is not None

def test_scoring_agent():

lead = {"company": "Acme", "revenue": "10M", "employees": 50}

score = score_agent(lead)

assert 0 <= score <= 100

def test_full_loop():

result = lead_qualification_agent("lead_123")

assert result['assigned_to'] is not None

assert result['score'] > 0

Depuração de problemas comuns (loops infinitos, alucinações, ferramentas erradas)

- Loops infinitos: Adicione limite de etapas. Logue cada etapa. Monitore ações repetidas.

- Alucinações: Adicione validação. Confira saídas com dados de origem.

- Ferramentas erradas: Melhore descrições de ferramentas. Adicione validação antes da execução.

Exemplo real: agente de qualificação de leads

Objetivo: pontuar leads, enriquecer dados, atribuir ao time de vendas

def lead_qualification_agent(lead_id):

"""

Autonomous agent that qualifies leads.

1. Fetches lead from CRM

2. Enriches with company data

3. Scores based on fit criteria

4. Assigns to best sales rep

5. Notifies rep

"""

Ferramentas: API CRM, serviço de enriquecimento de dados, modelo de pontuação

tools = {

"get_lead": crm.get_lead,

"enrich_lead": enrichment_api.enrich,

"score_lead": scoring_model.score,

"find_best_rep": crm.find_available_rep,

"assign_lead": crm.assign,

"send_notification": slack.send

}

Passo a passo do pseudocódigo (observar lead → pontuar → enriquecer → atribuir)

# Step 1: Observe

lead = get_lead(lead_id)

print(f"Observing lead: {lead['company']}")

# Step 2: Reason (LLM decides next action)

# LLM: "I need to enrich this lead first"

# Step 3: Act

enriched = enrich_lead(lead)

print(f"Enriched: revenue={enriched['revenue']}")

# Step 4: Feedback + Loop

# LLM: "Now I'll score"

# Step 5: Act

score = score_lead(enriched)

print(f"Score: {score}")

# Step 6: Reason

# LLM: "Score is {score}, should assign to top rep"

# Step 7: Act

best_rep = find_best_rep(score)

assign_lead(lead_id, best_rep)

send_notification(best_rep, f"New lead: {lead['company']}")

print(f"Assigned to {best_rep}")

Resultados: métricas de acurácia, latência e custo

- Acurácia: 94% (pontuação do lead bate com revisão manual)

- Latência: 8 segundos (5 chamadas de ferramentas, 3 etapas de raciocínio do LLM)

- Custo: US$ 0,03 por lead (chamadas de API GPT-4 + API de enriquecimento)

- Throughput: 450 leads/hora (única instância de agente)

- Taxa de automação: 87% (13% escalados para revisão humana)

Integrando agentes com sistemas de negócio

Padrões de integração de API

APIs REST (mais comuns)

A maioria dos agentes chama APIs REST. Use cliente HTTP padrão:

def call_crm_api(endpoint, method="GET", data=None):

url = f"https://api.crm.com/{endpoint}"

headers = {"Authorization": f"Bearer {api_key}"}

if method == "GET":

response = requests.get(url, headers=headers)

elif method == "POST":

response = requests.post(url, json=data, headers=headers)

return response.json()

Webhooks (gatilhos de agente orientados a eventos)

Dispare agentes em eventos (novo lead, e-mail recebido, envio de formulário):

@app.post("/webhook/new_lead")

def on_new_lead(lead_data):

# Trigger agent asynchronously

queue.enqueue(lead_qualification_agent, lead_data['id'])

return {"status": "queued"}

Autenticação e segurança (chaves de API, OAuth, rate limiting)

- Chaves de API: Guarde em environment variables, não no código

- OAuth: Para integrações voltadas ao usuário (Salesforce, HubSpot)

- Rate limiting: Respeite limites de API. Implemente lógica de backoff e retry

from ratelimit import limits, sleep_and_retry

@sleep_and_retry

@limits(calls=100, period=60) # 100 calls per minute

def call_api(endpoint):

return requests.get(f"https://api.example.com/{endpoint}")

Integração com banco de dados

Somente leitura (agente consulta dados)

Agente lê dados de clientes, interações passadas, base de conhecimento:

def get_customer_history(customer_id):

query = "SELECT * FROM interactions WHERE customer_id = %s"

return db.execute(query, (customer_id,))

Operações de escrita (agente armazena decisões/resultados)

Agente escreve decisões no banco:

def store_lead_score(lead_id, score, assigned_to):

db.execute(

"UPDATE leads SET score = %s, assigned_to = %s WHERE id = %s",

(score, assigned_to, lead_id)

)

Transações e consistência (garantir integridade dos dados)

Use transações para operações em múltiplas etapas:

with db.transaction():

score = score_lead(lead)

db.update_lead_score(lead_id, score)

rep = find_best_rep(score)

db.assign_lead(lead_id, rep)

# All-or-nothing: if any step fails, rollback

Integração com CRM e ferramentas de negócio

Padrões de integração com Salesforce, HubSpot, Pipedrive

Use SDKs oficiais:

from salesforce import SalesforceAPI

sf = SalesforceAPI(api_key=key)

# Update lead

sf.update_lead(lead_id, {

'score': 85,

'assigned_to': 'john@acme.com',

'status': 'qualified'

})

Integração com Slack, e-mail, Jira (agente envia notificações/atualizações)

from slack_sdk import WebClient

slack = WebClient(token=slack_token)

# Notify sales rep

slack.chat_postMessage(

channel="john",

text=f"New qualified lead: {lead['company']} (score: {score})"

)

Autenticação e escopo de permissões

Use escopos OAuth para limitar o que agentes podem fazer:

# Agent can only read leads, update scores

# Cannot delete leads or access sensitive data

oauth_scopes = ["leads:read", "leads:update"]

Fluxos human-in-the-loop

Quando os agentes precisam de aprovação humana

Decisões de alto risco: transações financeiras, reembolsos a clientes, exceções de política.

if decision_risk_score > 0.7:

# Route to human for approval

escalate_to_human(decision, reason="High risk")

else:

# Agent executes decision

execute_decision(decision)

Padrões de escalonamento (decisões de alto risco, casos limite)

def lead_qualification_with_escalation(lead_id):

score = score_lead(lead_id)

if score > 80:

# High confidence, assign directly

assign_lead(lead_id, best_rep)

elif 50 < score < 80:

# Medium confidence, route to human

escalate_to_human(lead_id, "Review and assign")

else:

# Low score, reject

reject_lead(lead_id)

Loops de feedback (humanos corrigem erros do agente)

@app.post("/feedback/lead_score")

def on_score_feedback(lead_id, actual_score, agent_score):

# Store feedback

db.log_feedback(lead_id, agent_score, actual_score)

# Retrain model on feedback (periodic)

if should_retrain():

retrain_scoring_model()

Falhas comuns de agentes e como preveni-las

Loops infinitos (agente fica preso repetindo a mesma ação)

Causa: Má definição de objetivo, ferramenta que não progride

# Bad: Agent keeps calling same tool

Agente pensa: "I need to get lead data"

→ Chama get_lead()

→ Ainda sem dados enriquecidos

→ Chama get_lead() novamente

→ Loop infinito

Prevenção: limite máximo de etapas, rastreamento de progresso, diversidade de ferramentas

max_steps = 10

steps_taken = 0

while steps_taken < max_steps:

action = llm.decide_next_action()

if action == last_action:

# Same action twice, break loop

break

execute_action(action)

steps_taken += 1

Recuperação: timeout, escalonamento para humano

try:

result = agent.run(timeout=30) # 30 second timeout

except TimeoutError:

escalate_to_human("Agent loop timeout")

Alucinações (agente inventa fatos ou saídas de ferramentas)

Causa: Tendência do LLM a confabular, descrições de ferramentas ruins

# Bad: Agent hallucinates tool output

Agent: "I called enrich_lead, got revenue=$100M"

Realidade: enrich_lead() returned null (API failed)

Agent made up the result

Prevenção: Retrieval-Augmented Generation (RAG), validação de ferramentas, fact-checking

def execute_tool_safely(tool_name, params):

try:

result = execute_tool(tool_name, params)

# Validate result

if result is None:

return {"error": "Tool returned null"}

if not validate_result(result):

return {"error": "Result failed validation"}

return result

except Exception as e:

return {"error": str(e)}

Use RAG para ancorar o agente em fatos:

# Instead of: "Summarize this article"

# Use: "Summarize this article, citing specific passages"

knowledge_base = vector_db.search(query)

prompt = f"""

Summarize this article. Only cite specific passages.

Article: {article}

Knowledge base: {knowledge_base}

"""

Recuperação: fallback para humano, retry com raciocínio diferente

def robust_agent_call(goal, retries=3):

for attempt in range(retries):

try:

result = agent.run(goal)

# Validate result

if validate(result):

return result

except Exception as e:

if attempt == retries - 1:

escalate_to_human(goal)

else:

time.sleep(2 ** attempt) # Backoff

Uso incorreto de ferramentas (agente chama ferramenta errada ou com parâmetros errados)

Causa: Descrições ambíguas de ferramentas, raciocínio ruim

# Bad: Ambiguous tool description

"update_lead - Update a lead"

# Good: Clear description

"update_lead - Update a lead's score, status, or assigned_to field.

Parameters: lead_id (required), score (0-100), status (qualified/disqualified),

assigned_to (sales rep email)"

Prevenção: documentação clara, treino de uso de ferramentas, validação antes da execução

# Validate before execution

tool_call = llm.decide_tool_call()

if not validate_tool_call(tool_call):

# Tool call is invalid, ask LLM to fix

llm.correct_tool_call(tool_call)

else:

execute_tool(tool_call)

def validate_tool_call(call):

tool = tools[call['name']]

required_params = tool['required_parameters']

for param in required_params:

if param not in call['params']:

return False

return True

Recuperação: tratamento de erros, sugerir ferramenta correta, retry

try:

result = execute_tool(tool_call)

except ToolExecutionError as e:

# Suggest correct tool

correct_tool = suggest_correct_tool(e)

llm.suggest_retry(correct_tool)

Estouros de custo (agente usa chamadas de API demais)

Causa: Raciocínio ineficiente, chamadas redundantes de ferramentas

# Bad: Agent calls same tool multiple times

Agent: "Let me get lead data"

→ Chama get_lead()

→ Chama get_lead() novamente (esqueceu que já havia feito)

→ Chama get_lead() uma terceira vez

Custo: 3x maior que o necessário

Prevenção: limites de orçamento, deduplicação de chamadas, cache

budget = {"tokens": 10000, "api_calls": 50}

spent = {"tokens": 0, "api_calls": 0}

def execute_with_budget(action):

global spent

if spent['api_calls'] >= budget['api_calls']:

raise BudgetExceededError()

result = execute_action(action)

spent['api_calls'] += 1

return result

Implemente cache:

cache = {}

def get_lead_cached(lead_id):

if lead_id in cache:

return cache[lead_id]

result = crm_api.get_lead(lead_id)

cache[lead_id] = result

return result

Recuperação: monitoramento de custo, throttling, fallback para modelo mais barato

if cost_this_hour > budget_per_hour:

# Switch to cheaper model

switch_to_model("gpt-3.5-turbo") # Cheaper than GPT-4

Problemas de latência (agente muito lento para uso em tempo real)

Causa: Múltiplas etapas de raciocínio, respostas lentas de ferramentas

Um agente fazendo 5 chamadas sequenciais de API de 1 segundo cada = 5+ segundos de latência.

Prevenção: execução paralela de ferramentas, cache, modelos mais rápidos

# Parallel execution

import asyncio

async def parallel_agent(lead_id):

lead = await get_lead_async(lead_id)

# Call multiple tools in parallel

enrichment, scoring = await asyncio.gather(

enrich_lead_async(lead),

score_lead_async(lead)

)

return (enrichment, scoring)

Use modelos mais rápidos:

# Instead of GPT-4 (slower, more accurate)

# Use GPT-3.5-turbo (faster, still accurate enough)

model = "gpt-3.5-turbo" # 200ms latency vs 500ms for GPT-4

Recuperação: timeout, retornar resultados parciais, fila para async

try:

result = agent.run(timeout=5) # 5 second timeout

return result

except TimeoutError:

# Return partial results

return partial_result

# Queue for async completion

queue.enqueue(complete_agent, lead_id)

Medindo o desempenho do agente e ROI

Principais métricas a acompanhar

Acurácia (% de decisões/ações corretas)

Compare a saída do agente com a verdade de referência (revisão humana, resultados reais).

correct = 0

total = 100

for decision in agent_decisions:

if decision == human_review[decision.id]:

correct += 1

accuracy = correct / total * 100 # e.g., 94%

Latência (tempo para concluir tarefa)

Meça o tempo ponta a ponta da entrada à saída.

start = time.time()

result = agent.run(input_data)

latency = time.time() - start # e.g., 8.5 seconds

Custo por tarefa (chamadas de API, computação, revisão humana)

cost = (llm_api_calls * llm_cost) + (tool_calls * tool_cost) + (human_review_rate * hourly_rate)

# e.g., $0.03 per lead

Satisfação do usuário (se houver human-in-the-loop)

Pesquise usuários: “Quão satisfeito você está com as decisões do agente?”

Taxa de automação (% de tarefas concluídas sem intervenção humana)

automated = tasks_completed_by_agent

total = all_tasks

automation_rate = automated / total * 100 # e.g., 87%

Cálculo do ROI

Baseline: custo do processo manual (horas humanas × taxa horária)

Manual lead qualification:

- 100 leads/month

- 5 minutes per lead

- 500 hours/month

- $20/hour = $10,000/month

Custo do agente: infraestrutura + chamadas de API + supervisão humana

Agent-driven:

- 100 leads/month

- $0.03 per lead (API calls)

- $3 total API cost

- $500/month human review (10% escalation)

- $100/month infrastructure

Total: $603/month

Período de retorno: quando custo do agente < custo manual

Savings per month: $10,000 - $603 = $9,397

ROI: 1,557% (9,397 / 603)

Payback period: < 1 month (immediate)

Exemplo: ROI do agente de qualificação de leads

Manual process:

- 500 leads/month

- 5 min per lead = 2,500 hours = $50,000/month

Agent process:

- 500 leads/month

- $0.03 per lead = $15

- 5% escalation (25 leads) = $250 human time

- Infrastructure = $500

Total: $765/month

Savings: $50,000 - $765 = $49,235/month

ROI: 6,436%

Melhoria contínua

Monitore métricas ao longo do tempo

# Track daily metrics

daily_metrics = {

'accuracy': 0.94,

'latency': 8.5,

'cost_per_task': 0.03,

'automation_rate': 0.87

}

Faça testes A/B de diferentes configurações de agente

# Test 1: GPT-4 (more accurate, slower)

# Test 2: GPT-3.5-turbo (faster, slightly less accurate)

# Measure: accuracy, latency, cost

# Choose based on your priorities

Incorpore feedback para melhorar a acurácia

# Collect human feedback on agent mistakes

feedback = db.get_feedback()

# Retrain agent (adjust prompts, add examples)

agent.retrain(feedback)

# Measure: accuracy improves from 94% to 96%

Escale agentes de sucesso, aposente os de baixo desempenho

Monitore o ROI. Se um agente não entregar valor, aposente-o. Escale agentes bem-sucedidos para outros times.

Perguntas frequentes

A seção de FAQ é renderizada automaticamente a partir do frontmatter e aparece abaixo.

{{ cta-dark-panel heading=“Construa agentes sem a complexidade” description=“A plataforma nativa de agentes do FlowHunt cuida da integração de ferramentas, tratamento de erros e monitoramento. Comece a construir fluxos de trabalho autônomos em minutos - não semanas.” ctaPrimaryText=“Experimente o FlowHunt grátis” ctaPrimaryURL=“https://app.flowhunt.io/sign-in" ctaSecondaryText=“Agende uma demonstração” ctaSecondaryURL=“https://www.flowhunt.io/demo/" gradientStartColor="#7c3aed” gradientEndColor="#ec4899” gradientId=“cta-ai-agents” }}