LG EXAONE Deep vs DeepSeek R1: Modelos de Raciocínio em IA Comparados

Uma análise aprofundada do modelo de raciocínio EXAONE Deep 32B da LG testado contra o DeepSeek R1 e o QwQ da Alibaba, examinando alegações de desempenho superi...

Automação de IA

O OpenAI O1 utiliza aprendizado por reforço e raciocínio nativo em cadeia para superar o GPT4o em tarefas complexas de RAG, embora com um custo mais elevado.

A OpenAI acaba de lançar um novo modelo chamado OpenAI O1 da série O1 de modelos. A principal mudança arquitetural nesses modelos é a capacidade de pensar antes de responder à consulta de um usuário. Neste blog, vamos nos aprofundar nas principais mudanças do OpenAI O1, nos novos paradigmas que esses modelos utilizam e em como esse modelo pode aumentar significativamente a precisão do RAG. Vamos comparar um fluxo RAG simples usando o OpenAI GPT4o e o modelo OpenAI O1.

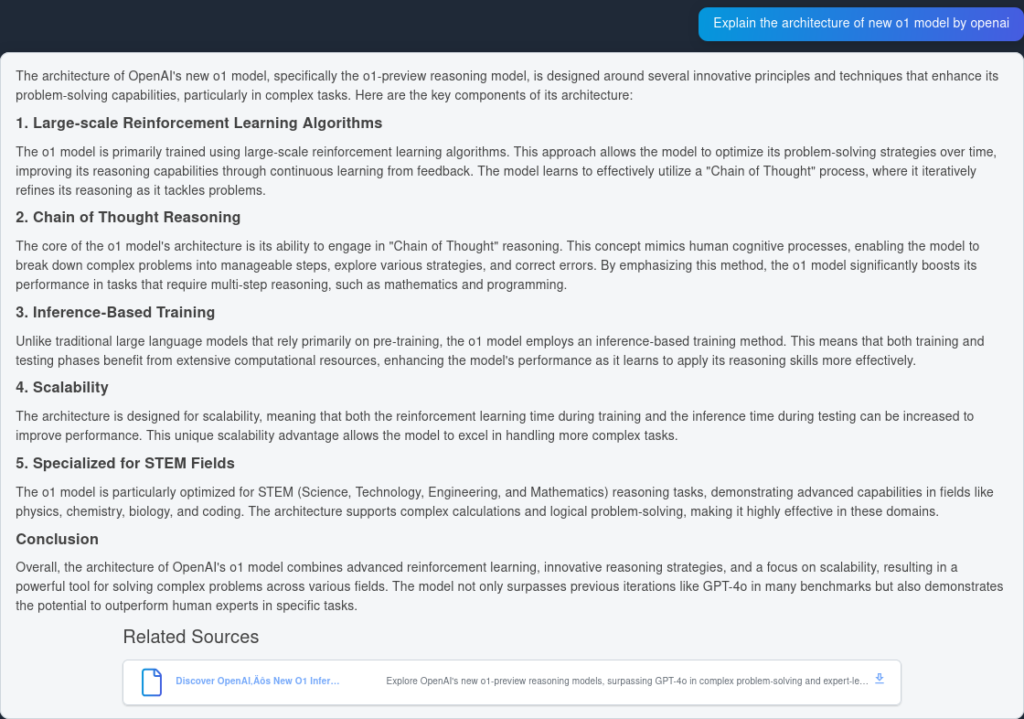

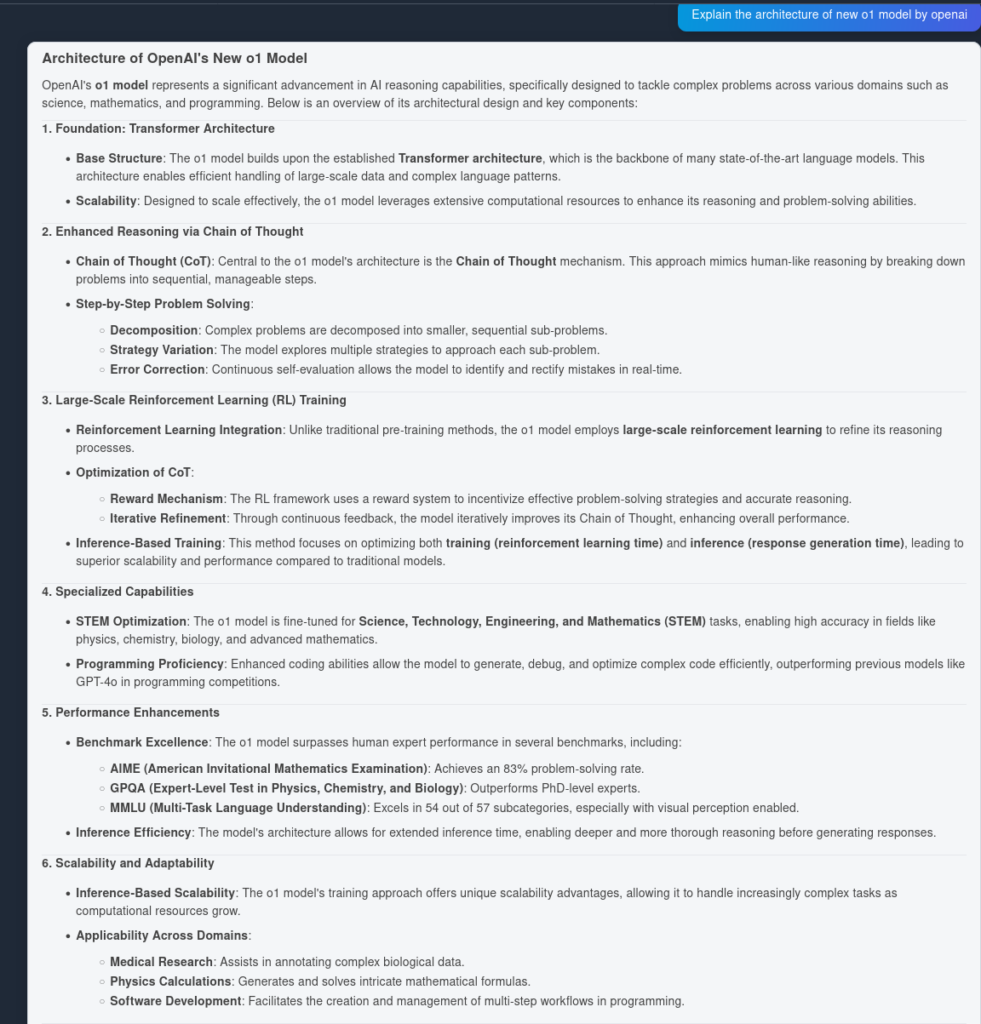

O modelo O1 utiliza algoritmos de aprendizado por reforço em larga escala durante o seu processo de treinamento. Isso permite que o modelo desenvolva uma robusta “Cadeia de Raciocínio”, possibilitando pensar de forma mais profunda e estratégica sobre os problemas. Ao otimizar continuamente seus caminhos de raciocínio por meio do aprendizado por reforço, o modelo O1 melhora significativamente sua capacidade de analisar e resolver tarefas complexas com eficiência.

Anteriormente, a cadeia de raciocínio provou ser um mecanismo útil de engenharia de prompt para fazer o LLM “pensar” por si só e responder perguntas complexas em um plano passo a passo. Com os modelos O1, esse passo já vem de fábrica e é integrado nativamente ao modelo no momento da inferência, tornando-o útil para tarefas de resolução de problemas matemáticos e de programação.

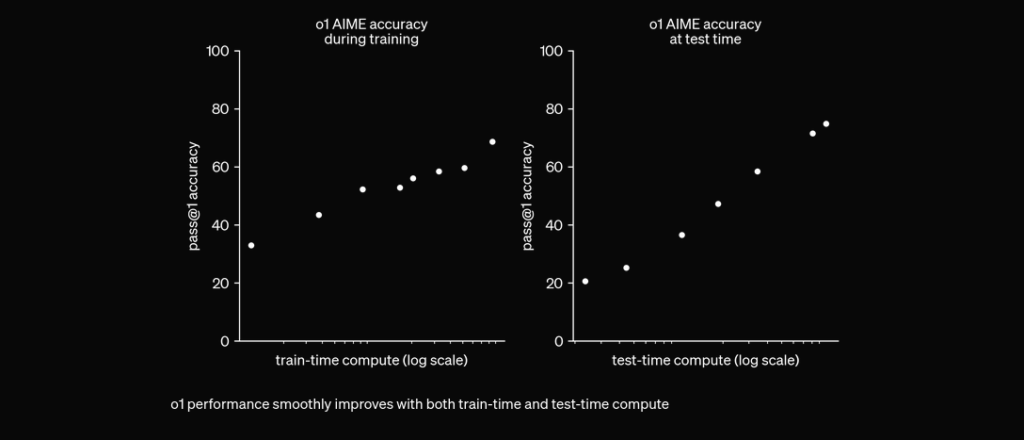

O O1 é treinado com RL para “pensar” antes de responder via uma cadeia de raciocínio privada. Quanto mais tempo pensa, melhor se sai em tarefas de raciocínio. Isso abre uma nova dimensão para escala. Não estamos mais limitados pelo pré-treinamento. Agora podemos escalar a computação da inferência também. pic.twitter.com/niqRO9hhg1

— Noam Brown (@polynoamial) 12 de setembro de 2024

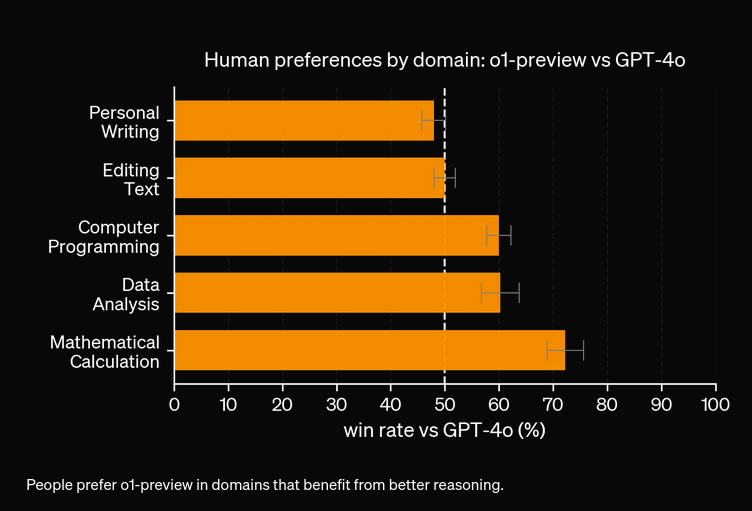

Em avaliações extensas, o modelo O1 demonstrou desempenho notável em vários benchmarks:

Para testar a precisão de desempenho do OpenAI O1 e do GPT4o, criamos dois fluxos idênticos, mas com dois LLMs diferentes. Vamos comparar a capacidade de resposta das perguntas dos modelos em duas fontes indexadas referentes ao relatório técnico do OpenAI O1.

Primeiro, vamos criar um fluxo RAG simples no FlowHunt. Ele consiste em Chat Input, Document Retriever (busca documentos relevantes), Prompt, Generator e Chat Output. O componente LLM OpenAI é adicionado para especificar o modelo (caso contrário, o GPT4o é usado por padrão).

Aqui está a resposta do GPT4o:

E aqui está o resultado do OpenAI O1:

Como você pode ver, o OpenAI O1 capturou mais vantagens arquiteturais do próprio artigo—6 pontos contra 4. Além disso, o O1 faz implicações lógicas de cada ponto, enriquecendo o documento com mais insights sobre por que a mudança arquitetural é útil.

Em nossos experimentos, o modelo O1 custaria mais para maior precisão. O novo modelo possui 3 tipos de tokens: Token de Prompt, Token de Conclusão e Token de Raciocínio (um tipo de token recém-adicionado), tornando-o potencialmente mais caro. Na maioria dos casos, o OpenAI O1 fornece respostas que parecem mais úteis se estiverem fundamentadas na verdade. No entanto, há algumas situações em que o GPT4o supera o OpenAI O1—algumas tarefas simplesmente não precisam de raciocínio.

Yasha é um talentoso desenvolvedor de software especializado em Python, Java e aprendizado de máquina. Yasha escreve artigos técnicos sobre IA, engenharia de prompts e desenvolvimento de chatbots.

Experimente o FlowHunt para aproveitar os LLMs mais recentes como OpenAI O1 e GPT4o para raciocínio superior e geração aumentada por recuperação.

Uma análise aprofundada do modelo de raciocínio EXAONE Deep 32B da LG testado contra o DeepSeek R1 e o QwQ da Alibaba, examinando alegações de desempenho superi...

Descubra como o o1 Preview da OpenAI supera o GPT-4 ao dominar prompts de escrita complexos por meio de planejamento interno, criatividade e respeito a restriçõ...

Descubra como a Geração Aumentada por Recuperação (RAG) está transformando a IA empresarial, desde os princípios fundamentais até arquiteturas agenticas avançad...