LLM xAI

O FlowHunt suporta dezenas de modelos de geração de texto, incluindo modelos da xAI. Veja como usar os modelos da xAI em suas ferramentas de IA e chatbots.

O LLM Meta AI do FlowHunt reúne os modelos Llama da Meta e dezenas de outros modelos de IA em um único painel fácil de controlar para geração flexível de texto e imagem.

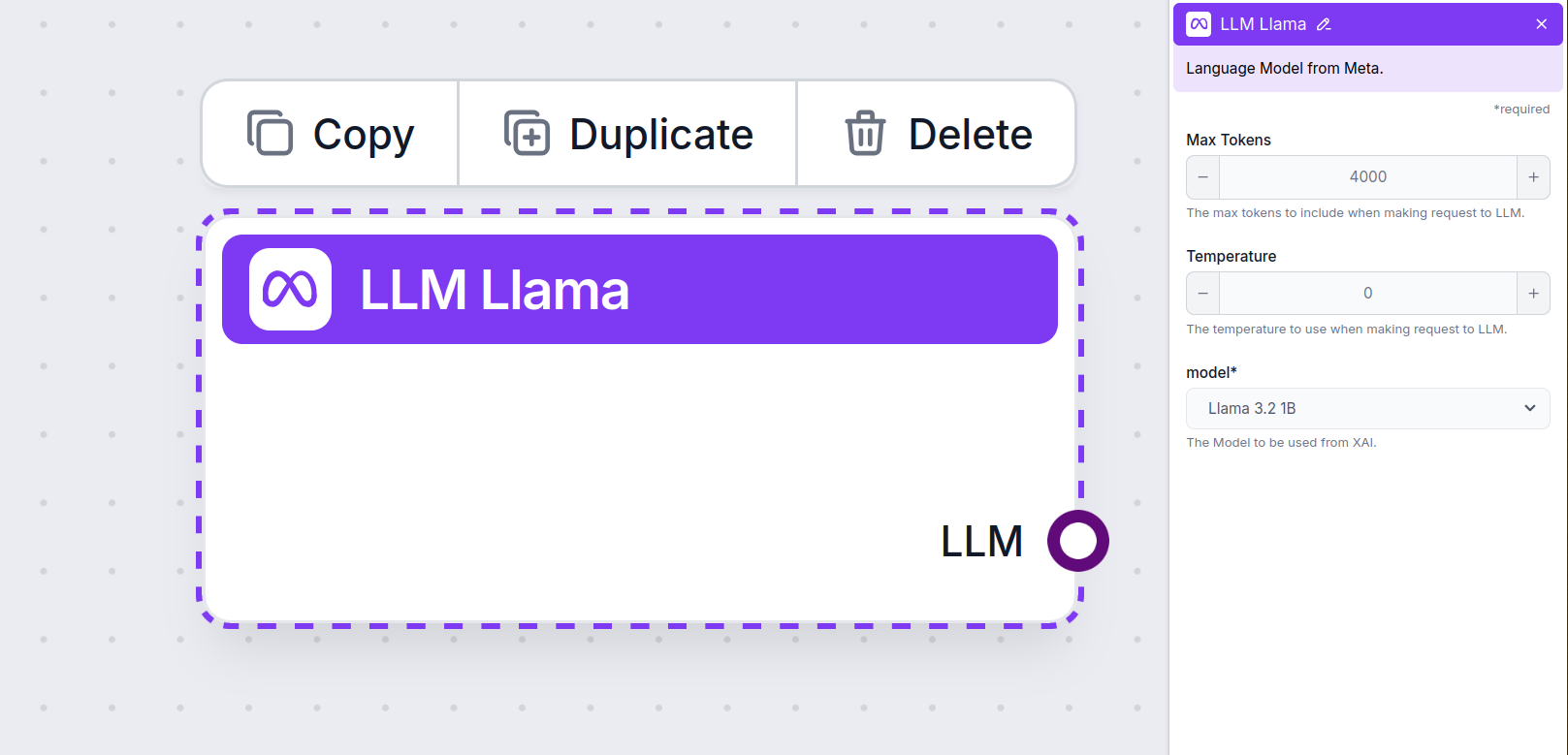

Descrição do componente

The LLM Meta AI component connects the Claude family of model to your Flow. While the Generators and Agents are where the actual magic happens, LLM components allow you to control the used model. All components come with ChatGPT-4 by default. You can connect this component if you wish to change the model or gain more control over it.

Remember that connecting an LLM Component is optional. All components that use an LLM come with ChatGPT-4o as the default. The LLM components allow you to change the model and control model settings.

Tokens represent the individual units of text the model processes and generates. Token usage varies with models, and a single token can be anything from words or subwords to a single character. Models are usually priced in millions of tokens.

The max tokens setting limits the total number of tokens that can be processed in a single interaction or request, ensuring the responses are generated within reasonable bounds. The default limit is 4,000 tokens, the optimal size for summarizing documents and several sources to generate an answer.

Temperature controls the variability of answers, ranging from 0 to 1.

A temperature of 0.1 will make the responses very to the point but potentially repetitive and deficient.

A high temperature of 1 allows for maximum creativity in answers but creates the risk of irrelevant or even hallucinatory responses.

For example, the recommended temperature for a customer service bot is between 0.2 and 0.5. This level should keep the answers relevant and to the script while allowing for a natural response variation.

This is the model picker. You’ll find all the supported models from Meta AI here. We support Meta’s open-source lightweight Llama models. These models are designed for efficient on-device and edge deployments:

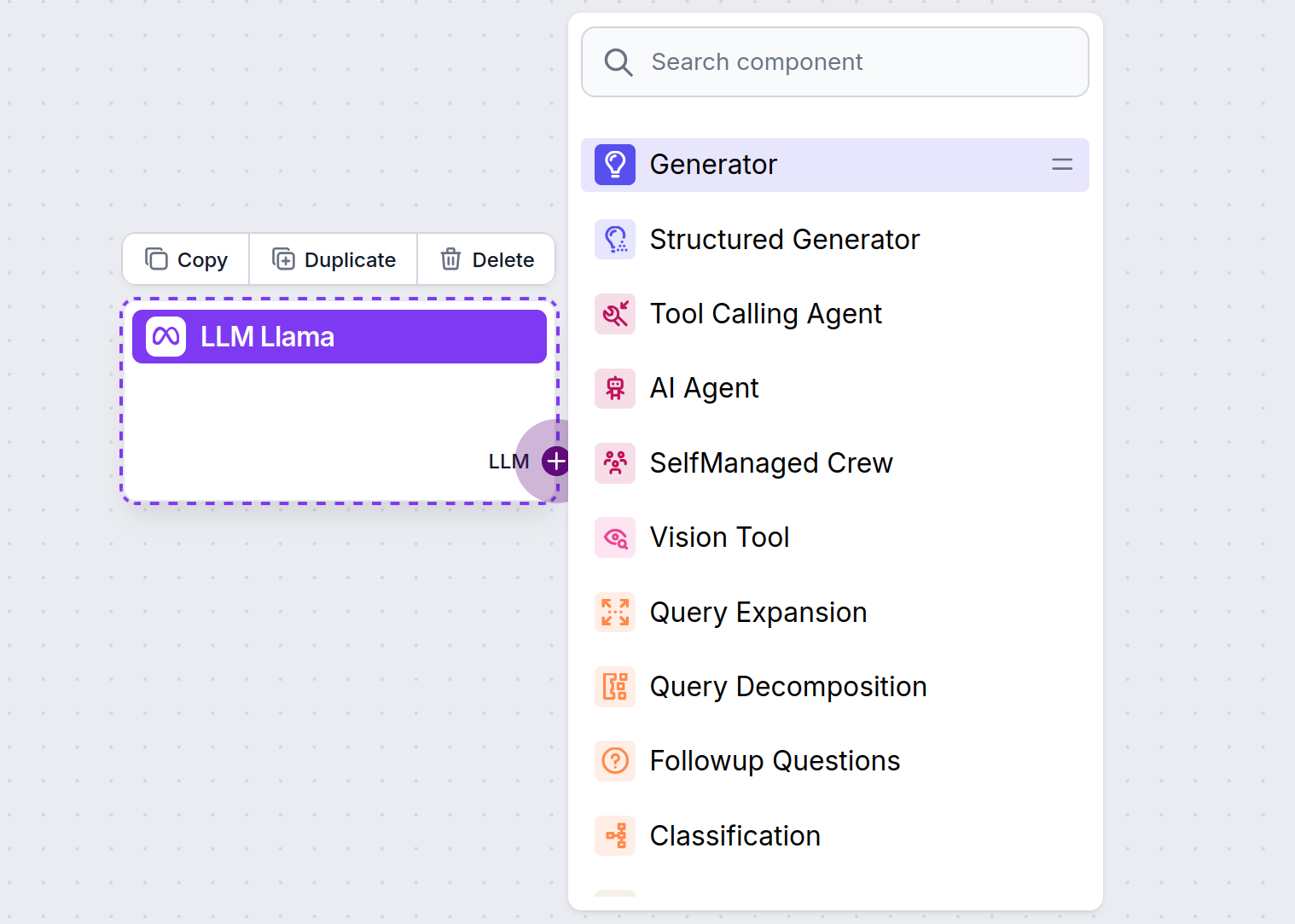

You’ll notice that all LLM components only have an output handle. Input doesn’t pass through the component, as it only represents the model, while the actual generation happens in AI Agents and Generators.

The LLM handle is always purple. The LLM input handle is found on any component that uses AI to generate text or process data. You can see the options by clicking the handle:

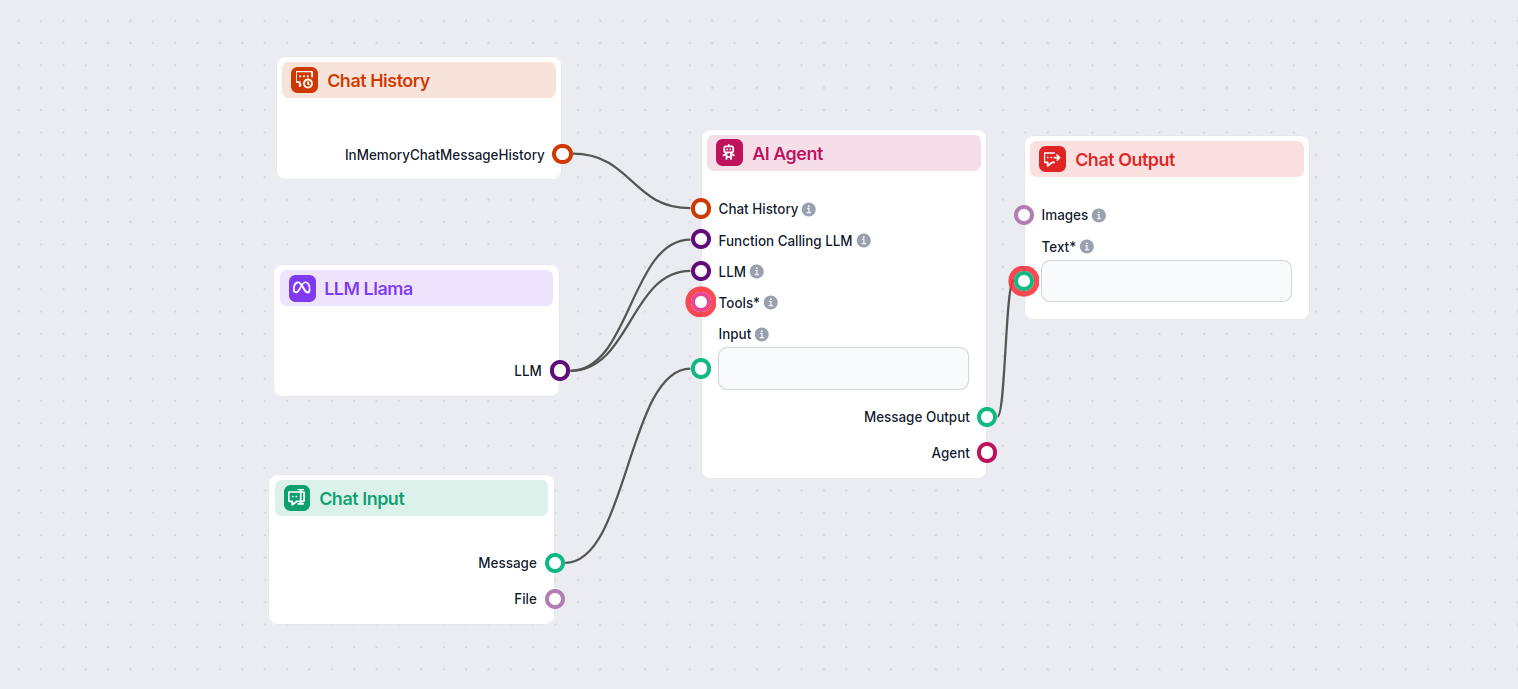

This allows you to create all sorts of tools. Let’s see the component in action. Here’s a simple AI Agent chatbot Flow that’s using Meta AI’s Llama 3.2 1B to generate responses. You can think of it as a basic Llama chatbot.

This simple Chatbot Flow includes:

O componente LLM Meta AI permite conectar os modelos Llama da Meta e outros geradores de texto/imagem aos seus fluxos, possibilitando fácil seleção de modelos e configuração avançada como máximo de tokens e temperatura.

O FlowHunt suporta os modelos Llama de código aberto da Meta, incluindo Llama 3.2 1B e 3B, otimizados para eficiência, sumarização e implantações em dispositivos.

Você pode ajustar configurações como máximo de tokens (limita o tamanho da resposta), temperatura (controla a criatividade das respostas) e seleção de modelo diretamente pelo painel do FlowHunt para cada componente.

Não, adicionar o componente LLM Meta AI é opcional. Por padrão, os componentes utilizam o ChatGPT-4o, mas você pode trocar para Llama ou outros modelos para mais controle ou casos específicos de uso.

Comece a criar chatbots e ferramentas de IA mais inteligentes com os modelos Llama da Meta e dezenas de outros geradores de IA, tudo em uma única plataforma.

O FlowHunt suporta dezenas de modelos de geração de texto, incluindo modelos da xAI. Veja como usar os modelos da xAI em suas ferramentas de IA e chatbots.

O FlowHunt suporta dezenas de modelos de texto de IA, incluindo modelos da Mistral. Veja como usar a Mistral em suas ferramentas e chatbots de IA.

O FlowHunt suporta dezenas de modelos de IA, incluindo os modelos Claude da Anthropic. Aprenda como usar o Claude em suas ferramentas e chatbots de IA com confi...