Reclassificação de Documentos

A reclassificação de documentos é o processo de reordenar documentos recuperados com base em sua relevância para a consulta do usuário, refinando os resultados ...

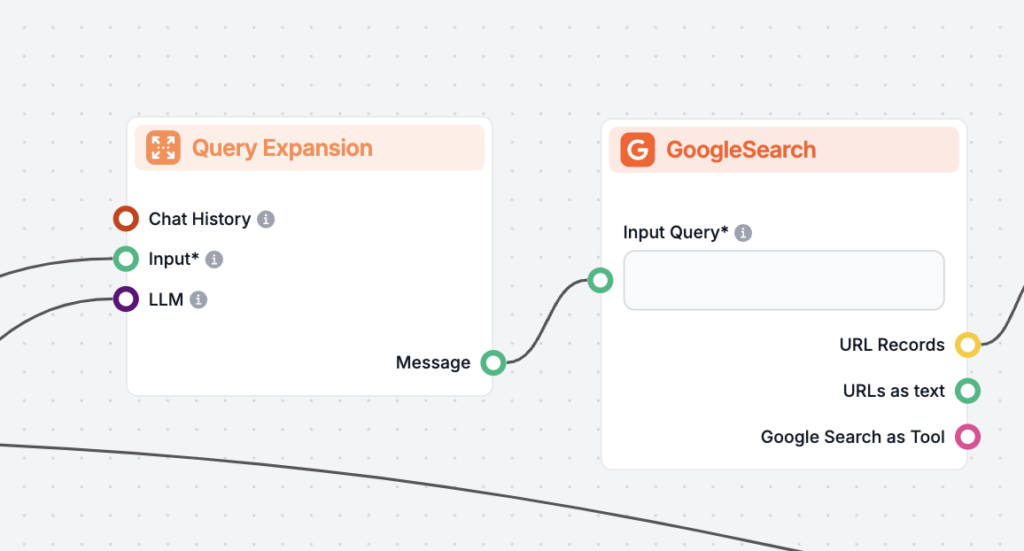

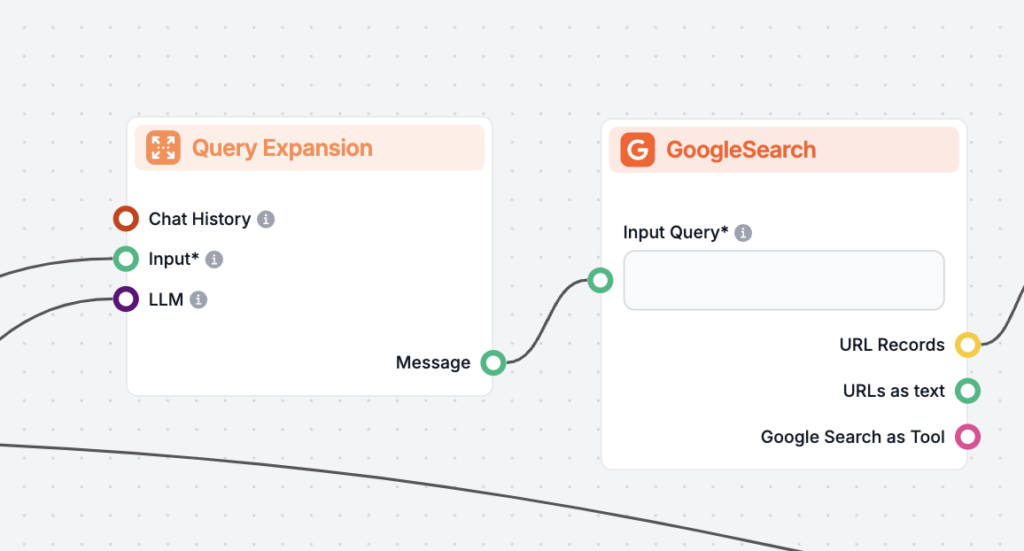

A Expansão de Consulta enriquece as consultas dos usuários com contexto ou termos adicionais, aumentando a precisão da recuperação e a qualidade das respostas em sistemas de IA como RAG e chatbots.

A Expansão de Consulta aprimora as consultas dos usuários adicionando termos ou contexto, melhorando a recuperação de documentos para respostas precisas. Em sistemas RAG, ela aumenta o recall e a relevância, auxiliando chatbots e IA a fornecer respostas exatas ao lidar de forma eficaz com consultas vagas ou sinônimos.

Expansão de Consulta refere-se ao processo de melhorar a consulta original do usuário adicionando termos ou contexto adicionais antes de enviá-la ao mecanismo de recuperação. Esse aumento ajuda a recuperar documentos ou informações mais relevantes, que depois são usados para gerar uma resposta mais precisa e apropriada ao contexto. Se documentos forem buscados com consultas alternativas e depois reclassificados, o processo RAG obtém resultados de documentos muito mais precisos na janela de contexto do prompt.

Geração Aumentada por Recuperação (RAG) é uma arquitetura de IA que combina mecanismos de recuperação com modelos generativos para produzir respostas mais precisas e contextualmente relevantes. Em sistemas RAG, um componente de recuperação busca documentos ou fragmentos de dados relevantes em uma base de conhecimento baseada na consulta do usuário. Em seguida, um modelo generativo (geralmente um Grande Modelo de Linguagem ou LLM) utiliza essa informação recuperada para gerar uma resposta coerente e informativa.

Em sistemas RAG, a qualidade da resposta gerada depende fortemente da relevância dos documentos recuperados. Se o componente de recuperação não buscar as informações mais pertinentes, o modelo generativo pode produzir respostas subótimas ou irrelevantes. A Expansão de Consulta aborda esse desafio ao melhorar a consulta inicial, aumentando as chances de recuperar todos os documentos relevantes.

Ao expandir a consulta original com termos relacionados, sinônimos ou parafrases, a Expansão de Consulta amplia o espaço de busca. Isso aumenta o recall do sistema de recuperação, ou seja, captura uma proporção maior de documentos relevantes da base de conhecimento. Um recall mais alto leva a um contexto mais abrangente para o modelo generativo, melhorando a qualidade geral da saída do sistema RAG.

LLMs como o GPT-4 podem gerar consultas semanticamente similares ou parafrases da consulta original. Ao entender o contexto e as nuances da linguagem, os LLMs podem produzir expansões de alta qualidade que capturam diferentes formas de se fazer a mesma pergunta.

Exemplo:

Nesta abordagem, o sistema gera uma resposta hipotética à consulta do usuário usando um LLM. A resposta hipotética é então adicionada à consulta original para fornecer mais contexto durante a recuperação.

Processo:

Exemplo:

Este método envolve gerar várias consultas alternativas que capturam diferentes formulações ou aspectos da consulta original. Cada consulta é usada independentemente para recuperar documentos.

Processo:

Exemplo:

Cenário:

Um sistema de IA é projetado para responder perguntas com base no relatório anual de uma empresa. Um usuário pergunta: “Houve grande rotatividade na equipe executiva?”

Implementação:

Benefício:

Ao fornecer mais contexto através da resposta hipotética, o sistema recupera informações relevantes que poderiam ter sido perdidas apenas com a consulta original.

Cenário:

Um chatbot de suporte ao cliente auxilia usuários na solução de problemas. Um usuário digita: “Minha internet está lenta.”

Implementação:

Benefício:

O chatbot captura uma gama mais ampla de possíveis problemas e soluções, aumentando as chances de resolver o problema do usuário de forma eficiente.

Cenário:

Um estudante utiliza um assistente de IA para encontrar recursos sobre um tema: “Efeitos da privação de sono na função cognitiva.”

Implementação:

Benefício:

O estudante recebe informações abrangentes cobrindo vários aspectos do tema, auxiliando em uma pesquisa mais aprofundada.

Adicionar muitas consultas expandidas pode introduzir documentos irrelevantes, reduzindo a precisão da recuperação.

Mitigação:

Palavras com múltiplos significados podem levar a expansões irrelevantes.

Mitigação:

Gerar e processar múltiplas consultas expandidas pode ser intensivo em recursos.

Mitigação:

Garantir que as consultas expandidas funcionem efetivamente com os algoritmos de recuperação existentes.

Mitigação:

Atribuir pesos aos termos nas consultas expandidas para refletir sua importância.

Após a recuperação, reclassificar os documentos para priorizar a relevância.

Exemplo:

Usar um Cross-Encoder após a recuperação para pontuar e reclassificar documentos com base em sua relevância para a consulta original.

Incorporar as interações do usuário para melhorar a expansão de consulta.

Usar IA e LLMs para expansão de consulta aproveita a compreensão avançada da linguagem para melhorar a recuperação. Isso permite que sistemas de IA, incluindo chatbots e assistentes virtuais, forneçam respostas mais precisas e adequadas ao contexto.

Automatizar o processo de expansão de consulta reduz o esforço dos usuários para criar consultas precisas. A automação de IA lida com a complexidade nos bastidores, aumentando a eficiência dos sistemas de recuperação de informação.

Chatbots se beneficiam da expansão de consulta ao entender melhor as intenções dos usuários, especialmente quando eles usam linguagem coloquial ou frases incompletas. Isso leva a interações mais satisfatórias e resolução eficaz de problemas.

Exemplo:

Um chatbot de suporte técnico pode interpretar uma consulta vaga do usuário como “Meu aplicativo não está funcionando” expandindo para incluir “aplicativo travando”, “software não responde” e “mensagens de erro do app”, levando a uma resolução mais rápida.

Pesquisas sobre Expansão de Consulta para RAG

Improving Retrieval for RAG based Question Answering in question answering, enhancing accuracy with real-time data. Discover more!") Models on Financial Documents

Este artigo examina a eficácia de Grandes Modelos de Linguagem (LLMs) aprimorados por Geração Aumentada por Recuperação (RAG), especialmente em contextos de documentos financeiros. Identifica que imprecisões nas saídas dos LLMs frequentemente provêm de uma recuperação subótima de fragmentos de texto, em vez dos próprios LLMs. O estudo propõe melhorias nos processos de RAG, incluindo técnicas sofisticadas de segmentação e expansão de consulta, juntamente com anotações de metadados e algoritmos de reclassificação. Essas metodologias visam refinar a recuperação de textos, melhorando assim o desempenho dos LLMs na geração de respostas precisas. Leia mais

Enhancing Retrieval and Managing Retrieval: A Four-Module Synergy for Improved Quality and Efficiency in RAG Systems

O artigo apresenta uma abordagem modular para aprimorar sistemas RAG, com foco no módulo Query Rewriter, que cria consultas otimizadas para busca de conhecimento. Aborda problemas de platôs de informação e ambiguidade em consultas gerando múltiplas queries. Além disso, o Knowledge Filter e o Memory Knowledge Reservoir são propostos para gerenciar conhecimento irrelevante e otimizar recursos de recuperação. Esses avanços visam aprimorar a qualidade e eficiência das respostas em sistemas RAG, validados por experimentos em conjuntos de dados de QA. Acesse o código e mais detalhes.

MultiHop-RAG: Benchmarking Retrieval-Augmented Generation for Multi-Hop Queries

Esta pesquisa destaca desafios em sistemas RAG existentes ao lidar com consultas multi-hop, que exigem raciocínio sobre múltiplas evidências. Introduz um novo conjunto de dados projetado especificamente para avaliar sistemas RAG em consultas multi-hop, visando expandir as capacidades atuais dos métodos RAG. O artigo discute avanços necessários para que métodos RAG lidem de forma eficaz com estruturas de consulta complexas e melhorem a adoção de LLMs em aplicações práticas.

Expansão de Consulta é o processo de aumentar a consulta original do usuário adicionando termos relacionados, sinônimos ou contexto, ajudando sistemas de recuperação a buscar documentos mais relevantes e gerar respostas precisas, especialmente em aplicações impulsionadas por IA.

Em sistemas RAG (Geração Aumentada por Recuperação), a Expansão de Consulta aumenta o recall do componente de recuperação ao ampliar o espaço de busca, garantindo que mais documentos relevantes sejam considerados para gerar respostas precisas.

As técnicas incluem o uso de Grandes Modelos de Linguagem para gerar consultas parafraseadas, geração de respostas hipotéticas, abordagens de múltiplas consultas, ponderação de termos e aproveitamento do feedback do usuário para melhoria contínua.

A Expansão de Consulta melhora o recall, lida com consultas vagas ou ambíguas, reconhece sinônimos e aprimora a experiência do usuário ao entregar respostas mais precisas e informativas sem a necessidade de refino manual da consulta.

Sim, os desafios incluem superexpansão (introdução de documentos irrelevantes), ambiguidade nos termos, demanda por recursos computacionais e garantir compatibilidade com algoritmos de recuperação. Estes podem ser mitigados com geração controlada, filtragem de relevância e modelos eficientes.

Veja como a Expansão de Consulta pode aumentar a precisão do seu chatbot de IA e melhorar a recuperação de informações. Descubra as soluções do FlowHunt para manuseio eficiente e automatizado de consultas.

A reclassificação de documentos é o processo de reordenar documentos recuperados com base em sua relevância para a consulta do usuário, refinando os resultados ...

A Resposta a Perguntas com Geração Aumentada por Recuperação (RAG) combina recuperação de informações e geração de linguagem natural para aprimorar grandes mode...

Transforme frases concisas em conteúdos detalhados e envolventes com nosso Expansor de Sentenças alimentado por IA. Perfeito para escritores, estudantes e profi...