Agenții AI sunt fundamental diferiți de chatboți. Un chatbot așteaptă input-ul utilizatorului și răspunde. Un agent urmărește obiective autonom, apelează instrumente, raționează despre probleme și execută acțiuni fără input uman la fiecare pas.

Această distincție contează pentru că agenții pot automatiza fluxuri de lucru întregi. Un agent de calificare a lead-urilor scorează prospecții, îmbogățește datele lor și îi alocă reprezentanților de vânzări - totul fără intervenție umană. Un agent de triaj al conținutului categorizează tichetele de suport, le direcționează către specialiști și escaladează cazurile limită către oameni.

În acest ghid vei învăța cum să arhitecturezi agenți fiabili, să îi integrezi cu sistemele de business, să previi erorile comune și să le măsori impactul. Vom aborda tipare reale folosite în producție la companii care automatizează la scară largă calificarea lead-urilor, procesarea documentelor și suportul clienților.

Ce sunt agenții AI și cum se diferențiază de chatboți?

Definiția agenților AI (sisteme autonome care percep, decid, acționează)

Un agent AI este un sistem software care:

- Percepe mediul (citește input, rezultate ale instrumentelor, memorie)

- Raționează asupra celei mai bune acțiuni (folosește un LLM pentru a planifica)

- Acționează apelând instrumente sau făcând pași către un obiectiv

- Se adaptează pe baza feedback-ului și a rezultatelor

Agenții sunt orientați pe obiective. Tu definești obiectivul (“Scorează și califică acest lead”) și agentul găsește cum să îl atingă.

Distincție cheie: chatboții sunt reactivi; agenții sunt autonomi

Chatboții: utilizatorul inițiază → modelul răspunde

Utilizator: "Care este statusul comenzii mele?"

Chatbot: [Caută comanda, răspunde]

Utilizator: "O poți anula?"

Chatbot: [Anulează comanda, răspunde]

Utilizatorul conduce fiecare interacțiune. Chatbotul este stateless - fiecare mesaj este independent.

Agenții: orientați pe obiective, execută acțiuni fără input de la utilizator la fiecare pas

Obiectivul agentului: "Califică și scorează acest lead"

1. Agentul observă: [Date lead din CRM]

2. Agentul raționează: "Trebuie să îmbogățesc datele și să-l scorez"

3. Agentul acționează: Apelează API-ul de enrichment

4. Agentul observă: [Date îmbogățite]

5. Agentul raționează: "Scor 85, alocă reprezentantului de top"

6. Agentul acționează: Actualizează CRM, trimite notificare

7. Gata. Nu este necesar input uman.

Agentul lucrează către un obiectiv definit, luând multiple decizii și apeluri de instrumente autonom.

De ce agenții sunt importanți pentru fluxurile de lucru

Automatizare la scară (gestionează mii de sarcini fără intervenție umană)

Calificarea manuală a lead-urilor: 5 minute per lead × 100 lead-uri = 500 ore/lună. Cost: 10.000 USD/lună (la 20 USD/oră).

Condus de agent: 10 secunde per lead × 100 lead-uri = 16 ore/lună. Cost: 100 USD (apeluri API ale agentului). Economii: 99%.

Agenții multiplică capacitatea echipei tale fără angajări.

Raționament în mai multe etape (împarte problemele complexe în subsarcini)

Sarcinile complexe necesită mai mulți pași:

- Calificarea lead-urilor: Scorează → Îmbogățește → Alocă → Notifică

- Triaj documente: Extrage → Clasifică → Direcționează → Arhivează

- Suport clienți: Înțelege → Caută în baza de cunoștințe → Generează răspuns → Direcționează dacă este nevoie

Agenții gestionează acest raționament automat. Tu definești obiectivul; agentul îl împarte în pași.

Utilizarea instrumentelor (agenții apelează API-uri, baze de date, servicii externe)

Agenții sunt “mâinile”. Apelează API-uri pentru a:

- Interoga baze de date

- Actualiza sisteme CRM

- Trimite e-mailuri sau mesaje Slack

- Apela servicii terțe (enrichment de date, procesare plăți)

Un singur agent poate orchestra 5-10 apeluri de instrumente pentru a finaliza un flux de lucru.

Comportament adaptiv (învață din feedback, ajustează abordarea)

Agenții se pot îmbunătăți în timp. Dacă un agent clasifică greșit documentele, oferi feedback. Agentul învață și își ajustează strategia de prompt.

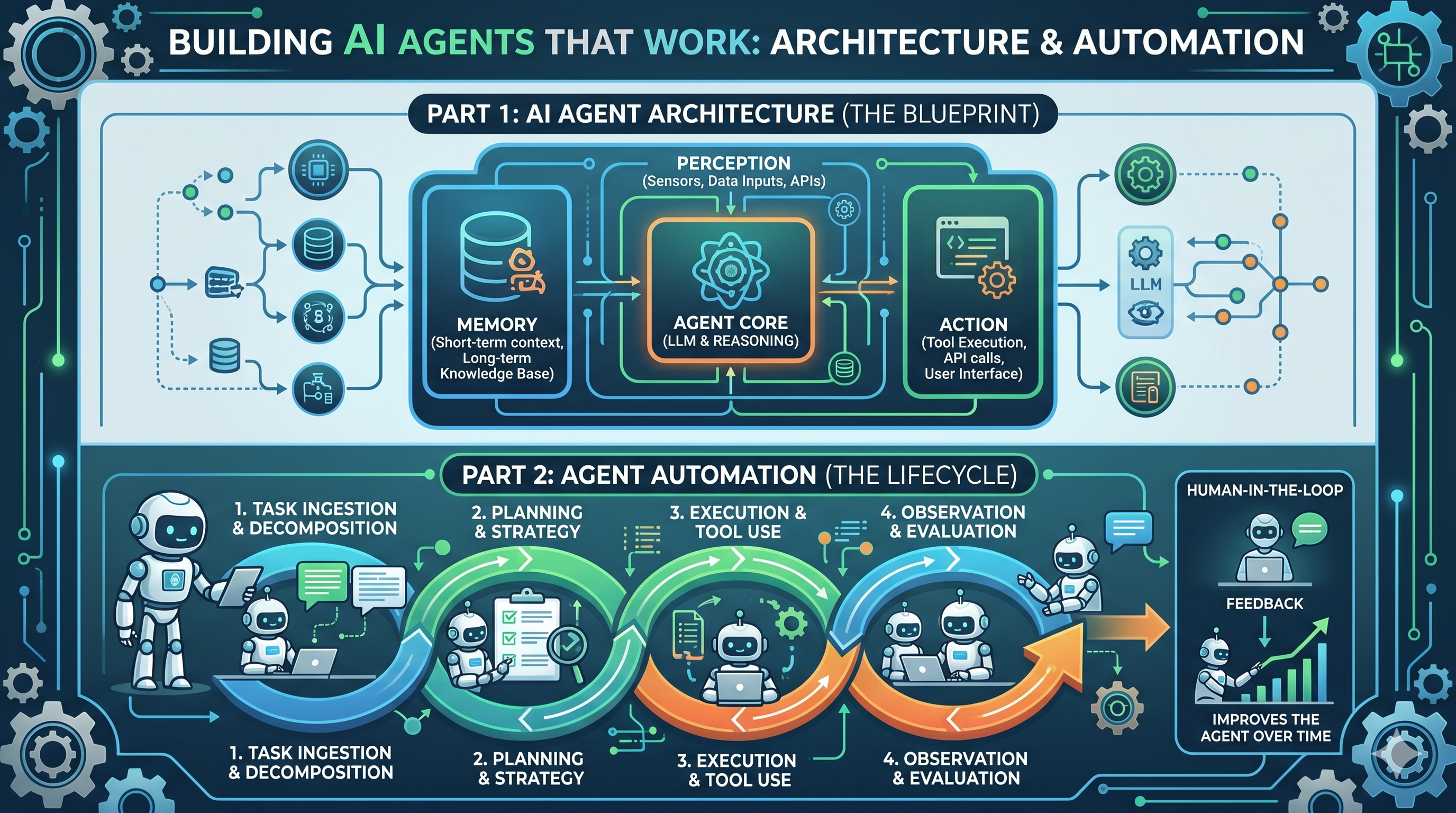

Componentele de bază ale unui agent AI (bucla agentului)

Bucla de raționament a agentului (cu descrierea diagramei)

Nucleul fiecărui agent este o buclă:

┌─────────────────────────────────────────┐

│ START: Agentul primește obiectivul │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ OBSERVĂ: Citește input, rezultate │

│ ale instrumentelor, memorie, │

│ mediu │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ RAȚIONEAZĂ: LLM decide următoarea │

│ acțiune (ce instrument?) │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ ACȚIONEAZĂ: Execută apelul instru- │

│ mentului sau finalizează │

│ sarcina │

└────────────────┬────────────────────────┘

│

▼

┌─────────────────────────────────────────┐

│ FEEDBACK: Evaluează rezultatul, │

│ actualizează memoria, │

│ verifică obiectivul │

└────────────────┬────────────────────────┘

│

├─→ Obiectiv neatins? Înapoi la OBSERVĂ

│

└─→ Obiectiv atins sau max pași? GATA

Observare: agentul percepe starea (input, mediu, rezultate ale instrumentelor)

Agentul citește:

- Input inițial (date lead, text document, întrebare client)

- Rezultate ale instrumentelor din pașii anteriori (răspunsuri API, interogări de bază de date)

- Memorie (istoric conversație, decizii anterioare, bază de cunoștințe)

- Stare curentă (ce s-a făcut, ce mai rămâne)

Raționament: LLM decide următoarea acțiune (planificare, selecție instrument)

LLM-ul primește un prompt precum:

Ești un agent de calificare a lead-urilor. Obiectivul tău este să scorezi și să califici acest lead.

Instrumente disponibile:

1. enrich_lead(lead_id) - Obține date suplimentare despre lead

2. score_lead(lead_data) - Scorează pe baza criteriilor

3. assign_to_sales_rep(lead_id, rep_id) - Alocă lead-ul unui reprezentant

4. send_notification(rep_id, message) - Notifică reprezentantul

Stare curentă:

- Lead ID: 12345

- Companie: Acme Corp

- Venituri: Necunoscute (trebuie îmbogățite)

- Status: Încă nescorat

Ce ar trebui să faci în continuare?

LLM-ul răspunde: “Ar trebui să îmbogățesc lead-ul întâi pentru a obține datele de venituri, apoi să scorez, apoi să aloc.”

Acțiune: execută apelul instrumentului sau fă pasul către obiectiv

Agentul execută instrumentul selectat:

result = enrich_lead(lead_id=12345)

# Returns: {'revenue': '$10M', 'industry': 'SaaS', 'employees': 150}

Feedback: evaluează rezultatul, ajustează strategia dacă este necesar

Agentul verifică: Apelul instrumentului a reușit? Ne-a apropiat de obiectiv? Actualizează memoria și continuă bucla.

Buclă: repetă până obiectivul este atins sau se ating pașii maximi

Agentul repetă observare → raționament → acțiune → feedback până:

- Obiectivul este atins (“Lead scorat și alocat”)

- Se ating pașii maximi (previne buclele infinite)

- Apare o eroare (escaladează către om)

Integrarea instrumentelor (“mâinile” agentului)

Definirea instrumentelor (semnături de funcții, descrieri, parametri)

Instrumentele sunt funcții pe care agentul le poate apela. Definește-le clar:

tools = [

{

"name": "enrich_lead",

"description": "Get additional company data about a lead (revenue, employees, industry)",

"parameters": {

"lead_id": {"type": "string", "description": "Unique identifier of the lead"}

}

},

{

"name": "score_lead",

"description": "Score a lead on a scale of 0-100 based on fit criteria",

"parameters": {

"lead_data": {"type": "object", "description": "Lead information including revenue, industry, etc."}

}

}

]

Descrierile clare ajută LLM-ul să aleagă instrumentul potrivit.

Apelarea instrumentelor (cum selectează și apelează agenții instrumentele)

LLM-ul răspunde cu un apel de instrument:

{

"thought": "I need to enrich this lead to get revenue data",

"action": "enrich_lead",

"action_input": {"lead_id": "12345"}

}

Framework-ul tău de agent execută instrumentul și transmite rezultatul înapoi către LLM.

Gestionarea rezultatelor instrumentelor (parsarea răspunsurilor, recuperarea din erori)

Gestionează atât succesul, cât și eșecul:

def execute_tool(tool_name, tool_input):

try:

if tool_name == "enrich_lead":

result = crm_api.enrich(tool_input['lead_id'])

return {"status": "success", "data": result}

except Exception as e:

return {"status": "error", "message": str(e)}

Dacă un instrument eșuează, agentul ar trebui să încerce o abordare diferită sau să escaladeze către un om.

Sisteme de memorie (ce țin minte agenții)

Memorie pe termen scurt (contextul curent al conversației)

Memoria de lucru a agentului: input curent, rezultate ale instrumentelor, pași de raționament. De obicei stocată în fereastra de context (promptul).

Exemplu: agentul de calificare a lead-urilor ține minte:

- Datele originale ale lead-ului

- Rezultatele enrichment-ului

- Scorul

- Ce reprezentant a fost alocat

Memorie pe termen lung (bază de cunoștințe, interacțiuni anterioare)

Memorie persistentă: decizii anterioare, tipare învățate, bază de cunoștințe.

Cazuri de utilizare:

- Bază de cunoștințe: Agentul preia articole relevante când răspunde la întrebări ale clienților

- Istoric decizii: Agentul învață ce lead-uri au convertit (îmbunătățește scoringul)

- Jurnale interacțiuni: Agentul ține minte interacțiuni anterioare cu un client

Implementează cu baze de date vectoriale (Pinecone, Weaviate) pentru căutare semantică.

Limitări de memorie (constrângerile ferestrei de context)

LLM-urile au ferestre de context finite (4K-128K tokeni). Agenții nu pot ține minte totul. Strategii:

- Sumarizare: Comprimă conversațiile vechi în rezumate

- Retrieval-augmented generation (RAG): Preia doar memoria relevantă când e nevoie

- Memorie ierarhică: Păstrează interacțiunile recente pe termen scurt, cele vechi pe termen lung

Coloana vertebrală a raționamentului (“creierul”)

Selectarea LLM (GPT-4, Claude, modele open source)

- GPT-4: Cel mai bun raționament, gestionează sarcini complexe. Cost: 0,03-0,06 USD per 1K tokeni.

- Claude 3.5 Sonnet: Raționament puternic, context lung (200K tokeni). Cost: 0,003-0,015 USD per 1K tokeni.

- Open source (LLaMA 4): Mai ieftin (0,01-0,03 USD per 1M tokeni), personalizabil, prietenos cu confidențialitatea.

Pentru majoritatea agenților, Claude sau modelele open source sunt suficiente și mai ieftine.

Moduri de raționament (Chain-of-Thought, Tree-of-Thought, Reflexion)

- Chain-of-thought: Agentul gândește pas cu pas. “Trebuie să îmbogățesc → scorez → aloc.”

- Tree-of-thought: Agentul explorează mai multe căi, alege cea mai bună. Mai lent dar mai precis pentru probleme complexe.

- Reflexion: Agentul își critică propria ieșire, încearcă din nou dacă este nevoie. Reduce halucinațiile.

Exemplu de prompt reflexion:

Agent: "Voi aloca acest lead reprezentantului John."

Critic: "Stai, ai verificat dacă John este deja la capacitate maximă?"

Agent: "Bine zis. Verific întâi volumul de muncă al lui John."

Compromisuri: viteză vs. acuratețe

- Agenți rapizi: Raționament single-turn, fără validare a instrumentelor. 2-5 secunde per sarcină. 85% acuratețe.

- Agenți precis: Raționament în mai multe etape, validare, reflexion. 10-30 secunde per sarcină. 95% acuratețe.

Alege viteza pentru timp real (suport clienți). Alege acuratețea pentru mize mari (decizii financiare).

Tipuri de agenți și când să folosești fiecare

Agenți reactivi (simpli, rapizi, stateless)

Cum funcționează (o singură rundă: input → acțiune)

Agenții reactivi iau o singură decizie și acționează. Fără planificare în mai multe etape.

Input: "Care este soldul contului meu?"

→ Agentul interoghează baza de date

→ Agentul răspunde cu soldul

Gata.

Cel mai potrivit pentru: utilizarea simplă a instrumentelor, apeluri API, răspunsuri imediate

- Q&A de suport clienți (căutare comandă, verificare sold)

- Apeluri API simple (vreme, curs acțiuni)

- Răspunsuri imediate necesare (< 2 secunde latență)

Exemplu: chatbot de suport clienți cu căutare în baza de cunoștințe

def customer_service_agent(question):

# 1. Search knowledge base

articles = search_kb(question)

# 2. LLM picks best article

response = llm.complete(f"""

Question: {question}

Relevant articles: {articles}

Provide an answer based on these articles.

""")

# 3. Return response

return response

Latență: 1-3 secunde. Cost: 0,001-0,01 USD per interogare.

Agenți de planificare (orientați pe obiective, raționament în mai multe etape)

Cum funcționează (descompun obiectivul în subsarcini, execută planul)

Agenții de planificare împart obiectivele complexe în pași.

Obiectiv: "Califică și alocă acest lead"

→ Agentul planifică: [îmbogățire, scorare, alocare, notificare]

→ Agentul execută fiecare pas

→ Agentul verifică obiectivul atins

Gata.

Cel mai potrivit pentru: fluxuri complexe, sarcini de cercetare, analiză de date

- Calificarea lead-urilor (îmbogățire → scorare → alocare)

- Procesarea documentelor (extragere → clasificare → stocare)

- Sarcini de cercetare (căutare → rezumare → compilare)

Exemplu: agent de calificare a lead-urilor (scorare → îmbogățire → alocare)

def lead_qualification_agent(lead_id):

lead = crm.get_lead(lead_id)

# Step 1: Enrich

enriched = enrich_lead(lead)

# Step 2: Score

score = score_lead(enriched)

# Step 3: Assign

best_rep = find_best_sales_rep(score)

crm.assign_lead(lead_id, best_rep)

# Step 4: Notify

send_slack(f"New qualified lead assigned to {best_rep}")

return {"lead_id": lead_id, "score": score, "assigned_to": best_rep}

Latență: 5-15 secunde. Cost: 0,02-0,05 USD per lead.

Agenți de învățare (adaptivi, se îmbunătățesc în timp)

Cum funcționează (încorporează feedback, ajustează comportamentul)

Agenții de învățare devin mai buni cu feedback.

Inițial: Agentul clasifică documentul drept "Factură" (60% încredere)

Feedback uman: "De fapt, este o Chitanță"

Agentul învață: Ajustează promptul de clasificare

Data viitoare: Același document clasificat drept "Chitanță" (90% încredere)

Cel mai potrivit pentru: procese de lungă durată, personalizare, optimizare

- Recomandări de conținut (învață preferințele utilizatorilor)

- Direcționare suport clienți (învață ce agenți gestionează cel mai bine fiecare problemă)

- Optimizare prețuri (învață ce prețuri convertesc cel mai bine)

Exemplu: agent de recomandare conținut (învață preferințele utilizatorilor)

def recommendation_agent(user_id):

# Get user history

history = db.get_user_history(user_id)

# LLM recommends based on patterns

recommendation = llm.complete(f"""

User history: {history}

Based on past preferences, what should we recommend?

""")

# Show recommendation, collect feedback

feedback = user_feedback # thumbs up/down

# Store feedback for future recommendations

db.log_feedback(user_id, recommendation, feedback)

return recommendation

În timp, recomandările se îmbunătățesc pe măsură ce agentul învață preferințele utilizatorilor.

Agenți ierarhici (agenți care gestionează alți agenți)

Cum funcționează (agentul supervizor deleagă specialiștilor)

Un agent supervizor coordonează agenți specializați.

Supervizor: "Procesează acest tichet de suport"

├─ Agent clasificator: "Aceasta este o problemă de facturare"

├─ Agent specialist facturare: "Rambursează 50 USD"

└─ Agent notificare: "Trimite e-mail de confirmare"

Cel mai potrivit pentru: fluxuri enterprise, automatizare la scară mare

- Creare conținut (cercetare → scriere → editare → publicare)

- Suport clienți complex (triaj → rezolvare → escaladare)

- Pipeline-uri procesare date (extragere → transformare → încărcare)

Exemplu: pipeline creare conținut (cercetare → scriere → editare → publicare)

def content_pipeline_agent(topic):

# Supervisor delegates

research = research_agent(topic)

draft = writer_agent(research)

edited = editor_agent(draft)

published = publisher_agent(edited)

return {"topic": topic, "status": "published"}

Fiecare agent specializat este optimizat pentru sarcina sa. Supervizorul orchestrează.

Top instrumente și framework-uri pentru agenți AI în 2026 (tabel comparativ)

Criterii de evaluare

Capacitate de raționament (Chain-of-Thought, planificare, reflexion)

Cât de sofisticată este gândirea agentului. Agenții simpli folosesc chain-of-thought. Agenții complecși folosesc planificare și reflexion.

Integrarea instrumentelor (cât de ușor se adaugă instrumente personalizate)

Poți conecta ușor API-uri, baze de date, sisteme CRM? Sau ai nevoie de cod personalizat?

Curba de învățare (timp de setup, calitatea documentației)

Cât de repede poate obține un dezvoltator un agent funcțional? Platformele no-code sunt mai rapide; framework-urile Python mai flexibile.

Model de preț (gratuit, per apel API, abonament)

Unele framework-uri sunt open source (gratuite). Altele percep per apel API sau abonament.

Cele mai bune cazuri de utilizare

Pentru ce este optimizat fiecare instrument?

Tabel comparativ: top instrumente și framework-uri pentru agenți AI (2026)

| Instrument | Tip framework | Capacitate raționament | Integrare instrumente | Curba învățare | Preț | Cel mai potrivit pentru |

|---|---|---|---|---|---|---|

| n8n | Constructor vizual workflow | Chain-of-thought | 500+ integrări | Scăzută | Gratuit + plătit | Utilizatori non-tehnici, setup rapid |

| CrewAI | Framework Python | Planificare + reflexion | Instrumente personalizate (Python) | Medie | Open source | Dezvoltatori, agenți complecși |

| Autogen | Framework Python | Raționament multi-agent | Instrumente personalizate | Ridicată | Open source | Cercetare, sisteme multi-agent |

| LangGraph | Framework Python | Planificare + gestiune stare | Ecosistem LangChain | Medie | Open source | Fluxuri complexe, urmărire stare |

| FlowHunt | Platformă nativă | Chain-of-thought + planificare | Integrări native + API | Scăzută | Abonament | Automatizare fluxuri, ușurință în utilizare |

| Lindy.ai | Platformă no-code | Chain-of-thought | 100+ integrări | Foarte scăzută | Freemium | Non-tehnic, agenți rapizi |

| Gumloop | Platformă no-code | Chain-of-thought | 50+ integrări | Foarte scăzută | Freemium | Automatizare simplă, șabloane |

Diferențe cheie:

- No-code (n8n, FlowHunt, Lindy.ai): Rapide de construit, personalizare limitată. Bune pentru fluxuri standard.

- Framework-uri Python (CrewAI, Autogen, LangGraph): Flexibile, puternice, curbă de învățare mai abruptă. Bune pentru logică complexă.

- Open source (CrewAI, Autogen, LangGraph): Gratuite, dar gestionezi infrastructura. Platformele plătite se ocupă de hosting.

Cum alegi instrumentul potrivit pentru cazul tău de utilizare

- Prototip rapid (< 1 săptămână): Folosește no-code (FlowHunt, n8n, Lindy.ai)

- Agent complex cu logică personalizată: Folosește framework Python (CrewAI, LangGraph)

- Sistem multi-agent (agenți care coordonează): Folosește Autogen

- Automatizare flux în producție: Folosește FlowHunt (gestionat, monitorizat, scalat)

Construirea primului tău agent: arhitectură pas cu pas

Definește obiectivul și sfera agentului

Ce problemă rezolvă?

Fii specific. Greșit: “Automatizează gestionarea lead-urilor.” Corect: “Scorează lead-urile 0-100, îmbogățește cu date despre companie, alocă reprezentanților de vânzări pe baza capacității.”

Care sunt metricile de succes?

- Acuratețe: % decizii corecte (țintă: > 90%)

- Latență: Timpul de finalizare al sarcinii (țintă: < 10 secunde)

- Cost: Apeluri API per sarcină (țintă: < 0,05 USD)

- Rată de automatizare: % sarcini finalizate fără intervenție umană (țintă: > 80%)

Care sunt constrângerile (latență, cost, acuratețe)?

Compromisuri:

- Fluxuri în timp real: Necesită < 5 secunde latență. Folosește modele rapide, mai puține apeluri de instrumente.

- Fluxuri batch: Pot tolera 5-30 minute. Folosește raționament mai precis, mai multe apeluri de instrumente.

- Sensibil la cost: Folosește modele open source, mai puține apeluri API.

- Critic în acuratețe: Folosește modele scumpe (GPT-4), validare în mai multe etape.

Proiectează bucla agentului

Ce va observa agentul?

Date de intrare: date lead, text document, întrebare client, context din memorie.

Ce mod de raționament (chain-of-thought simplu vs. planificare)?

- Chain-of-thought: Rapid, simplu. “Fac pasul 1, apoi pasul 2.”

- Planificare: Mai lent, mai precis. “Hai să planifici întâi toți pașii, apoi să execut.”

De ce instrumente are nevoie?

Listează API-urile, bazele de date, serviciile pe care agentul le va apela.

Exemplu pentru calificarea lead-urilor:

- API CRM (obținere/actualizare lead)

- API enrichment date (obținere date companie)

- Model de scorare (scorează lead)

- Serviciu notificări (trimite Slack/e-mail)

Cum știe când să se oprească?

Definește condiția de succes. “Oprește când lead-ul este scorat și alocat.”

Definește și pași maximi pentru a preveni buclele infinite. “Oprește după 10 pași, indiferent.”

Implementează și testează

Pseudocod sau exemplu real de cod (CrewAI sau FlowHunt)

Exemplu CrewAI:

from crewai import Agent, Task, Crew

# Define agents

enrichment_agent = Agent(

role="Data Enrichment Specialist",

goal="Enrich lead data with company information",

tools=[enrich_tool]

)

scoring_agent = Agent(

role="Lead Scoring Expert",

goal="Score leads based on fit criteria",

tools=[score_tool]

)

assignment_agent = Agent(

role="Sales Manager",

goal="Assign leads to best sales rep",

tools=[assign_tool, notify_tool]

)

# Define tasks

enrich_task = Task(

description="Enrich this lead: {lead_id}",

agent=enrichment_agent

)

score_task = Task(

description="Score the enriched lead",

agent=scoring_agent

)

assign_task = Task(

description="Assign lead to best rep and notify",

agent=assignment_agent

)

# Run crew

crew = Crew(agents=[enrichment_agent, scoring_agent, assignment_agent],

tasks=[enrich_task, score_task, assign_task])

result = crew.kickoff(inputs={"lead_id": "12345"})

Strategie de testare (teste unitare pentru apeluri de instrumente, teste de integrare pentru bucle)

def test_enrichment_tool():

result = enrich_tool("lead_123")

assert result['revenue'] is not None

assert result['employees'] is not None

def test_scoring_agent():

lead = {"company": "Acme", "revenue": "10M", "employees": 50}

score = score_agent(lead)

assert 0 <= score <= 100

def test_full_loop():

result = lead_qualification_agent("lead_123")

assert result['assigned_to'] is not None

assert result['score'] > 0

Depanarea problemelor comune (bucle infinite, halucinații, instrumente greșite)

- Bucle infinite: Adaugă limită de pași. Loghează fiecare pas. Monitorizează acțiuni repetate.

- Halucinații: Adaugă validare. Verifică ieșirile față de datele sursă.

- Instrumente greșite: Îmbunătățește descrierile instrumentelor. Adaugă validare a instrumentului înainte de execuție.

Exemplu real: agent de calificare a lead-urilor

Obiectiv: scorează lead-uri, îmbogățește date, alocă echipei de vânzări

def lead_qualification_agent(lead_id):

"""

Autonomous agent that qualifies leads.

1. Fetches lead from CRM

2. Enriches with company data

3. Scores based on fit criteria

4. Assigns to best sales rep

5. Notifies rep

"""

Instrumente: API CRM, serviciu enrichment date, model de scorare

tools = {

"get_lead": crm.get_lead,

"enrich_lead": enrichment_api.enrich,

"score_lead": scoring_model.score,

"find_best_rep": crm.find_available_rep,

"assign_lead": crm.assign,

"send_notification": slack.send

}

Parcurgere pseudocod (observă lead → scorează → îmbogățește → alocă)

# Step 1: Observe

lead = get_lead(lead_id)

print(f"Observing lead: {lead['company']}")

# Step 2: Reason (LLM decides next action)

# LLM: "I need to enrich this lead first"

# Step 3: Act

enriched = enrich_lead(lead)

print(f"Enriched: revenue={enriched['revenue']}")

# Step 4: Feedback + Loop

# LLM: "Now I'll score"

# Step 5: Act

score = score_lead(enriched)

print(f"Score: {score}")

# Step 6: Reason

# LLM: "Score is {score}, should assign to top rep"

# Step 7: Act

best_rep = find_best_rep(score)

assign_lead(lead_id, best_rep)

send_notification(best_rep, f"New lead: {lead['company']}")

print(f"Assigned to {best_rep}")

Rezultate: metrici de acuratețe, latență, cost

- Acuratețe: 94% (scorul lead-ului se potrivește cu revizuirea manuală)

- Latență: 8 secunde (5 apeluri de instrumente, 3 pași de raționament LLM)

- Cost: 0,03 USD per lead (apeluri API GPT-4 + API enrichment)

- Debit: 450 lead-uri/oră (o singură instanță de agent)

- Rată de automatizare: 87% (13% escaladate către om pentru revizuire)

Integrarea agenților cu sistemele de business

Tipare de integrare API

API-uri REST (cele mai comune)

Majoritatea agenților apelează API-uri REST. Folosește client HTTP standard:

def call_crm_api(endpoint, method="GET", data=None):

url = f"https://api.crm.com/{endpoint}"

headers = {"Authorization": f"Bearer {api_key}"}

if method == "GET":

response = requests.get(url, headers=headers)

elif method == "POST":

response = requests.post(url, json=data, headers=headers)

return response.json()

Webhook-uri (declanșatori de agent bazați pe evenimente)

Declanșează agenți la evenimente (lead nou, e-mail primit, trimitere formular):

@app.post("/webhook/new_lead")

def on_new_lead(lead_data):

# Trigger agent asynchronously

queue.enqueue(lead_qualification_agent, lead_data['id'])

return {"status": "queued"}

Autentificare și securitate (chei API, OAuth, rate limiting)

- Chei API: Stochează în environment variables, nu în cod

- OAuth: Pentru integrări orientate către utilizator (Salesforce, HubSpot)

- Rate limiting: Respectă limitele API. Implementează logică de backoff și retry

from ratelimit import limits, sleep_and_retry

@sleep_and_retry

@limits(calls=100, period=60) # 100 calls per minute

def call_api(endpoint):

return requests.get(f"https://api.example.com/{endpoint}")

Integrarea cu baza de date

Doar citire (agentul interoghează datele)

Agentul citește date despre clienți, interacțiuni trecute, baza de cunoștințe:

def get_customer_history(customer_id):

query = "SELECT * FROM interactions WHERE customer_id = %s"

return db.execute(query, (customer_id,))

Operații de scriere (agentul stochează decizii/rezultate)

Agentul scrie decizii în baza de date:

def store_lead_score(lead_id, score, assigned_to):

db.execute(

"UPDATE leads SET score = %s, assigned_to = %s WHERE id = %s",

(score, assigned_to, lead_id)

)

Tranzacții și consistență (asigurarea integrității datelor)

Folosește tranzacții pentru operații în mai multe etape:

with db.transaction():

score = score_lead(lead)

db.update_lead_score(lead_id, score)

rep = find_best_rep(score)

db.assign_lead(lead_id, rep)

# All-or-nothing: if any step fails, rollback

Integrarea CRM și instrumente de business

Tipare de integrare Salesforce, HubSpot, Pipedrive

Folosește SDK-urile oficiale:

from salesforce import SalesforceAPI

sf = SalesforceAPI(api_key=key)

# Update lead

sf.update_lead(lead_id, {

'score': 85,

'assigned_to': 'john@acme.com',

'status': 'qualified'

})

Integrare Slack, e-mail, Jira (agentul trimite notificări/actualizări)

from slack_sdk import WebClient

slack = WebClient(token=slack_token)

# Notify sales rep

slack.chat_postMessage(

channel="john",

text=f"New qualified lead: {lead['company']} (score: {score})"

)

Autentificare și limitarea permisiunilor

Folosește scopurile OAuth pentru a limita ce pot face agenții:

# Agent can only read leads, update scores

# Cannot delete leads or access sensitive data

oauth_scopes = ["leads:read", "leads:update"]

Fluxuri human-in-the-loop

Când agenții au nevoie de aprobarea umană

Decizii cu risc ridicat: tranzacții financiare, rambursări clienți, excepții de politică.

if decision_risk_score > 0.7:

# Route to human for approval

escalate_to_human(decision, reason="High risk")

else:

# Agent executes decision

execute_decision(decision)

Tipare de escaladare (decizii cu risc ridicat, cazuri limită)

def lead_qualification_with_escalation(lead_id):

score = score_lead(lead_id)

if score > 80:

# High confidence, assign directly

assign_lead(lead_id, best_rep)

elif 50 < score < 80:

# Medium confidence, route to human

escalate_to_human(lead_id, "Review and assign")

else:

# Low score, reject

reject_lead(lead_id)

Bucle de feedback (oamenii corectează greșelile agenților)

@app.post("/feedback/lead_score")

def on_score_feedback(lead_id, actual_score, agent_score):

# Store feedback

db.log_feedback(lead_id, agent_score, actual_score)

# Retrain model on feedback (periodic)

if should_retrain():

retrain_scoring_model()

Eșecuri comune ale agenților și cum să le previi

Bucle infinite (agentul se blochează repetând aceeași acțiune)

Cauză: Definire slabă a obiectivului, instrument care nu face progrese

# Bad: Agent keeps calling same tool

Agentul gândește: "I need to get lead data"

→ Apelează get_lead()

→ Încă nu are date îmbogățite

→ Apelează get_lead() din nou

→ Buclă infinită

Prevenire: limită maximă de pași, urmărirea progresului, diversitatea instrumentelor

max_steps = 10

steps_taken = 0

while steps_taken < max_steps:

action = llm.decide_next_action()

if action == last_action:

# Same action twice, break loop

break

execute_action(action)

steps_taken += 1

Recuperare: timeout, escaladare către om

try:

result = agent.run(timeout=30) # 30 second timeout

except TimeoutError:

escalate_to_human("Agent loop timeout")

Halucinații (agentul inventează fapte sau ieșiri ale instrumentelor)

Cauză: Tendința LLM-ului de a confabula, descrieri slabe ale instrumentelor

# Bad: Agent hallucinates tool output

Agent: "I called enrich_lead, got revenue=$100M"

Realitate: enrich_lead() returned null (API failed)

Agent made up the result

Prevenire: Retrieval-Augmented Generation (RAG), validarea instrumentelor, fact-checking

def execute_tool_safely(tool_name, params):

try:

result = execute_tool(tool_name, params)

# Validate result

if result is None:

return {"error": "Tool returned null"}

if not validate_result(result):

return {"error": "Result failed validation"}

return result

except Exception as e:

return {"error": str(e)}

Folosește RAG pentru a ancora agentul în fapte:

# Instead of: "Summarize this article"

# Use: "Summarize this article, citing specific passages"

knowledge_base = vector_db.search(query)

prompt = f"""

Summarize this article. Only cite specific passages.

Article: {article}

Knowledge base: {knowledge_base}

"""

Recuperare: fallback către om, reîncercare cu raționament diferit

def robust_agent_call(goal, retries=3):

for attempt in range(retries):

try:

result = agent.run(goal)

# Validate result

if validate(result):

return result

except Exception as e:

if attempt == retries - 1:

escalate_to_human(goal)

else:

time.sleep(2 ** attempt) # Backoff

Utilizarea greșită a instrumentelor (agentul apelează instrumentul greșit sau cu parametri greșiți)

Cauză: Descrieri ambigue ale instrumentelor, raționament slab

# Bad: Ambiguous tool description

"update_lead - Update a lead"

# Good: Clear description

"update_lead - Update a lead's score, status, or assigned_to field.

Parameters: lead_id (required), score (0-100), status (qualified/disqualified),

assigned_to (sales rep email)"

Prevenire: documentație clară a instrumentelor, antrenament utilizare instrumente, validare înainte de execuție

# Validate before execution

tool_call = llm.decide_tool_call()

if not validate_tool_call(tool_call):

# Tool call is invalid, ask LLM to fix

llm.correct_tool_call(tool_call)

else:

execute_tool(tool_call)

def validate_tool_call(call):

tool = tools[call['name']]

required_params = tool['required_parameters']

for param in required_params:

if param not in call['params']:

return False

return True

Recuperare: tratarea erorilor, sugerarea instrumentului corect, reîncercare

try:

result = execute_tool(tool_call)

except ToolExecutionError as e:

# Suggest correct tool

correct_tool = suggest_correct_tool(e)

llm.suggest_retry(correct_tool)

Depășiri de cost (agentul folosește prea multe apeluri API)

Cauză: Raționament ineficient, apeluri redundante de instrumente

# Bad: Agent calls same tool multiple times

Agent: "Let me get lead data"

→ Apelează get_lead()

→ Apelează get_lead() din nou (a uitat că deja a făcut-o)

→ Apelează get_lead() a treia oară

Cost: 3x mai mare decât este necesar

Prevenire: limite de buget, deduplicarea apelurilor, caching

budget = {"tokens": 10000, "api_calls": 50}

spent = {"tokens": 0, "api_calls": 0}

def execute_with_budget(action):

global spent

if spent['api_calls'] >= budget['api_calls']:

raise BudgetExceededError()

result = execute_action(action)

spent['api_calls'] += 1

return result

Implementează caching:

cache = {}

def get_lead_cached(lead_id):

if lead_id in cache:

return cache[lead_id]

result = crm_api.get_lead(lead_id)

cache[lead_id] = result

return result

Recuperare: monitorizarea costurilor, throttling, fallback către model mai ieftin

if cost_this_hour > budget_per_hour:

# Switch to cheaper model

switch_to_model("gpt-3.5-turbo") # Cheaper than GPT-4

Probleme de latență (agent prea lent pentru utilizare în timp real)

Cauză: Multiple etape de raționament, răspunsuri lente ale instrumentelor

Un agent care face 5 apeluri API secvențiale de câte 1 secundă fiecare = 5+ secunde latență.

Prevenire: execuție paralelă a instrumentelor, caching, modele mai rapide

# Parallel execution

import asyncio

async def parallel_agent(lead_id):

lead = await get_lead_async(lead_id)

# Call multiple tools in parallel

enrichment, scoring = await asyncio.gather(

enrich_lead_async(lead),

score_lead_async(lead)

)

return (enrichment, scoring)

Folosește modele mai rapide:

# Instead of GPT-4 (slower, more accurate)

# Use GPT-3.5-turbo (faster, still accurate enough)

model = "gpt-3.5-turbo" # 200ms latency vs 500ms for GPT-4

Recuperare: timeout, returnare rezultate parțiale, coadă pentru async

try:

result = agent.run(timeout=5) # 5 second timeout

return result

except TimeoutError:

# Return partial results

return partial_result

# Queue for async completion

queue.enqueue(complete_agent, lead_id)

Măsurarea performanței agentului și a ROI-ului

Metrici cheie de urmărit

Acuratețe (% decizii/acțiuni corecte)

Compară ieșirea agentului cu adevărul de referință (revizuire umană, rezultate reale).

correct = 0

total = 100

for decision in agent_decisions:

if decision == human_review[decision.id]:

correct += 1

accuracy = correct / total * 100 # e.g., 94%

Latență (timpul de finalizare al sarcinii)

Măsoară timpul end-to-end de la input la output.

start = time.time()

result = agent.run(input_data)

latency = time.time() - start # e.g., 8.5 seconds

Cost per sarcină (apeluri API, compute, revizuire umană)

cost = (llm_api_calls * llm_cost) + (tool_calls * tool_cost) + (human_review_rate * hourly_rate)

# e.g., $0.03 per lead

Satisfacția utilizatorului (dacă există human-in-the-loop)

Sondează utilizatorii: “Cât de mulțumit ești cu deciziile agentului?”

Rata de automatizare (% sarcini finalizate fără intervenție umană)

automated = tasks_completed_by_agent

total = all_tasks

automation_rate = automated / total * 100 # e.g., 87%

Calculul ROI

Baseline: costul procesului manual (ore umane × tarif orar)

Manual lead qualification:

- 100 leads/month

- 5 minutes per lead

- 500 hours/month

- $20/hour = $10,000/month

Cost agent: infrastructură + apeluri API + supraveghere umană

Agent-driven:

- 100 leads/month

- $0.03 per lead (API calls)

- $3 total API cost

- $500/month human review (10% escalation)

- $100/month infrastructure

Total: $603/month

Perioada de recuperare: când costul agentului < costul manual

Savings per month: $10,000 - $603 = $9,397

ROI: 1,557% (9,397 / 603)

Payback period: < 1 month (immediate)

Exemplu: ROI agent calificare lead-uri

Manual process:

- 500 leads/month

- 5 min per lead = 2,500 hours = $50,000/month

Agent process:

- 500 leads/month

- $0.03 per lead = $15

- 5% escalation (25 leads) = $250 human time

- Infrastructure = $500

Total: $765/month

Savings: $50,000 - $765 = $49,235/month

ROI: 6,436%

Îmbunătățire continuă

Monitorizează metricile în timp

# Track daily metrics

daily_metrics = {

'accuracy': 0.94,

'latency': 8.5,

'cost_per_task': 0.03,

'automation_rate': 0.87

}

Testează A/B diferite configurări de agent

# Test 1: GPT-4 (more accurate, slower)

# Test 2: GPT-3.5-turbo (faster, slightly less accurate)

# Measure: accuracy, latency, cost

# Choose based on your priorities

Încorporează feedback pentru a îmbunătăți acuratețea

# Collect human feedback on agent mistakes

feedback = db.get_feedback()

# Retrain agent (adjust prompts, add examples)

agent.retrain(feedback)

# Measure: accuracy improves from 94% to 96%

Scalează agenții de succes, retrage-i pe cei slabi

Monitorizează ROI-ul. Dacă un agent nu livrează valoare, retrage-l. Scalează agenții de succes către alte echipe.

Întrebări frecvente

Secțiunea FAQ este redată automat din frontmatter și apare mai jos.

{{ cta-dark-panel heading=“Construiește agenți fără complexitate” description=“Platforma nativă de agenți FlowHunt gestionează integrarea instrumentelor, tratarea erorilor și monitorizarea. Începe să construiești fluxuri de lucru autonome în câteva minute - nu săptămâni.” ctaPrimaryText=“Încearcă FlowHunt gratuit” ctaPrimaryURL=“https://app.flowhunt.io/sign-in" ctaSecondaryText=“Rezervă un demo” ctaSecondaryURL=“https://www.flowhunt.io/demo/" gradientStartColor="#7c3aed” gradientEndColor="#ec4899” gradientId=“cta-ai-agents” }}