Generare Augmentată prin Recuperare (RAG)

Generarea Augmentată prin Recuperare (RAG) este un cadru AI avansat care combină sistemele tradiționale de recuperare a informațiilor cu modele generative mari ...

Reordonarea documentelor rafinează rezultatele căutării recuperate prin prioritizarea documentelor cele mai relevante pentru interogarea unui utilizator, îmbunătățind acuratețea sistemelor AI și RAG.

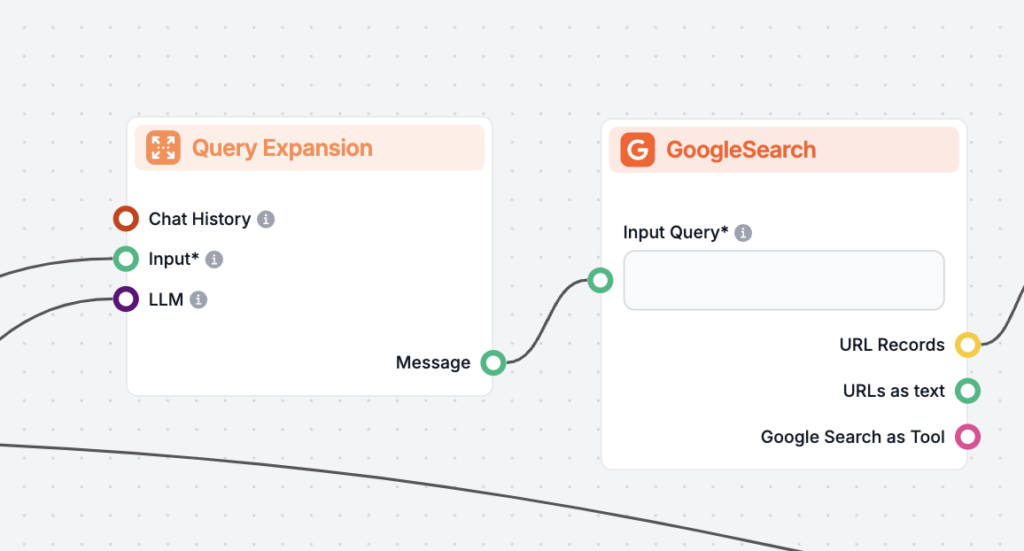

Reordonarea documentelor rearanjează documentele recuperate pe baza relevanței față de interogare, rafinând rezultatele căutării. Extinderea interogării îmbunătățește căutarea prin adăugarea de termeni înrudiți, sporind recall-ul și abordând ambiguitatea. Combinarea acestor tehnici în sistemele RAG crește acuratețea recuperării și calitatea răspunsurilor.

Reordonarea documentelor este procesul de rearanjare a documentelor recuperate pe baza relevanței față de interogarea utilizatorului. După o etapă inițială de recuperare, reordonarea rafinează rezultatele evaluând mai precis relevanța fiecărui document, asigurând prioritatea celor mai pertinente documente.

Generarea Augmentată de Recuperare (RAG) este un cadru avansat care combină capabilitățile modelelor lingvistice mari (LLM) cu sisteme de recuperare a informației. În RAG, când un utilizator trimite o interogare, sistemul recuperează documente relevante dintr-o bază vastă de cunoștințe și transmite aceste informații către LLM pentru a genera răspunsuri informate și precise contextual. Această abordare crește acuratețea și relevanța conținutului generat de AI prin ancorarea sa în date factuale.

Definiție

Extinderea interogării este o tehnică utilizată în recuperarea informațiilor pentru a crește eficacitatea interogărilor de căutare. Aceasta implică completarea interogării originale cu termeni sau expresii suplimentare care sunt semantic înrudite. Scopul principal este de a reduce distanța dintre intenția utilizatorului și limbajul folosit în documentele relevante, îmbunătățind astfel recuperarea informațiilor pertinente.

Cum funcționează

În practică, extinderea interogării poate fi realizată prin diverse metode:

Prin extinderea interogării, sistemul de recuperare poate acoperi o arie mai largă, capturând documente care ar fi putut fi omise din cauza variațiilor de terminologie sau formulare.

Îmbunătățirea recall-ului

Recall-ul se referă la abilitatea sistemului de recuperare de a găsi toate documentele relevante. Extinderea interogării îmbunătățește recall-ul prin:

Abordarea ambiguității interogării

Utilizatorii trimit adesea interogări scurte sau ambigue. Extinderea interogării ajută la:

Îmbunătățirea potrivirii documentelor

Prin includerea unor termeni relevanți suplimentari, sistemul crește șansele de potrivire a interogării cu documente care pot utiliza un vocabular diferit, îmbunătățind astfel eficacitatea generală a procesului de recuperare.

Ce este PRF?

Feedback-ul pseudo-relevant este o metodă automată de extindere a interogării în care sistemul presupune că documentele de top rezultate după o căutare inițială sunt relevante. Extrage termeni semnificativi din aceste documente pentru a rafina interogarea originală.

Cum funcționează PRF

Beneficii și dezavantaje

Valorificarea modelelor lingvistice mari

Odată cu avansul AI, LLM-uri precum GPT-3 și GPT-4 pot genera extinderi sofisticate ale interogărilor, înțelegând contextul și semantica.

Cum funcționează extinderea bazată pe LLM

Exemplu

Interogare originală:

“Care au fost cei mai importanți factori care au contribuit la creșterea veniturilor?”

Răspuns generat de LLM:

“În anul fiscal, mai mulți factori cheie au contribuit la creșterea semnificativă a veniturilor companiei, inclusiv campanii de marketing de succes, diversificarea produselor, inițiative pentru satisfacția clienților, strategii de preț și investiții în tehnologie.”

Interogare extinsă:

“Interogare originală: Care au fost cei mai importanți factori care au contribuit la creșterea veniturilor?

Răspuns ipotetic: [Răspuns generat de LLM]”

Avantaje

Provocări

Proces pas cu pas

Beneficii în sistemele RAG

De ce este necesară reordonarea

Prezentare generală

Cross-encoderele sunt modele de rețea neurală care iau o pereche de input-uri (interogarea și un document) și returnează un scor de relevanță. Spre deosebire de bi-encodere, care encodează separat interogarea și documentul, cross-encoderele le procesează împreună, permițând o interacțiune mai bogată între cele două.

Cum funcționează cross-encoderele

Avantaje

Provocări

Ce este ColBERT?

ColBERT (Contextualized Late Interaction over BERT) este un model de recuperare proiectat pentru a echilibra eficiența cu eficacitatea. Utilizează un mecanism de interacțiune întârziată care permite o comparație detaliată între token-urile interogării și ale documentului, fără costuri computaționale ridicate.

Cum funcționează ColBERT

Avantaje

Cazuri de utilizare

Prezentare generală

FlashRank este o bibliotecă de reordonare rapidă și ușoară ce utilizează cross-encodere de ultimă generație. Este proiectată pentru integrare facilă în fluxurile existente și pentru a îmbunătăți performanța reordonării cu un overhead minim.

Caracteristici

Exemplu de utilizare

from flashrank import Ranker, RerankRequest

query = 'Care au fost cei mai importanți factori care au contribuit la creșterea veniturilor?'

ranker = Ranker(model_name="ms-marco-MiniLM-L-12-v2")

rerank_request = RerankRequest(query=query, passages=documents)

results = ranker.rerank(rerank_request)

Beneficii

Proces

Considerații

Tehnici complementare

Beneficiile combinării

Flux de lucru exemplu

Extinderea interogării cu LLM:

def expand_query(query):

prompt = f"Provide additional related queries for: '{query}'"

expanded_queries = llm.generate(prompt)

expanded_query = ' '.join([query] + expanded_queries)

return expanded_query

Recuperarea inițială:

documents = vector_db.retrieve_documents(expanded_query)

Reordonarea documentelor:

from sentence_transformers import CrossEncoder

cross_encoder = CrossEncoder('cross-encoder/ms-marco-MiniLM-L-6-v2')

pairs = [[query, doc.text] for doc in documents]

scores = cross_encoder.predict(pairs)

ranked_docs = [doc for _, doc in sorted(zip(scores, documents), reverse=True)]

Selectarea documentelor de top:

top_documents = ranked_docs[:top_k]

Generarea răspunsului cu LLM:

context = '\n'.join([doc.text for doc in top_documents])

prompt = f"Answer the following question using the context provided:\n\nQuestion: {query}\n\nContext:\n{context}"

response = llm.generate(prompt)

Monitorizare și optimizare

Scenariu

O companie utilizează un chatbot AI pentru a gestiona întrebările clienților despre produse și servicii. Clienții adresează adesea întrebări în moduri diferite, folosind termeni sau expresii variate.

Provocări

Implementare

Beneficii

Scenariu

Cercetătorii folosesc un asistent AI pentru a găsi articole academice, date și perspective relevante pentru munca lor.

Provocări

Implementare

Reordonarea documentelor este procesul de rearanjare a documentelor recuperate după o căutare inițială pe baza relevanței față de interogarea unui utilizator. Asigură prioritatea celor mai relevante și utile documente, îmbunătățind calitatea căutărilor și chatbot-urilor alimentate de inteligență artificială.

În sistemele RAG, reordonarea documentelor utilizează modele precum cross-encoders sau ColBERT pentru a evalua relevanța fiecărui document față de interogarea utilizatorului, după o recuperare inițială. Această etapă ajută la rafinarea și optimizarea setului de documente oferite modelelor lingvistice mari pentru generarea de răspunsuri precise.

Extinderea interogării este o tehnică în recuperarea informațiilor care completează interogarea originală a utilizatorului cu termeni sau expresii înrudite, crescând recall-ul și abordând ambiguitatea. În sistemele RAG, ajută la recuperarea unor documente mai relevante care pot utiliza o terminologie diferită.

Metodele cheie includ modele neuronale cross-encoder (care encodează împreună interogarea și documentul pentru o scorare de mare precizie), ColBERT (care utilizează interacțiune întârziată pentru o scorare eficientă) și biblioteci precum FlashRank pentru reordonare rapidă și precisă.

Extinderea interogării lărgește căutarea pentru a recupera mai multe documente potențial relevante, în timp ce reordonarea documentelor filtrează și rafinează aceste rezultate pentru a se asigura că doar cele mai pertinente documente sunt transmise AI-ului pentru generarea răspunsului, maximizând atât recall-ul, cât și precizia.

Descoperă cum reordonarea documentelor și extinderea interogărilor pot îmbunătăți acuratețea și relevanța chatbot-urilor și fluxurilor tale AI. Construiește AI mai inteligente cu FlowHunt.

Generarea Augmentată prin Recuperare (RAG) este un cadru AI avansat care combină sistemele tradiționale de recuperare a informațiilor cu modele generative mari ...

Descoperă principalele diferențe dintre Generarea augmentată prin regăsire (RAG) și Generarea augmentată prin cache (CAG) în inteligența artificială. Află cum R...

Evaluarea documentelor în Retrieval-Augmented Generation (RAG) este procesul de evaluare și clasificare a documentelor pe baza relevanței și calității lor ca ră...