Transformatoare

Transformatoarele reprezintă o arhitectură revoluționară de rețele neuronale care a transformat inteligența artificială, în special procesarea limbajului natura...

Transformerele sunt rețele neuronale care folosesc mecanisme de atenție pentru a procesa eficient date secvențiale, excelând în NLP, recunoaștere vocală, genomică și multe altele.

Un model transformer este un tip de rețea neuronală proiectată special pentru a gestiona date secvențiale, cum ar fi textul, vorbirea sau datele de tip time-series. Spre deosebire de modelele tradiționale precum Recurrent Neural Networks (RNN) și Convolutional Neural Networks (CNN), transformerele utilizează un mecanism cunoscut sub numele de „atenție” sau „self-attention” pentru a evalua importanța diferitelor elemente din secvența de intrare. Acest lucru permite modelului să capteze dependențe și relații pe termen lung în cadrul datelor, făcându-l extrem de puternic pentru o gamă largă de aplicații.

În centrul unui model transformer se află mecanismul de atenție, care permite modelului să se concentreze asupra diferitelor părți ale secvenței de intrare atunci când face predicții. Acest mecanism evaluează relevanța fiecărui element din secvență, permițând modelului să surprindă modele și dependențe complexe pe care modelele tradiționale le-ar putea rata.

Self-attention este o formă specială de atenție folosită în cadrul transformerelelor. Permite modelului să ia în considerare întreaga secvență de intrare simultan, în loc să o proceseze secvențial. Această capacitate de procesare paralelă nu doar că îmbunătățește eficiența computațională, dar sporește și abilitatea modelului de a înțelege relații complexe în date.

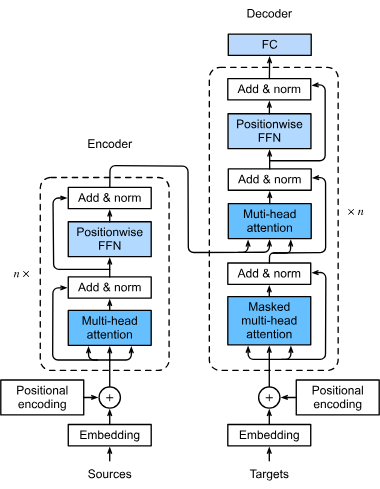

Un model transformer tipic este compus dintr-un encoder și un decoder:

Atât encoderul, cât și decoderul sunt compuse din mai multe straturi de self-attention și rețele neuronale feedforward, suprapuse pentru a crea un model profund și puternic.

Transformerele au devenit coloana vertebrală a sarcinilor moderne de NLP. Ele sunt folosite în:

Transformerele permit traducerea și transcrierea vorbirii în timp real, făcând întâlnirile și sălile de clasă mai accesibile pentru participanții diverși și cu deficiențe de auz.

Prin analizarea secvențelor de gene și proteine, transformerele accelerează ritmul proiectării de medicamente și al medicinei personalizate.

Transformerele pot identifica modele și anomalii în seturi mari de date, fiind de neînlocuit pentru detectarea activităților frauduloase și generarea de recomandări personalizate în comerțul electronic și serviciile de streaming.

Transformerele beneficiază de un ciclu virtuos: pe măsură ce sunt utilizate în diverse aplicații, generează cantități vaste de date, care pot fi apoi folosite pentru a antrena modele și mai precise și mai puternice. Acest ciclu de generare a datelor și de îmbunătățire a modelelor continuă să avanseze stadiul AI-ului, conducând la ceea ce unii cercetători numesc „era AI-ului bazat pe transformere”.

Spre deosebire de RNN-uri, care procesează datele secvențial, transformerele procesează întreaga secvență simultan, permițând o paralelizare și o eficiență mai mare.

Deși CNN-urile sunt excelente pentru date de tip imagine, transformerele excelează în gestionarea datelor secvențiale, oferind o arhitectură mai versatilă și mai puternică pentru o gamă mai largă de aplicații.

Un model transformer este o arhitectură de rețea neuronală proiectată pentru a procesa date secvențiale utilizând un mecanism de atenție, permițând captarea relațiilor și dependențelor din date în mod eficient.

Spre deosebire de RNN, care procesează datele secvențial, transformerele procesează întreaga secvență de intrare simultan, oferind o eficiență sporită. În timp ce CNN-urile sunt potrivite pentru date de tip imagine, transformerele excelează în gestionarea datelor secvențiale, cum ar fi textul și vorbirea.

Transformerele sunt utilizate pe scară largă în procesarea limbajului natural, recunoaștere și sinteză a vorbirii, genomică, descoperirea de medicamente, detectarea fraudei și sisteme de recomandare datorită capacității lor de a gestiona date secvențiale complexe.

Încearcă FlowHunt pentru a crea chatboți și instrumente AI personalizate, valorificând modele avansate precum transformerele pentru nevoile afacerii tale.

Transformatoarele reprezintă o arhitectură revoluționară de rețele neuronale care a transformat inteligența artificială, în special procesarea limbajului natura...

Un Transformator Generativ Pre-antrenat (GPT) este un model AI care utilizează tehnici de învățare profundă pentru a produce texte ce imită îndeaproape scrierea...

Descoperă modelarea secvențelor în AI și învățarea automată—prezicerea și generarea secvențelor de date precum text, audio și ADN folosind RNN, LSTM, GRU și Tra...