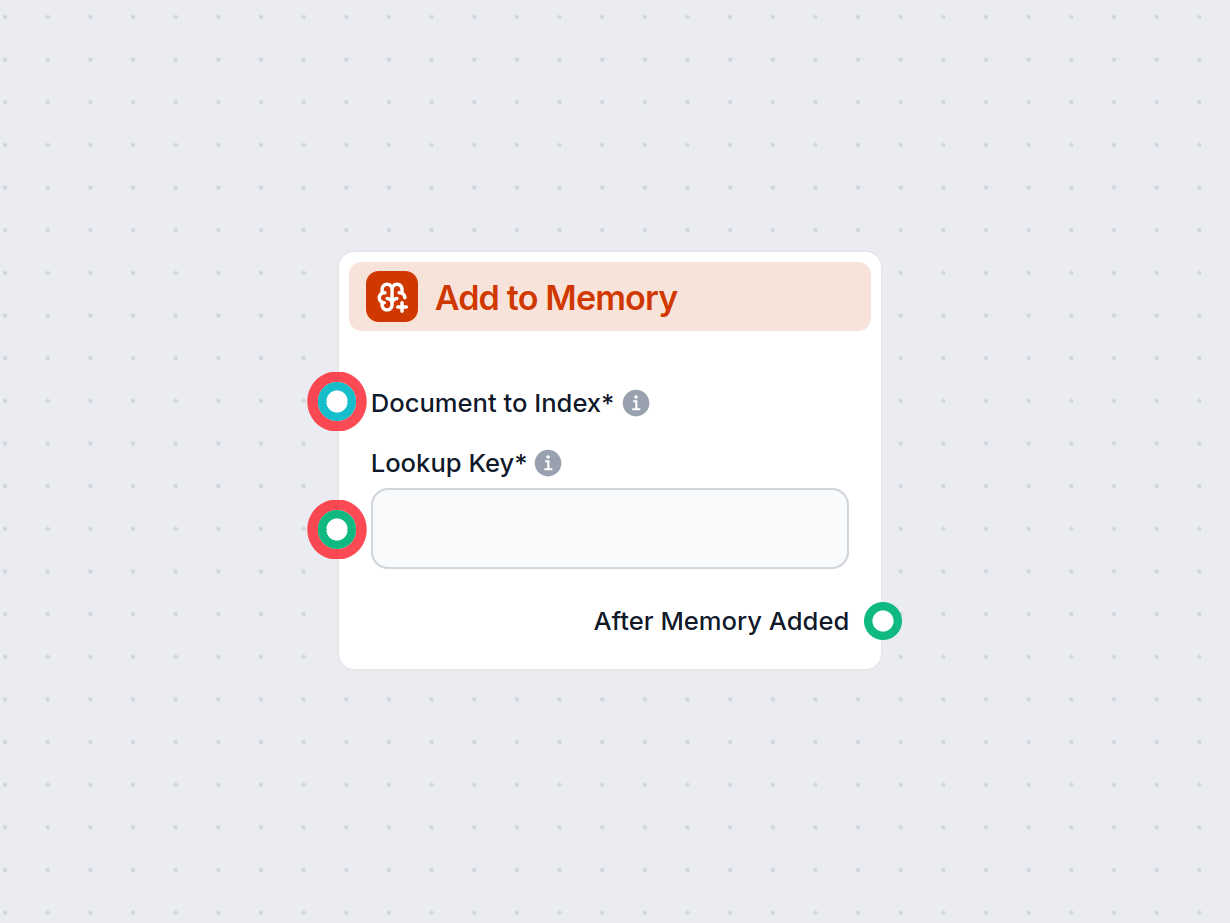

Lägg till i minnet

Lagra enkelt viktig information i ditt arbetsflöde med komponenten Lägg till i minnet. Spara smidigt data eller dokument i långtidsminnet, kategoriserade med an...

Associativt minne gör det möjligt för AI-system att hämta information baserat på inmatningsmönster och associationer, vilket stöder uppgifter som mönsterigenkänning och möjliggör mer människoliknande interaktioner.

Associativt minne inom artificiell intelligens (AI) avser en typ av minnesmodell som gör det möjligt för system att återkalla information baserat på mönster och associationer snarare än explicita adresser eller nycklar. Istället för att hämta data genom dess exakta plats tillåter associativt minne AI-system att komma åt information genom att matcha inmatningsmönster mot lagrade mönster, även när inmatningen är ofullständig eller brusig. Denna förmåga gör associativt minne särskilt värdefullt i AI-applikationer där mönsterigenkänning, dataåtervinning och inlärning från erfarenhet krävs.

Associativt minne jämförs ofta med hur den mänskliga hjärnan återkallar information. När du tänker på ett begrepp utlöses relaterade minnen eller idéer. På liknande sätt gör associativt minne inom AI det möjligt för system att hämta lagrad data som är mest associerad med en given inmatning, vilket underlättar mer människoliknande interaktioner och beslutsprocesser.

I AI-sammanhang manifesterar sig associativt minne i olika former, inklusive innehållsadresserbara minnesnätverk, Hopfield-nätverk och modeller för bidirektionellt associativt minne (BAM). Dessa modeller är avgörande för uppgifter som mönsterigenkänning, maskininlärning och utveckling av intelligent beteende hos AI-agenter, inklusive chattbottar och automatiseringsverktyg.

Den här artikeln fördjupar sig i begreppet associativt minne inom AI, utforskar vad det är, hur det används samt ger exempel och användningsfall för att illustrera dess betydelse i moderna AI-applikationer.

Associativt minne är en minnesmodell som möjliggör lagring och hämtning av data baserat på innehållet i informationen snarare än dess specifika adress. I traditionella datorminnessystem (som RAM) nås data genom att ange exakta minnesadresser. I kontrast tillåter associativt minne dataåtervinning genom att matcha inmatningsmönster mot lagrade mönster, vilket effektivt innebär att minnet adresseras via sitt innehåll.

Inom AI är associativa minnesmodeller utformade för att efterlikna hjärnans förmåga att återkalla information genom associationer. Det innebär att när systemet får en delvis eller brusig inmatning kan det hämta det kompletta eller närmaste matchande lagrade mönstret. Associativt minne är i grunden innehållsadresserbart och erbjuder robusta och effektiva mekanismer för dataåtervinning.

Associativt minne kan grovt delas in i två typer:

Innehållsadresserbart minne är en form av associativt minne där dataåtervinning sker baserat på innehåll snarare än adress. CAM-hårdvaruenheter är utformade för att jämföra inmatade sökdata mot en tabell av lagrad data och returnera adressen där matchande data finns. Inom AI tillämpas CAM-principer i neurala nätverk för att möjliggöra associativ inlärning och minnesfunktioner.

För att förstå associativt minne i AI krävs också en utforskning av de tekniska implementationerna och modellerna som gör det möjligt. Nedan följer några av de viktigaste modellerna och begreppen.

Hopfield-nätverk har begränsningar vad gäller antalet mönster de kan lagra utan fel. Minneskapaciteten är ungefär 0,15 gånger antalet neuroner i nätverket. Överskrids denna gräns försämras nätverkets förmåga att hämta korrekta mönster.

Associativa minnesmodeller har inneboende begränsningar avseende antalet mönster de kan lagra och hämta korrekt. Faktorer som påverkar kapaciteten inkluderar:

Associativt minne förbättrar AI-automatisering och chattbotfunktionalitet genom att möjliggöra mer intuitiva och effektiva dataåtervinnings- och interaktionsmöjligheter.

Chattbottar med associativt minne kan ge mer kontextuellt relevanta och korrekta svar genom att:

En kundtjänstchattbot använder associativt minne för att matcha användarfrågor mot lagrade lösningar. Om en kund beskriver ett problem med stavfel eller ofullständig information kan chattbotten ändå hämta relevant lösning baserat på mönsterassociationer.

Associativt minne inom AI avser artificiella systems förmåga att återkalla och relatera information på ett sätt som liknar mänskligt minne. Det spelar en avgörande roll för att förbättra generalisering och anpassningsbarhet hos AI-modeller. Flera forskare har undersökt detta koncept och dess tillämpningar inom AI.

A Brief Survey of Associations Between Meta-Learning and General AI av Huimin Peng (Publicerad: 2021-01-12) – Denna artikel ger en översikt över meta-lärandets historia och dess bidrag till generell AI, med särskilt fokus på utvecklingen av associativa minnesmoduler. Meta-lärande förbättrar AI-modellers generaliseringsförmåga, vilket gör dem tillämpliga för olika uppgifter. Studien belyser meta-lärandets roll i utformningen av generella AI-algoritmer, som ersätter uppgiftsspecifika modeller med anpassningsbara system. Den diskuterar även kopplingar mellan meta-lärande och associativt minne och ger insikter i hur minnesmoduler kan integreras i AI-system för förbättrad prestanda. Läs mer.

Shall androids dream of genocides? How generative AI can change the future of memorialization of mass atrocities av Mykola Makhortykh m.fl. (Publicerad: 2023-05-08) – Även om artikeln inte direkt fokuserar på associativt minne undersöker den hur generativ AI förändrar minnespraktiker. Den diskuterar de etiska implikationerna och potentialen för AI att skapa nya narrativ, vilket relaterar till associativt minnets roll i att förbättra AI:s förståelse och tolkning av historiskt innehåll. Studien väcker frågor om AI:s förmåga att särskilja mellan mänskligt och maskinellt genererat innehåll, vilket anknyter till utmaningarna med att utveckla AI-system med associativt minne. Läs mer.

No AI After Auschwitz? Bridging AI and Memory Ethics in the Context of Information Retrieval of Genocide-Related Information av Mykola Makhortykh (Publicerad: 2024-01-23) – Denna forskning undersöker de etiska utmaningarna med att använda AI för informationsåtervinning relaterad till kulturarv, inklusive folkmord. Den lyfter fram vikten av associativt minne för att etiskt kurera och återhämta känslig information. Artikeln skisserar en ram inspirerad av Belmont-kriterier för att hantera dessa utmaningar och föreslår sätt för AI-system att etiskt hantera och återvinna associativt minne kopplat till historiska händelser. Studien ger insikter i hur AI-teknik kan förenas med minnesetik, vilket är avgörande för att utveckla ansvarsfulla AI-system. Läs mer.

Associativt minne inom AI avser en minnesmodell som gör det möjligt för system att återkalla information baserat på mönster och associationer istället för explicita adresser. Detta gör att AI kan hämta data genom mönsterigenkänning, även med ofullständig eller brusig inmatning, likt hur mänskligt minne fungerar.

Det finns två huvudtyper: autoassociativt minne, som återkallar ett komplett mönster från en delvis eller brusig inmatning av samma mönster, och heteroassociativt minne, som associerar olika in- och utmatningsmönster för uppgifter som översättning.

Chattbottar med associativt minne kan minnas tidigare interaktioner, matcha mönster i användarfrågor och korrigera fel, vilket möjliggör kontextuellt relevanta och korrekta svar även vid ofullständig eller felstavad inmatning.

Fördelarna inkluderar feltolerans, parallell sökning, adaptiv inlärning och biologiskt inspirerade mekanismer. Begränsningarna innefattar begränsad minneskapacitet, beräkningskomplexitet och utmaningar vid skalning för stora datamängder.

Smarta chattbottar och AI-verktyg under ett och samma tak. Koppla samman intuitiva block för att förvandla dina idéer till automatiserade Flows.

Lagra enkelt viktig information i ditt arbetsflöde med komponenten Lägg till i minnet. Spara smidigt data eller dokument i långtidsminnet, kategoriserade med an...

Upptäck de viktigaste skillnaderna mellan Retrieval-Augmented Generation (RAG) och Cache-Augmented Generation (CAG) inom AI. Lär dig hur RAG dynamiskt hämtar re...

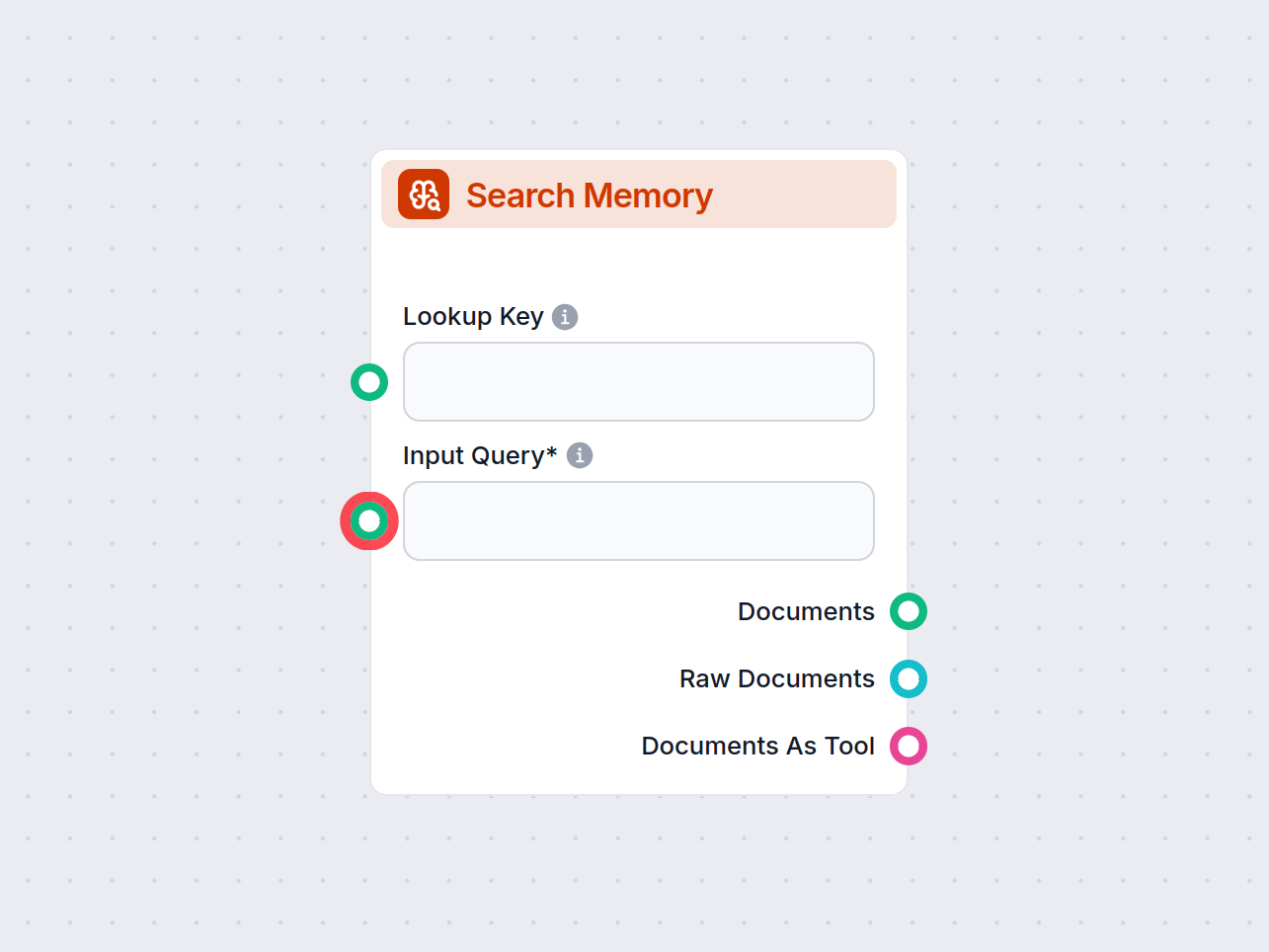

Lås upp kraften i ditt arbetsflöde med komponenten Sökminne – hämta relevant information från lagrat minne med användarfrågor. Sök, filtrera och extrahera dokum...