Textsammanfattning

Textsammansfattning är en grundläggande AI-process som kondenserar långa dokument till koncisa sammanfattningar och bevarar viktig information och mening. Genom...

Korreferensupplösning länkar uttryck till samma enhet i texten, vilket gör att maskiner kan förstå kontext och lösa tvetydigheter för förbättrade NLP-applikationer.

Korreferensupplösning är en grundläggande uppgift inom naturlig språkbehandling (NLP) som innebär att identifiera och länka uttryck i en text som refererar till samma enhet. Det avgör när två eller fler ord eller fraser i en text syftar på samma sak eller person. Denna process är avgörande för att maskiner ska kunna förstå och tolka text på ett sammanhängande sätt, eftersom människor naturligt uppfattar sambandet mellan pronomen, namn och andra refererande uttryck.

Korreferensupplösning är en integrerad komponent i NLP-applikationer, såsom dokumentsammanfattning, frågesvarssystem, maskinöversättning, sentimentanalys och informationsutvinning. Den spelar en nyckelroll för att förbättra maskinens förmåga att bearbeta och förstå mänskligt språk genom att lösa tvetydigheter och ge kontext.

Viktiga punkter:

Korreferensupplösning används i olika NLP-uppgifter och bygger broar mellan människa och dator. Upptäck dess nyckelaspekter, funktion och tillämpningar redan idag! Nyckeltillämpningar inkluderar:

Trots sin betydelse innebär korreferensupplösning flera utmaningar:

Flera tekniker används för att lösa korreferensproblem:

Flera avancerade modeller och system används för korreferensupplösning:

Att utvärdera prestandan hos korreferensupplösningssystem omfattar flera mått:

Framtiden för korreferensupplösning omfattar flera lovande områden:

Korreferensupplösning är en avgörande aspekt av NLP och överbryggar klyftan mellan maskinell förståelse och mänsklig kommunikation genom att lösa referenser och tvetydigheter i språket. Dess tillämpningar är omfattande och varierade, och påverkar områden från AI-automation till chattbottar, där förståelse för mänskligt språk är avgörande.

Korreferensupplösning är en central uppgift inom naturlig språkbehandling (NLP) som innebär att avgöra när två eller fler uttryck i en text refererar till samma enhet. Denna uppgift är avgörande för olika tillämpningar, inklusive informationsutvinning, textsammanfattning och frågesvar.

Nya forskningshöjdpunkter:

Att dela upp eventkorreferensupplösning i hanterbara problem:

Ahmed et al. (2023) föreslår ett nytt tillvägagångssätt för eventkorreferensupplösning (ECR) genom att dela upp problemet i två hanterbara deluppgifter. Traditionella metoder har svårt med snedfördelningen mellan korreferenta och icke-korreferenta par samt den beräkningsmässiga komplexiteten hos kvadratiska operationer. Deras metod introducerar en heuristik för att effektivt filtrera bort icke-korreferenta par samt en balanserad träningsmetod, vilket ger resultat jämförbara med de mest avancerade modellerna samtidigt som beräkningskraven minskar. Studien utforskar även utmaningarna med att korrekt klassificera svåra omnämndepar.

Läs mer

Integrering av kunskapsbaser inom kemiområdet:

Lu och Poesio (2024) tar upp korreferens- och bryggupplösning i kemipatent genom att integrera extern kunskap i en multitask-lärande modell. Deras studie understryker vikten av domänspecifik kunskap för att förstå kemiska processer och visar att sådan kunskapsintegration förbättrar både korreferens- och bryggupplösning. Denna forskning belyser potentialen i domänanpassning för att förbättra NLP-uppgifter.

Korreferensupplösning i dialogrelationsutvinning:

Xiong et al. (2023) utökar det befintliga DialogRE-datasetet till DialogRE^C+ och fokuserar på hur korreferensupplösning hjälper till i dialogrelationsutvinning (DRE). Genom att införa korreferenskedjor i DRE-scenariot förbättrar de argumentrelationsresonemanget. Datasetet innehåller manuella annoteringar av 5 068 korreferenskedjor av olika typer, såsom talar- och organisationskedjor. Författarna utvecklar grafbaserade DRE-modeller som drar nytta av korreferenskunskap och visar på förbättrad prestanda vid utvinning av relationer från dialoger. Detta arbete belyser den praktiska tillämpningen av korreferensupplösning i komplexa dialogsituationer.

Dessa studier representerar betydande framsteg inom korreferensupplösning och visar på innovativa metoder och tillämpningar som bemöter utmaningarna i denna komplexa NLP-uppgift.

Korreferensupplösning är processen att identifiera när två eller fler uttryck i en text refererar till samma enhet, till exempel att länka pronomen till de substantiv de syftar på. Det är avgörande för maskinell förståelse och sammanhängande tolkning av språk.

Korreferensupplösning används i dokumentsammanfattning, frågesystem, maskinöversättning, sentimentanalys och konversationsbaserad AI för att förbättra maskiners förståelse och kontextspårning.

Tekniker inkluderar regelbaserade metoder, maskininlärningsmodeller, djupinlärning (som transformerarkitekturer), filterbaserade metoder, entitetscentrerade och hybrida system som kombinerar flera metoder.

Utmaningar omfattar tvetydighet i referenser, varierande uttryck för enheter, kontextuella nyanser, diskursnivå-tvetydigheter och språkberoende komplexitet.

Noterbara system inkluderar Stanford CoreNLP, BERT-baserade modeller och ordnivå-korreferensupplösningssystem, som alla erbjuder olika tillvägagångssätt för att länka enheter i text.

Smarta chattbottar och AI-verktyg under ett och samma tak. Koppla intuitiva block för att förvandla dina idéer till automatiserade Flows.

Textsammansfattning är en grundläggande AI-process som kondenserar långa dokument till koncisa sammanfattningar och bevarar viktig information och mening. Genom...

Förbättrad dokumentsökning med NLP integrerar avancerade tekniker för naturlig språkbehandling i dokumentsökningssystem, vilket ökar noggrannhet, relevans och e...

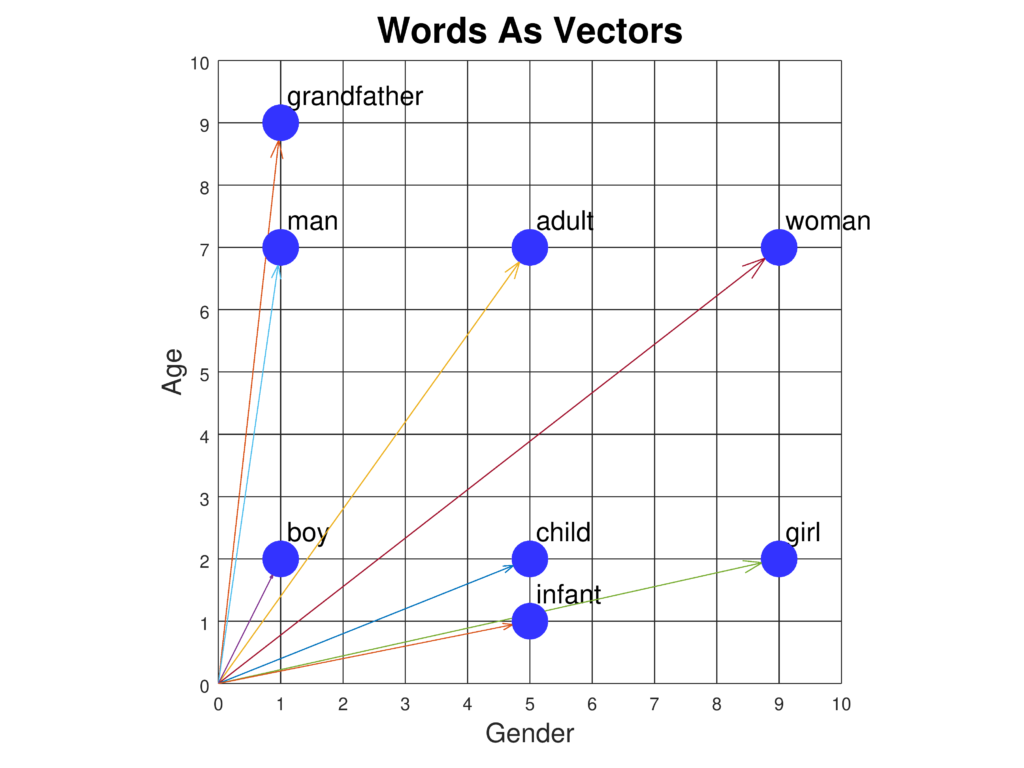

Ord-inbäddningar är sofistikerade representationer av ord i ett kontinuerligt vektorrum som fångar semantiska och syntaktiska relationer för avancerade NLP-uppg...