Fönstring

Fönstring inom artificiell intelligens syftar på att bearbeta data i segment eller “fönster” för att effektivt analysera sekventiell information. Avgörande inom...

Dependency parsing analyserar den grammatiska strukturen i meningar genom att identifiera ordberoenden, vilket driver viktiga NLP-applikationer som översättning, sentimentanalys och mycket mer.

Dependency Parsing är en syntaktisk analysmetod som används inom Natural Language Processing (NLP) för att förstå den grammatiska strukturen i en mening. Det innebär att man identifierar beroenden, eller grammatiska relationer, mellan ord i en mening och bildar en trädliknande struktur där huvudverbet ofta fungerar som rot. Detta tillvägagångssätt är avgörande för att fastställa funktionen hos varje ord, såsom subjekt, objekt och modifierare, inom en mening. På så sätt möjliggör det för maskiner att förstå meningsstrukturen mer effektivt, vilket är viktigt för olika NLP-applikationer.

Huvud och beroende:

Varje beroenderelation består av ett huvud och ett beroende. Huvudet är den centrala delen i relationen, medan det beroende ordet modifierar eller kompletterar huvudet. Till exempel, i ”morning flight” är ”flight” huvudet och ”morning” beroendet.

Beroendeträd:

Denna grafiska representation belyser den syntaktiska strukturen av en mening. Noder representerar ord, och riktade kanter (bågar) illustrerar beroenderelationerna mellan dem. Vanligtvis är roten huvudverbet eller ett ord som förenar meningen.

Beroenderelationer:

Dessa är etiketter som kategoriserar ordens roller i deras relationer. Vanliga beroendetaggar inkluderar nsubj (nominalt subjekt), dobj (direkt objekt) och amod (adjektivmodifierare), vilka klargör varje ords grammatiska funktion i förhållande till andra.

Projektivitet:

En egenskap hos beroendeträd där om det finns en väg från huvudet till varje ord mellan huvudet och beroendet i meningen, är bågen projektiv. Träd är projektiva när alla bågar är projektiva, vilket innebär att inga kanter korsar varandra när trädet avbildas ovanför meningen.

Icke-projektiva träd:

Dessa uppstår när minst en båge är icke-projektiv, vilket indikerar en mer komplex meningsstruktur, ofta förekommande i språk med flexibel ordföljd.

Dependency parsing kan utföras med hjälp av olika NLP-verktyg och bibliotek, såsom spaCy, NLTK med Stanford CoreNLP och Stanza. Dessa verktyg använder förtränade modeller för att parsa meningar och generera beroendeträd, vilket hjälper användare att visualisera och analysera den syntaktiska strukturen i textdata.

spaCy:

Ett öppen källkods-bibliotek som erbjuder ett snabbt och effektivt sätt att parsa meningar. Det inkluderar displaCy, en inbyggd visualiserare för dependency-träd.

NLTK och Stanford CoreNLP:

Denna kombination möjliggör omfattande parsing med hjälp av ett Java-baserat bibliotek och skapar dependency-träd som kan visualiseras med NetworkX eller GraphViz.

Stanza:

Utvecklat av Stanford NLP Group, erbjuder Stanza en pipeline baserad på neurala nätverk för NLP-uppgifter, inklusive dependency parsing.

Maskinöversättning:

Förbättrar förståelsen av källspråkets struktur och betydelse för att skapa korrekta översättningar till målspråket.

Sentimentanalys:

Genom att analysera beroenderelationer kan man identifiera sentiment kopplat till specifika delar av en mening, vilket förbättrar noggrannheten i sentimentdetektering.

Informationsutvinning:

Underlättar utvinning av specifik information från text genom att identifiera och förstå de grammatiska rollerna hos ord.

Textsamanfattning:

Hjälper till att identifiera nyckelmeningar och fraser i en text, vilket möjliggör koncis sammanfattning.

Frågesvarssystem:

Förbättrar förståelsen av frågor genom att analysera ordbindningar, vilket underlättar framtagandet av korrekta svar från en korpus.

Medan dependency parsing fokuserar på relationer mellan ord, syftar constituency parsing (en annan syntaktisk parsingteknik) till att visa meningsbyggnadens hierarkiska struktur. Constituency parsing identifierar nominal-, verbalfraser och andra beståndsdelar och visar meningsstrukturen i ett trädformat. Båda metoderna är värdefulla för olika NLP-uppgifter och kan användas tillsammans för en heltäckande textförståelse.

Hantering av icke-projektiva träd:

Hantering av meningar med icke-projektiva strukturer kan vara komplext, särskilt i morfologiskt rika språk.

Långdistansberoenden:

Parsing av meningar med beroenden över långa avstånd kan vara utmanande på grund av möjliga tvetydigheter och behovet av exakt kontextförståelse.

Syntaktisk tvetydighet:

Olika tolkningar av meningsstrukturen kan leda till tolkningssvårigheter, vilket kräver sofistikerade modeller för att lösa tvetydigheter.

Övergripande är dependency parsing en avgörande komponent inom NLP, som gör det möjligt för maskiner att tolka den grammatiska strukturen i mänskligt språk och möjliggör en mängd olika applikationer inom AI, maskininlärning och data science.

Dependency Parsing är en central del av språkteknologi som handlar om att analysera den grammatiska strukturen i en mening genom att fastställa relationer mellan ”huvudord” och de ord som modifierar dessa huvud. Här är några viktiga vetenskapliga arbeten som fördjupar sig i olika aspekter av dependency parsing:

A Survey of Syntactic-Semantic Parsing Based on Constituent and Dependency Structures

Författare: Meishan Zhang

Denna artikel ger en omfattande översikt av syntaktisk och semantisk parsing, med fokus på constituent- och dependency parsing. Dependency parsing lyfts fram för sin förmåga att hantera både syntaktisk och semantisk analys. Översikten granskar representativa modeller och diskuterar relaterade ämnen som domän- och språkoberoende parsing, parserapplikationer och korpusutveckling. Arbetet är grundläggande för att förstå den bredare kontexten och metoderna inom parsing.

Läs mer

A Survey of Unsupervised Dependency Parsing

Författare: Wenjuan Han, Yong Jiang, Hwee Tou Ng, Kewei Tu

Denna artikel behandlar unsupervised dependency parsing, där parsers tränas på oannoterad text, vilket är särskilt värdefullt för resursfattiga språk. Artikeln kategoriserar befintliga metoder och belyser fördelarna med att använda stora mängder oannoterad data. Den tar också upp aktuella trender och ger insikter för framtida forskning i området.

Läs mer

Context Dependent Semantic Parsing: A Survey

Författare: Zhuang Li, Lizhen Qu, Gholamreza Haffari

Denna översikt behandlar semantisk parsing, särskilt hur den kan förbättras genom att inkorporera kontextuell information. Artikeln granskar metoder och dataset för kontextberoende semantisk parsing, identifierar utmaningar och möjligheter för framtida forskning. Detta arbete är betydelsefullt för dem som vill förbättra noggrannheten i parsing i samtal och dynamiska miljöer.

Läs mer

Dessa artiklar ger tillsammans en djup förståelse för dependency parsing, belyser dess tillämpningar, utmaningar och de innovativa metoder som utvecklas för att förbättra dess effektivitet. De fungerar som värdefulla resurser för alla som vill fördjupa sig i syntaktisk och semantisk parsing inom NLP.

Dependency parsing är en syntaktisk analysmetod som identifierar grammatiska relationer (beroenden) mellan ord i en mening och bildar en trädliknande struktur för att förstå meningens innebörd och struktur.

Dependency parsing används i maskinöversättning, sentimentanalys, informationsutvinning, textsammanfattning och frågesvarssystem för att förbättra textförståelsen och automatisera språkuppgifter.

Populära verktyg inkluderar spaCy, Stanza, NLTK med Stanford CoreNLP, som alla erbjuder robusta modeller och visualiserare för syntaktisk parsing i NLP-pipelines.

Dependency parsing fokuserar på relationer mellan ord (beroenden), medan constituency parsing visar den hierarkiska strukturen av fraser och beståndsdelar i en mening; båda ger olika insikter för NLP-uppgifter.

Dra nytta av dependency parsing och andra AI-verktyg för att förbättra din textförståelse och automatisera dina arbetsflöden.

Fönstring inom artificiell intelligens syftar på att bearbeta data i segment eller “fönster” för att effektivt analysera sekventiell information. Avgörande inom...

Korreferensupplösning är en grundläggande NLP-uppgift som identifierar och länkar uttryck i text som refererar till samma enhet, avgörande för maskinell förståe...

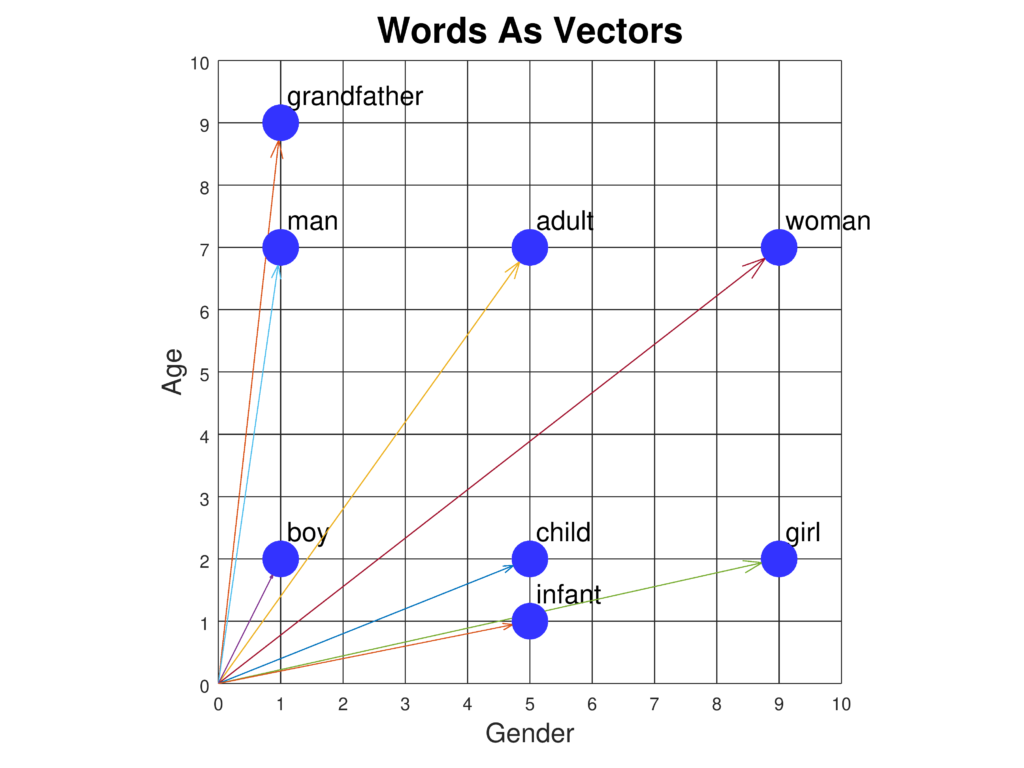

Ord-inbäddningar är sofistikerade representationer av ord i ett kontinuerligt vektorrum som fångar semantiska och syntaktiska relationer för avancerade NLP-uppg...