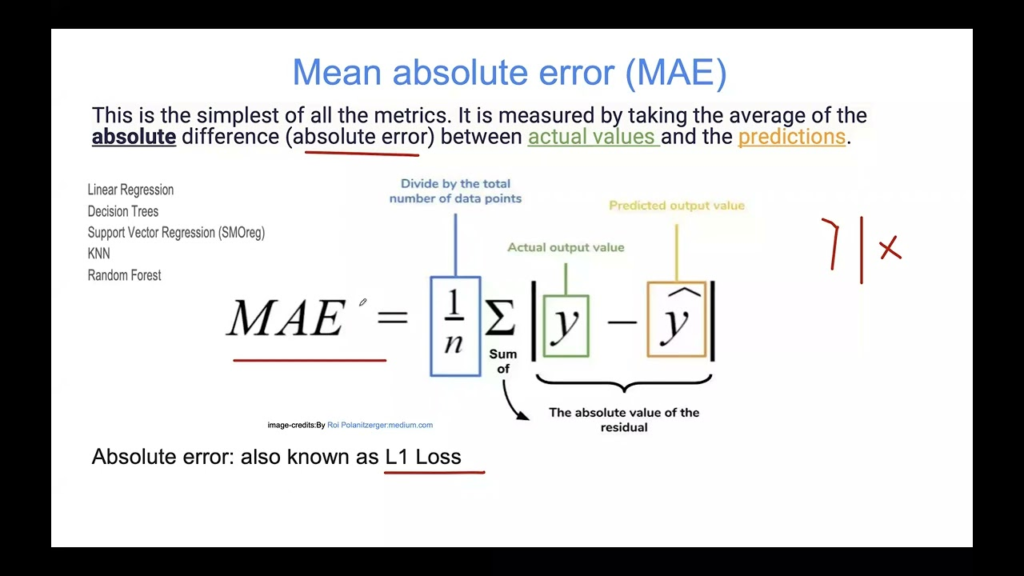

Medelfel (MAE)

Medelfel (MAE) är ett grundläggande mått inom maskininlärning för att utvärdera regressionsmodeller. Det mäter den genomsnittliga storleken på felen i förutsäge...

Dolda Markovmodeller är kraftfulla verktyg för att modellera system med dolda tillstånd, vilket möjliggör sekvensanalys och prediktion inom områden som tal, biologi och finans.

Dolda Markovmodeller (HMM) är en sofistikerad klass av statistiska modeller som används för att representera system där de underliggande tillstånden inte är direkt observerbara. Dessa modeller är avgörande för att tolka data där processen som genererar observationerna är dold, vilket gör HMM till ett grundläggande verktyg inom områden som taligenkänning, biologisk sekvensanalys och finansiell modellering.

Dolda tillstånd är de oobserverbara aspekterna av systemet. I en HMM utvecklas dessa tillstånd enligt en Markovprocess, vilket innebär att framtida tillstånd endast beror på det nuvarande tillståndet och inte på tidigare händelser. Denna egenskap kallas Markov-egenskapen. Att förstå de dolda tillstånden är avgörande eftersom de representerar den verkliga dynamiken i det modellerade systemet.

Observerbara händelser är de datapunkter eller signaler vi kan mäta. Inom HMM produceras varje observation av ett av de dolda tillstånden. Den största utmaningen och målet med HMM är att härleda sekvensen av dolda tillstånd utifrån sekvensen av observerade händelser. Denna härledning ger insikt i den underliggande process som inte är direkt tillgänglig.

Övergångssannolikheter är en uppsättning sannolikheter som anger sannolikheten att gå från ett dolt tillstånd till ett annat. Dessa sannolikheter utgör en övergångsmatris, där varje element anger sannolikheten att övergå från ett tillstånd till ett annat. Denna matris är grundläggande för att förutsäga framtida tillstånd och förstå dynamiken i den underliggande processen.

Emissionssannolikheter beskriver sannolikheten att observera en viss händelse från ett specifikt dolt tillstånd. Dessa sannolikheter organiseras i en emissionsmatris, där varje post motsvarar sannolikheten att observera en given observation från ett dolt tillstånd. Denna komponent är avgörande för att koppla de dolda tillstånden till de observerbara data.

Den ursprungliga tillståndsfördelningen anger sannolikheterna för att systemet startar i vart och ett av de möjliga tillstånden. Den är viktig för att definiera modellens startläge och används tillsammans med övergångs- och emissionssannolikheter för att modellera hela processen.

Viterbi-algoritmen är en dynamisk programmeringsmetod som används för att bestämma den mest sannolika sekvensen av dolda tillstånd givet en sekvens av observationer. Den beräknar effektivt den optimala vägen genom tillståndsrymden genom att utvärdera alla möjliga vägar och välja den med högst sannolikhet. Denna algoritm används ofta vid avkodningsproblem, som inom taligenkänning och bioinformatik.

Framåtalgoritmen beräknar sannolikheten för en sekvens av observationer givet modellparametrarna genom att summera över alla möjliga sekvenser av dolda tillstånd. Detta görs med dynamisk programmering, vilket möjliggör effektiv beräkning och undviker den exponentiella komplexiteten som uppstår vid utvärdering av alla möjliga tillståndssekvenser.

Baum-Welch-algoritmen, även kallad framåt-bakåt-algoritmen, är en iterativ metod för att uppskatta parametrarna i en HMM. Den är ett specifikt fall av Expectation-Maximization (EM)-algoritmen och används för att hitta maximum likelihood-skattningar av övergångs- och emissionssannolikheter utifrån en given observationsmängd. Denna algoritm är avgörande för att träna HMM när modellparametrarna är okända.

HMM är en hörnsten i taligenkänningsteknologi. De modellerar sekvensen av talade ord genom att koppla dolda tillstånd till fonetiska enheter, som fonem eller ord, och observationer till akustiska signaler. Detta gör det möjligt för systemet att effektivt känna igen och bearbeta mänskligt tal.

Inom bioinformatik används HMM för att modellera biologiska sekvenser, inklusive DNA, RNA och proteiner. De används för uppgifter som genprediktion, sekvensjämförelse och modellering av evolutionära processer. HMM hjälper till att förstå funktionella och strukturella egenskaper hos biologiska molekyler.

Inom finanssektorn används HMM för att modellera marknadsbeteenden och för prediktiv analys. Dolda tillstånd kan representera olika marknadsförhållanden, medan observationer kan vara aktiekurser eller ekonomiska indikatorer. HMM är värdefulla för prognoser och riskbedömning på finansmarknaderna.

HMM används i språkteknologi för uppgifter som ordklassanalys, där målet är att tilldela ordklasser till ord i en mening. Dolda tillstånd motsvarar ordklasser, medan observationerna är själva orden. Denna tillämpning hjälper till att förstå och bearbeta mänskligt språk på ett datoriserat sätt.

Tänk dig en HMM som används för att förutsäga vädermönster. I denna modell kan dolda tillstånd vara “Soligt” och “Regnigt”, medan observerbara händelser är “Torrt” och “Blött”. Övergångssannolikheter definierar hur sannolikt det är att vädret ändras från ett tillstånd till ett annat. Emissionssannolikheter anger sannolikheten att observera torra eller blöta förhållanden givet det aktuella vädret. Genom att analysera sekvenser av torra och blöta dagar kan HMM härleda den mest sannolika sekvensen av underliggande vädertillstånd.

Inom artificiell intelligens är HMM en integrerad del av system som behöver fatta beslut baserat på ofullständig information. Till exempel kan HMM i chatbotar modellera användarens avsikt och förstå sekvensen av användarinmatningar för att ge mer träffsäkra och kontextuellt lämpliga svar. Inom AI-driven automation kan HMM förutsäga användarens handlingar och automatisera repetitiva arbetsuppgifter genom att lära sig av användarens beteendemönster.

Sammanfattningsvis ger dolda Markovmodeller ett kraftfullt ramverk för att modellera system med dolda tillstånd. Deras förmåga att hantera sekventiella data och göra prediktioner baserat på observerbara händelser gör dem ovärderliga inom många områden, inklusive AI och automation. HMM fortsätter att vara ett viktigt verktyg för forskare och praktiker inom områden där det är nödvändigt att förstå och förutsäga komplexa, dolda processer.

Dolda Markovmodeller är kraftfulla statistiska modeller som används för att representera system som växlar mellan oobserverbara, eller “dolda”, tillstånd. De tillämpas i stor utsträckning inom områden som taligenkänning, bioinformatik och finans. Nedan följer sammanfattningar av några viktiga vetenskapliga artiklar som behandlar olika aspekter och framsteg inom dolda Markovmodeller:

Context Tree Estimation in Variable Length Hidden Markov Models

Författare: Thierry Dumont

Denna artikel behandlar den komplexa frågan om att uppskatta kontextträd i dolda Markovmodeller med variabel längd. Författaren föreslår en ny estimator som inte kräver någon fördefinierad övre gräns för kontextträdets djup. Estimatorn bevisas vara starkt konsekvent med hjälp av informationsteoretiska blandningsolikheter. En algoritm introduceras för effektiv beräkning av estimatorn och simuleringar visar metodens giltighet. Läs mer

Infinite Structured Hidden Semi-Markov Models

Författare: Jonathan H. Huggins, Frank Wood

Denna artikel utforskar framsteg inom Bayesianska icke-parametriska metoder för oändliga dolda Markovmodeller, med fokus på att förbättra tillståndens varaktighet. Den introducerar ett nytt ramverk kallat “infinite structured hidden semi-Markov model”, vilket möjliggör konstruktion av modeller med strukturerade och explicit tidsbestämda tillstånd. Detta ramverk är betydelsefullt för tillämpningar som kräver vänster-till-höger eller andra strukturerade tillståndsövergångar. Läs mer

Speaker Identification in a Shouted Talking Environment Based on Novel Third-Order Circular Suprasegmental Hidden Markov Models

Författare: Ismail Shahin

Denna forskning syftar till att förbättra talaridentifiering i utmanande miljöer, exempelvis när talare ropar. Den introducerar Third-Order Circular Suprasegmental Hidden Markov Models (CSPHMM3s), som integrerar egenskaper från flera typer av HMM. Resultaten visar att CSPHMM3 överträffar andra modeller och uppnår talaridentifieringsprestanda nära mänskliga lyssnares subjektiva bedömningar. Läs mer

En dold Markovmodell (HMM) är en statistisk modell där det modellerade systemet antas följa en Markovprocess med oobserverbara (dolda) tillstånd. HMM används för att härleda den mest sannolika sekvensen av dolda tillstånd utifrån observerade data.

De viktigaste komponenterna är dolda tillstånd, observerbara händelser, övergångssannolikheter, emissionssannolikheter och ursprunglig tillståndsfördelning.

HMM används i stor utsträckning inom taligenkänning, biologisk sekvensanalys, finansiell modellering, språkteknologi och AI-driven automation.

Vanliga algoritmer inkluderar Viterbi-algoritmen för avkodning, framåtalgoritmen för att beräkna observationssannolikheter och Baum-Welch-algoritmen för att träna HMM-parametrar.

HMM hjälper AI-system och automatiserade arbetsflöden att göra prediktioner och beslut baserat på ofullständig eller sekventiell data, såsom att förstå användarens avsikt i chatbotar eller förutsäga användarens handlingar vid automation.

Smarta chatbotar och AI-verktyg samlade på en plats. Koppla ihop intuitiva block och förvandla dina idéer till automatiserade flöden.

Medelfel (MAE) är ett grundläggande mått inom maskininlärning för att utvärdera regressionsmodeller. Det mäter den genomsnittliga storleken på felen i förutsäge...

Modelltolkning avser förmågan att förstå, förklara och lita på de förutsägelser och beslut som fattas av maskininlärningsmodeller. Det är avgörande inom AI, sär...

Övervakad inlärning är ett grundläggande AI- och maskininlärningskoncept där algoritmer tränas på märkta data för att göra korrekta förutsägelser eller klassifi...