Mönsterigenkänning

Mönsterigenkänning är en beräkningsprocess för att identifiera mönster och regelbundenheter i data, avgörande inom områden som AI, datavetenskap, psykologi och ...

Monte Carlo-metoder använder slumpmässig provtagning för att lösa komplexa problem inom områden som finans, teknik och AI, vilket möjliggör modellering av osäkerhet och riskanalys.

Monte Carlo-metoder använder slumpmässig provtagning för att lösa komplexa problem och hjälper områden som finans, teknik och AI. De modellerar osäkerhet, optimerar beslut och bedömer risker men kräver betydande beräkningskraft och högkvalitativa slumptal.

Monte Carlo-metoder, även kallade Monte Carlo-experiment, är en klass av beräkningsalgoritmer som bygger på upprepad slumpmässig provtagning för att få numeriska lösningar på komplexa problem. Den grundläggande principen för Monte Carlo-metoder är att utnyttja slumpen för att lösa problem som kan vara deterministiska till sin natur. Metoden är uppkallad efter Monte Carlo-casinot i Monaco, vilket återspeglar den slumpmässiga komponenten som är central för dessa tekniker. Konceptet introducerades av matematikern Stanislaw Ulam, som inspirerades av hasardspelens stokastiska natur. Monte Carlo-metoder är avgörande inom områden som kräver optimering, numerisk integration och provtagning från sannolikhetsfördelningar.

Monte Carlo-metoder används flitigt inom olika områden som fysik, finans, teknik och artificiell intelligens (AI), särskilt där de hjälper till i beslutsprocesser vid osäkerhet. Monte Carlo-simuleringens flexibilitet att modellera fenomen med osäkra variabler gör dem ovärderliga för riskbedömning och sannolikhetsprognoser.

Ursprunget till Monte Carlo-metoder går tillbaka till 1940-talet, under utvecklingen av kärnvapen inom Manhattanprojektet. Ulam och John von Neumann använde dessa metoder för att lösa komplexa integraler relaterade till neutronspridning. Metoden fick snabbt genomslag inom olika vetenskapliga discipliner tack vare sin flexibilitet och effektivitet vid hantering av problem som involverar slump och osäkerhet.

Kärnan i Monte Carlo-metoder är processen att slumpmässigt ta prover. Detta innebär att generera slumptal för att simulera olika scenarier och bedöma möjliga utfall. Tillförlitligheten hos resultaten från Monte Carlo är starkt beroende av kvaliteten på dessa slumptal, som ofta genereras med hjälp av pseudorandomgeneratorer. Dessa generatorer erbjuder en balans mellan hastighet och effektivitet jämfört med traditionella slumptabeller. Resultatens robusthet kan förbättras avsevärt genom tekniker som variansreduktion och quasi-slumpmässiga sekvenser.

Monte Carlo-simuleringar utnyttjar sannolikhetsfördelningar för att modellera variablers beteende. Vanliga fördelningar inkluderar normalfördelningen, kännetecknad av sin klockformade, symmetriska kurva, och den likformiga fördelningen, där alla utfall är lika sannolika. Valet av rätt fördelning är avgörande eftersom det påverkar simuleringens noggrannhet och relevans för verkliga scenarier. Avancerade tillämpningar kan använda fördelningar som Poisson- eller exponentialfördelningar för att modellera specifika typer av slumpmässiga processer.

I Monte Carlo-simuleringar är indata-variabler, ofta behandlade som slumpvariabler, de oberoende variabler som påverkar systemets beteende. Utdata-variabler är resultaten från simuleringen och representerar möjliga utfall baserat på indata. Dessa variabler kan vara kontinuerliga eller diskreta och är avgörande för att definiera modellens omfång och begränsningar. Känslighetsanalys utförs ofta för att avgöra vilken indata-variabel som har störst påverkan på utfallen och för att styra modellens förbättring och validering.

Standardavvikelse och varians är viktiga statistiska mått för att förstå spridningen och tillförlitligheten i simuleringsresultaten. Standardavvikelsen ger insikt i variationen från medelvärdet, medan variansen mäter graden av spridning inom en uppsättning värden. Dessa mått är centrala för att tolka simuleringsresultat, särskilt vid bedömning av risk och osäkerhet kopplat till olika utfall.

Monte Carlo-simuleringar följer en strukturerad metodik:

Avancerade Monte Carlo-simuleringar kan inkludera tekniker som Markov Chain Monte Carlo (MCMC), som är särskilt användbara för provtagning från komplexa sannolikhetsfördelningar. MCMC-metoder används inom Bayesiansk statistik och maskininlärning, där de hjälper till att uppskatta posteriorfördelningar för modellparametrar.

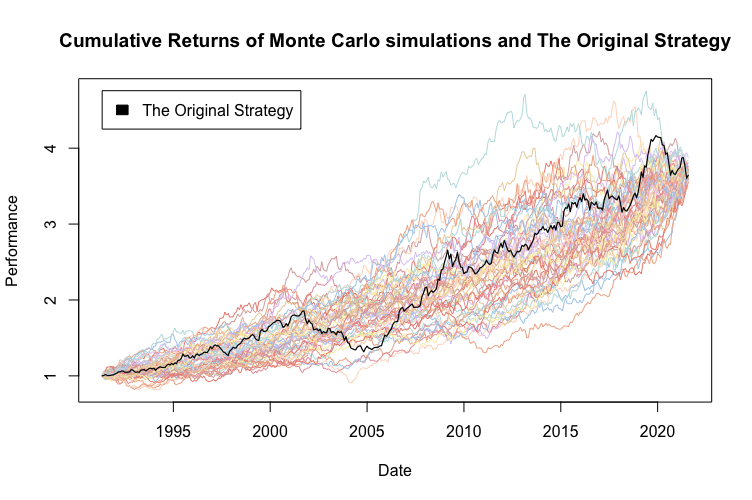

Monte Carlo-simuleringar är oumbärliga i finansiell modellering, där de används för att uppskatta sannolikheten för investeringsavkastning, bedöma portföljrisker och prissätta derivat. Genom att simulera tusentals marknadsscenarier kan finansanalytiker förutse möjliga vinster eller förluster och utveckla strategier för att hantera risk. Denna metod är avgörande för stresstestning av finansiella modeller och för att utvärdera effekten av marknadsvolatilitet på investeringsportföljer.

Inom teknik används Monte Carlo-metoder för att simulera tillförlitligheten och prestandan hos system under varierande förhållanden. Till exempel kan de förutsäga felfrekvensen för komponenter i mekaniska system och säkerställa att produkter uppfyller krav på säkerhet och hållbarhet. Dessa simuleringar används också vid kvalitetskontroll och processoptimering, där de hjälper till att identifiera potentiella fel och ineffektivitet.

Inom AI förbättrar Monte Carlo-metoder beslutsalgoritmer, särskilt i miljöer med hög osäkerhet. Dessa metoder hjälper AI-system att utvärdera möjliga utfall av olika åtgärder och förbättrar deras förmåga att förutsäga och anpassa sig till förändringar. Monte Carlo Tree Search (MCTS) är en välkänd tillämpning inom spel och beslutsfattande, där den gör det möjligt för AI att fatta informerade beslut även med ofullständig information.

Projektledare använder Monte Carlo-simuleringar för att förutsäga projekttidslinjer och budgetar, och tar hänsyn till osäkerheter som förseningar och kostnadsöverskridanden. Detta underlättar planering och resursallokering genom att ge sannolikhetsbaserade uppskattningar av projektavslut. Monte Carlo-metoder är särskilt användbara inom riskhantering, där de hjälper till att identifiera och kvantifiera risker som kan påverka projektets mål.

Miljöforskare använder Monte Carlo-simuleringar för att modellera komplexa ekologiska system och förutse effekterna av förändringar i miljövariabler. Detta är avgörande för riskbedömning och utveckling av effektiva strategier för bevarande. Monte Carlo-metoder används vid klimatmodellering, bedömning av biologisk mångfald och miljökonsekvensanalyser, och ger insikter om potentiella följder av mänskliga aktiviteter på ekosystem.

Trots att Monte Carlo-metoder ger stora fördelar finns det även utmaningar:

Inom artificiell intelligens är Monte Carlo-metoder viktiga för att utveckla intelligenta system som kan resonera under osäkerhet. Dessa metoder kompletterar maskininlärning genom att erbjuda sannolikhetsramverk som ökar AI-modellers robusthet och anpassningsförmåga.

Till exempel är Monte Carlo Tree Search (MCTS) en populär algoritm inom AI, särskilt inom spel och beslutsfattande. MCTS använder slumpmässig provtagning för att utvärdera möjliga drag i ett spel, vilket gör att AI kan fatta informerade beslut även med ofullständig information. Denna teknik har varit avgörande för att utveckla AI-system som kan spela komplexa spel som Go och schack.

Vidare öppnar integrationen av Monte Carlo-simuleringar med AI-tekniker som djupinlärning och förstärkningsinlärning nya möjligheter att bygga intelligenta system som kan tolka stora datamängder, känna igen mönster och förutsäga framtida trender med högre noggrannhet. Dessa synergier förbättrar AI-modellers förmåga att lära av osäker data och förbättra sina beslutsprocesser i dynamiska miljöer.

Monte Carlo-metoder är en kraftfull uppsättning beräkningsalgoritmer som används för att simulera och förstå komplexa system. Dessa metoder bygger på upprepad slumpmässig provtagning för att få numeriska resultat och används flitigt inom områden som fysik, finans och teknik. Nedan följer några viktiga vetenskapliga artiklar som behandlar olika aspekter av Monte Carlo-metoder:

Fast Orthogonal Transforms for Multi-level Quasi-Monte Carlo Integration

Författare: Christian Irrgeher, Gunther Leobacher

Denna artikel diskuterar en metod för att kombinera snabba ortogonala transformationer med quasi-Monte Carlo-integration, vilket förbättrar effektiviteten hos den senare. Författarna visar att denna kombination kan öka den beräkningsmässiga prestandan avsevärt för multilevel Monte Carlo-metoder. Studien ger exempel som validerar den förbättrade effektiviteten och är ett värdefullt bidrag till beräkningsmatematiken. Läs mer

The Derivation of Particle Monte Carlo Methods for Plasma Modeling from Transport Equations

Författare: Savino Longo

Denna forskning ger en detaljerad analys av hur man härleder Particle och Monte Carlo-metoder från transportekvationer, särskilt för plasmasimulering. Det omfattar tekniker som Particle in Cell (PIC) och Monte Carlo (MC) och ger insikt i den matematiska grunden för dessa simuleringsmetoder. Artikeln är viktig för att förstå tillämpningen av Monte Carlo-metoder inom plasmafysik. Läs mer

Projected Multilevel Monte Carlo Method for PDE with Random Input Data

Författare: Myoungnyoun Kim, Imbo Sim

Författarna introducerar en projicerad multilevel Monte Carlo-metod som syftar till att minska beräkningskomplexiteten samtidigt som felkonvergensen bibehålls. Studien visar att multilevel Monte Carlo-metoder kan uppnå önskad noggrannhet med mindre beräkningsinsats jämfört med traditionella Monte Carlo-metoder. Numeriska experiment ges för att styrka de teoretiska resultaten. Läs mer

Inference with Hamiltonian Sequential Monte Carlo Simulators

Författare: Remi Daviet

Denna artikel föreslår en ny Monte Carlo-simulator som kombinerar fördelarna med Sequential Monte Carlo och Hamiltonian Monte Carlo-simulatorer. Den är särskilt effektiv för inferens i komplexa och multimodala scenarier. Artikeln innehåller flera exempel som visar metodens robusthet vid svåra sannolikhetsfördelningar och målfunktioner. Läs mer

Antithetic Riemannian Manifold and Quantum-Inspired Hamiltonian Monte Carlo

Författare: Wilson Tsakane Mongwe, Rendani Mbuvha, Tshilidzi Marwala

Forskningen presenterar nya algoritmer som förbättrar Hamiltonian Monte Carlo-metoder genom att införliva antithetisk provtagning och kvantinspirerade tekniker. Dessa innovationer förbättrar provtagningshastigheten och minskar variansen i uppskattningarna. Studien tillämpar dessa metoder på finansiell marknadsdata och Bayesiansk logistisk regression och visar på betydande förbättringar i samplingseffektivitet. Läs mer

Monte Carlo-metoder är en klass av beräkningsalgoritmer som använder upprepad slumpmässig provtagning för att få numeriska lösningar på komplexa problem, ofta involverande osäkerhet och sannolikhetsmodellering.

De används flitigt inom finans för riskanalys och portföljoptimering, inom teknik för tillförlitlighet och kvalitetskontroll, inom AI för beslutsfattande under osäkerhet, samt inom projektledning och miljövetenskap för prognoser och riskbedömning.

Den största fördelen är deras förmåga att modellera osäkerhet och simulera ett brett spektrum av möjliga utfall, vilket ger värdefulla insikter för beslutsfattande i komplexa system.

Monte Carlo-metoder kan vara beräkningsintensiva, kräva högkvalitativ slumpgenerering och kan möta utmaningar som dimensionsförbannelse när modellkomplexiteten ökar.

Utforska hur Monte Carlo-metoder och AI-drivna verktyg kan förbättra beslutsfattande, riskanalys och komplexa simuleringar för ditt företag eller din forskning.

Mönsterigenkänning är en beräkningsprocess för att identifiera mönster och regelbundenheter i data, avgörande inom områden som AI, datavetenskap, psykologi och ...

Random Forest-regression är en kraftfull maskininlärningsalgoritm som används för prediktiv analys. Den konstruerar flera beslutsxadträd och medelvärdesxadberäk...

Boostning är en maskininlärningsteknik som kombinerar förutsägelser från flera svaga inlärare för att skapa en stark inlärare, vilket förbättrar noggrannheten o...