One-Shot Prompting: Lär LLM att skapa YouTube-inbäddningar

Lär dig hur FlowHunt använde one-shot prompting för att lära LLM:er att hitta och bädda in relevanta YouTube-videor i WordPress. Denna teknik säkerställer perfe...

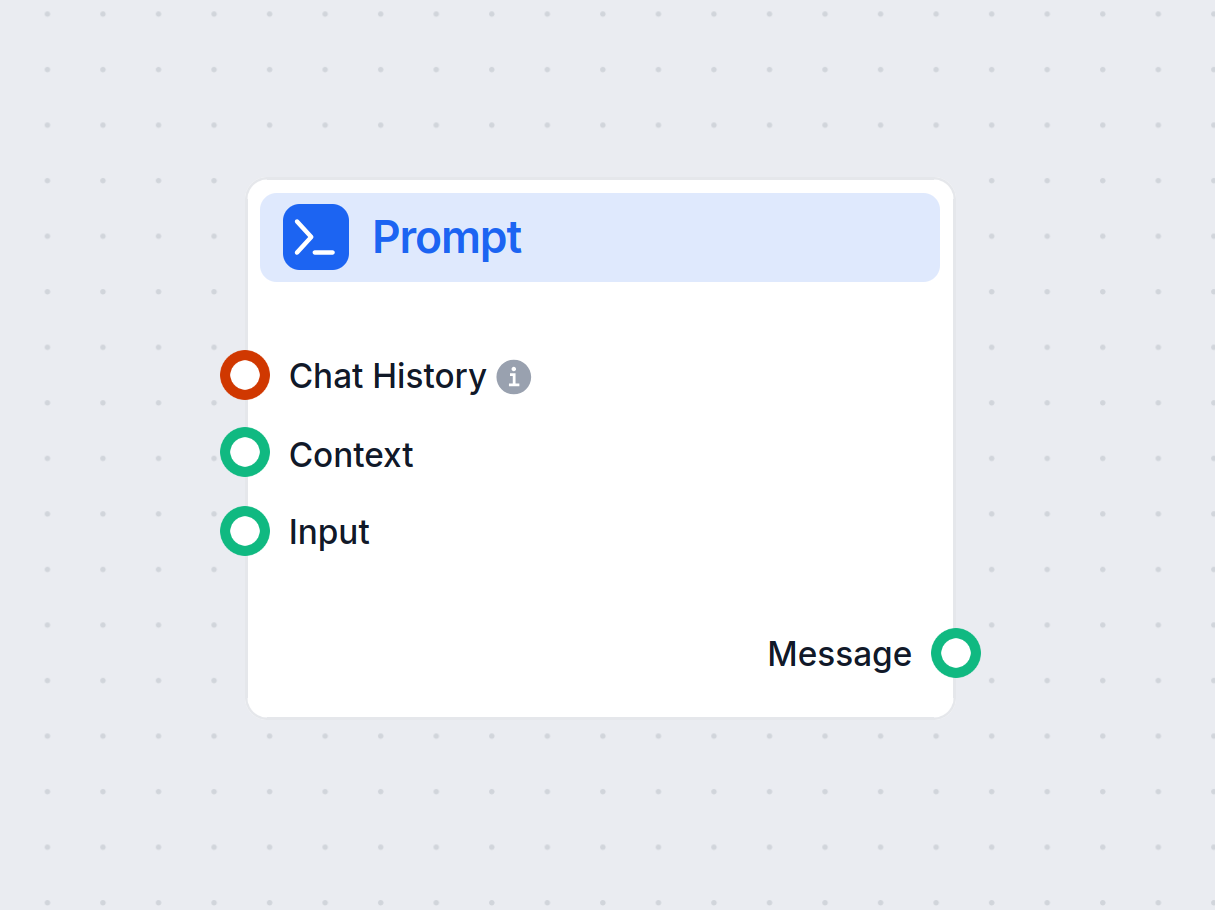

En prompt är inmatningstexten som styr hur en LLM svarar, där tydlighet, specifikhet och tekniker som few-shot eller chain-of-thought förbättrar AI-utdatan.

Prompter spelar en avgörande roll i LLM:ers funktionalitet. De fungerar som den primära mekanismen genom vilken användare interagerar med dessa modeller. Genom att formulera dina frågor eller instruktioner effektivt kan du avsevärt påverka kvaliteten och relevansen hos de svar som genereras av LLM:en. Bra prompts är avgörande för att utnyttja LLM:ers fulla potential, oavsett om det gäller affärsapplikationer, innehållsskapande eller forskningsändamål.

Prompter används på olika sätt för att styra en LLM:s utdata. Här är några vanliga tillvägagångssätt:

Att skapa effektiva prompts innebär tydlighet och specifikhet. Här är några tips:

Forskare har funnit att exempel (few-shot prompting) eller detaljerade resonemangs-steg (chain-of-thought prompting) avsevärt kan förbättra modellens prestanda. Till exempel:

Att strukturera din prompt på ett meningsfullt sätt kan styra LLM:en att generera mer korrekta och relevanta svar. Till exempel, om uppgiften är kundservice, kan du börja med ett systemmeddelande: ”Du är en vänlig AI-agent som kan hjälpa kunden med deras senaste beställning.”

En prompt är den inmatningstext som ges till en stor språkmodell (LLM) för att styra dess svar. Det kan vara en fråga, instruktion eller kontext som hjälper modellen att generera relevant utdata.

Zero-shot prompting ger modellen en uppgift utan exempel. One-shot inkluderar ett exempel, medan few-shot ger flera exempel för att styra LLM:ens utdata.

Använd tydligt och specifikt språk, ge relevant kontext och formulera instruktioner positivt. Att inkludera exempel eller steg-för-steg-resonemang kan förbättra svarskvaliteten.

Chain-of-thought prompting innebär att man inkluderar detaljerade resonemangs-steg i prompten för att styra LLM:en mot genomtänkta och korrekta svar.

Smarta chattbotar och AI-verktyg under ett och samma tak. Koppla intuitiva block för att omvandla dina idéer till automatiserade Flows.

Lär dig hur FlowHunt använde one-shot prompting för att lära LLM:er att hitta och bädda in relevanta YouTube-videor i WordPress. Denna teknik säkerställer perfe...

Lär dig hur FlowHunts Prompt-komponent låter dig definiera din AI-bots roll och beteende, vilket säkerställer relevanta och personliga svar. Anpassa prompts och...

Promptteknik är praxis att utforma och förfina indata för generativa AI-modeller för att producera optimala resultat. Detta innebär att skapa precisa och effekt...