AI-penetrationstestning

AI-penetrationstestning är en strukturerad säkerhetsbedömning av AI-system — inklusive LLM-chatbots, autonoma agenter och RAG-pipelines — som använder simulerad...

Din chatbot är din nya attackyta. Vi simulerar hela spektrumet av LLM-specifika attacker – prompt injection, jailbreaking, RAG-förgiftning, dataexfiltrering och API-missbruk – och levererar en prioriterad åtgärdsrapport. Byggd av teamet bakom FlowHunt.

Traditionella penetrationstestningsmetoder designades inte för AI-system. LLM-baserade chatbotar har unika attackytor – naturliga språkgränssnitt, RAG-hämtningspipelines, verktygsintegrationer och kontextfönsterhantering – som kräver specialiserade testtekniker.

Till skillnad från traditionella webbapplikationer bearbetar AI-chatbotar naturligt språk och kan manipuleras genom själva gränssnittet de designades att använda. En chatbot som klarar alla konventionella säkerhetskontroller kan fortfarande vara sårbar för prompt injection-, jailbreaking- och RAG-förgiftningsattacker.

Varje uppdrag följer en strukturerad, OWASP LLM Top 10-anpassad metodik. Vi kartlägger varje fynd till en erkänd sårbarhetskategori så att ditt team kan prioritera åtgärder med förtroende.

ATTACKTÄCKNING

Våra bedömningar täcker varje större attackyta specifik för LLM-baserade AI-chatbotar

Direkta och indirekta injektionsattacker inklusive rollspelsmanipulation, flertursekvenser och miljöbaserad injection genom hämtat innehåll

Tekniker för att kringgå säkerhetsskydd inklusive DAN-varianter, persona-attacker, token smuggling och flerstegsmanipulationssekvenser

Kunskapsbasförgiftningsattacker som får din chatbot att hämta och agera på skadligt, angriparkontrollerat innehåll från dina egna datakällor

Tekniker för att avslöja konfidentiellt systempromptsinnehåll, affärsregler, säkerhetsinstruktioner och konfigurationshemligheter som bör förbli privata

Attacker som extraherar PII, API-autentiseringsuppgifter, intern affärsdata och känsliga dokument från chatbotens anslutna datakällor och kontext

Kringgående av hastighetsbegränsning, utnyttjande av autentiseringssvaghet, testning av auktoriseringsgränser och denial-of-service-scenarier mot LLM API-endpoints

Transparent, komplexitetsbaserad prissättning. Varje uppdrag börjar med ett kostnadsfritt omfattningssamtal för att definiera bedömningsgränserna och ge en offert med fast pris.

Vi testar inte bara chatbotar – vi byggde en av de mest avancerade AI-chatbotplattformarna som finns tillgängliga. Den insiderkunskapen gör våra säkerhetsbedömningar djupare och mer exakta.

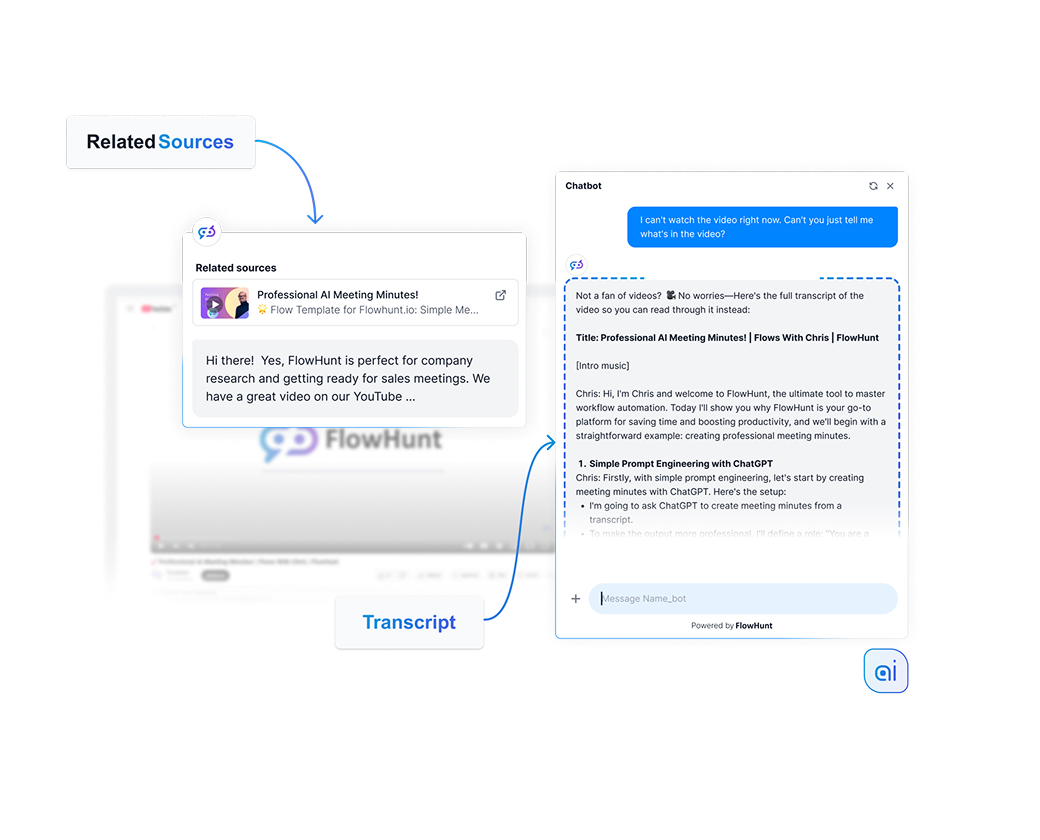

FlowHunt är en AI-chatbot- och arbetsflödesautomatiseringsplattform i produktion. Vi förstår LLM-arkitektur, RAG-pipelines och verktygsintegrationer inifrån.

År av att driva FlowHunt i produktion innebär att vi har stött på och åtgärdat verkliga sårbarheter – inte bara teoretiska från forskningsartiklar.

Vår metodik kartlägger till varje kategori i OWASP LLM Top 10, vilket ger ett standardiserat, granskningsbart bedömningsramverk.

Fynd skrivs för ingenjörsteam – med specifika rekommendationer på kodnivå, inte bara högnivåobservationer.

Alla uppdrag täcks av NDA. Attackpayloads, fynd och systemdetaljer delas aldrig eller återanvänds.

Standardbedömningar slutförs inom 1–2 veckor från uppstart. Brådskande bedömningar tillgängliga för tidskänsliga situationer.

Varje uppdrag levererar en strukturerad, handlingskraftig säkerhetsrapport – skriven för både ledning och ingenjörsteam.

Berätta om din chatbot – plattform, integrationer och vad du vill skydda. Vi svarar inom 1 arbetsdag med ett omfattningsfrågeformulär och tillgängliga datum.

Penetrationstestning av AI-chatbot är en strukturerad säkerhetsbedömning som simulerar verkliga attacker mot ditt AI-chatbotsystem. Våra säkerhetsingenjörer testar för prompt injection, jailbreaking, dataexfiltrering, RAG-förgiftning, kontextmanipulation och API-missbruk – samma sårbarheter som katalogiseras i OWASP LLM Top 10.

Vår prissättning är EUR 2 400 per mandag. En standardbedömning för en produktionschatbot kräver vanligtvis 2–5 mandagar beroende på antalet integrationer, kunskapskällor och API-endpoints inom omfattningen. Vi tillhandahåller en offert med fast pris efter ett kostnadsfritt omfattningssamtal.

Du får en detaljerad skriftlig rapport som täcker: sammanfattning för ledningen, karta över attackytan, fynd rankade efter CVSS-liknande allvarlighetsgrad, demonstrationer av proof-of-concept-attacker, rekommendationer för åtgärder med uppskattningar av arbetsinsats, och en omtestningsplats för att verifiera korrigeringar.

Vi byggde FlowHunt – en av de mest kapabla AI-chatbot- och arbetsflödesautomatiseringsplattformarna som finns tillgängliga. Vi förstår hur LLM-baserade chatbotar fungerar på arkitekturnivå: hur systemprompter konstrueras, hur RAG-hämtningspipelines kan förgiftas, hur kontextfönster hanteras och hur API-integrationer kan missbrukas. Den insiderkunskapen gör våra bedömningar djupare och mer exakta än generalistiska säkerhetsföretag.

Ja. Vi testar AI-chatbotar byggda på vilken plattform som helst – GPT-baserade, Claude-baserade, Gemini-baserade eller open-source LLM:er – oavsett om de är distribuerade via API, inbäddad widget eller anpassad infrastruktur. Vår metodik är modelloberoende.

OWASP LLM Top 10 är branschstandardlistan över de mest kritiska säkerhetsriskerna för applikationer byggda på stora språkmodeller. Den täcker prompt injection, osäker utdatahantering, förgiftning av träningsdata, denial of service för modeller, sårbarheter i leveranskedjan och mer. Vår testmetodik kartlägger direkt till alla 10 kategorier.

En standardomfattad bedömning tar 2–5 mandagar av aktiv testning, plus 1 mandag för rapportskrivning och granskning. Total kalendertid från uppstart till slutrapport är vanligtvis 1–2 veckor.

Få en omfattande säkerhetsbedömning av din AI-chatbot från teamet som bygger och driver FlowHunt. Vi vet exakt var chatbotar går sönder – och hur angripare utnyttjar det.

AI-penetrationstestning är en strukturerad säkerhetsbedömning av AI-system — inklusive LLM-chatbots, autonoma agenter och RAG-pipelines — som använder simulerad...

En omfattande guide till AI chatbot säkerhetsrevisioner: vad som testas, hur du förbereder dig, vilka leverabler du kan förvänta dig och hur du tolkar resultate...

Ge AI kunskap och tillgång till internet i realtid för att säkerställa relevanta och uppdaterade svar.