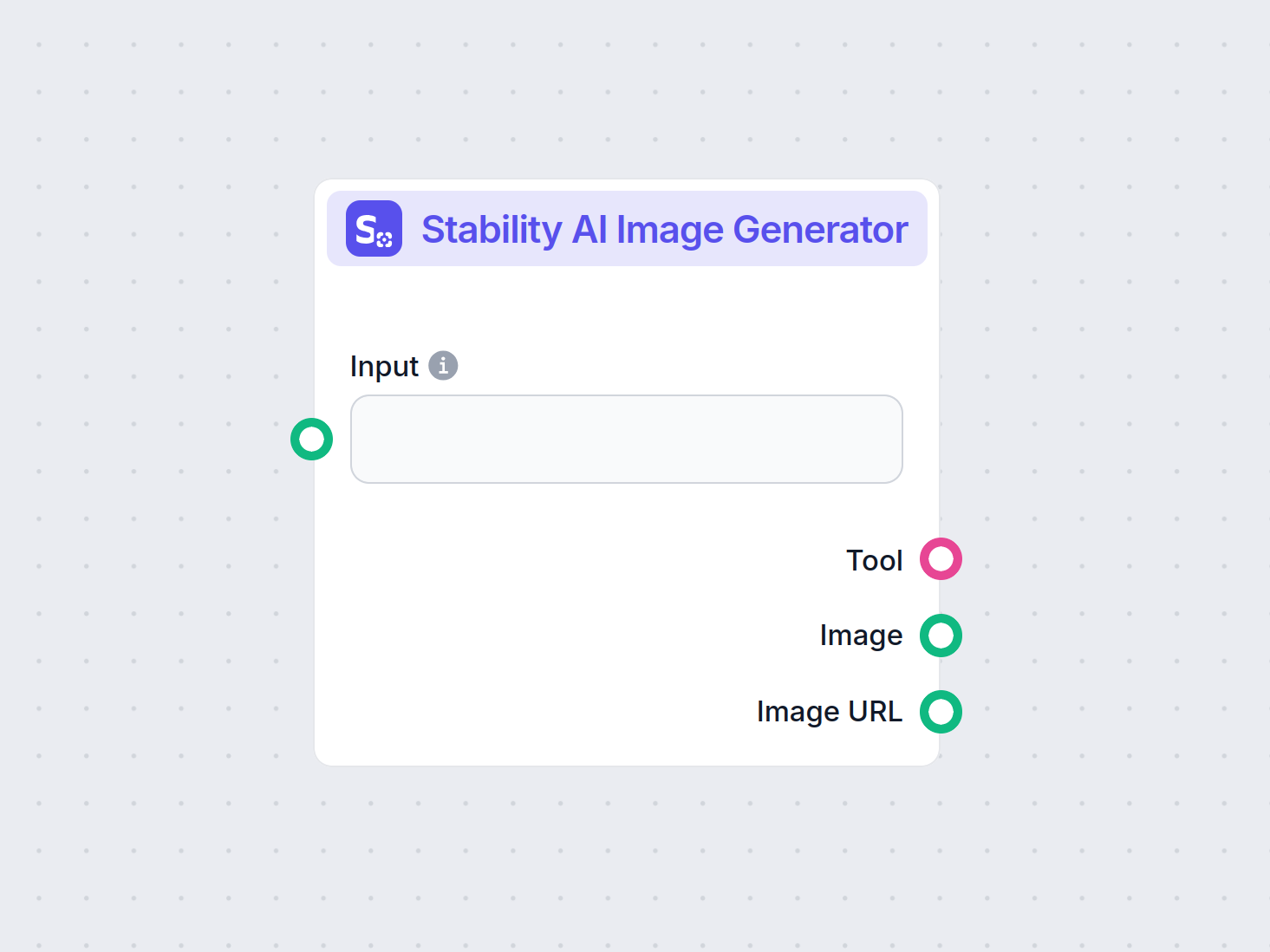

Stability AI Görüntü Oluşturucu

Stability AI Görüntü Oluşturucu bileşeni ile metin istemlerinden yüksek kaliteli görseller oluşturun. Stable Diffusion modelleriyle desteklenen bu araç, görsel ...

Stable Diffusion, kullanıcıların gelişmiş latent diffusion ve derin öğrenme teknikleriyle istemlerden foto-gerçekçi görseller oluşturmasını sağlayan önde gelen bir metinden-görüntüye AI modelidir.

Stable Diffusion, derin öğrenme kullanarak açıklamalardan yüksek kaliteli görseller oluşturan bir metinden-görüntüye AI modelidir. Özellikle eller gibi karmaşık unsurlarda daha iyi sonuçlar için negatif istemler ve referans görseller gibi teknikler kullanır.

Stable Diffusion, metinsel açıklamalara dayalı olarak yüksek kaliteli, foto-gerçekçi görseller üreten gelişmiş bir metinden-görüntüye üretim modelidir. Latent diffusion modeli olarak geliştirilen bu teknoloji, üretken yapay zeka alanında önemli bir atılımı temsil etmekte, diffusion modelleri ve makine öğreniminin ilkelerini birleştirerek verilen metin istemlerine çok yakın görseller oluşturmaktadır.

Stable Diffusion, rastgele gürültüyü rafine ederek tutarlı görseller oluşturmak için derin öğrenme ve diffusion modellerini kullanır. Milyonlarca görsel üzerinde kapsamlı şekilde eğitilmiş olmasına rağmen, özellikle eller gibi karmaşık unsurlarda zorluk yaşayabilir. Zamanla, modeller daha büyük veri setleriyle eğitildikçe bu tür sorunlar azalmakta ve üretilen görseller giderek daha gerçekçi hale gelmektedir.

El sorununu aşmanın etkili bir yolu negatif istemler kullanmaktır. (-kötü anatomi) veya (-kötü eller -doğal olmayan eller) gibi ifadeleri istemlerinize ekleyerek yapay zekaya bozulmuş özellikler üretmemesini söyleyebilirsiniz. Negatif istemlerin aşırı kullanılmamasına dikkat edin; aksi halde modelin yaratıcı çıktısı sınırlandırılabilir.

Bir diğer teknik ise referans görseller kullanarak yapay zekayı yönlendirmektir. İsteminizde bir referans görsele bağlantı içeren {image} etiketi ekleyerek, AI’ya doğru el çizimi için görsel bir şablon sunarsınız. Bu özellikle doğru el oranları ve pozlarının korunması için faydalıdır.

En iyi sonuçlar için hem negatif istemleri hem de referans görselleri birleştirin. Bu ikili yaklaşım, AI’nın yaygın hatalardan kaçınmasını ve yüksek kaliteli örneklere sadık kalmasını sağlar.

(-bükülmüş parmaklar) veya (gerçekçi perspektifler) gibi ayrıntılar ekleyerek daha da geliştirebilirsiniz.Bu tekniklerde ustalaşarak, Stable Diffusion ile el çizimlerinde önemli iyileşmeler sağlayabilir ve deneyimli bir sanatçının inceliğine sahip eserler oluşturabilirsiniz. Referans görsellerinizi toplayın, hassas istemler hazırlayın ve AI sanatınızın nasıl geliştiğini izleyin!

Temelinde, Stable Diffusion metin istemlerini bir dizi hesaplamalı süreçle görsel temsillere dönüştürerek çalışır. İşleyişini anlamak için diffusion modelleri, latent alanlar ve sinir ağları kavramlarına inmek gerekir.

Diffusion modelleri, makine öğreniminde veri oluşturmayı bir diffusion sürecini tersine çevirerek öğrenen üretici modeller sınıfıdır. Diffusion süreci, veriye (örneğin görsellere) aşamalı olarak gürültü ekleyerek onları rastgele gürültüden ayırt edilemez hale getirir. Model, bu süreci adım adım tersine çevirmeyi, yani gürültüyü çıkarmayı öğrenir ve orijinal veriyi geri kazanır. Bu ters diffusion süreci, rastgele gürültüden yeni ve tutarlı veriler üretmenin anahtarıdır.

Stable Diffusion özel olarak bir latent diffusion modeli kullanır. Geleneksel diffusion modelleri doğrudan görsellerin yüksek boyutlu piksel alanında çalışırken, latent diffusion modelleri sıkıştırılmış bir latent alanda çalışır. Latent alan, verinin temel özelliklerini daha düşük boyutlarda yakalar ve hesaplama yükünü azaltır. Latent alanda çalışmak, Stable Diffusion’ın yüksek çözünürlüklü görselleri daha verimli üretmesini sağlar.

Stable Diffusion’ın temel mekanizması, latent alanda gerçekleşen ters diffusion sürecidir. Rastgele bir gürültü latent vektörüyle başlanır, model bu latent temsili her adımda tahmin edip gürültüyü çıkararak yinelemeli olarak rafine eder. Bu rafinasyon, kullanıcı tarafından sağlanan metinsel açıklama ile yönlendirilir. Süreç, latent vektör, çözüldüğünde metin istemiyle uyumlu bir görsel üretecek bir duruma ulaşana kadar devam eder.

Stable Diffusion’ın mimarisi, metin istemlerini görsellere dönüştürmek için birlikte çalışan birkaç temel bileşeni entegre eder.

VAE, görselleri latent alana sıkıştıran ve tekrar görsele dönüştüren kodlayıcı-çözücü sistemidir. Kodlayıcı bir görseli temel özelliklerini azaltılmış biçimde yakalayan latent temsile dönüştürür. Çözücü ise bu latent temsili detaylı görsele geri çevirir.

Bu süreç, modelin düşük boyutlu verilerle çalışmasına olanak tanıyarak, piksel alanında çalışmaya kıyasla ciddi şekilde hesaplama kaynaklarını azaltır.

U-Net, Stable Diffusion’da görüntü işleme görevleri için kullanılan özel bir sinir ağı mimarisidir. Bir kodlama yolu ve bu yolun aynalı katmanları arasında atlama bağlantıları içeren bir çözme yolundan oluşur. Stable Diffusion bağlamında, U-Net ters diffusion sürecinde gürültü tahmincisi olarak görev yapar.

Diffusion sürecinin her zaman adımında, U-Net latent temsildeki gürültü miktarını tahmin eder. Bu tahmin, latent vektörü rafine etmek için kullanılır ve tahmini gürültü çıkarılarak latent alan adım adım metin istemine uygun bir görsel haline getirilir.

Metinsel bilgiyi dahil etmek için Stable Diffusion, CLIP (Contrastive Language-Image Pretraining) modeline dayalı bir metin kodlayıcı kullanır. CLIP, metinsel ve görsel bilgileri ortak bir latent alana eşleştirerek anlamayı ve ilişkilendirmeyi amaçlar.

Kullanıcı bir metin istemi verdiğinde, metin kodlayıcı bu istemi metinsel verinin sayısal temsilleri olan gömülere dönüştürür. Bu gömüler, ters diffusion sürecinde U-Net’i koşullandırır ve görsel üretiminin metin isteminin içeriğini yansıtmasını sağlar.

Stable Diffusion, görsel üretiminde çok yönlülük sunar ve kullanıcı ihtiyaçlarına göre çeşitli şekillerde kullanılabilir.

Stable Diffusion’ın ana kullanım alanı, metin istemlerinden görsel üretmektir. Kullanıcılar açıklayıcı metni girer ve model bu açıklamayı temsil eden bir görsel üretir. Örneğin, bir kullanıcı “Gün batımında palmiyeli sakin bir plaj” girdiğinde, bu sahneyi betimleyen bir görsel alır.

Bu özellik, yaratıcı endüstrilerde, içerik üretiminde ve tasarımda kavramların hızlı görselleştirilmesi gereken alanlarda özellikle değerlidir.

Sıfırdan görsel üretmenin ötesinde, Stable Diffusion mevcut görselleri de metinsel talimatlara göre değiştirebilir. Başlangıç görseli ve bir metin istemi verilerek, model metinde tarif edilen değişiklikleri içeren yeni bir görsel üretebilir.

Örneğin, bir kullanıcı bir gündüz şehir manzarası görseli ile “geceye ve neon ışıklara dönüştür” istemini verirse, bu değişiklikleri yansıtan bir görsel elde eder.

Inpainting, bir görseldeki eksik veya bozulmuş alanların doldurulmasıdır. Stable Diffusion, metin istemlerini kullanarak belirli görsel alanların yeniden oluşturulmasında başarılıdır. Kullanıcılar bir görselin bazı bölümlerini maskeleyip, boşluğu neyin doldurması gerektiğini metinsel olarak tarif edebilir.

Bu özellik, fotoğraf restorasyonu, istenmeyen nesnelerin kaldırılması veya bir görseldeki belli unsurların genel tutarlılığı koruyarak değiştirilmesi için kullanışlıdır.

Hafif varyasyonlarla ardışık görseller üreterek, Stable Diffusion animasyon veya video içerik oluşturmak için genişletilebilir. Deforum gibi araçlar, Stable Diffusion’ın yeteneklerini zaman içinde metin istemleriyle yönlendirilen dinamik görsel içerik üretimi için geliştirir.

Bu, geleneksel kare kare animasyon tekniklerine gerek kalmadan animasyon, görsel efekt ve dinamik içerik üretiminde yeni olanaklar sunar.

Stable Diffusion’ın metinden görsel üretme yeteneği, AI otomasyonu ve sohbet botu geliştirmede güçlü bir araçtır.

Stable Diffusion’ı sohbet botlarına entegre etmek, kullanıcı sorularına yanıt olarak görsel içerik üretilmesine olanak tanır. Örneğin, müşteri hizmetleri senaryosunda, bir sohbet botu anında oluşturulan görsel rehberler veya açıklamalar sunabilir.

Metin istemleri, CLIP metin kodlayıcı ile gömülere dönüştürülür. Bu gömüler, görsel üretim sürecinin koşullandırılması için kritik öneme sahiptir ve çıktı görselinin kullanıcının metinsel açıklamasıyla uyumlu olmasını sağlar.

Ters diffusion süreci, latent temsili öngörülen gürültüyü çıkararak yinelemeli olarak rafine etmeyi içerir. Her zaman adımında, model metin gömülerini ve mevcut latent vektör durumunu dikkate alarak gürültü bileşenini doğru şekilde tahmin eder.

Modelin gürültülü görselleri yönetme yeteneği, onu etkili şekilde gürültüsüzleştirmeyi öğrendiği büyük veri setlerinde eğitilmesinden kaynaklanır. Bu eğitim, rastgele gürültüyle başlarken bile net görseller üretebilmesini sağlar.

Latent alanda çalışmak hesaplama verimliliği sağlar. Latent alan, piksel alanına göre daha az boyuta sahip olduğundan, işlemler daha az kaynak gerektirir. Bu verimlilik, Stable Diffusion’ın aşırı hesaplama ihtiyacı olmadan yüksek çözünürlüklü görseller üretebilmesini mümkün kılar.

Sanatçılar ve tasarımcılar, kavramsal açıklamalara dayalı olarak hızlıca görseller prototipleyerek yaratıcı süreçte Stable Diffusion’dan faydalanabilir; fikirden görselleştirmeye geçiş süresini kısaltır.

Pazarlama ekipleri, kapsamlı grafik tasarım kaynaklarına ihtiyaç duymadan kampanya, sosyal medya ve reklamlar için özel görseller oluşturabilir.

Oyun geliştiriciler, açıklayıcı istemler vererek varlıklar, ortamlar ve kavramsal sanat eserleri oluşturabilir; varlık üretim sürecini hızlandırır.

Perakendeciler, ürünlerin farklı ortamlarda veya konfigürasyonlarda görsellerini üreterek ürün görselleştirmesini ve müşteri deneyimini iyileştirebilir.

Eğitimciler ve içerik üreticiler, karmaşık kavramları açıklamak için illüstrasyon ve diyagramlar üretebilir; böylece öğrenme materyallerini daha ilgi çekici hale getirir.

Yapay zeka ve bilgisayarla görme araştırmacıları, diffusion modelleri ve latent alanların yeteneklerini keşfetmek için Stable Diffusion’ı kullanabilir.

Stable Diffusion’ı etkili kullanmak için bazı teknik hususlar dikkate alınmalıdır.

Stable Diffusion’ı kullanmaya başlamak için şu adımları izleyin:

AI otomasyon sistemleri ve sohbet botları geliştirenler için, Stable Diffusion işlevselliği artırmak için entegre edilebilir.

Stable Diffusion kullanırken etik sonuçların farkında olmak önemlidir.

Stable diffusion, üretici modeller alanında, özellikle veri çoğaltma ve görsel sentezde önemli bir konudur. Son çalışmalar, stable diffusion’ın çeşitli uygulama ve etkinliklerini araştırmıştır.

Alpha-Stable Gürültü Ortamlarında Dağıtık Tahmin için Diffusion En Küçük Ortalama P-Güç Algoritmaları — Fuxi Wen (2013):

Alpha-stable gürültü ile karakterize edilen ortamlarda dağıtık tahmin için diffusion en küçük ortalama p-güç (LMP) algoritmasını tanıtır. Çalışma, diffusion LMP yöntemini diffusion en küçük ortalama kareler (LMS) algoritması ile karşılaştırır ve alpha-stable gürültü koşullarında daha iyi performans gösterdiğini gösterir. Bu araştırma, gürültülü ortamlarda sağlam tahmin tekniklerinin geliştirilmesi için kritiktir. Daha fazla oku

COCO ve Yabani Ot Veri Setlerinde Veri Çoğaltma için Stable Diffusion — Boyang Deng (2024):

Stable diffusion modellerinin küçük veri setlerini iyileştirmek için yüksek çözünürlüklü sentetik görseller üretmedeki kullanımı araştırılır. Görselden-görsele çeviri, Dreambooth ve ControlNet gibi tekniklerden yararlanarak, stable diffusion’ın sınıflandırma ve tespit görevlerindeki verimliliği değerlendirilir. Bulgular, stable diffusion’ın çeşitli alanlarda umut vadeden uygulamalar sunduğunu gösteriyor. Daha fazla oku

Temperli α-stable Süreçlerle Kontrol Edilen Diffusion ve Gevşeme — Aleksander Stanislavsky, Karina Weron ve Aleksander Weron (2011):

Temperli α-stable süreçler kullanılarak anormal diffusion ve üstel olmayan gevşeme özellikleri türetilmiştir. α-stable rastgele operasyonel zamanda sonsuz moment zorluğuna çözüm getirir ve özel bir durum olarak alt-diffusion’u da içerir. Daha fazla oku

Stable Diffusion ile Oluşturulan Sentetik Görsel Veri Setinin Değerlendirilmesi — Andreas Stöckl (2022):

Stable Diffusion modeliyle üretilen sentetik görseller, Wordnet sınıflandırması kullanılarak değerlendirilmiştir. Modelin çeşitli kavramlar için doğru görseller üretme kabiliyeti incelenmiş, temsiliyet doğruluğundaki farklılıklar ortaya konmuştur. Bu değerlendirmeler, stable diffusion’ın veri çoğaltmadaki rolünü anlamak için önemlidir. Daha fazla oku

Üretici Modellerin Karşılaştırmalı Analizi: VAEs, GANs ve Stable Diffusion ile Görsel Sentezi Geliştirmek — Sanchayan Vivekananthan (2024):

Üç üretici çerçeve incelenmiştir: VAEs, GANs ve Stable Diffusion modelleri. Araştırma, her modelin güçlü ve zayıf yönlerini vurgularken, stable diffusion’ın belirli sentez görevlerinde üstün olduğunu kaydeder. Daha fazla oku

Stable Diffusion Modelini Hugging Face Diffusers kütüphanesiyle Python’da nasıl uygulayabileceğimize bakalım.

Gerekli kütüphaneleri yükleyin:

pip install torch transformers diffusers accelerate

pip install xformers # İsteğe bağlı

Diffusers kütüphanesi, önceden eğitilmiş modelleri kolayca yüklemenizi sağlar:

from diffusers import StableDiffusionPipeline

import torch

# Stable Diffusion modelini yükleyin

model_id = "stabilityai/stable-diffusion-2-1"

pipe = StableDiffusionPipeline.from_pretrained(model_id, torch_dtype=torch.float16)

pipe = pipe.to("cuda") # Daha hızlı çıkarım için modeli GPU'ya taşıyın

Görsel üretmek için, sadece bir metin istemi verin:

prompt = "Dağlar ve gölle huzurlu bir manzara, foto-gerçekçi, 8K çözünürlük"

image = pipe(prompt).images[0]

# Görseli kaydedin veya görüntüleyin

image.save("generated_image.png")

model_id ile belirtilen önceden eğitilmiş modeli yükler.torch.float16 bellek kullanımını azaltır.Çeşitli parametreleri özelleştirebilirsiniz:

image = pipe(

prompt=prompt,

num_inference_steps=50, # Gürültü giderme adımı sayısı

guidance

Stable Diffusion, metin istemlerinden yüksek kaliteli, foto-gerçekçi görseller üretmek için tasarlanmış gelişmiş bir yapay zeka modelidir. Latent diffusion ve derin öğrenmeyi kullanarak metinsel açıklamaları görsellere dönüştürür.

Stable Diffusion, metin istemlerini bir CLIP metin kodlayıcı ile görüntü gömülerine dönüştürür, ardından istemle yönlendirilen latent bir temsili yinelemeli olarak gürültüsüzleştirerek tutarlı bir görüntü çıktısı oluşturur.

Stable Diffusion; yaratıcı içerik üretimi, pazarlama materyalleri, oyun varlığı oluşturma, e-ticaret ürün görselleştirme, eğitsel illüstrasyonlar ve yapay zeka destekli sohbet botlarında kullanılır.

Evet, Stable Diffusion görselden-görsele çeviri ve inpainting'i destekler; kullanıcıların mevcut görselleri değiştirmesine veya metin istemlerine göre eksik kısımları doldurmasına olanak tanır.

Stable Diffusion ile verimli görüntü üretimi için modern bir GPU'ya sahip bir bilgisayar önerilir. Model ayrıca Python ve PyTorch ile Diffusers gibi kütüphaneleri gerektirir.

Evet, Stable Diffusion izin verici bir açık kaynak lisansı ile yayınlanmıştır; topluluk katkılarını, özelleştirmeyi ve geniş erişilebilirliği teşvik eder.

Stable Diffusion ile yaratıcılığınızı ortaya çıkarın ve yapay zekanın fikirlerinizi nasıl etkileyici görsellere dönüştürebileceğini görün.

Stability AI Görüntü Oluşturucu bileşeni ile metin istemlerinden yüksek kaliteli görseller oluşturun. Stable Diffusion modelleriyle desteklenen bu araç, görsel ...

Stable Diffusion Modellerinde ipuçlarında ustalaşarak yüksek kaliteli yapay zeka tarafından üretilen görseller oluşturun. Konu, stil ve çözünürlük gibi ana unsu...

Black Forest Labs tarafından geliştirilen Flux AI Modeli, doğal dilde verilen istemleri gelişmiş makine öğrenimi algoritmalarıyla son derece ayrıntılı, fotogerç...