Fastn Server

Tích hợp FlowHunt với Fastn Server để hợp nhất truy cập API, điều phối quy trình AI và tự động hóa hoạt động kinh doanh trên các nền tảng như Slack, Notion, Hub...

Hướng dẫn toàn diện về cách tích hợp trí tuệ nhân tạo với các ứng dụng bên ngoài thông qua API và webhook, bao gồm xác thực, giao tiếp thời gian thực và các chiến lược triển khai thực tiễn.

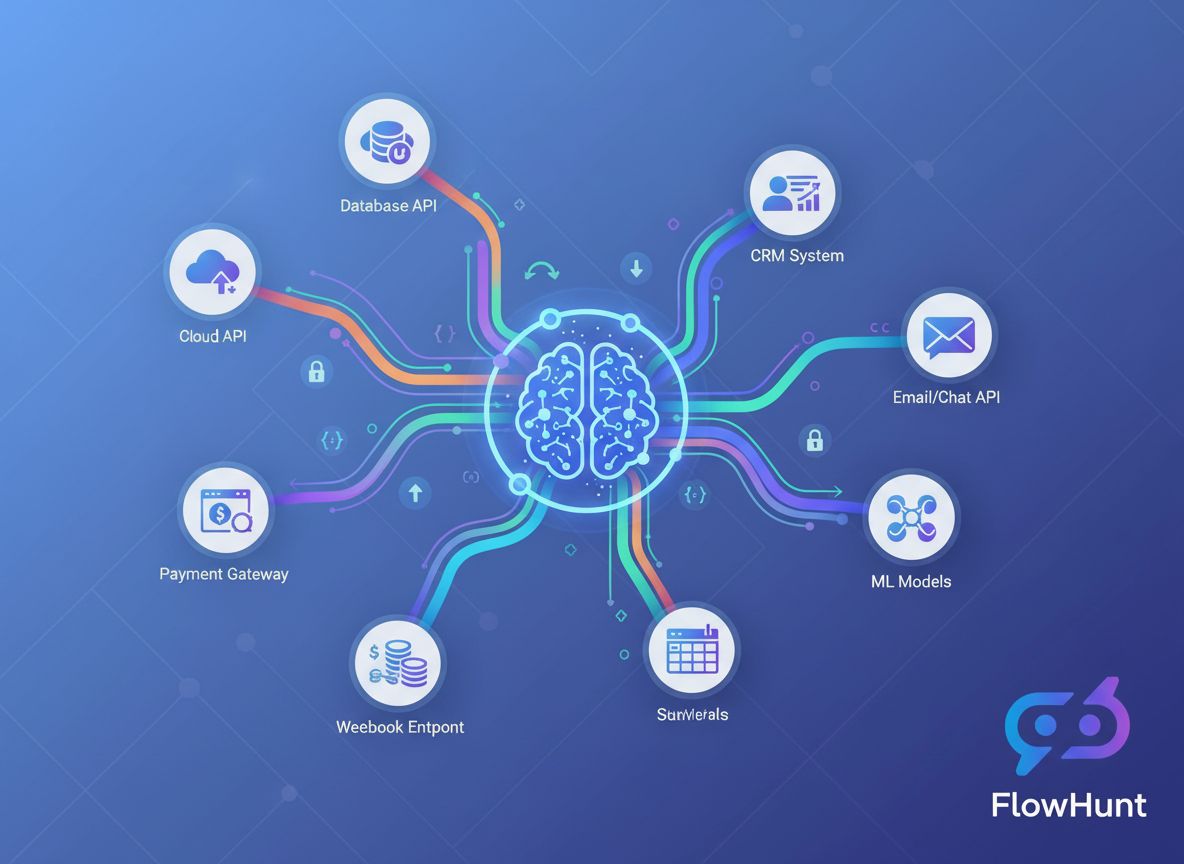

Sự kết hợp giữa trí tuệ nhân tạo và các ứng dụng bên ngoài đã làm thay đổi căn bản cách doanh nghiệp vận hành. Ngày nay, các tổ chức không còn chỉ sử dụng các hệ thống AI biệt lập—thay vào đó, họ triển khai các tích hợp tinh vi, kết nối mô hình AI với nền tảng CRM, cổng thanh toán, công cụ giao tiếp và vô số dịch vụ khác. Bài hướng dẫn toàn diện này sẽ giúp bạn khám phá các phương pháp kỹ thuật và chiến lược để tích hợp AI với công cụ bên ngoài thông qua API và webhook, cung cấp cho bạn kiến thức cần thiết để xây dựng các quy trình AI bền vững, mở rộng và an toàn.

Dù bạn là lập trình viên mới tích hợp AI lần đầu hay kiến trúc sư doanh nghiệp đang thiết kế hệ thống tự động hóa phức tạp, việc hiểu rõ sự khác biệt giữa tích hợp dựa trên API và webhook là rất quan trọng. Bài viết này sẽ đồng hành cùng bạn từ các khái niệm nền tảng đến các mẫu triển khai nâng cao, đảm bảo bạn tự tin kết nối năng lực AI vào hệ thống công nghệ hiện tại.

Trước khi đi sâu vào các chiến lược tích hợp, bạn cần nắm rõ sự khác biệt cơ bản giữa hai mô hình giao tiếp này. API (Giao diện lập trình ứng dụng) là tập hợp các giao thức và công cụ cho phép phần mềm giao tiếp với nhau. API hoạt động theo mô hình pull—ứng dụng của bạn chủ động yêu cầu dữ liệu hoặc dịch vụ từ hệ thống ngoài. Khi cần thông tin, bạn gửi yêu cầu, chờ phản hồi và xử lý dữ liệu trả về.

Ngược lại, webhook hoạt động theo mô hình push. Thay vì ứng dụng của bạn liên tục hỏi thông tin, webhook cho phép hệ thống ngoài chủ động gửi dữ liệu đến ứng dụng của bạn khi có sự kiện xác định. Hãy hình dung như việc bạn liên tục kiểm tra hộp thư trong ngày (API) so với việc bưu tá mang thư đến tận nhà khi có (webhook).

API thường dùng cho các thao tác theo yêu cầu—lấy thông tin người dùng, xử lý thanh toán, tạo dự đoán AI, hoặc lấy dữ liệu thời gian thực. Webhook lại phát huy hiệu quả trong các kịch bản hướng sự kiện, khi bạn cần thông báo tức thời: thanh toán thành công, biểu mẫu được gửi, tệp được tải lên, hoặc người dùng thực hiện hành động.

Lựa chọn giữa API và webhook tùy thuộc vào bài toán cụ thể. Nhiều tích hợp hiện đại thường dùng cả hai: API để truy vấn dữ liệu và webhook cho thông báo thời gian thực. Phương pháp kết hợp này mang lại sự linh hoạt và đáp ứng mà ứng dụng hiện đại cần.

Lý do kinh doanh cho việc tích hợp AI với các công cụ ngoài rất thuyết phục và đa dạng. Những tổ chức thực hiện thành công sẽ đạt được lợi thế cạnh tranh rõ rệt trên nhiều phương diện.

Tăng hiệu quả vận hành & giảm chi phí: Khi hệ thống AI tách rời khỏi công cụ hiện có, bạn tạo ra các điểm nghẽn dữ liệu và các công đoạn thủ công. Tích hợp AI trực tiếp với CRM, email, quản lý dự án… loại bỏ các điểm ma sát này. Thay vì nhập/xuất dữ liệu thủ công, AI sẽ tự động xử lý, phân tích và kích hoạt hành động trên toàn bộ hệ thống. Tự động hóa này giảm chi phí vận hành, hạn chế lỗi con người và giải phóng nhân sự cho các công việc chiến lược hơn.

Ra quyết định thời gian thực: Webhook giúp AI phản ứng ngay lập tức với sự kiện kinh doanh. Khi khách hàng gửi ticket, AI có thể phân tích cảm xúc và phân luồng cho đúng bộ phận. Khi dữ liệu bán hàng cập nhật, AI tính toán lại dự báo. Khi tồn kho thấp, AI tự động đặt hàng bổ sung. Khả năng phản ứng tức thời này thay đổi cách doanh nghiệp thích ứng với thị trường và phục vụ khách hàng.

Nâng cao trải nghiệm khách hàng: AI tích hợp cung cấp trải nghiệm liền mạch và cá nhân hóa. Chatbot AI kết nối CRM có thể truy xuất lịch sử khách, trả lời theo ngữ cảnh. Hệ thống gợi ý AI trên sàn thương mại điện tử có thể đề xuất sản phẩm phù hợp. Trợ lý lên lịch AI tích hợp với lịch làm việc tự động tìm slot họp. Những trải nghiệm này tạo sự hài lòng và tăng sự trung thành của khách hàng.

Phân tích dữ liệu quy mô lớn: Kết nối AI với nhiều nguồn dữ liệu qua API giúp doanh nghiệp xây dựng hệ thống phân tích tổng thể, xử lý thông tin từ toàn bộ hoạt động. Bức tranh hợp nhất này cho phép dự đoán chính xác, nhận diện mẫu tốt hơn, và có những insight mà dữ liệu rời rạc không thể mang lại.

Những lợi ích chính:

API là xương sống của hầu hết các tích hợp AI. Để kết nối AI với công cụ bên ngoài hiệu quả, bạn cần hiểu cách API hoạt động và cách tương tác với chúng thông qua lập trình.

API hiện đại có nhiều loại, mỗi loại có đặc điểm riêng. REST (Representational State Transfer) API là loại phổ biến nhất, sử dụng các phương thức HTTP chuẩn (GET, POST, PUT, DELETE) để thao tác trên resource được định danh bằng URL. REST API không lưu trạng thái, mỗi yêu cầu đều chứa đủ thông tin để xử lý, dễ hiểu và triển khai.

GraphQL API linh hoạt hơn, cho phép client chỉ lấy đúng dữ liệu cần, thay vì nhận về cấu trúc phản hồi cố định. Điều này tối ưu cho truy vấn phức tạp nhưng cần client tinh vi hơn.

SOAP API là giao thức cũ hơn, dựa trên XML, vẫn còn dùng trong môi trường doanh nghiệp. SOAP phức tạp hơn REST nhưng có nhiều tính năng mạnh cho tích hợp enterprise.

RPC API cho phép gọi hàm trên server từ xa như thể gọi local. Một số API blockchain hoặc crypto dùng kiểu này.

Hầu hết các tích hợp AI sẽ dùng REST API, cân bằng giữa đơn giản và đầy đủ chức năng.

Mọi tương tác với API đều cần xác thực để đảm bảo ứng dụng bạn có quyền truy cập dịch vụ. Hiểu các cơ chế xác thực rất quan trọng cho bảo mật khi tích hợp AI.

API Key là phương thức xác thực đơn giản nhất. Khi đăng ký dịch vụ API, bạn nhận được một khóa riêng và thêm nó vào yêu cầu. Tuy dễ dùng, API Key có hạn chế—không tự hết hạn, quyền truy cập thường toàn bộ, không phân quyền chi tiết. Phù hợp cho phát triển hoặc thao tác không nhạy cảm, nhưng không nên là lớp bảo mật duy nhất khi chạy thật.

OAuth 2.0 là chuẩn ngành cho ủy quyền truy cập. Thay vì chia sẻ thông tin đăng nhập, OAuth cho phép người dùng ủy quyền ứng dụng truy cập dữ liệu thay mặt họ. Đây là phương thức bạn thấy khi app yêu cầu “truy cập tài khoản Google của bạn” hay “kết nối với Slack”. OAuth phức tạp hơn để triển khai nhưng bảo mật và kiểm soát tốt hơn.

Bearer Token & JWT (JSON Web Token) kết hợp sự đơn giản của API Key với bảo mật nâng cao. JWT là token được ký số, chứa thông tin về user/app, có thể gồm thời hạn, quyền hạn, metadata… rất phù hợp cho microservices và hệ phân tán.

Mutual TLS (mTLS) dùng chứng chỉ cho cả client và server, bảo mật cao nhất. Phổ biến trong doanh nghiệp hoặc các thao tác nhạy cảm.

Tương tác với API là xây dựng request HTTP với header, tham số và nội dung phù hợp. Ví dụ gọi API AI:

import requests

import json

# Thiết lập xác thực

headers = {

'Authorization': 'Bearer YOUR_API_KEY',

'Content-Type': 'application/json',

}

# Chuẩn bị dữ liệu gửi

data = {

'model': 'gpt-4',

'messages': [

{

'role': 'user',

'content': 'Phân tích phản hồi khách hàng này về cảm xúc'

}

],

'temperature': 0.7,

'max_tokens': 500,

}

# Gửi yêu cầu API

response = requests.post(

'https://api.openai.com/v1/chat/completions',

headers=headers,

json=data

)

# Xử lý phản hồi

if response.status_code == 200:

result = response.json()

ai_response = result['choices'][0]['message']['content']

print(f"Phân tích AI: {ai_response}")

else:

print(f"Lỗi: {response.status_code} - {response.text}")

Mẫu này thể hiện quy trình cơ bản: xác thực, xây dựng request, gửi lên endpoint API và xử lý phản hồi. Hầu hết các tích hợp AI đều theo cấu trúc này, chỉ khác tham số và định dạng phản hồi tùy dịch vụ.

API lấy dữ liệu khi cần, còn webhook cho phép giao tiếp thời gian thực theo mô hình push. Hiểu kiến trúc webhook là chìa khóa xây dựng hệ thống AI phản ứng nhanh.

Webhook thực chất là cơ chế callback. Bạn đăng ký một URL với dịch vụ ngoài, khi có sự kiện, dịch vụ đó gửi HTTP POST tới URL này kèm dữ liệu sự kiện. Ứng dụng của bạn nhận, xử lý và thực hiện hành động.

Luồng hoạt động:

Xây dựng webhook receiver là tạo endpoint HTTP nhận POST request. Ví dụ với Flask:

from flask import Flask, request, jsonify

import hmac

import hashlib

import json

app = Flask(__name__)

WEBHOOK_SECRET = 'your_webhook_secret_key'

def verify_webhook_signature(payload, signature):

"""Xác thực webhook đến từ nguồn hợp lệ"""

expected_signature = hmac.new(

WEBHOOK_SECRET.encode(),

payload,

hashlib.sha256

).hexdigest()

return hmac.compare_digest(signature, expected_signature)

@app.route('/webhook/payment', methods=['POST'])

def handle_payment_webhook():

# Lấy payload thô để xác thực chữ ký

payload = request.get_data()

signature = request.headers.get('X-Signature')

# Xác thực webhook

if not verify_webhook_signature(payload, signature):

return jsonify({'error': 'Chữ ký không hợp lệ'}), 401

# Parse JSON

data = request.json

# Xử lý sự kiện

try:

if data['event_type'] == 'payment.completed':

# Gọi AI phân tích giao dịch

analyze_transaction(data['transaction_id'], data['amount'])

# Cập nhật DB

update_payment_status(data['transaction_id'], 'completed')

# Gửi email xác nhận

send_confirmation_email(data['customer_email'])

# Luôn trả 200 để xác nhận nhận được

return jsonify({'status': 'received'}), 200

except Exception as e:

# Log lỗi nhưng vẫn trả 200 để tránh retry

log_error(f"Lỗi xử lý webhook: {str(e)}")

return jsonify({'status': 'received'}), 200

if __name__ == '__main__':

app.run(port=5000)

Ví dụ này áp dụng các thực tiễn tốt nhất: xác thực chữ ký, xử lý lỗi phù hợp, và luôn trả phản hồi thành công để tránh dịch vụ ngoài gửi lại.

Webhook có những thách thức bảo mật riêng vì hệ thống ngoài chủ động gửi dữ liệu vào ứng dụng bạn. Các biện pháp cần thiết:

Xác thực chữ ký: Hầu hết nhà cung cấp webhook gửi chữ ký trong header, sinh từ secret chung. Luôn xác thực chữ ký để đảm bảo webhook hợp lệ, không bị can thiệp.

Chỉ dùng HTTPS: Bắt buộc dùng HTTPS cho endpoint webhook để mã hóa dữ liệu, chống tấn công trung gian.

Whitelist IP: Nếu có thể, chỉ cho phép IP cụ thể gửi webhook tới endpoint, ngăn nguồn không hợp lệ.

Giới hạn tốc độ: Áp dụng rate limit cho endpoint để tránh lạm dụng hoặc bị spam.

Idempotency: Xử lý webhook phải idempotent—xử lý lại nhiều lần vẫn ra kết quả như nhau, vì provider có thể gửi lại nếu lần đầu thất bại.

Sau khi hiểu nền tảng, hãy khám phá cách tích hợp mô hình AI với các dịch vụ ngoài. Đây là lúc sức mạnh thực sự của AI tích hợp phát huy.

Thị trường AI có nhiều lựa chọn với năng lực, giá cả và cách tích hợp khác nhau. API OpenAI truy cập GPT-4, GPT-3.5 cho NLP, sinh code, suy luận… Google Cloud AI có Vertex AI, Document AI, Vision AI. AWS cung cấp SageMaker cho mô hình tùy chỉnh và nhiều dịch vụ AI dựng sẵn. Claude API của Anthropic chuyên về AI an toàn, dễ giải thích. Hugging Face có model open-source và model hub.

Lựa chọn của bạn dựa trên: năng lực AI cần, ngân sách, độ trễ, bảo mật dữ liệu, ưu tiên dịch vụ quản lý hay tự triển khai.

Một pipeline tích hợp AI điển hình gồm: thu thập dữ liệu từ API ngoài, tiền xử lý, đưa qua AI, xử lý kết quả và kích hoạt hành động. Ví dụ tích hợp nhiều thành phần:

import requests

import json

from datetime import datetime

import logging

class AIIntegrationPipeline:

def __init__(self, ai_api_key, crm_api_key):

self.ai_api_key = ai_api_key

self.crm_api_key = crm_api_key

self.logger = logging.getLogger(__name__)

def fetch_customer_data(self, customer_id):

"""Lấy dữ liệu khách hàng từ API CRM"""

headers = {'Authorization': f'Bearer {self.crm_api_key}'}

response = requests.get(

f'https://api.crm.example.com/customers/{customer_id}',

headers=headers

)

return response.json()

def analyze_with_ai(self, text_content):

"""Gửi nội dung lên AI để phân tích"""

headers = {

'Authorization': f'Bearer {self.ai_api_key}',

'Content-Type': 'application/json'

}

payload = {

'model': 'gpt-4',

'messages': [

{

'role': 'system',

'content': 'Bạn là chuyên gia chăm sóc khách hàng. Hãy phân tích tương tác và đưa ra nhận định.'

},

{

'role': 'user',

'content': text_content

}

],

'temperature': 0.5,

'max_tokens': 1000

}

response = requests.post(

'https://api.openai.com/v1/chat/completions',

headers=headers,

json=payload

)

if response.status_code == 200:

return response.json()['choices'][0]['message']['content']

else:

self.logger.error(f"Lỗi API AI: {response.status_code}")

raise Exception("Phân tích AI thất bại")

def update_crm_with_insights(self, customer_id, insights):

"""Cập nhật CRM với nhận định từ AI"""

headers = {

'Authorization': f'Bearer {self.crm_api_key}',

'Content-Type': 'application/json'

}

payload = {

'ai_insights': insights,

'last_analyzed': datetime.now().isoformat(),

'analysis_status': 'completed'

}

response = requests.put(

f'https://api.crm.example.com/customers/{customer_id}',

headers=headers,

json=payload

)

return response.status_code == 200

def process_customer(self, customer_id):

"""Pipeline hoàn chỉnh: lấy, phân tích, cập nhật"""

try:

# Lấy dữ liệu

customer_data = self.fetch_customer_data(customer_id)

# Chuẩn bị nội dung cho AI

content_to_analyze = f"""

Khách hàng: {customer_data['name']}

Tương tác gần đây: {customer_data['recent_interactions']}

Lịch sử mua hàng: {customer_data['purchase_history']}

"""

# Gửi cho AI phân tích

insights = self.analyze_with_ai(content_to_analyze)

# Cập nhật CRM với kết quả

success = self.update_crm_with_insights(customer_id, insights)

if success:

self.logger.info(f"Đã xử lý thành công khách hàng {customer_id}")

return {'status': 'success', 'insights': insights}

else:

self.logger.error(f"Lỗi cập nhật CRM cho {customer_id}")

return {'status': 'error', 'message': 'CRM update failed'}

except Exception as e:

self.logger.error(f"Lỗi pipeline: {str(e)}")

return {'status': 'error', 'message': str(e)}

Đây là pipeline hoàn chỉnh: lấy dữ liệu từ CRM, gửi lên AI để phân tích, cập nhật lại kết quả vào CRM. Mẫu này có thể áp dụng cho vô số bài toán kinh doanh.

Mỗi kịch bản tích hợp sẽ phù hợp với kiến trúc khác nhau. Hiểu rõ ưu/nhược điểm giúp bạn chọn đúng giải pháp.

| Phương pháp | Phù hợp nhất cho | Ưu điểm | Nhược điểm | Độ trễ |

|---|---|---|---|---|

| Gọi API đồng bộ | Tính năng thời gian thực, giao diện người dùng | Đơn giản, phản hồi tức thì, dễ debug | Chậm nếu AI xử lý lâu, chặn luồng | Thấp đến Trung bình |

| Bất đồng bộ với webhook | Quy trình hướng sự kiện, khối lượng lớn | Không chặn, mở rộng tốt, phản hồi nhanh | Phức tạp hơn, nhất quán trễ | Trung bình đến Cao |

| Hàng đợi thông điệp | Hệ thống tách rời, xử lý batch | Đảm bảo giao hàng, cân bằng tải, retry | Hạ tầng phụ, nhất quán trễ | Trung bình đến Cao |

| Job định kỳ | Phân tích theo đợt, xử lý batch | Đơn giản, tài nguyên dự đoán trước | Không thời gian thực, có thể bỏ lỡ sự kiện gấp | Cao |

| Tích hợp streaming | Xử lý dữ liệu real-time, phân tích liên tục | Insight tức thì, chịu tải lớn | Hạ tầng phức tạp, cần công cụ chuyên biệt | Rất thấp |

Mỗi cách đều có vai trò riêng. Hệ thống chăm sóc khách hàng có thể dùng API đồng bộ cho chatbot, nhưng phân tích cảm xúc chuyên sâu sẽ chạy bất đồng bộ. Sàn thương mại điện tử dùng webhook cho đơn hàng, job định kỳ cho phân tích kho.

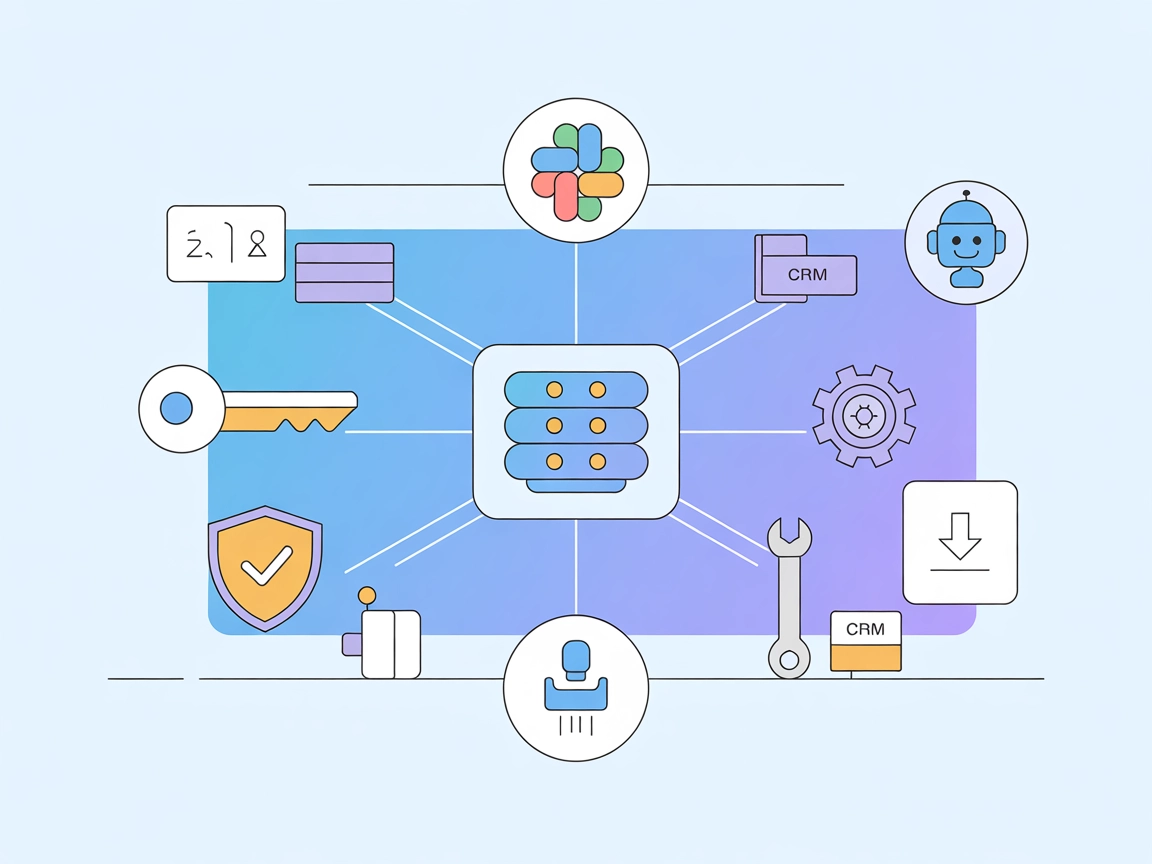

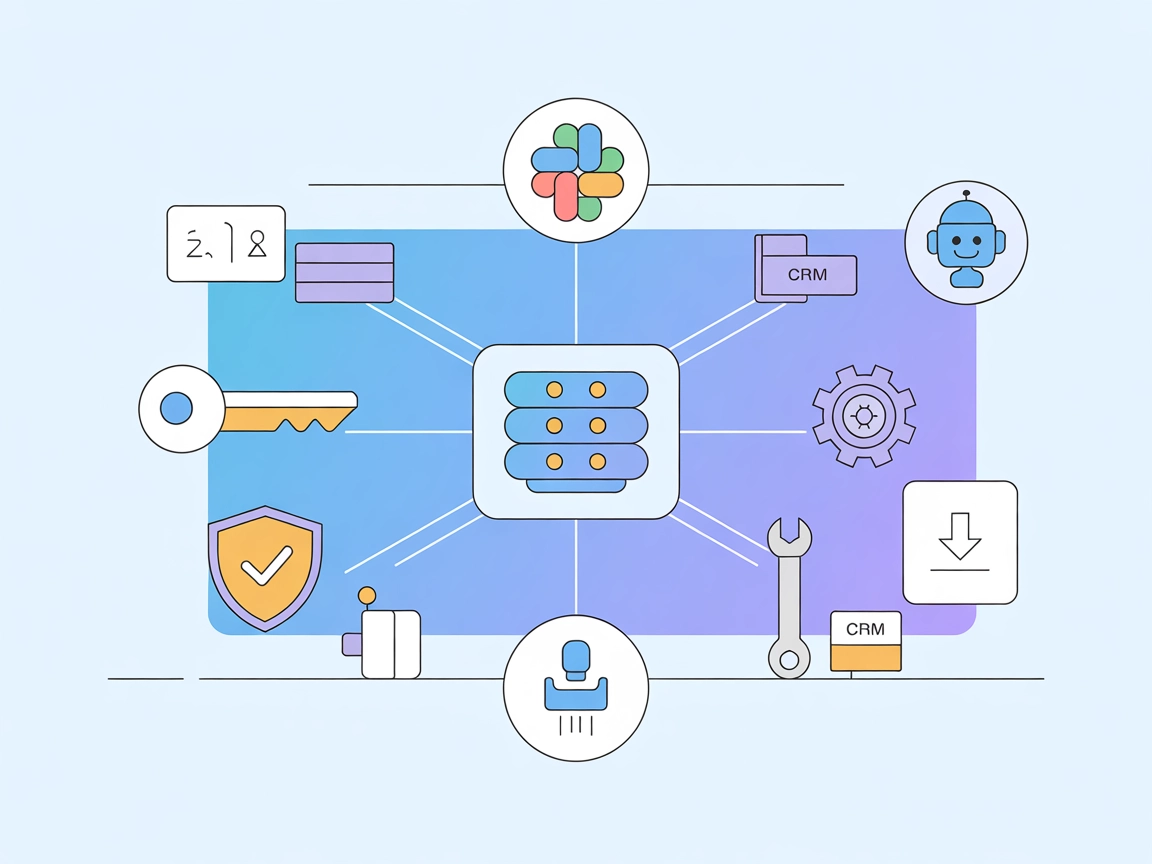

Khi hệ thống lớn, việc quản lý nhiều API/webhook thủ công sẽ trở nên quá tải. FlowHunt giúp bạn thay đổi chiến lược tích hợp.

FlowHunt là nền tảng tự động hóa quy trình dành riêng cho tích hợp AI. Thay vì phải tự viết, bảo trì code tích hợp, FlowHunt cung cấp giao diện trực quan để kết nối AI, API và webhook, quản lý xác thực, xử lý lỗi và kiểm soát hiệu năng.

Visual Workflow Builder: Thiết kế quy trình tích hợp phức tạp mà không cần code. Kết nối AI, API, webhook bằng thao tác kéo-thả trực quan. FlowHunt tự động xử lý HTTP, xác thực, chuyển đổi dữ liệu.

Connector dựng sẵn: FlowHunt tích hợp sẵn connector cho các dịch vụ AI phổ biến (OpenAI, Google Cloud AI, Anthropic) và hàng trăm công cụ ngoài (Salesforce, HubSpot, Slack, Stripe…). Các connector này tự động xử lý xác thực và chi tiết riêng của API.

Quản lý webhook: FlowHunt đơn giản hóa việc đăng ký, nhận sự kiện, kích hoạt phân tích AI—all trên cùng giao diện, không cần xây receiver thủ công.

Xử lý lỗi & retry: Tự động retry API lỗi với backoff hàm mũ. Thiết lập thông báo lỗi, workflow fallback. Đảm bảo tích hợp của bạn bền vững, ổn định.

Biến đổi dữ liệu: Chuyển đổi dữ liệu giữa các định dạng khác nhau. Mapping trường từ CRM sang input AI, chuyển output AI thành định dạng các công cụ khác cần.

Giám sát & logging: Theo dõi từng cuộc gọi API, sự kiện webhook, từng lần chạy workflow. Xác định điểm nghẽn, debug, tối ưu hóa với log và phân tích chi tiết.

Giới hạn tốc độ & throttle: FlowHunt tự động kiểm soát giới hạn API, xếp hàng request, phân bổ hợp lý để không vượt ngưỡng.

Bạn muốn tự động phân tích phản hồi khách hàng từ hệ thống hỗ trợ, phân loại cảm xúc, cập nhật CRM. Workflow trên FlowHunt sẽ gồm:

Thay vì phải code thủ công hàng chục dòng và xử lý lỗi, mọi thứ chỉ là workflow trực quan. Bạn dễ dàng chỉnh sửa, thêm bước, đổi model AI mà không cần động đến code.

Khi nhu cầu tích hợp AI tăng, một số mẫu nâng cao và thực tiễn sau sẽ rất quan trọng.

Hầu hết API đều giới hạn số request mỗi phút/giờ. Vượt ngưỡng sẽ bị lỗi, thậm chí bị khóa dịch vụ. Quản lý rate limit hiệu quả là chìa khóa tích hợp ổn định.

Hãy dùng backoff hàm mũ: mỗi lần bị limit, chờ lâu hơn trước khi gửi lại. Đa số API trả thông tin limit trong header, cho phép bạn chủ động kiểm soát tốc độ gửi request.

import time

import requests

def call_api_with_backoff(url, headers, data, max_retries=5):

"""Gọi API với backoff khi bị giới hạn"""

for attempt in range(max_retries):

try:

response = requests.post(url, headers=headers, json=data)

# Kiểm tra bị limit

if response.status_code == 429:

retry_after = int(response.headers.get('Retry-After', 2 ** attempt))

print(f"Bị giới hạn. Đợi {retry_after} giây...")

time.sleep(retry_after)

continue

# Kiểm tra lỗi khác

response.raise_for_status()

return response.json()

except requests.exceptions.RequestException as e:

if attempt == max_retries - 1:

raise

wait_time = 2 ** attempt

print(f"Request lỗi: {e}. Thử lại sau {wait_time} giây...")

time.sleep(wait_time)

raise Exception("Vượt quá số lần retry")

Một số thao tác AI cần thời gian xử lý dài. Thay vì chờ đợi, hãy dùng mẫu async: dịch vụ AI trả về job_id, bạn polling hoặc nhận webhook khi xong.

def submit_async_ai_job(content):

"""Gửi nội dung cho AI xử lý bất đồng bộ"""

headers = {'Authorization': f'Bearer {AI_API_KEY}'}

response = requests.post(

'https://api.ai.example.com/async-analyze',

headers=headers,

json={'content': content}

)

job_data = response.json()

return job_data['job_id']

def check_job_status(job_id):

"""Kiểm tra trạng thái job"""

headers = {'Authorization': f'Bearer {AI_API_KEY}'}

response = requests.get(

f'https://api.ai.example.com/jobs/{job_id}',

headers=headers

)

job_data = response.json()

if job_data['status'] == 'completed':

return {'status': 'completed', 'result': job_data['result']}

elif job_data['status'] == 'failed':

return {'status': 'failed', 'error': job_data['error']}

else:

return {'status': 'processing'}

Gọi API AI với cùng input nhiều lần sẽ lãng phí tài nguyên. Hãy cache kết quả cho các truy vấn phổ biến.

import hashlib

import json

from functools import wraps

import redis

# Kết nối Redis cache

cache = redis.Redis(host='localhost', port=6379, db=0)

def cache_ai_result(ttl=3600):

"""Decorator cache kết quả AI"""

def decorator(func):

@wraps(func)

def wrapper(content, *args, **kwargs):

content_hash = hashlib.md5(content.encode()).hexdigest()

cache_key = f"ai_result:{content_hash}"

cached_result = cache.get(cache_key)

if cached_result:

return json.loads(cached_result)

result = func(content, *args, **kwargs)

cache.setex(cache_key, ttl, json.dumps(result))

return result

return wrapper

return decorator

@cache_ai_result(ttl=86400) # Cache 24h

def analyze_sentiment(text):

"""Phân tích cảm xúc có caching"""

# Gọi API AI tại đây

pass

Tích hợp sản xuất cần giám sát toàn diện. Theo dõi thời gian API, tỷ lệ lỗi, thành công webhook. Thiết lập cảnh báo khi có bất thường.

import logging

from datetime import datetime

import json

class IntegrationMonitor:

def __init__(self, log_file='integration.log'):

self.logger = logging.getLogger(__name__)

handler = logging.FileHandler(log_file)

formatter = logging.Formatter(

'%(asctime)s - %(name)s - %(levelname)s - %(message)s'

)

handler.setFormatter(formatter)

self.logger.addHandler(handler)

def log_api_call(self, service, endpoint, status_code, response_time, error=None):

"""Ghi log API call"""

log_entry = {

'timestamp': datetime.now().isoformat(),

'service': service,

'endpoint': endpoint,

'status_code': status_code,

'response_time_ms': response_time,

'error': error

}

self.logger.info(json.dumps(log_entry))

def log_webhook_event(self, event_type, source, success, processing_time):

"""Ghi log sự kiện webhook"""

log_entry = {

'timestamp': datetime.now().isoformat(),

'event_type': event_type,

'source': source,

'success': success,

'processing_time_ms': processing_time

}

self.logger.info(json.dumps(log_entry))

Xem xét một ví dụ thực tế cho thấy các khái niệm này hội tụ trong doanh nghiệp.

Bài toán: Một công ty thương mại điện tử muốn nâng cao trải nghiệm khách hàng bằng gợi ý sản phẩm cá nhân hóa, tự động phân loại bình luận khách hàng và phát hiện đơn hàng gian lận. Họ có nhiều hệ thống: cửa hàng Shopify, nền tảng review riêng, cổng thanh toán, database khách hàng. Các hệ thống này không giao tiếp tốt, việc phân tích review và phát hiện gian lận chủ yếu thủ công.

Giải pháp: Họ xây dựng hệ tích hợp AI qua API và webhook:

Engine gợi ý sản phẩm: Khi khách xem sản phẩm (webhook từ Shopify), hệ thống lấy lịch sử mua qua API, gửi dữ liệu cho AI phân tích và trả về gợi ý cá nhân hóa. AI xét đặc điểm sản phẩm, sở thích khách, sản phẩm hot.

Pipeline phân tích review: Khi khách gửi review (webhook), hệ thống gửi nội dung cho AI phân tích cảm xúc, trích xuất chủ đề, đánh giá chất lượng. Kết quả lưu lại nền tảng review qua API, giúp công ty nắm bắt cảm xúc khách hàng quy mô lớn.

Phát hiện gian lận: Khi có đơn hàng (webhook), hệ thống lấy lịch sử khách và chi tiết đơn qua API, gửi cho model AI kiểm tra gian lận, từ đó duyệt hoặc flag đơn cho kiểm tra thủ công.

Kết quả: Doanh số trung bình mỗi đơn tăng 23% nhờ gợi ý tốt, thời gian xử lý review giảm 85%, đơn gian lận giảm 67%. Hệ thống xử lý hàng ngàn sự kiện/ngày với uptime 99.9%.

Công nghệ sử dụng: Shopify API, webhook receiver tùy chỉnh, API OpenAI cho NLP, model phát hiện gian lận chạy trên AWS, Redis cache, logging toàn diện.

Case study này cho thấy cách tích hợp API & webhook hiệu quả có thể tạo giá trị kinh doanh lớn.

Tích hợp AI với công cụ bên ngoài thông qua API & webhook không còn là lựa chọn xa xỉ—mà là điều kiện cần để doanh nghiệp cạnh tranh. Khả năng kết nối AI với hệ thống sẵn có, tự động hóa quy trình, phản ứng theo sự kiện thời gian thực sẽ thay đổi cách doanh nghiệp vận hành.

Chìa khóa thành công là hiểu gốc rễ: API hoạt động ra sao, webhook giúp giao tiếp real-time như thế nào, cách xác thực an toàn, xử lý lỗi hợp lý. Xa hơn, các mẫu nâng cao như xử lý bất đồng bộ, caching, giám sát toàn diện sẽ đảm bảo hệ thống tích hợp ổn định khi mở rộng.

Dù bạn xây tích hợp AI đầu tiên hay kiến trúc hệ thống phức tạp cho doanh nghiệp lớn, các nguyên tắc trong bài này là nền tảng vững chắc. Hãy bắt đầu từ yêu cầu rõ ràng, chọn mẫu tích hợp phù hợp, xây dựng xử lý lỗi chắc chắn và giám sát mọi thứ. Khi nhu cầu tăng cao, các nền tảng như FlowHunt sẽ giúp bạn quản lý sự phức tạp mà không mất đi sự linh hoạt.

Tương lai thuộc về doanh nghiệp biết kết hợp AI thông minh vào hệ vận hành. Làm chủ tích hợp API & webhook, bạn đang mở cánh cửa phát huy tiềm năng AI mà vẫn đảm bảo độ tin cậy, bảo mật doanh nghiệp yêu cầu.

Experience how FlowHunt automates your AI integrations with external tools — from API management and webhook handling to error recovery and monitoring — all in one unified platform.

Arshia là Kỹ sư Quy trình AI tại FlowHunt. Với nền tảng về khoa học máy tính và niềm đam mê AI, anh chuyên tạo ra các quy trình hiệu quả tích hợp công cụ AI vào các nhiệm vụ hàng ngày, nâng cao năng suất và sự sáng tạo.

FlowHunt giúp đơn giản hóa việc tích hợp AI với các công cụ bên ngoài, tự động hóa các cuộc gọi API, quản lý webhook và xử lý dữ liệu trên một nền tảng thống nhất.

Tích hợp FlowHunt với Fastn Server để hợp nhất truy cập API, điều phối quy trình AI và tự động hóa hoạt động kinh doanh trên các nền tảng như Slack, Notion, Hub...

Tích hợp FlowHunt với MCP OpenAPI để tự động hóa quy trình làm việc, đồng bộ dữ liệu thời gian thực và tăng cường doanh nghiệp của bạn với các tích hợp API an t...

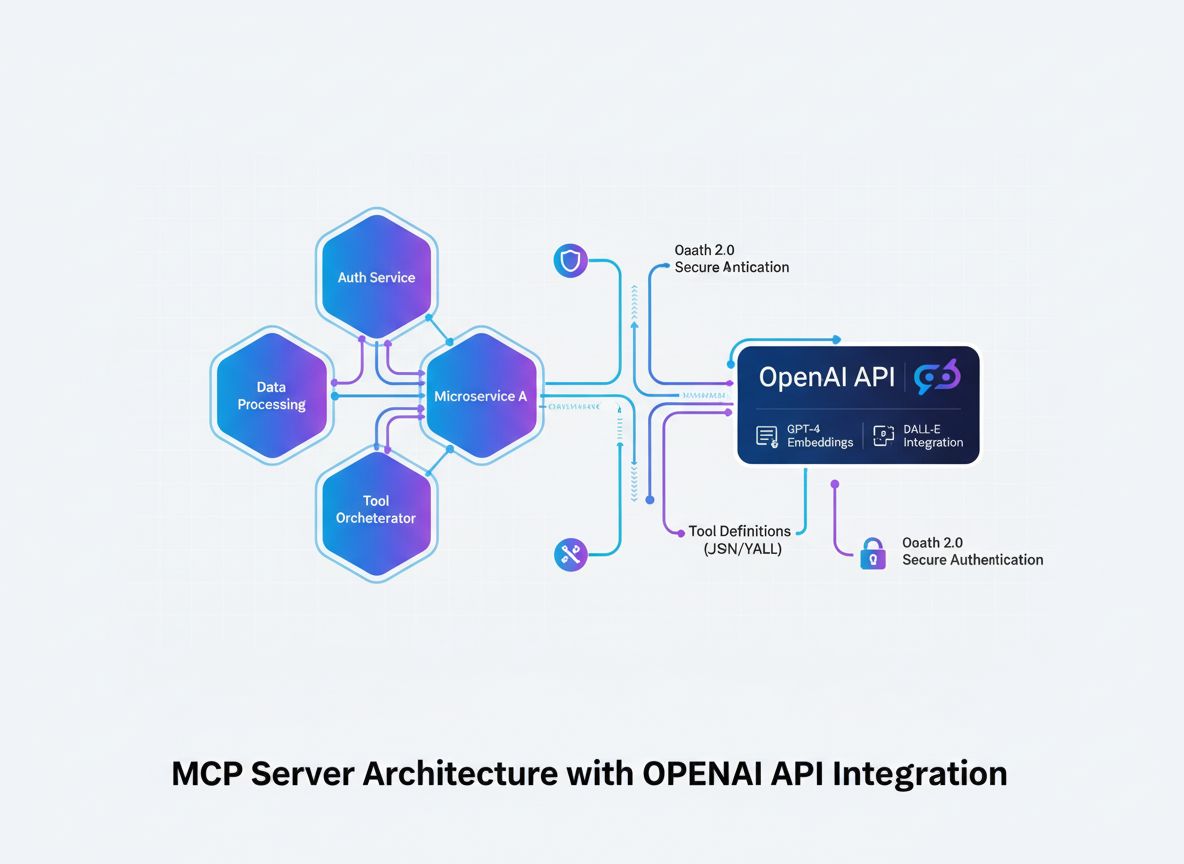

Tìm hiểu cách phát triển một máy chủ Model Context Protocol (MCP) tích hợp liền mạch với API của OpenAI, cho phép thực thi công cụ AI mạnh mẽ và tự động hóa thô...

Đồng Ý Cookie

Chúng tôi sử dụng cookie để cải thiện trải nghiệm duyệt web của bạn và phân tích lưu lượng truy cập của mình. See our privacy policy.