18 Nền tảng AI tốt nhất năm 2025: Tính năng, Ứng dụng và Cách chọn

Khám phá 18 nền tảng AI hàng đầu năm 2025, các tính năng, ứng dụng thực tiễn và bí quyết chọn nền tảng phù hợp cho doanh nghiệp của bạn. Luôn dẫn đầu trong thế ...

Hướng Dẫn Quản Lý Rủi Ro và Kiểm Soát AI của KPMG cung cấp cho các tổ chức một phương pháp tiếp cận có cấu trúc, đạo đức để quản lý rủi ro AI, hỗ trợ triển khai có trách nhiệm và tuân thủ các tiêu chuẩn toàn cầu.

Con số thống kê đầu tiên này có thể từ năm ngoái, nhưng hiện tại vẫn cực kỳ phù hợp. Theo KPMG’s 2024 U.S. CEO Outlook, có tới 68% CEO xác định AI là ưu tiên đầu tư hàng đầu. Họ kỳ vọng AI sẽ giúp tăng hiệu quả, nâng cao kỹ năng cho lực lượng lao động và thúc đẩy đổi mới trên toàn tổ chức.

Đây là một sự tín nhiệm lớn dành cho AI — nhưng cũng đặt ra một câu hỏi quan trọng: với quá nhiều điều đặt cược, các tổ chức làm thế nào để đảm bảo sử dụng AI một cách có trách nhiệm và đạo đức?

Đây là lúc Hướng Dẫn Quản Lý Rủi Ro và Kiểm Soát AI của KPMG phát huy vai trò. Hướng dẫn này mang đến một khung rõ ràng, thực tiễn giúp doanh nghiệp khai thác tiềm năng của AI đồng thời kiểm soát các rủi ro thực tế mà AI mang lại. Trong bối cảnh hiện nay, xây dựng AI đáng tin cậy không chỉ là thực hành tốt — mà còn là một yêu cầu sống còn cho doanh nghiệp.

Trí tuệ Nhân tạo (AI) đang cách mạng hóa các ngành công nghiệp, mở ra mức độ hiệu quả, đổi mới và sức cạnh tranh mới. Tuy nhiên, đi kèm với sự chuyển đổi này là những rủi ro và thách thức đạo đức riêng biệt mà các tổ chức phải quản lý cẩn trọng để duy trì niềm tin và đảm bảo sử dụng có trách nhiệm. Hướng Dẫn Quản Lý Rủi Ro và Kiểm Soát AI của KPMG được thiết kế nhằm hỗ trợ các tổ chức vượt qua những phức tạp này, cung cấp một phương pháp tiếp cận thực tiễn, có cấu trúc và dựa trên giá trị cho quản trị AI.

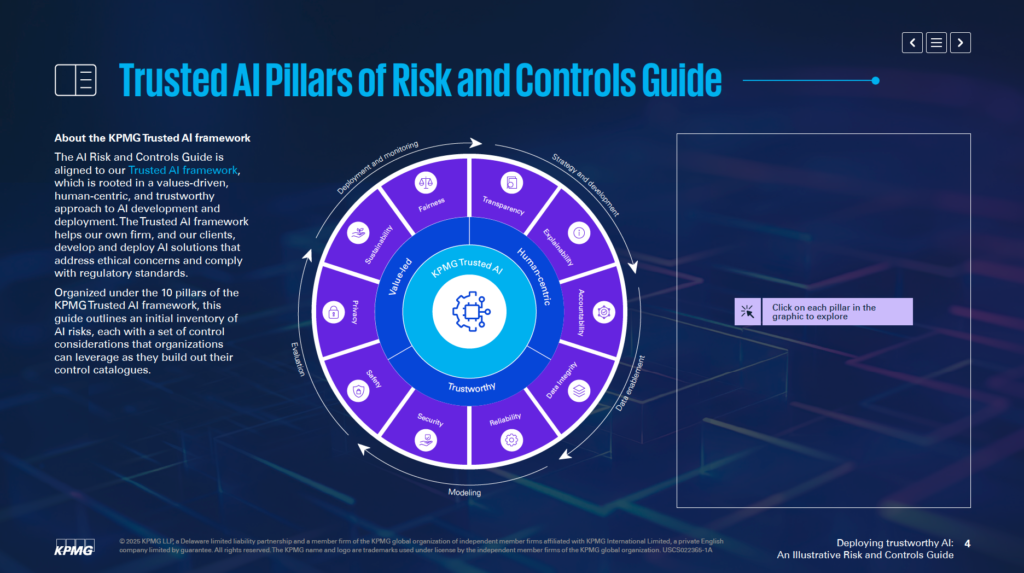

Phù hợp với Khung AI Đáng Tin Cậy của KPMG, hướng dẫn này giúp doanh nghiệp phát triển và triển khai các giải pháp AI đạo đức, lấy con người làm trung tâm và tuân thủ các tiêu chuẩn pháp lý toàn cầu. Hướng dẫn được tổ chức xoay quanh 10 trụ cột nền tảng, mỗi trụ cột tập trung vào một khía cạnh trọng yếu của quản lý rủi ro AI:

Tập trung vào các trụ cột này, các tổ chức có thể lồng ghép nguyên tắc đạo đức vào mọi giai đoạn của vòng đời AI — từ chiến lược, phát triển đến triển khai và giám sát. Hướng dẫn này không chỉ nâng cao khả năng chống chịu rủi ro mà còn thúc đẩy đổi mới bền vững, đáng tin cậy và phù hợp với kỳ vọng xã hội.

Dù bạn là chuyên gia quản lý rủi ro, lãnh đạo cấp cao, nhà khoa học dữ liệu hay cố vấn pháp lý, hướng dẫn này cung cấp các công cụ và góc nhìn thiết yếu để bạn khai thác sức mạnh AI một cách có trách nhiệm.

Hướng Dẫn Quản Lý Rủi Ro và Kiểm Soát AI của KPMG là nguồn tài nguyên chuyên biệt giúp tổ chức quản lý các rủi ro liên quan trực tiếp đến trí tuệ nhân tạo (AI). Hướng dẫn thừa nhận rằng dù AI mang lại tiềm năng lớn, nhưng sự phức tạp và các vấn đề đạo đức đi kèm đòi hỏi một cách tiếp cận quản lý rủi ro riêng biệt. Hướng dẫn cung cấp một khung có cấu trúc để giải quyết những thách thức này một cách có trách nhiệm và hiệu quả.

Hướng dẫn không nhằm thay thế các hệ thống hiện tại mà được thiết kế để bổ sung cho quy trình quản lý rủi ro sẵn có. Mục tiêu chính là đưa các yếu tố đặc thù của AI vào cấu trúc quản trị của tổ chức, đảm bảo phù hợp nhịp nhàng với thực tiễn vận hành hiện tại. Cách tiếp cận này cho phép các tổ chức củng cố năng lực quản lý rủi ro mà không cần phải xây dựng lại toàn bộ khung quản trị.

Hướng dẫn được xây dựng dựa trên khung AI Đáng Tin Cậy của KPMG, nhấn mạnh phương pháp dựa trên giá trị và lấy con người làm trung tâm cho AI. Hướng dẫn tích hợp các nguyên tắc từ các tiêu chuẩn được công nhận rộng rãi như ISO 42001, Khung Quản Lý Rủi Ro AI của NIST và Đạo luật AI của EU. Nhờ đó, hướng dẫn vừa thiết thực vừa phù hợp với các thực hành tốt nhất và yêu cầu pháp lý toàn cầu về quản trị AI.

Hướng dẫn mang lại các góc nhìn thực tiễn và ví dụ cụ thể để giải quyết rủi ro liên quan đến AI. Hướng dẫn khuyến khích tổ chức điều chỉnh các ví dụ này cho phù hợp với bối cảnh của mình, xét đến các yếu tố như hệ thống AI phát triển nội bộ hay do đối tác cung cấp, cũng như loại dữ liệu và kỹ thuật sử dụng. Tính linh hoạt này đảm bảo hướng dẫn luôn phù hợp cho nhiều ngành nghề và ứng dụng AI khác nhau.

Hướng dẫn tập trung giúp tổ chức triển khai công nghệ AI một cách an toàn, đạo đức và minh bạch. Bằng cách giải quyết các khía cạnh kỹ thuật, vận hành và đạo đức của rủi ro AI, hướng dẫn giúp tổ chức xây dựng niềm tin với các bên liên quan đồng thời tận dụng khả năng chuyển đổi của AI.

Hướng dẫn đóng vai trò là nguồn lực đảm bảo hệ thống AI phù hợp với mục tiêu kinh doanh đồng thời giảm thiểu rủi ro tiềm năng. Hướng dẫn hỗ trợ đổi mới dựa trên nền tảng trách nhiệm và minh bạch.

Hướng Dẫn Quản Trị AI của KPMG được thiết kế cho các chuyên gia chịu trách nhiệm quản lý việc triển khai AI, đảm bảo AI được áp dụng an toàn, đạo đức và hiệu quả. Hướng dẫn áp dụng cho các nhóm khác nhau trong tổ chức, bao gồm:

Các lãnh đạo cấp cao như CEO, CIO, CTO sẽ thấy hướng dẫn này hữu ích cho việc quản trị AI như một ưu tiên chiến lược. Theo KPMG’s 2024 US CEO Outlook, 68% CEO xem AI là lĩnh vực đầu tư chủ chốt. Hướng dẫn này giúp lãnh đạo điều chỉnh chiến lược AI phù hợp với mục tiêu tổ chức đồng thời kiểm soát các rủi ro liên quan.

Kỹ sư phần mềm, nhà khoa học dữ liệu và những người chịu trách nhiệm phát triển, triển khai giải pháp AI có thể sử dụng hướng dẫn để tích hợp nguyên tắc đạo đức và kiểm soát vững chắc trực tiếp vào hệ thống. Hướng dẫn nhấn mạnh điều chỉnh quản lý rủi ro phù hợp với kiến trúc và dòng dữ liệu của mô hình AI.

Hướng dẫn có thể thích nghi cho doanh nghiệp tự phát triển hệ thống AI, mua từ bên thứ ba hoặc sử dụng bộ dữ liệu độc quyền. Đặc biệt phù hợp với ngành tài chính, y tế, công nghệ, nơi các ứng dụng AI tiên tiến và dữ liệu nhạy cảm đóng vai trò then chốt.

Triển khai AI mà thiếu khung quản trị rõ ràng có thể dẫn đến rủi ro tài chính, pháp lý và danh tiếng. Hướng dẫn của KPMG kết hợp với quy trình hiện có để cung cấp phương pháp có cấu trúc, đạo đức trong quản lý AI. Hướng dẫn thúc đẩy trách nhiệm, minh bạch và thực hành đạo đức, giúp tổ chức sử dụng AI một cách có trách nhiệm đồng thời khai phá tiềm năng của AI.

Các tổ chức nên bắt đầu bằng cách liên kết rủi ro đặc thù AI vào hệ thống phân loại rủi ro hiện tại. Phân loại rủi ro là một cấu trúc dùng để xác định, tổ chức và xử lý các lỗ hổng tiềm ẩn. Vì AI tạo ra những thách thức mới, nên phân loại truyền thống cần mở rộng để bao gồm các yếu tố riêng của AI. Những yếu tố này có thể gồm độ chính xác của luồng dữ liệu, logic thuật toán và mức độ tin cậy của nguồn dữ liệu. Nhờ đó, rủi ro AI trở thành một phần trong nỗ lực quản lý rủi ro tổng thể thay vì bị tách rời.

Hướng dẫn nhấn mạnh cần đánh giá toàn bộ vòng đời hệ thống AI. Những lĩnh vực cần xem xét gồm nguồn gốc dữ liệu, cách dữ liệu di chuyển qua các quy trình và logic nền tảng của mô hình AI. Cách tiếp cận toàn diện này giúp bạn xác định điểm dễ bị tổn thương trong quá trình phát triển và vận hành AI.

Hệ thống AI khác nhau tùy mục đích, phương pháp phát triển và loại dữ liệu sử dụng. Việc mô hình được xây dựng nội bộ hay mua ngoài ảnh hưởng đáng kể đến rủi ro. Tương tự, loại dữ liệu—dữ liệu độc quyền, công khai hoặc nhạy cảm—cùng kỹ thuật xây dựng AI đòi hỏi chiến lược quản lý rủi ro riêng.

Hướng dẫn đề xuất điều chỉnh các biện pháp kiểm soát để phù hợp với nhu cầu cụ thể của hệ thống AI. Ví dụ, nếu bạn sử dụng dữ liệu độc quyền, cần kiểm soát truy cập nghiêm ngặt hơn. Ngược lại, dùng hệ thống AI từ đối tác có thể yêu cầu đánh giá rủi ro bên thứ ba sâu hơn. Việc điều chỉnh kiểm soát giúp xử lý hiệu quả các thách thức đặc thù của từng hệ thống AI.

Hướng dẫn khuyến nghị tích hợp thực hành quản lý rủi ro vào mọi giai đoạn vòng đời AI. Bao gồm lên kế hoạch cho rủi ro ngay từ thiết kế, thiết lập hệ thống giám sát mạnh khi triển khai và thường xuyên cập nhật đánh giá rủi ro khi hệ thống AI phát triển. Xử lý rủi ro ở từng bước giúp giảm điểm yếu và đảm bảo AI vừa đạo đức, vừa tin cậy.

Bước khởi đầu bằng việc điều chỉnh rủi ro AI với hệ thống phân loại hiện có và tùy biến kiểm soát phù hợp sẽ tạo nền tảng vững chắc cho AI đáng tin cậy. Những nỗ lực này giúp tổ chức nhận diện, đánh giá và quản lý rủi ro một cách hệ thống, xây dựng khung quản trị AI mạnh mẽ.

Khung AI Đáng Tin Cậy của KPMG được xây dựng dựa trên mười trụ cột then chốt, giải quyết các thách thức đạo đức, kỹ thuật và vận hành của trí tuệ nhân tạo. Các trụ cột này định hướng tổ chức trong thiết kế, phát triển và triển khai AI một cách có trách nhiệm, đảm bảo niềm tin và trách nhiệm giải trình xuyên suốt vòng đời AI.

Giám sát con người và phân công trách nhiệm phải có ở mọi giai đoạn vòng đời AI. Điều này đồng nghĩa xác định rõ ai chịu trách nhiệm quản lý rủi ro AI, đảm bảo tuân thủ pháp luật, và duy trì khả năng can thiệp, điều chỉnh hoặc đảo ngược quyết định AI khi cần thiết.

Hệ thống AI nên hướng tới giảm hoặc loại bỏ thiên vị có thể gây tác động tiêu cực đến cá nhân, cộng đồng hoặc nhóm. Điều này bao gồm kiểm tra dữ liệu kỹ lưỡng để đảm bảo đại diện cho nhiều nhóm, áp dụng biện pháp công bằng trong phát triển và liên tục giám sát kết quả để thúc đẩy sự đối xử công bằng.

Minh bạch yêu cầu chia sẻ công khai cách hệ thống AI hoạt động và lý do đưa ra quyết định cụ thể. Bao gồm việc ghi lại giới hạn hệ thống, kết quả hiệu suất, phương pháp kiểm thử. Người dùng nên được thông báo khi dữ liệu của họ bị thu thập, nội dung do AI tạo ra phải được gắn nhãn rõ ràng và các ứng dụng nhạy cảm như phân loại sinh trắc học cần có thông báo minh bạch cho người dùng.

Hệ thống AI phải cung cấp lý do dễ hiểu cho các quyết định của mình. Để đạt được điều đó, tổ chức cần ghi chép chi tiết bộ dữ liệu, thuật toán và chỉ số hiệu suất, giúp các bên liên quan phân tích và tái tạo kết quả một cách hiệu quả.

Chất lượng và độ tin cậy của dữ liệu trong toàn bộ vòng đời—từ thu thập, gán nhãn, lưu trữ đến phân tích—là điều thiết yếu. Cần có kiểm soát để xử lý các rủi ro như dữ liệu bị hỏng hoặc thiên vị. Thường xuyên kiểm tra chất lượng dữ liệu và kiểm thử hồi quy khi cập nhật hệ thống giúp duy trì độ chính xác và đáng tin cậy cho AI.

Giải pháp AI phải tuân thủ luật bảo vệ quyền riêng tư và dữ liệu. Tổ chức cần xử lý yêu cầu của chủ thể dữ liệu đúng cách, tiến hành đánh giá tác động quyền riêng tư, áp dụng các phương pháp tiên tiến như bảo mật vi sai để cân bằng giữa sử dụng dữ liệu và bảo vệ quyền riêng tư cá nhân.

Hệ thống AI phải vận hành nhất quán theo đúng mục đích và độ chính xác yêu cầu. Điều này đòi hỏi kiểm thử toàn diện, cơ chế phát hiện bất thường và vòng phản hồi liên tục để xác thực đầu ra của hệ thống.

Các biện pháp an toàn bảo vệ hệ thống AI khỏi gây tổn hại cho cá nhân, doanh nghiệp hoặc tài sản. Bao gồm thiết kế cơ chế dự phòng, giám sát các nguy cơ như nhiễm độc dữ liệu hoặc tấn công prompt injection, đảm bảo hệ thống phù hợp với tiêu chuẩn đạo đức và vận hành.

Thực hành an ninh mạnh mẽ cần thiết để bảo vệ AI khỏi các mối đe dọa và hành vi độc hại. Tổ chức nên kiểm toán định kỳ, đánh giá lỗ hổng bảo mật và sử dụng mã hóa bảo vệ dữ liệu nhạy cảm.

Hệ thống AI nên được thiết kế để giảm thiểu tiêu thụ năng lượng và hỗ trợ mục tiêu môi trường. Yếu tố phát triển bền vững cần được lồng ghép ngay từ thiết kế, liên tục giám sát năng lượng, hiệu suất và phát thải trong suốt vòng đời AI.

Thực hiện 10 trụ cột này, tổ chức có thể tạo ra hệ thống AI đạo đức, đáng tin cậy và phù hợp với kỳ vọng xã hội. Khung này cung cấp cấu trúc rõ ràng để quản lý thách thức AI đồng thời thúc đẩy đổi mới có trách nhiệm.

Toàn vẹn dữ liệu rất quan trọng để đảm bảo hệ thống AI luôn chính xác, công bằng và đáng tin cậy. Quản lý dữ liệu kém có thể gây ra rủi ro như thiên vị, sai sót và kết quả không đáng tin cậy. Những vấn đề này làm suy yếu niềm tin vào đầu ra của AI và có thể dẫn đến sự cố vận hành hoặc tổn hại uy tín nghiêm trọng. Khung AI Đáng Tin Cậy của KPMG nhấn mạnh duy trì dữ liệu chất lượng cao trong toàn bộ vòng đời để hệ thống AI hoạt động hiệu quả và đáp ứng tiêu chuẩn đạo đức.

Nếu không có quản trị dữ liệu chặt chẽ, hệ thống AI có thể tạo ra kết quả sai lệch. Các vấn đề như dữ liệu không đầy đủ, sai sót hoặc không liên quan sẽ dẫn đến kết quả thiên vị hoặc không đáng tin cậy, làm tăng rủi ro cho nhiều ứng dụng AI khác nhau.

Dữ liệu thường được truyền giữa các hệ thống để đào tạo, kiểm thử hoặc vận hành. Nếu quá trình này không được kiểm soát tốt, dữ liệu có thể bị hỏng, mất hoặc suy giảm chất lượng, ảnh hưởng đến hiệu suất AI.

Để tăng cường quản trị dữ liệu, tổ chức có thể:

Để giảm thiểu rủi ro khi truyền dữ liệu, tổ chức nên:

Triển khai hệ thống giám sát liên tục giúp duy trì toàn vẹn dữ liệu trong toàn bộ vòng đời AI. Hệ thống này phát hiện các vấn đề như thay đổi bất ngờ về chất lượng dữ liệu hoặc sự không nhất quán trong xử lý. Nhờ đó, tổ chức có thể nhanh chóng khắc phục khi có sự cố.

Duy trì toàn vẹn dữ liệu là yếu tố then chốt để triển khai hệ thống AI đáng tin cậy. Tổ chức có thể giảm thiểu rủi ro bằng cách xây dựng khung quản trị mạnh mẽ, bảo vệ quá trình xử lý dữ liệu và duy trì quy trình xác thực liên tục. Những hành động này nâng cao độ tin cậy đầu ra của AI và đảm bảo tiêu chuẩn đạo đức và vận hành, góp phần xây dựng niềm tin vào công nghệ AI.

Quản lý yêu cầu liên quan đến quyền truy cập dữ liệu cá nhân là một thách thức lớn về quyền riêng tư trong AI. Các tổ chức phải đảm bảo cá nhân có quyền truy cập, chỉnh sửa hoặc xóa thông tin cá nhân theo luật như GDPR và CCPA. Nếu xử lý không đúng, có thể dẫn đến vi phạm quy định, mất niềm tin khách hàng và tổn hại danh tiếng tổ chức.

Để giảm rủi ro này, doanh nghiệp nên xây dựng chương trình nâng cao nhận thức về quyền dữ liệu cho cá nhân khi tương tác với AI. Hệ thống phải được thiết lập để xử lý yêu cầu nhanh chóng, minh bạch. Tổ chức cũng cần lưu trữ hồ sơ chi tiết về cách xử lý yêu cầu để chứng minh tuân thủ khi kiểm toán.

Hệ thống AI thường xử lý thông tin cá nhân nhạy cảm, khiến chúng trở thành mục tiêu hấp dẫn cho tấn công mạng. Nếu xảy ra rò rỉ, tổ chức có thể bị phạt nặng, tổn hại uy tín và mất lòng tin khách hàng.

Để phòng ngừa, Khung AI Đáng Tin Cậy của KPMG khuyến nghị tiến hành đánh giá đạo đức với hệ thống AI sử dụng dữ liệu cá nhân để đảm bảo tuân thủ quy định. Cần kiểm toán bảo vệ dữ liệu và đánh giá tác động quyền riêng tư (PIA) thường xuyên, nhất là khi dùng dữ liệu nhạy cảm để huấn luyện AI. Ngoài ra, các phương pháp như bảo mật vi sai (thêm nhiễu thống kê vào dữ liệu) giúp ẩn danh thông tin cá nhân nhưng vẫn cho phép phân tích.

Hệ thống AI không tích hợp biện pháp bảo vệ quyền riêng tư ngay từ đầu dễ gây ra vấn đề nghiêm trọng. Nếu không áp dụng nguyên tắc quyền riêng tư từ thiết kế, tổ chức có thể làm lộ dữ liệu nhạy cảm hoặc vi phạm pháp luật.

Doanh nghiệp nên tích hợp biện pháp bảo vệ quyền riêng tư vào giai đoạn phát triển hệ thống AI. Điều này bao gồm tuân thủ quy định về quyền riêng tư và bảo vệ dữ liệu thông qua thực hành quản lý dữ liệu vững chắc. Cần ghi chép rõ cách dữ liệu được thu thập, sử dụng, lưu trữ. Tổ chức cũng phải xin sự đồng ý rõ ràng từ người dùng khi thu thập và xử lý dữ liệu, đặc biệt với dữ liệu nhạy cảm như sinh trắc học.

Khi hệ thống AI không giải thích rõ cách dữ liệu người dùng được xử lý, có thể dẫn đến mất niềm tin và bị xem xét pháp lý. Người dùng cần biết khi nào dữ liệu của họ bị thu thập và mục đích sử dụng ra sao

Hướng Dẫn Quản Lý Rủi Ro và Kiểm Soát AI của KPMG là một khung thực tiễn được thiết kế để giúp các tổ chức quản lý những rủi ro đặc thù của AI, đảm bảo triển khai AI một cách có trách nhiệm, đạo đức và tuân thủ trên nhiều lĩnh vực.

Hướng dẫn này được xây dựng dựa trên mười trụ cột chính: Trách nhiệm giải trình, Công bằng, Minh bạch, Giải thích được, Toàn vẹn dữ liệu, Độ tin cậy, An ninh, An toàn, Quyền riêng tư và Phát triển bền vững—mỗi trụ cột giải quyết các khía cạnh trọng yếu trong quản lý rủi ro AI.

Hướng dẫn này dành cho các chuyên gia quản lý rủi ro, nhóm tuân thủ, chuyên gia an ninh mạng, cố vấn pháp lý, lãnh đạo cấp cao, nhà phát triển AI, kỹ sư và các tổ chức thuộc mọi quy mô muốn quản lý AI một cách có trách nhiệm.

Hướng dẫn này phù hợp với các tiêu chuẩn toàn cầu như ISO 42001, Khung Quản Lý Rủi Ro AI của NIST và Đạo luật AI của EU, giúp các tổ chức tích hợp các kiểm soát dành riêng cho AI vào quy trình quản trị hiện có và đáp ứng yêu cầu pháp lý.

Hướng dẫn đề xuất các biện pháp như quản trị dữ liệu chặt chẽ, bảo vệ quyền riêng tư ngay từ thiết kế, giám sát liên tục, minh bạch trong quyết định AI, phát hiện bất thường, vòng phản hồi và mục tiêu phát triển bền vững để giảm thiểu rủi ro liên quan đến AI.

Khám phá cách Hướng Dẫn Quản Lý Rủi Ro và Kiểm Soát AI của KPMG có thể giúp tổ chức của bạn đón nhận đổi mới AI đồng thời đảm bảo triển khai một cách đạo đức, an toàn và tuân thủ.

Khám phá 18 nền tảng AI hàng đầu năm 2025, các tính năng, ứng dụng thực tiễn và bí quyết chọn nền tảng phù hợp cho doanh nghiệp của bạn. Luôn dẫn đầu trong thế ...

Khám phá các xu hướng gọi vốn AI mới nhất năm 2024, bao gồm đầu tư tăng mạnh, sự thống trị của các ông lớn công nghệ, sự phát triển của AI tạo sinh và tác động ...

Lạm dụng AI tại nơi làm việc không phải là vấn đề của nhân viên—mà là cuộc khủng hoảng lãnh đạo. Khám phá lý do nhân viên sử dụng AI trong bí mật, các rủi ro li...

Đồng Ý Cookie

Chúng tôi sử dụng cookie để cải thiện trải nghiệm duyệt web của bạn và phân tích lưu lượng truy cập của mình. See our privacy policy.