LLM Gemini

FlowHunt hỗ trợ hàng chục mô hình AI, bao gồm Google Gemini. Tìm hiểu cách sử dụng Gemini trong công cụ AI và chatbot của bạn, chuyển đổi giữa các mô hình, và k...

LLM DeepSeek bởi FlowHunt giúp bạn truy cập và tùy chỉnh các mô hình AI hàng đầu như DeepSeek R1 để tạo văn bản và hình ảnh trong chatbot và công cụ AI của mình, tất cả từ một bảng điều khiển duy nhất.

Mô tả thành phần

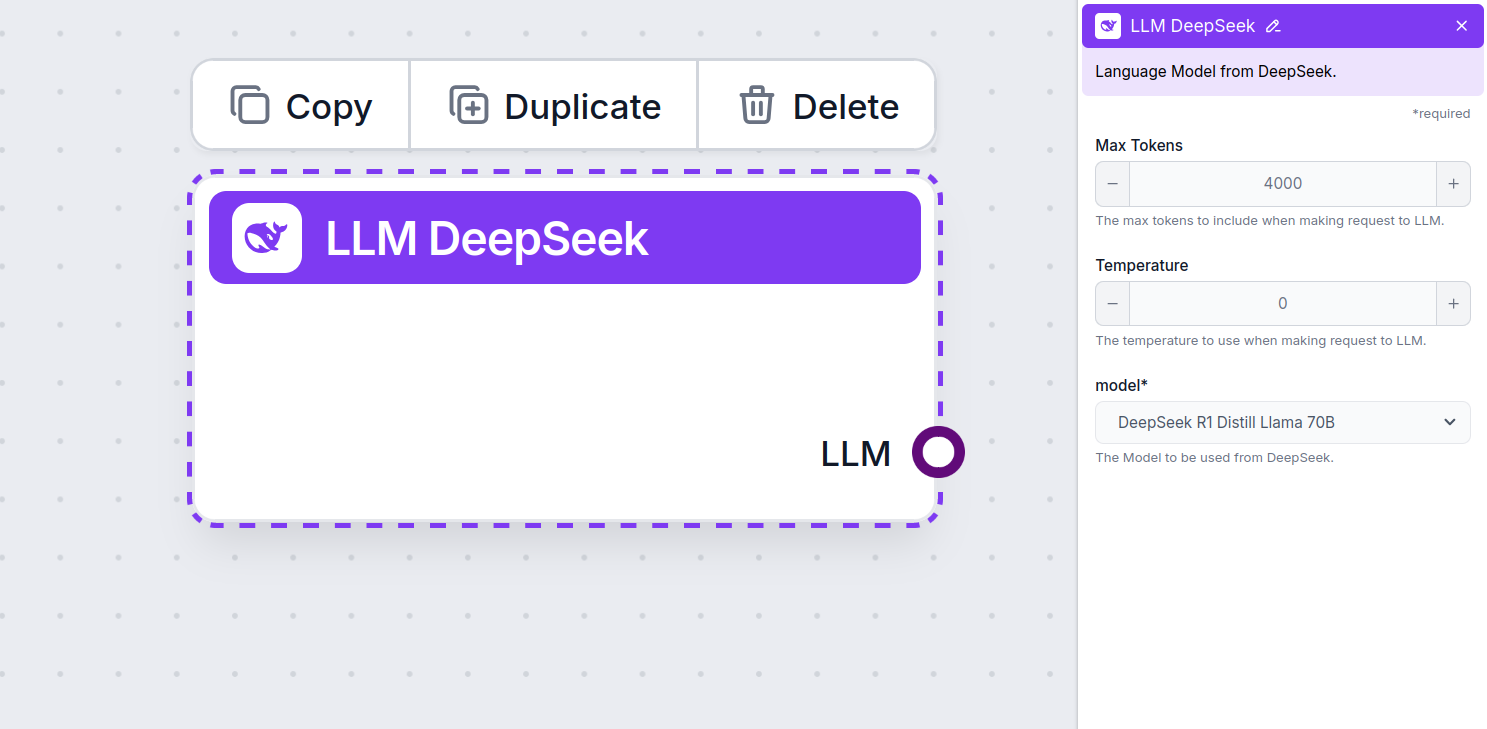

Thành phần LLM DeepSeek kết nối các mô hình DeepSeek vào Flow của bạn. Trong khi Generator và Agent là nơi các tác vụ thực sự diễn ra, các thành phần LLM giúp bạn chuyển đổi và kiểm soát mô hình được sử dụng.

Lưu ý rằng việc kết nối một thành phần LLM là không bắt buộc. Tất cả các thành phần sử dụng LLM đều mặc định là ChatGPT-4o. Các thành phần LLM giúp bạn thay đổi mô hình và kiểm soát các cài đặt của mô hình.

Token đại diện cho các đơn vị văn bản riêng lẻ mà mô hình xử lý và tạo ra. Việc sử dụng token thay đổi tùy theo mô hình, và một token có thể là từ, phân đoạn từ, hoặc một ký tự. Các mô hình thường được định giá theo hàng triệu token.

Cài đặt số lượng token tối đa giới hạn tổng số token có thể được xử lý trong một lần tương tác hoặc yêu cầu, đảm bảo phản hồi được tạo ra trong phạm vi hợp lý. Giới hạn mặc định là 4.000 token, kích thước tối ưu để tóm tắt tài liệu và nhiều nguồn nhằm tạo ra câu trả lời.

Nhiệt độ kiểm soát mức độ biến đổi của câu trả lời, trong khoảng từ 0 đến 1.

Nhiệt độ 0.1 sẽ khiến phản hồi rất sát vấn đề nhưng có thể lặp lại và thiếu sáng tạo.

Nhiệt độ cao 1 cho phép mức độ sáng tạo tối đa trong câu trả lời nhưng cũng có nguy cơ tạo ra câu trả lời không liên quan hoặc thậm chí “ảo giác”.

Ví dụ, nhiệt độ khuyến nghị cho chatbot chăm sóc khách hàng là từ 0.2 đến 0.5. Mức này sẽ giữ câu trả lời phù hợp và bám sát kịch bản, đồng thời vẫn cho phép sự đa dạng tự nhiên.

Đây là bộ chọn mô hình. Tại đây, bạn sẽ thấy tất cả các mô hình DeepSeek được hỗ trợ. Chúng tôi hỗ trợ mọi mô hình Gemini mới nhất:

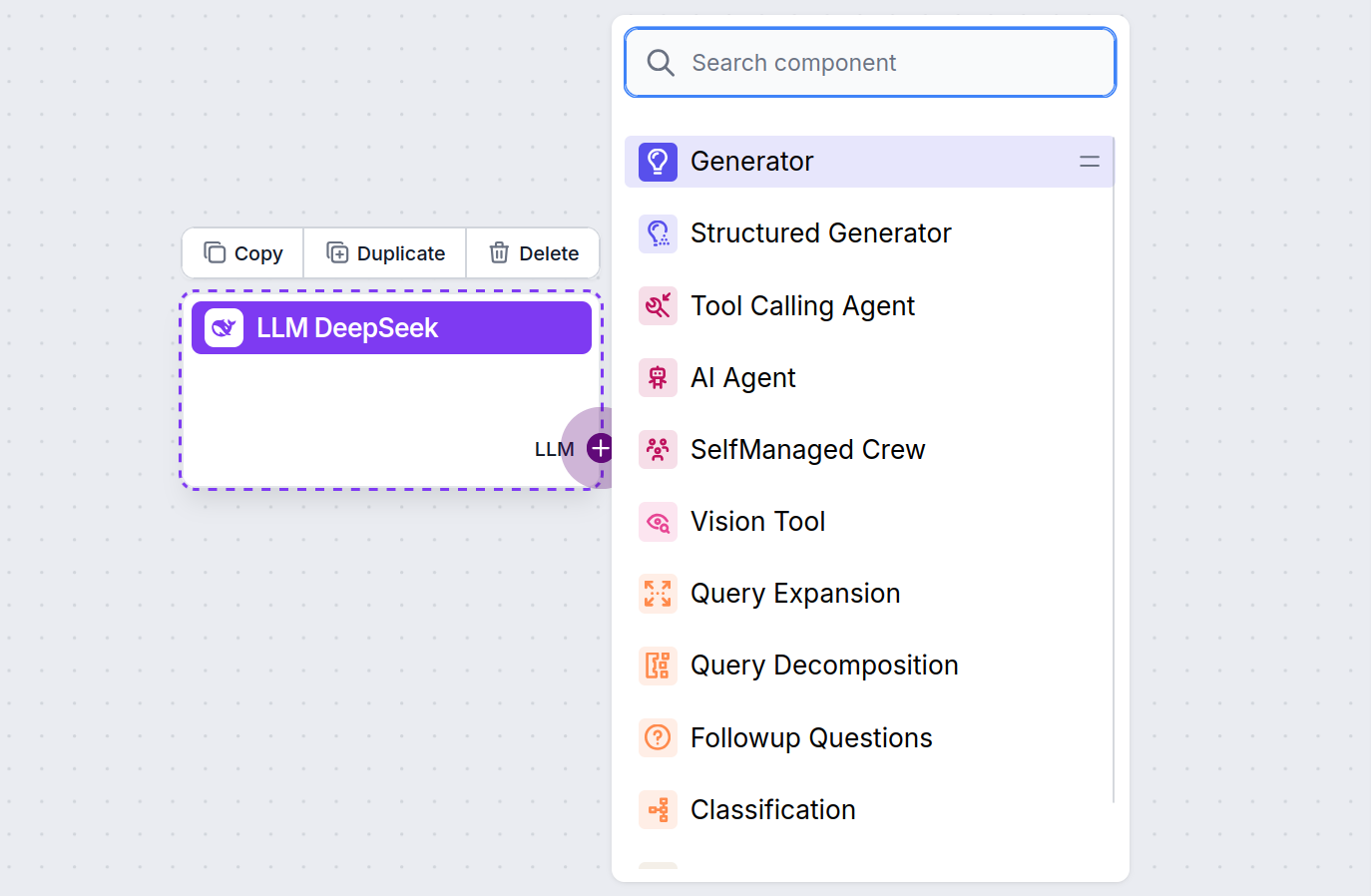

Bạn sẽ thấy tất cả các thành phần LLM chỉ có một đầu ra. Dữ liệu đầu vào không đi qua thành phần này, vì nó chỉ đại diện cho mô hình, trong khi việc tạo nội dung thực tế diễn ra ở AI Agent và Generator.

Đầu nối LLM luôn có màu tím. Đầu vào LLM có mặt trên mọi thành phần sử dụng AI để tạo văn bản hoặc xử lý dữ liệu. Bạn có thể xem các tùy chọn bằng cách nhấn vào đầu nối:

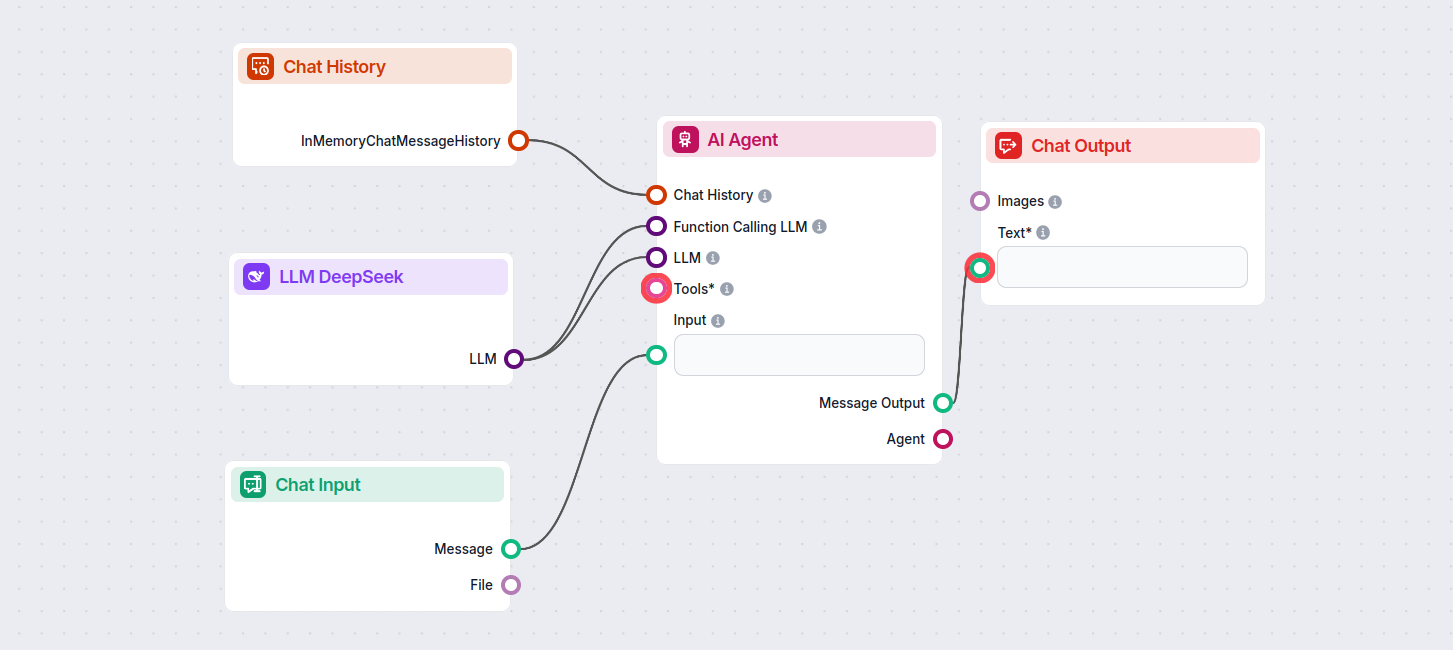

Điều này cho phép bạn tạo ra mọi loại công cụ. Hãy cùng xem thành phần này hoạt động như thế nào. Đây là một Flow chatbot AI Agent đơn giản sử dụng DeepSeek R1 để tạo phản hồi. Bạn có thể xem nó như một chatbot DeepSeek cơ bản.

Flow Chatbot đơn giản này bao gồm:

LLM DeepSeek là một thành phần trong FlowHunt cho phép bạn kết nối và kiểm soát các mô hình AI DeepSeek để tạo văn bản và hình ảnh, giúp xây dựng chatbot mạnh mẽ và các quy trình tự động.

FlowHunt hỗ trợ tất cả các mô hình DeepSeek mới nhất, bao gồm DeepSeek R1, nổi bật với tốc độ và hiệu năng, đặc biệt khi so với các mô hình AI hàng đầu khác.

Bạn có thể điều chỉnh số lượng token tối đa cho độ dài phản hồi và nhiệt độ cho mức sáng tạo, cũng như chuyển đổi giữa các mô hình DeepSeek có sẵn ngay trên bảng điều khiển FlowHunt.

Không, việc kết nối thành phần LLM là tùy chọn. Mặc định, FlowHunt sử dụng ChatGPT-4o, nhưng thêm LLM DeepSeek giúp bạn thay đổi và kiểm soát mô hình AI nào sẽ vận hành quy trình của mình.

Bắt đầu xây dựng chatbot AI thông minh hơn và các công cụ tự động hóa bằng những mô hình DeepSeek tiên tiến—tất cả mà không cần thiết lập phức tạp hay nhiều gói đăng ký.

FlowHunt hỗ trợ hàng chục mô hình AI, bao gồm Google Gemini. Tìm hiểu cách sử dụng Gemini trong công cụ AI và chatbot của bạn, chuyển đổi giữa các mô hình, và k...

FlowHunt hỗ trợ hàng chục mô hình sinh văn bản, bao gồm các mô hình của xAI. Dưới đây là cách sử dụng các mô hình xAI trong công cụ AI và chatbot của bạn....

FlowHunt hỗ trợ hàng chục mô hình sinh văn bản, bao gồm cả các mô hình Llama của Meta. Tìm hiểu cách tích hợp Llama vào công cụ AI và chatbot của bạn, tùy chỉnh...