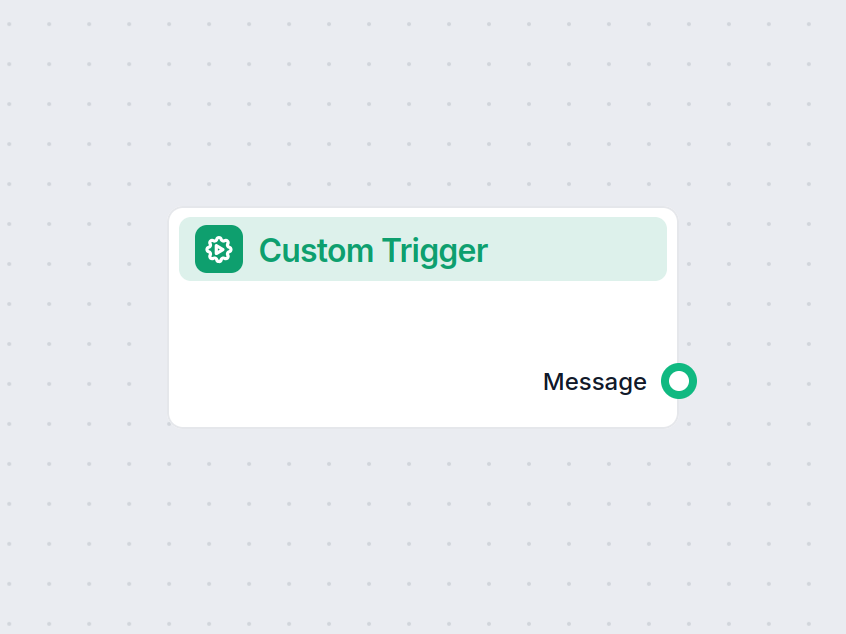

Kích Hoạt Tùy Chỉnh

Mở khóa các quy trình tự động hóa tùy chỉnh với thành phần Kích Hoạt Tùy Chỉnh trong FlowHunt. Thành phần này cho phép người dùng xác định các điểm kích hoạt cụ...

Hàm kích hoạt đưa vào tính phi tuyến trong mạng nơ-ron, giúp chúng học các mẫu phức tạp cần thiết cho các ứng dụng AI và học sâu.

Hàm kích hoạt là thành phần cơ bản trong kiến trúc của mạng nơ-ron nhân tạo (ANNs), ảnh hưởng lớn đến khả năng học và thực hiện các nhiệm vụ phức tạp của mạng. Bài viết thuật ngữ này đi sâu vào sự phức tạp của các hàm kích hoạt, phân tích mục đích, các loại và ứng dụng của chúng, đặc biệt trong lĩnh vực AI, học sâu và mạng nơ-ron.

Hàm kích hoạt trong mạng nơ-ron là một phép toán toán học được áp dụng lên đầu ra của một nơ-ron. Nó quyết định liệu một nơ-ron có được kích hoạt hay không, đưa vào mô hình tính phi tuyến, nhờ đó mạng có thể học các mẫu phức tạp. Nếu không có các hàm này, mạng nơ-ron về cơ bản sẽ chỉ hoạt động như một mô hình hồi quy tuyến tính, bất kể chiều sâu hay số tầng.

Hàm Sigmoid

Hàm Tanh

ReLU (Rectified Linear Unit)

Leaky ReLU

Hàm Softmax

Hàm Swish

Hàm kích hoạt đóng vai trò quan trọng trong nhiều ứng dụng AI, bao gồm:

Hàm kích hoạt là một phép toán toán học được áp dụng lên đầu ra của một nơ-ron, đưa vào tính phi tuyến và cho phép mạng nơ-ron học các mẫu phức tạp vượt ra ngoài quan hệ tuyến tính đơn giản.

Hàm kích hoạt cho phép mạng nơ-ron giải quyết các vấn đề phức tạp, phi tuyến bằng cách học các mẫu tinh vi, giúp chúng trở nên quan trọng trong các tác vụ như phân loại hình ảnh, xử lý ngôn ngữ và tự động hóa.

Các loại phổ biến bao gồm Sigmoid, Tanh, ReLU, Leaky ReLU, Softmax và Swish, mỗi loại có đặc tính và trường hợp sử dụng riêng ở các tầng khác nhau của mạng nơ-ron.

Các thách thức phổ biến bao gồm vấn đề mất dần gradient (đặc biệt với Sigmoid và Tanh), ReLU chết và chi phí tính toán cao với các hàm như Softmax trong các ứng dụng thời gian thực.

Chatbot thông minh và công cụ AI chỉ trong một nền tảng. Kết nối các khối trực quan để biến ý tưởng của bạn thành quy trình tự động hóa.

Mở khóa các quy trình tự động hóa tùy chỉnh với thành phần Kích Hoạt Tùy Chỉnh trong FlowHunt. Thành phần này cho phép người dùng xác định các điểm kích hoạt cụ...

Mạng nơ-ron nhân tạo (ANNs) là một nhánh của các thuật toán học máy được mô phỏng theo bộ não con người. Các mô hình tính toán này gồm các nút hoặc 'nơ-ron' liê...

Mạng nơ-ron, hay mạng nơ-ron nhân tạo (ANN), là một mô hình tính toán lấy cảm hứng từ não người, đóng vai trò thiết yếu trong AI và học máy cho các nhiệm vụ như...