Thư viện Python cho Phát triển Máy chủ Model Context Protocol (MCP)

Ví dụ nhanh về cách phát triển máy chủ MCP của riêng bạn với Python.

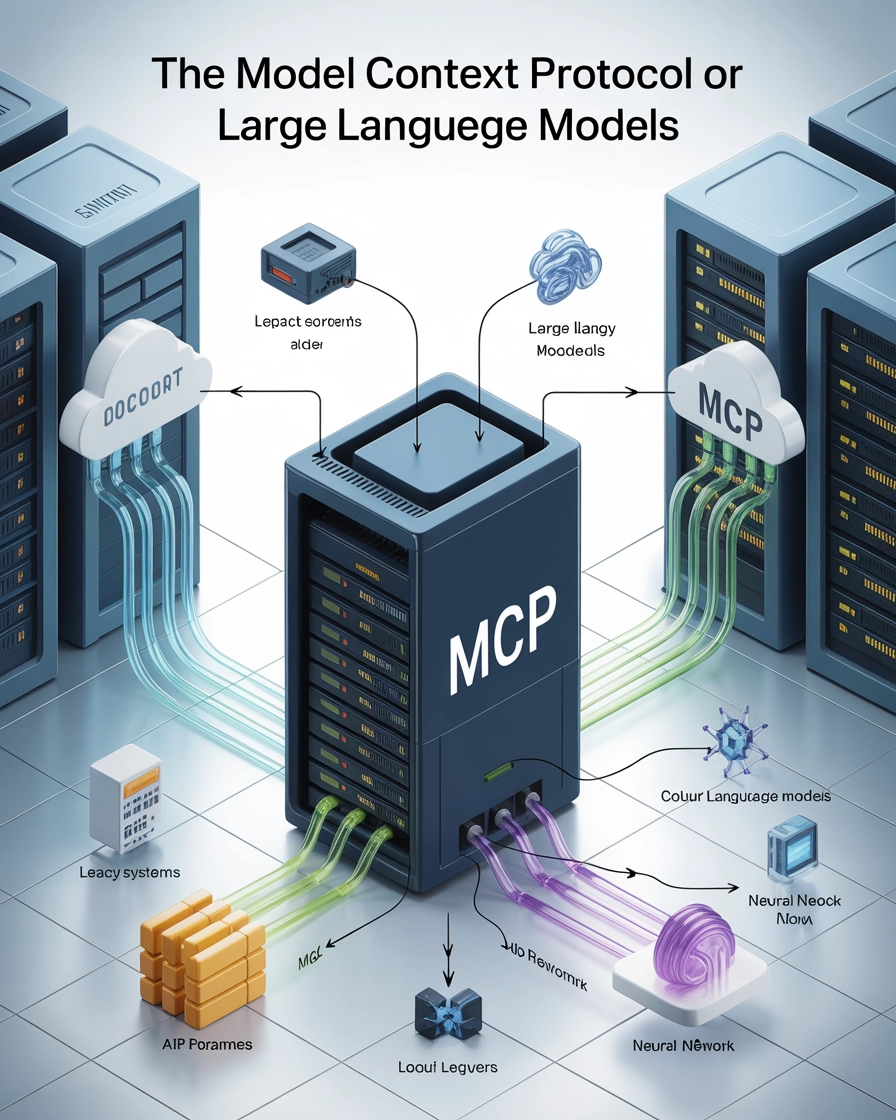

MCP chuẩn hóa việc LLM truy cập an toàn vào dữ liệu, công cụ và plugin bên ngoài, giúp tích hợp và liên kết AI linh hoạt, mạnh mẽ.

Model Context Protocol (MCP) là một giao diện tiêu chuẩn mở cho phép các Mô hình Ngôn ngữ Lớn (LLM) truy cập an toàn và nhất quán vào các nguồn dữ liệu, công cụ và khả năng bên ngoài. MCP thiết lập một lớp giao tiếp tiêu chuẩn hóa giữa ứng dụng AI và các nhà cung cấp ngữ cảnh khác nhau, đóng vai trò như “USB-C” cho các hệ thống AI.

MCP tuân theo kiến trúc client-server:

MCP định nghĩa ba nguyên thủy cơ bản là nền tảng của giao thức:

Tài nguyên đại diện cho dữ liệu và nội dung mà máy chủ MCP cung cấp cho LLM.

Ví dụ ứng dụng: Một máy chủ MCP cung cấp tệp nhật ký dưới dạng tài nguyên với URI file:///logs/app.log

Prompt là các mẫu hoặc quy trình làm việc được định nghĩa trước mà máy chủ cung cấp để hướng dẫn tương tác với LLM.

Ví dụ ứng dụng: Prompt tạo thông điệp commit git, nhận thay đổi mã nguồn làm đầu vào

Công cụ cung cấp các hàm thực thi mà LLM có thể gọi (thường cần người dùng phê duyệt) để thực hiện hành động.

Ví dụ ứng dụng: Công cụ máy tính thực hiện phép toán trên dữ liệu đầu vào do mô hình cung cấp

// Server exposing a single log file as a resource

const server = new Server({ /* config */ }, { capabilities: { resources: {} } });

// List available resources

server.setRequestHandler(ListResourcesRequestSchema, async () => {

return {

resources: [

{

uri: "file:///logs/app.log",

name: "Application Logs",

mimeType: "text/plain"

}

]

};

});

// Provide resource content

server.setRequestHandler(ReadResourceRequestSchema, async (request) => {

if (request.params.uri === "file:///logs/app.log") {

const logContents = await readLogFile();

return {

contents: [{

uri: request.params.uri,

mimeType: "text/plain",

text: logContents

}]

};

}

throw new Error("Resource not found");

});

const server = new Server({ /* config */ }, { capabilities: { tools: {} } });

// List available tools

server.setRequestHandler(ListToolsRequestSchema, async () => {

return {

tools: [{

name: "calculate_sum",

description: "Add two numbers together",

inputSchema: {

type: "object",

properties: {

a: { type: "number", description: "First number" },

b: { type: "number", description: "Second number" }

},

required: ["a", "b"]

},

annotations: {

title: "Calculate Sum",

readOnlyHint: true,

openWorldHint: false

}

}]

};

});

// Handle tool execution

server.setRequestHandler(CallToolRequestSchema, async (request) => {

if (request.params.name === "calculate_sum") {

try {

const { a, b } = request.params.arguments;

if (typeof a !== 'number' || typeof b !== 'number') {

throw new Error("Invalid input: 'a' and 'b' must be numbers.");

}

const sum = a + b;

return {

content: [{ type: "text", text: String(sum) }]

};

} catch (error: any) {

return {

isError: true,

content: [{ type: "text", text: `Error calculating sum: ${error.message}` }]

};

}

}

throw new Error("Tool not found");

});

MCP là một giao diện tiêu chuẩn mở cho phép LLM truy cập an toàn và nhất quán vào các nguồn dữ liệu, công cụ và khả năng bên ngoài, tạo ra một lớp giao tiếp tiêu chuẩn hóa giữa ứng dụng AI và nhà cung cấp ngữ cảnh.

MCP gồm có máy chủ, máy khách, máy chủ dịch vụ và nguồn dữ liệu. Nó sử dụng các nguyên thủy cốt lõi—tài nguyên, prompt và công cụ—để cho phép tương tác linh hoạt, an toàn giữa LLM và hệ thống bên ngoài.

MCP đơn giản hóa việc tích hợp AI, nâng cao bảo mật, giảm ràng buộc nhà cung cấp và cho phép truy cập liền mạch vào nhiều thông tin, công cụ cho cả lập trình viên và tổ chức.

MCP có thể được triển khai thông qua các máy chủ cung cấp tài nguyên hoặc công cụ (ví dụ: truy cập tệp nhật ký, công cụ tính toán) bằng giao diện tiêu chuẩn hóa, giúp kết nối với mô hình AI trở nên đơn giản hơn.

MCP chuẩn hóa quy trình LLM gọi hàm hoặc công cụ bên ngoài, tương tự như cách plugin mở rộng khả năng trình duyệt hoặc phần mềm.

Bắt đầu xây dựng hệ thống AI mạnh mẽ với tích hợp tiêu chuẩn hóa, truy cập dữ liệu an toàn và kết nối công cụ linh hoạt cùng FlowHunt.

Ví dụ nhanh về cách phát triển máy chủ MCP của riêng bạn với Python.

AI tác nhân đang tái định nghĩa tự động hóa quy trình làm việc với Model Context Protocol (MCP), cho phép tích hợp linh hoạt, mở rộng các tác nhân AI với nhiều ...

Máy chủ ModelContextProtocol (MCP) hoạt động như một cầu nối giữa các tác nhân AI và các nguồn dữ liệu, API, dịch vụ bên ngoài, cho phép người dùng FlowHunt xây...