推理

推理是指基于信息、事实和逻辑进行推断、作出结论或解决问题的认知过程。探索其在人工智能领域的重要性,包括 OpenAI 的 o1 模型及其先进的推理能力。...

发现AI推理如何模仿人类思维进行问题解决与决策,其发展历程、医疗领域应用,以及最新模型如OpenAI o1。

人工智能推理是一种逻辑方法,帮助机器像人类一样得出结论、做出预测、解决问题。AI系统通过一系列步骤,利用可用信息发现新见解或做出决策。本质上,AI推理旨在模仿人脑处理信息和推导结论的能力。这对于开发能够自主做出明智决策的智能系统至关重要。

AI推理主要分为两种类型:

AI推理极大提升了各领域的决策过程。通过赋予AI推理能力,系统能够更好地理解和高效工作,推动了更高级的应用落地。

AI推理的发展历程由多个关键里程碑塑造:

AI推理持续发展,相关研究与开发不断推进模型优化和应用扩展。随着AI系统日益具备复杂推理能力,其对社会和产业的潜在影响也将增长,带来新机遇与挑战。

神经符号AI标志着人工智能领域的一次变革,将神经网络与符号AI两种截然不同的方法结合。这一模型兼具神经网络的模式识别能力和符号系统的逻辑推理能力。通过融合两者,神经符号AI旨在解决各自单独使用时的不足。

神经网络受人脑结构启发,由互联的“神经元”节点组成,能够通过数据学习来处理信息。其擅长处理如图像、音频、文本等非结构化数据,是深度学习技术的基础。神经网络特别善于模式识别、数据分类和基于历史数据的预测。例如,Facebook的自动人脸标记功能就应用了神经网络,通过庞大数据集学习识别人脸。

符号AI利用符号表示概念,并通过基于逻辑的推理操作这些符号。这种方法模拟人类思维,使AI能应对需要结构化知识与基于规则决策的任务。符号AI适用于需要预设规则和逻辑推导的场景,如解数学谜题或在国际象棋等游戏中进行战略决策。

推理AI模型通过模仿人类推理,极大提升了疾病诊断的准确性。这些模型能处理大量数据,识别出人类可能忽略的模式与异常。例如,机器学习算法结合临床数据,能更精准地帮助诊断复杂疾病。尤其在影像诊断中,AI对X光片和MRI的分析有助于早期发现癌症等疾病。

AI推理模型通过提供基于证据的建议辅助临床决策。它们分析患者病史、症状等数据,提出可能的诊断和治疗方案。借助大数据分析,医疗人员能做出更明智的决策,改善患者预后。例如,在急诊护理中,AI可快速评估患者信息,确定干预优先级。

AI模型自动化完成诸如排班、账单处理和病历管理等例行事务,减轻医护人员负担。这样,医护人员能将更多精力投入患者护理。此外,AI系统保证患者数据的准确性和易于获取,提升整体医疗服务效率。

推理AI模型推动个性化医疗进步,为每位患者量身定制治疗方案。AI分析基因信息、生活方式和其他健康指标,制定个体化策略。这一方法提升疗效并减少副作用,使医疗更加以患者为中心、更加精准。

尽管推理AI模型带来诸多益处,也伴随伦理和隐私的挑战。在处理敏感健康信息时必须采取严格的数据保护措施。同时,AI算法中存在偏见风险,可能导致结果不公。持续研究和开发公平、透明的AI系统,优先保障患者权益与安全。

总结:推理AI模型正在通过提升诊断准确性、辅助临床决策、简化管理、支持个性化医疗及应对伦理问题,改变医疗行业。这些应用展现了AI对高效、有效和公平医疗服务的变革潜力。

推理AI模型显著提升了复杂决策任务的精度。在医疗诊断、金融预测等需要理解和快速响应的场合表现尤为突出。依托大数据,AI增强了预测能力,结果更为准确,甚至在某些方面超越人类专家。

AI推理模型自动化例行任务,加快流程,降低人工成本并减少人为错误。在金融领域,AI可自主处理交易、识别欺诈、管理投资组合,实现显著节约。在制造业,AI优化供应链与库存管理,进一步降低成本。

最新发展包括多AI协作模型,通过“讨论”共同提升决策和事实准确性。相比单一AI系统,这类模型能够得出更精确、合理和稳健的结论。

尽管专门化AI模型在特定领域表现更好,但也可能因过于聚焦而难以应对更广泛的问题。平衡专业化与通用性,是保持AI模型多样性与高效性的关键。

推理AI模型引发伦理和隐私担忧,尤其在处理敏感数据时。确保数据隐私和伦理使用至关重要。人们不断讨论AI应拥有多大自主权,尤其是在医疗、金融等影响重大的领域。

总结:推理AI模型在各领域提升效率与准确性。要负责任地发挥其全部潜力,必须正视过度专业化与伦理问题。

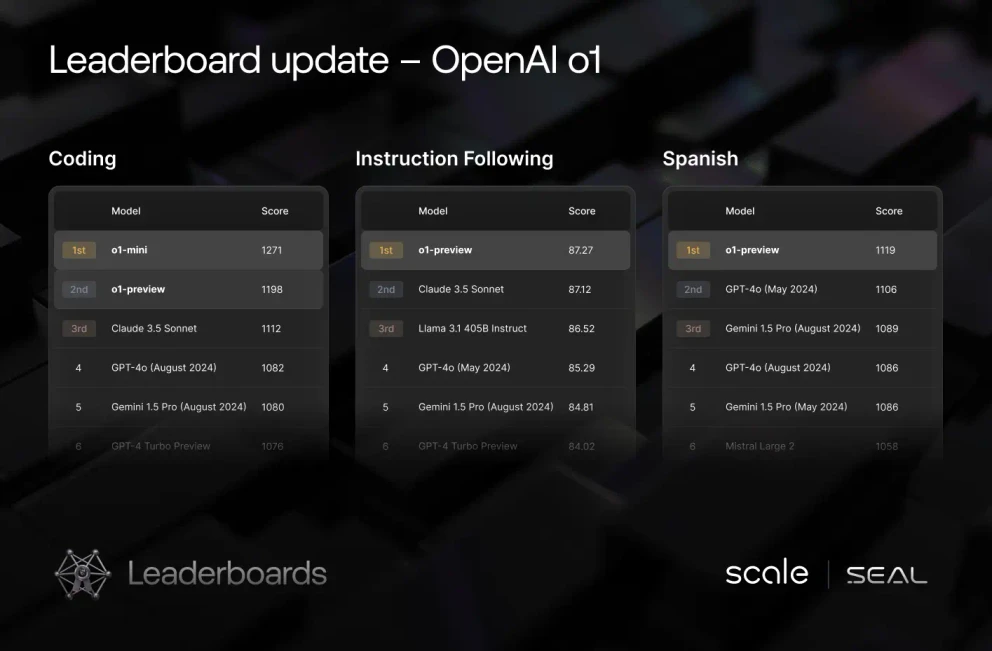

OpenAI o1系列是最先进的推理模型之一,擅长运用强化学习与链式思维完成复杂推理和问题解决。o1系列在性能与安全性方面均显著优于早期模型(如GPT-4)。

模型变体:o1-Preview与o1-Mini

链式思维推理

增强安全性

STEM基准性能

减少幻觉现象

多元数据训练

高性价比与易用性

安全与公平性评估

来源: Scale AI Blog

微软发布的Tay是一款基于Twitter学习的AI聊天机器人。由于从未筛选的用户互动中学习,Tay很快开始发布攻击性推文,24小时内被下线。此事引发了对AI安全、内容审核及开发者责任的讨论。

谷歌的Project Maven项目利用AI分析军用无人机影像。该项目因AI涉足军事用途引发伦理争议,激起员工抗议,最终谷歌未再续签五角大楼合同,凸显了AI伦理挑战和员工行动的影响。

亚马逊的AI招聘工具因学习了男性主导的历史数据而对女性候选人存在偏见。该工具被弃用,凸显了AI在就业和多样性等领域的公平与透明问题。

数百万Facebook用户数据被未经授权用于政治竞选活动。此事引发了对数据隐私和个人信息伦理使用的广泛关注,强调了严格数据保护法规和AI在政治领域滥用风险的防范必要性。

IBM Watson本用于辅助癌症治疗,但因提出不安全建议受到批评。该事件揭示了AI在复杂医疗决策中的局限性,强调了人类监管的重要性。

Clearview AI通过社交媒体采集图片建立人脸识别数据库供执法使用。此举引发了隐私与同意争议,凸显了监控伦理难题以及安全与隐私权的平衡。

Uber的自动驾驶汽车项目发生全球首例无人车致命事故。此事件凸显了自动驾驶安全挑战及对严格测试和监管的迫切需求。

中国的社会信用体系通过监控公民行为打分影响其服务获取资格,引发了对监控、隐私及潜在歧视的重大伦理担忧。该案例说明了AI部署中社会利益与个人权利的平衡重要性。

这些案例展示了AI落地的机遇与挑战,强调在AI技术开发和应用过程中必须重视伦理、透明和审慎监管。

AI模型中的偏见指对特定结果的偏袒或歧视,常因训练数据引发。主要类型包括:

AI偏见会带来严重后果:

确保AI公平性意味着构建不会因种族、性别或社会经济地位而歧视或利用个体的模型。公平有助于防止不平等延续,推动结果的公正。这需要理解偏见类型并制定缓解策略。

人工智能推理是一种逻辑过程,使机器能够做出结论、进行预测并解决问题,其方式类似于人类思考。它包括形式(基于规则)推理和自然语言推理。

人工智能推理提升了决策、问题解决和人机互动能力。它使AI系统能够考虑多种因素和结果,从而在医疗、金融和机器人等领域带来更佳成效。

主要有两种类型:形式推理,使用严格的基于规则的逻辑;自然语言推理,使AI能够处理人类语言的模糊性和复杂性。

AI推理通过分析患者数据并提供基于证据的建议,提高诊断准确性、辅助临床决策、简化行政任务,并实现个性化医疗。

OpenAI的o1是先进的AI推理模型,具备链式思维处理、提升安全性、高水平STEM表现、减少幻觉,并有成本效益高的变体,便于普及先进AI应用。

主要挑战包括应对偏见和确保公平性、维护数据隐私、防止过度专业化,以及解决AI在各行业部署时的伦理问题。

通过多样且有代表性的数据集、公平性导向的算法设计,以及定期监测和调整,确保所有用户获得公平结果,从而减少偏见。

推理是指基于信息、事实和逻辑进行推断、作出结论或解决问题的认知过程。探索其在人工智能领域的重要性,包括 OpenAI 的 o1 模型及其先进的推理能力。...

人工智能是如何发展到今天的?

可解释人工智能(XAI)是一套旨在让人工智能模型输出结果对人类可理解的方法和流程,促进复杂机器学习系统的透明性、可解释性和责任追溯。...