可扩展性

AI 可扩展性指的是 AI 系统无需大规模重新训练即可将其能力扩展到新的领域、任务和数据集,采用迁移学习、多任务学习和模块化设计等技术,实现灵活性与无缝集成。...

Anthropic首席执行官Dario Amodei做客Lex Fridman,讨论AI的未来,包括扩展定律、AGI时间表、安全性、可解释性和监管等话题。

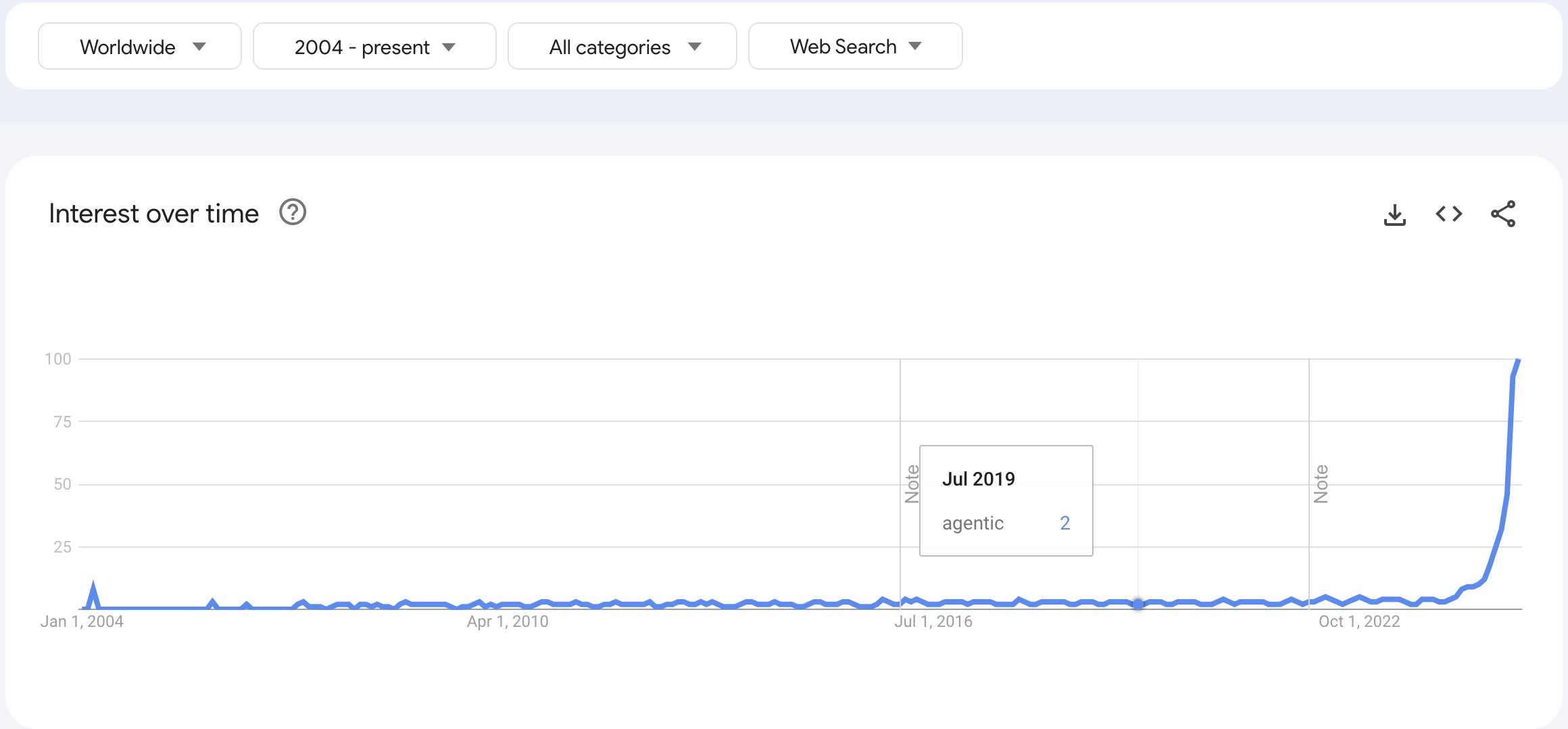

扩展对于打造更高效、更强大的AI模型至关重要。扩展定律指的是随着模型参数数量的增加,AI性能会有所提升。Amodei讨论了扩展对模型能力的影响,并指出更大的模型展现出更好的学习和推理能力。这一讨论强调了在模型规模与神经网络效率之间取得平衡的重要性,有望推动AI应用取得重大进展。

Amodei预测,AI可能会在2026至2027年间达到人类级智能。这一预测基于当前计算能力、数据获取和AI技术迅速发展的趋势。他的见解不仅涵盖了实现这一智能水平的技术里程碑,还涉及伴随而来的伦理和哲学问题。

一个主要挑战是AI权力集中在少数强大实体手中。Amodei警告,这可能导致技术获取不平等和潜在滥用,加剧全球不平等并威胁民主。为应对这一问题,需要公平分配AI进步成果,确保所有人受益,防止任何单一实体垄断技术。

了解AI内部运作机制(即机械可解释性)对于安全部署AI至关重要。Amodei强调需要理解AI如何做出决策和预测。通过提升透明度和可解释性,研究人员可以更好地预测AI行为、发现偏见并降低风险,尤其是在医疗、金融和国家安全等重要领域,这些系统正变得愈发自主。

模型层级结构是Anthropic AI方法的重要组成部分。Amodei介绍了不同模型规模如何服务于多样化的应用:小型模型适用于日常任务,大型模型则满足专业化需求。这种结构化策略让AI可灵活应用于各个领域,确保为不同行业和社会需求提供合适的解决方案。

Anthropic的RSP框架突出其对AI安全的承诺,通过负责任的扩展实现。这个框架涵盖了扩展AI模型的系统化步骤,确保随着AI能力的提升,其应用依然安全、合乎伦理并具社会责任感。通过这种方式,Anthropic致力于应对AI发展过程中的潜在伦理挑战,推动谨慎且创新的进步。

监管对于引导AI朝着积极、安全的方向发展至关重要。Amodei倡导制定全面法律框架来管理AI技术,强调设定明确的安全标准和监督机制。这种主动的做法旨在防止AI被滥用,同时推动兼顾公众利益与福祉的技术进步。

讨论还涉及了当前计算能力和数据可用性带来的限制,这些因素可能阻碍AI的未来发展。要突破这些障碍,需要探索如量子计算等新型计算方式,为下一代AI发展提供支持。同时,寻找可持续且可扩展的数据管理解决方案也是克服壁垒、保护隐私的关键。

AI扩展定律指的是通过增加AI模型的规模和参数,能够提升其表现的趋势。Dario Amodei强调,更大的模型通常展现出更好的学习和推理能力,但在扩展规模和效率间找到平衡仍然至关重要。

Dario Amodei预测,根据计算能力、数据获取和技术快速发展的趋势,AI可能会在2026年至2027年间达到人类级智能。

机械可解释性至关重要,因为它帮助研究人员理解AI模型如何做出决策和预测。这种透明性让人们能更好地预测AI行为、识别偏见,并在AI在关键领域变得更加自主时降低风险。

主要挑战包括AI权力集中于少数实体、潜在滥用、全球不平等以及对民主的威胁。确保AI技术的公平分配和负责任地扩展对于缓解这些挑战非常必要。

Dario Amodei主张制定全面法律框架和监管,为AI发展设定明确的安全标准和监督机制,旨在防止滥用,同时保护公众利益并推动负责任的技术进步。

Viktor Zeman 是 QualityUnit 的共同所有人。即使在领导公司 20 年后,他仍然主要是一名软件工程师,专注于人工智能、程序化 SEO 和后端开发。他参与了众多项目,包括 LiveAgent、PostAffiliatePro、FlowHunt、UrlsLab 等等。

AI 可扩展性指的是 AI 系统无需大规模重新训练即可将其能力扩展到新的领域、任务和数据集,采用迁移学习、多任务学习和模块化设计等技术,实现灵活性与无缝集成。...

探索人工智能如何从语言模型发展到能够操作图形界面和网页浏览器的系统,FlowHunt 团队深入探讨了创新、挑战以及人机交互未来的见解。...

探索2025年最重要的AI趋势,包括AI智能体和AI团队的崛起,了解这些创新如何通过自动化、协作和高级问题解决能力正在改变各行各业。...