人类参与环节(Human in the Loop)

人类参与环节(HITL)是一种人工智能和机器学习的方法,将人类专业知识整合到AI系统的训练、调整和应用中,以提升准确性、减少错误并确保伦理合规。...

了解“人类参与环节”(HITL)如何通过人类监督赋能AI聊天机器人,实现更高的准确性、伦理合规与用户满意度。看看 FlowHunt 如何实现自动对话中的无缝人工干预。

“人类参与环节”(Human in the Loop,HITL)是在构建和使用人工智能(AI)与机器学习(ML)系统,尤其是聊天机器人时的重要理念。HITL指的是在关键环节融合人类判断和专业知识与AI。这种人与机器的协作,有助于提升AI结果、确保符合伦理规范,并增强系统的整体表现。

人类参与环节涵盖了数据收集、模型训练和持续AI系统检查等不同阶段的人类输入。通过增加人类监督,HITL系统能够应对偏见、提升结果准确性,并让AI模型更易于理解。这对于聊天机器人来说尤为重要,因为保持高质量、让用户满意的对话体验是必要的。

HITL是一种AI和ML的方法,指人类通过反馈、验证和修正等方式参与机器学习过程。这种人类协助能减少错误、降低偏见、提升AI系统的准确性。在聊天机器人中,HITL允许实时干预与定制,帮助其更好地处理复杂和敏感的对话。

人类输入对于防止聊天机器人传播社会偏见或做出引发意外问题的决策至关重要。例如,在内容审核或客户服务中,人类判断可以理解AI可能忽略的细微差别和语境。

人类参与环节在各个领域有广泛的应用。在医疗领域,HITL被用于医学聊天机器人,提供精准的健康信息和诊断支持,确保敏感复杂的健康问题得到妥善处理。在客户服务中,配备HITL的聊天机器人高效应对常规问题,同时在人类介入下解决更棘手的事务。

电商网站也利用HITL聊天机器人增强客户互动并定制购物体验。人类监督确保这些聊天机器人保持专业沟通,避免潜在的公关风险。

在聊天机器人中采用HITL不仅提升了系统的准确性与可靠性,还建立了用户信任和满意度。随着AI技术不断进步,人类将持续在自动化系统与以人为本需求之间起到关键桥梁作用。

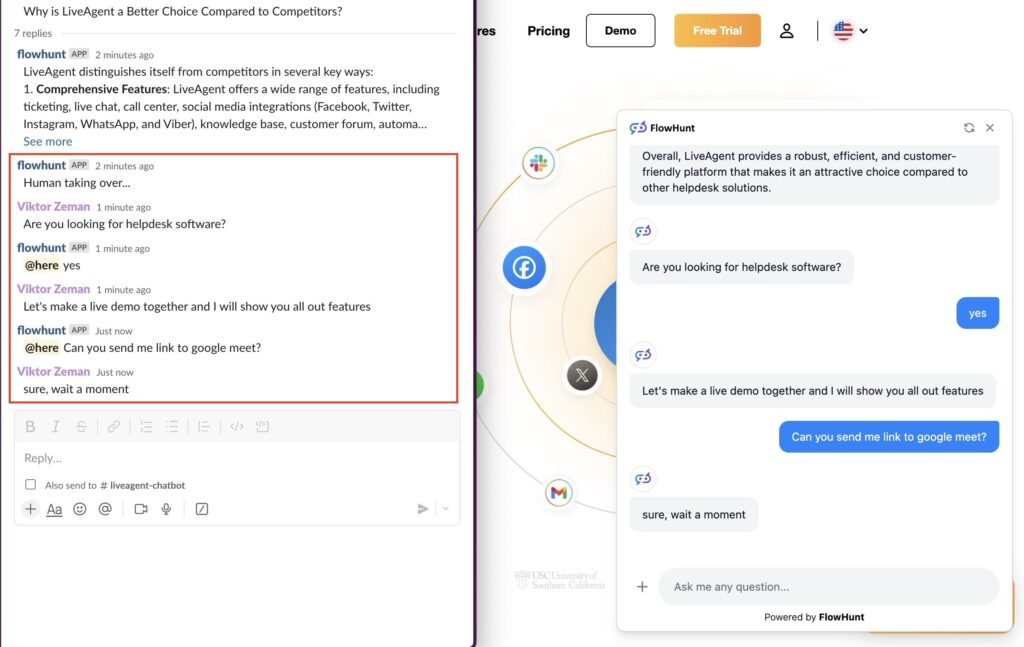

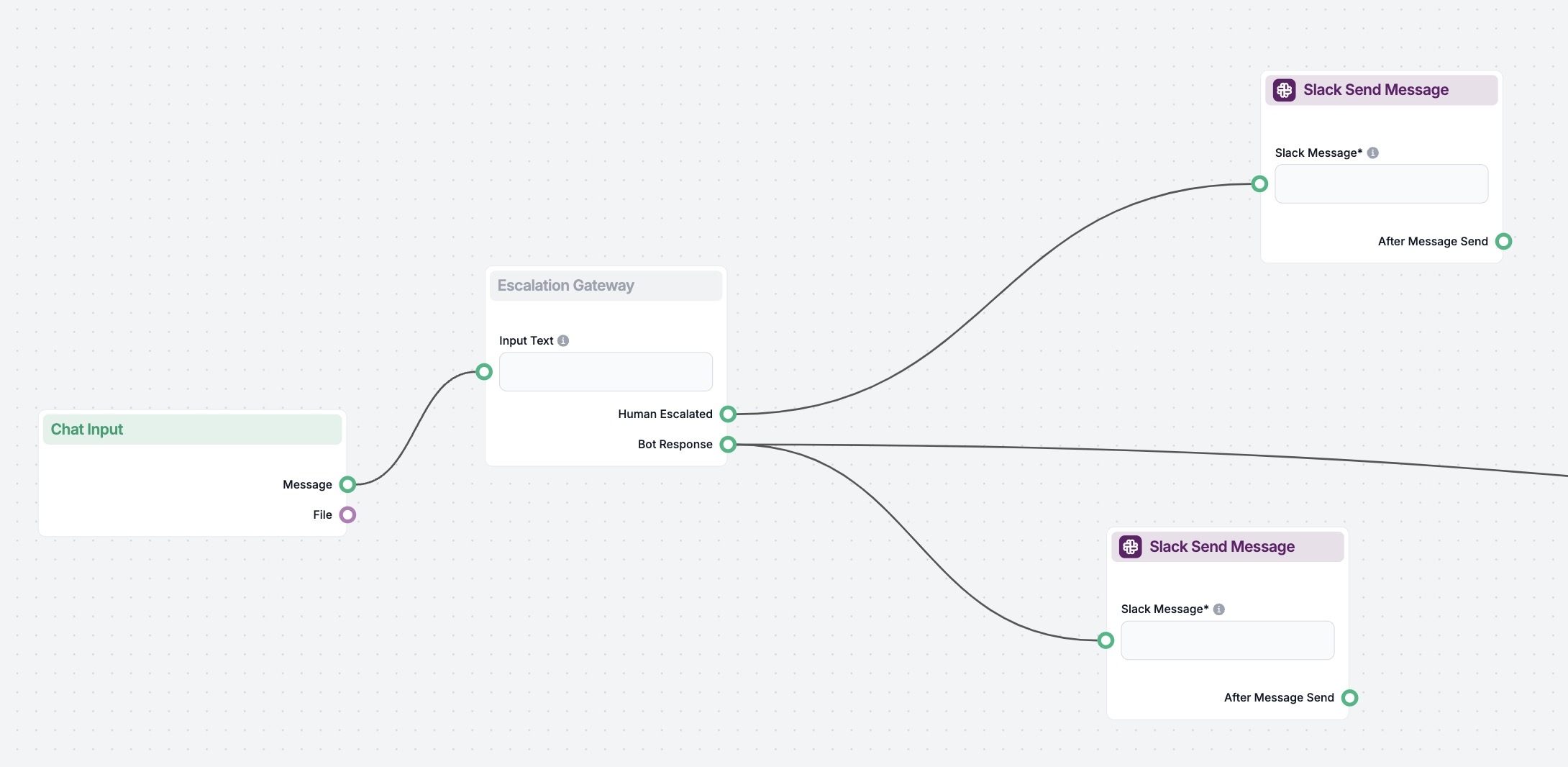

上图展示了AI聊天机器人中的“人类参与环节”流程。人类实时监控在线访客与聊天机器人的交流,并从机器人手中接管沟通。

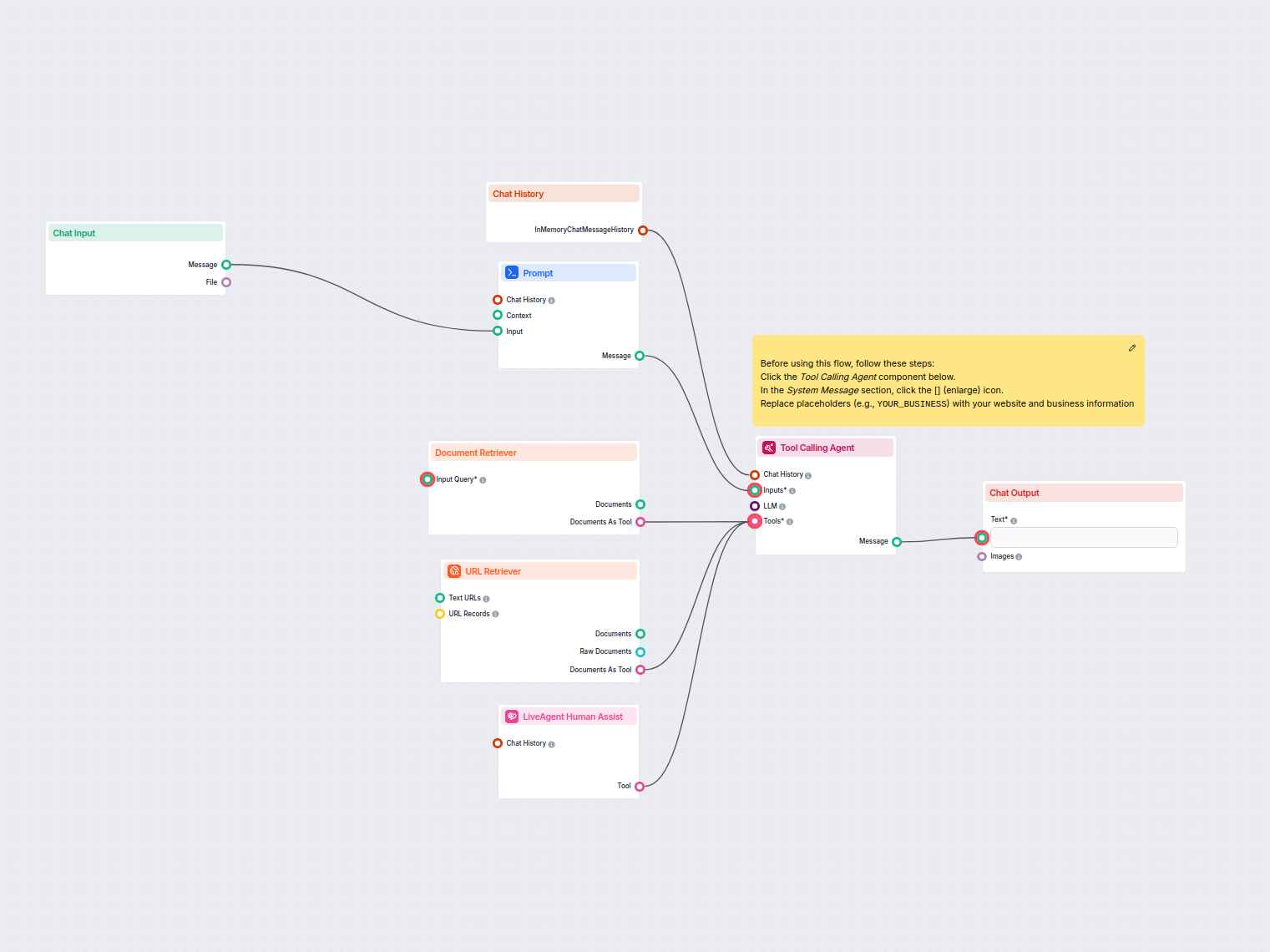

FlowHunt 允许聊天机器人拥有者在自动化对话中无缝插入升级网关。该功能可在需要时将对话转交给真实人工,比如通过Slack等工具,确保复杂问题或敏感事务能由客服代表直接、个性化地处理。

升级网关组件

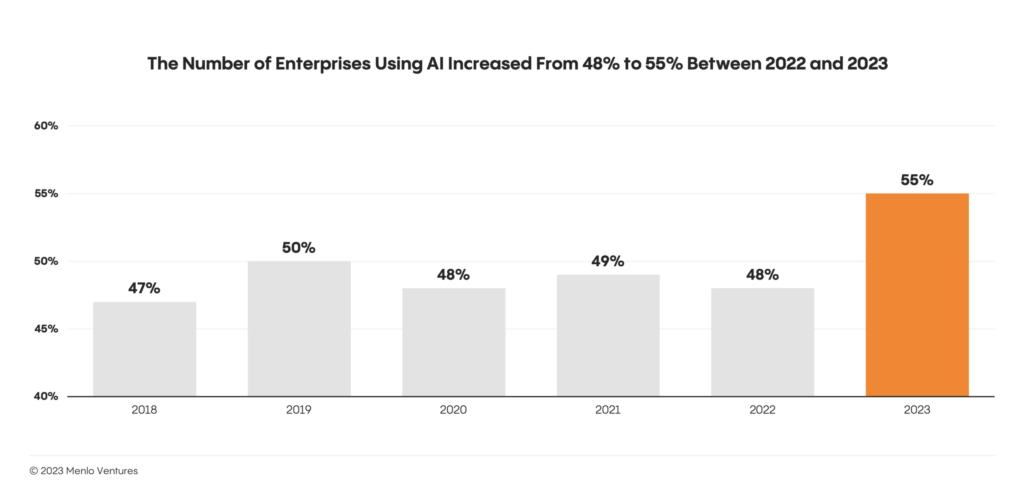

在企业级AI应用中,“人类参与环节”(HITL)的采用正迅速扩展。越来越多行业认识到引入人类监督能提升AI系统决策质量并维护伦理标准。HITL帮助企业在AI流程中保持主控,降低自动化带来的风险。在金融和医疗等领域,人类监督对于审查AI输出、防止偏见和错误尤为关键。企业利用HITL通过实时人类输入提升客户体验,实现更精准和个性化的服务,并在需要时提升运营效率。

图片来源:Menlo Ventures

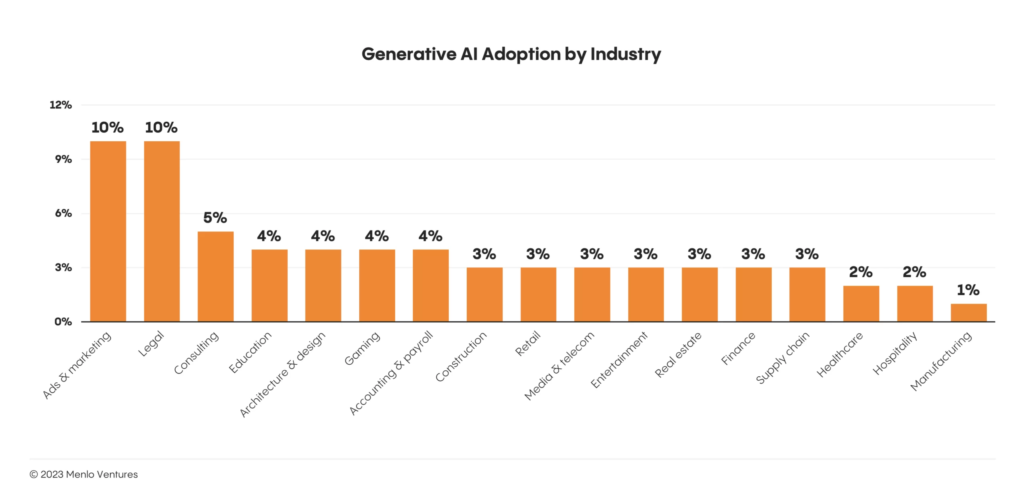

HITL与生成式AI的结合正在改变会话类AI系统的工作方式。生成式AI可以自主生成内容,但在人类引导下效果更佳。人类操作员能够引导生成模型输出更贴合语境、更契合需求的内容,特别是在客户服务类聊天机器人中。这种协作不仅提升了互动质量,也让AI系统更好地契合人类价值观和商业目标。融合生成能力与人类洞察,企业能够打造更先进、更灵活的AI解决方案,满足不断变化的用户需求。

图片来源:Menlo Ventures

当前HITL的采用趋势凸显了其在推动AI技术进步中的重要作用。随着AI在各行业普及,越来越需要融合人类判断和创造力的系统。这一趋势反映了对伦理AI的需求,并强调了人机协作在实现创新和可靠结果中的价值。

HITL系统通过人类监督不断优化AI输出。在初始阶段,人类专家负责数据标注,为AI模型学习和预测提供基础“真值”。随着模型运行,人类反馈对于检查AI表现、纠正错误和解决偏见极为重要。这一持续过程有助于确保AI系统输出符合现实世界的期望和社会价值观。

例如,在对话系统中,HITL允许人工代理实时介入,修改或批准AI生成的回复,确保回复适当且准确。这在客户服务和医疗等敏感领域尤为重要,因为AI生成内容可能产生重大影响。

采用HITL不仅提升性能,也促进生成式AI的伦理使用。它为发现和纠正偏见提供了手段,实现更包容和公平的结果。这有助于维护用户信任并满足AI应用的伦理标准。引入人类判断,HITL系统降低了自主AI决策带来的风险,比如强化刻板印象或生成有害内容。

随着AI技术进步,HITL与生成式AI的协作将不断深化。持续的人类参与有助于AI系统适应新环境和新输入,保持其相关性与准确性。未来,随着AI模型日益先进,对HITL的需求将持续存在,确保这些技术既强大又负责任,始终契合人类价值观。

总之,将“人类参与环节”与生成式AI模型结合,是变革会话系统的关键。HITL系统通过提升准确性、确保伦理标准和实现持续学习,成为开发可靠、可信AI解决方案的核心。随着技术进步,人类监督将始终是AI有效落地的基础组成部分。

在聊天机器人中采用“人类参与环节”(HITL)系统也带来诸多挑战。其中最主要的是可扩展性。增加人类监督会让AI应用扩展变得困难。随着数据与交互量增长,保持人类参与将需要大量人力和技术投入。

另一个挑战是成本。雇佣人类专家监督和协作AI系统会带来额外开支。对于中小企业或初创公司来说,可能难以负担大规模人类参与所需的预算。此外,将人类监督集成进AI工作流的复杂性,也可能带来集成难题。确保人类代理与AI高效协作,需要先进的系统设计和强有力的沟通机制。

伦理问题在实施HITL时同样不容忽视。自动化与人类输入的平衡需要谨慎规划,以避免强化既有偏见或引发新的伦理风险。人类监督有助于减少这些风险,为AI决策提供机器无法具备的情境和判断力。然而,这也要求人类代理团队足够多元和包容,确保AI决策能吸纳不同视角。

总之,聊天机器人中“人类参与环节”的未来充满机遇与发展潜力。人类智能与AI能力的融合,将持续推动我们与机器的互动变得更具伦理性、高效且以用户为中心。

人类参与环节(HITL)是指在AI聊天机器人的关键开发和运行阶段(如数据收集、模型训练和实时干预)引入人类专业知识,以提升准确性、减少偏见,并确保伦理标准的实现。

HITL很重要,因为它确保聊天机器人能提供准确、公正、符合语境的回应。人类监督有助于避免伦理问题并建立用户信任,尤其在医疗和客户服务等敏感领域尤为关键。

FlowHunt 允许聊天机器人拥有者插入升级网关,当遇到复杂或敏感问题时,实现真实人工的介入。这确保用户在自动化无法满足时,获得个性化和高效的支持。

挑战包括可扩展性、运营成本增加、集成复杂性,以及需要多元化的人类监督以避免引入新的偏见或伦理风险。

通过让人类参与数据标注、输出验证和反馈,HITL系统持续提升模型准确性,并帮助发现和修正偏见,确保AI输出符合现实世界的价值观和期望。

Viktor Zeman 是 QualityUnit 的共同所有人。即使在领导公司 20 年后,他仍然主要是一名软件工程师,专注于人工智能、程序化 SEO 和后端开发。他参与了众多项目,包括 LiveAgent、PostAffiliatePro、FlowHunt、UrlsLab 等等。

人类参与环节(HITL)是一种人工智能和机器学习的方法,将人类专业知识整合到AI系统的训练、调整和应用中,以提升准确性、减少错误并确保伦理合规。...

为企业高管提供一份关于实施 Human-in-the-Loop(HITL)框架的实用指南,帮助实现负责任的 AI 治理、降低风险、合规运营,并在企业 AI 系统中建立信任。...

通过 AI 聊天机器人自动化 LiveAgent 的客户支持,利用您的内部知识库解答问题,检索相关文档,并在需要时无缝转接至人工客服。通过智能化的问题处理,提高响应速度和客户满意度。...