嵌入向量

嵌入向量是在多维空间中对数据进行密集数值表示的方法,能够捕捉语义和上下文关系。了解嵌入向量如何驱动自然语言处理、图像处理和推荐系统等 AI 任务。...

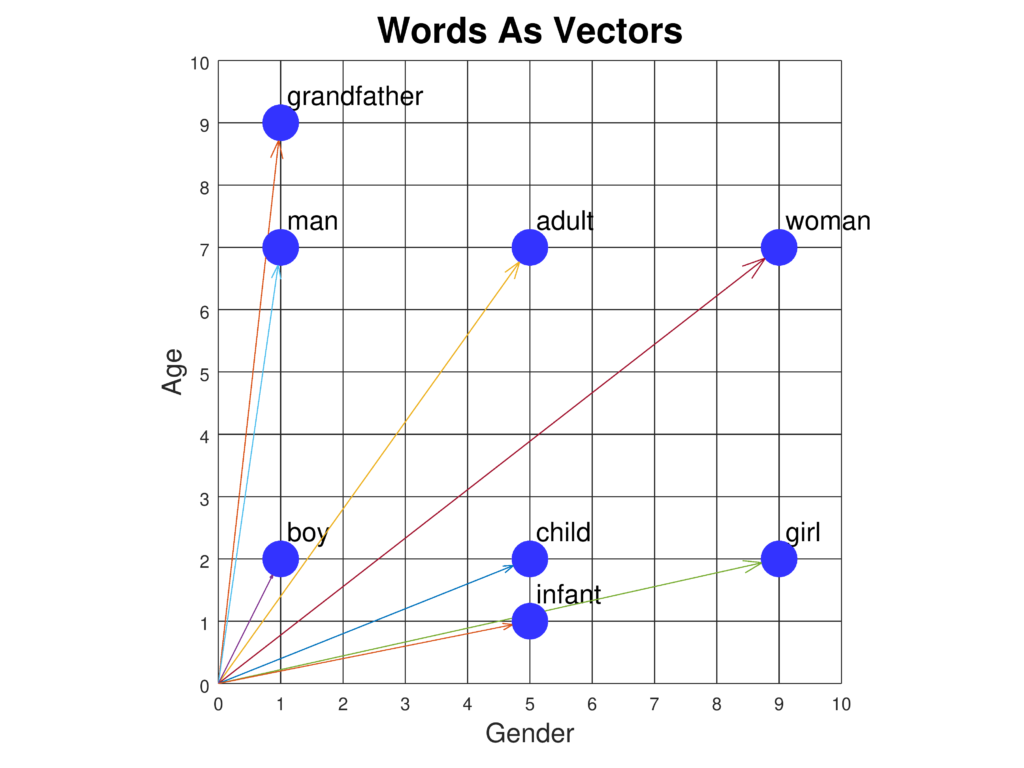

词嵌入将单词映射到连续空间中的向量,捕捉其含义和上下文,从而提升NLP应用效果。

词嵌入在NLP中扮演着桥梁作用,推动了人机交互的发展。了解其关键概念、工作原理及应用场景:

NLP中词嵌入的研究

基于词义定义的词义嵌入学习

Qi Li, Tianshi Li, Baobao Chang (2016) 针对词嵌入中多义词和同形异义词问题,提出了基于词义定义为每个词义生成一个嵌入的方法。该方法结合语料库进行训练,实现了高质量的词义嵌入。实验结果显示在词相似度和词义消歧任务上取得了提升,显示了词义嵌入在提升NLP应用中的潜力。阅读全文

基于神经网络的词嵌入去噪

Kim Anh Nguyen, Sabine Schulte im Walde, Ngoc Thang Vu (2016) 提出了两种通过去噪提升词嵌入质量的模型。作者识别出传统嵌入中存在的冗余信息,并提出无监督学习方法生成去噪词嵌入。这些模型利用深度前馈神经网络强化关键信息,减少噪声,实验结果在多个基准任务上表现优异。阅读全文

神经词嵌入综述

Erhan Sezerer, Selma Tekir (2021) 对神经词嵌入的发展和影响进行了全面回顾。综述涵盖了基础理论,并探讨了词义、词素和上下文嵌入等不同类型,介绍了基准数据集与性能评测,突显了神经嵌入对NLP任务的变革作用。阅读全文

通过显式词交互图层提升可解释性

Arshdeep Sekhon, Hanjie Chen, Aman Shrivastava, Zhe Wang, Yangfeng Ji, Yanjun Qi (2023) 聚焦于通过WIGRAPH神经网络层提升NLP模型可解释性。该层构建了单词间的全局交互图,可集成于任何NLP文本分类器,提升了模型解释性和预测性能。研究强调了词间交互对模型决策理解的重要性。阅读全文

银行业的词嵌入应用

Avnish Patel (2023) 探讨了词嵌入在银行业的应用,突出其在情感分析、文本分类等任务中的作用。研究考察了静态词嵌入(如Word2Vec、GloVe)和上下文模型,并强调了其在行业特定NLP任务中的影响。阅读全文

词嵌入是单词的密集向量表示,将语义相似的单词映射到连续空间中的相近点,使模型能够理解语言中的上下文和关系。

词嵌入通过捕捉语义和句法关系、降低维度、实现迁移学习,并提升对罕见词的处理能力,从而增强了NLP任务的表现。

常见技术包括Word2Vec、GloVe、FastText和TF-IDF。Word2Vec和GloVe等神经模型通过大规模文本学习嵌入,FastText则结合了子词信息。

传统嵌入难以处理多义词,可能加剧数据偏见,并且在大语料训练时需要大量计算资源。

词嵌入用于文本分类、机器翻译、命名实体识别、信息检索和问答系统,提升了准确性和上下文理解能力。

嵌入向量是在多维空间中对数据进行密集数值表示的方法,能够捕捉语义和上下文关系。了解嵌入向量如何驱动自然语言处理、图像处理和推荐系统等 AI 任务。...

自然语言处理(NLP)使计算机能够利用计算语言学、机器学习和深度学习来理解、解释和生成人的语言。NLP 支持翻译、聊天机器人、情感分析等应用,正在改变各行各业,提升人机交互体验。...

增强型基于自然语言处理(NLP)的文档搜索将先进的自然语言处理技术集成到文档检索系统中,在使用自然语言查询搜索大量文本数据时,提高了准确性、相关性和效率。...