DeepSeek MCP 服务器

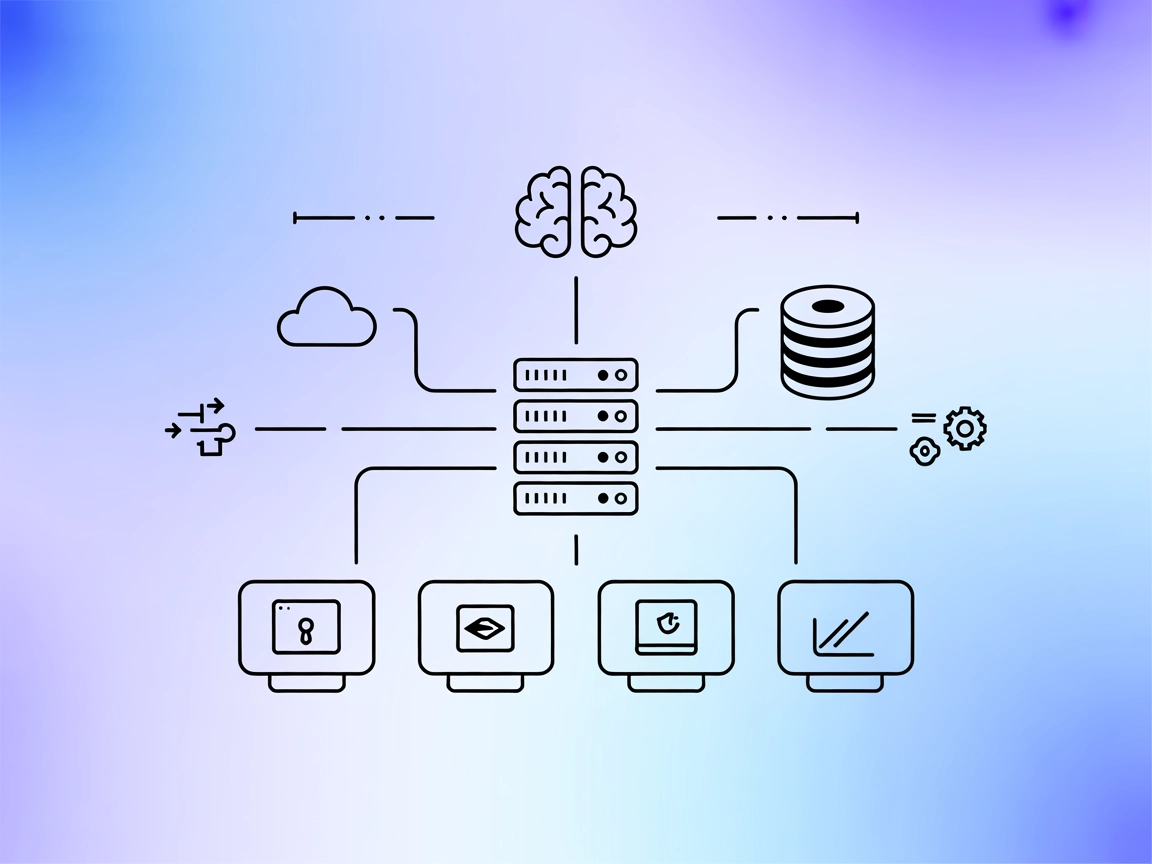

DeepSeek MCP 服务器将 DeepSeek 的先进语言模型与兼容 MCP 的应用集成,提供安全、匿名的 API 访问,使在 Claude Desktop 和 FlowHunt 等工具中实现可扩展、保护隐私的 AI 工作流成为可能。...

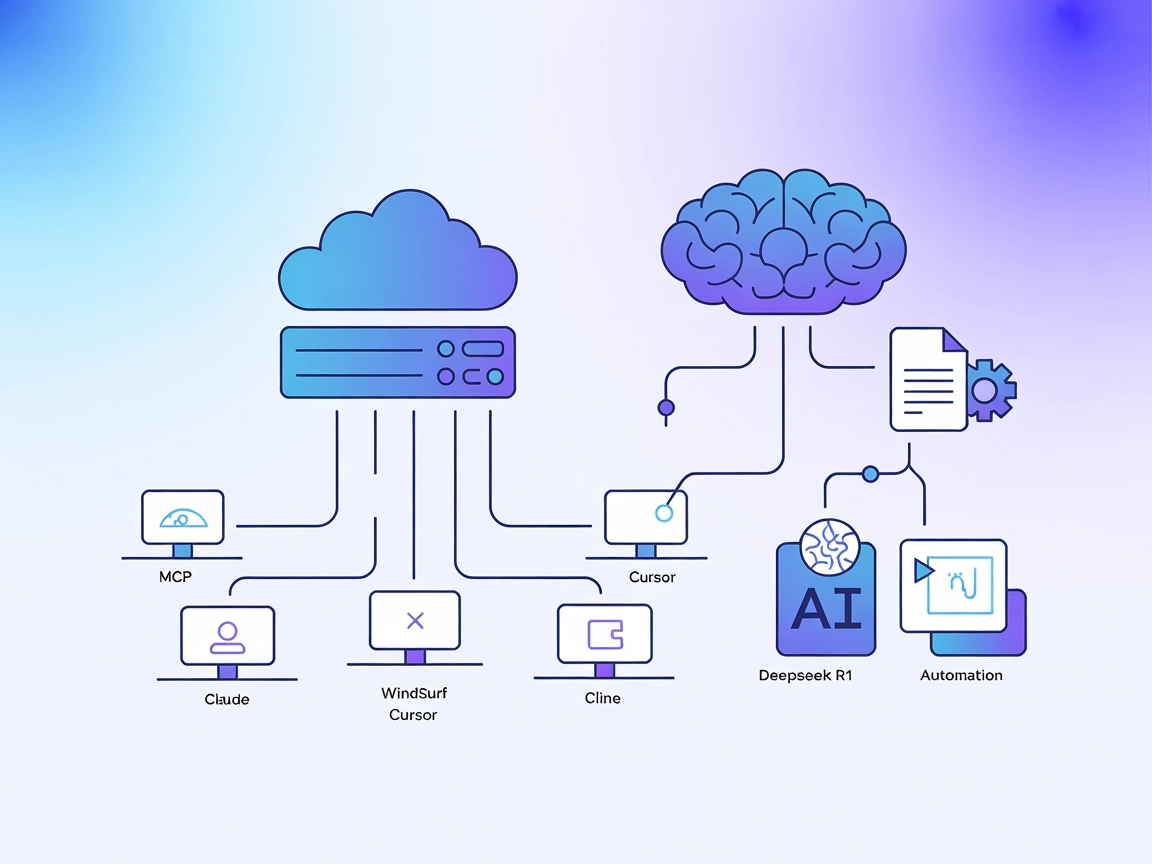

FlowHunt在您的内部系统和AI工具之间提供额外的安全层,让您能够精细控制从MCP服务器可访问哪些工具。托管在我们基础设施中的MCP服务器可以与FlowHunt的聊天机器人以及ChatGPT、Claude和各种AI编辑器等热门AI平台无缝集成。

DeepSeek MCP 服务器是一款 Model Context Protocol (MCP) 服务器,旨在将 DeepSeek 的先进语言模型与兼容 MCP 的应用(如 Claude Desktop)进行桥接。通过作为代理,允许 AI 助手与 DeepSeek API 交互,同时保持用户匿名性——API 只可见代理。该集成为开发者带来了更强大的工作流体验,使其可无缝访问 DeepSeek 的强大自然语言能力。通过 MCP 服务器,应用和 AI 代理可用于语言理解、文本生成、基于 API 的自动化等任务,全部基于标准化、安全且可扩展的协议框架内。

仓库及文档中未提及任何提示模板。

仓库及文档中未描述明确的 MCP 资源。

在可用文件或 README 中未发现任何工具定义(如 query_database、read_write_file、call_api)。

windsurf.config.json)。"mcpServers": {

"deepseek-mcp": {

"command": "npx",

"args": ["deepseek-mcp-server", "start"]

}

}

"mcpServers": {

"deepseek-mcp": {

"command": "npx",

"args": ["deepseek-mcp-server", "start"]

}

}

cursor.config.json。"mcpServers": {

"deepseek-mcp": {

"command": "npx",

"args": ["deepseek-mcp-server", "start"]

}

}

cline.config.json 文件。"mcpServers": {

"deepseek-mcp": {

"command": "npx",

"args": ["deepseek-mcp-server", "start"]

}

}

请通过环境变量配置敏感信息(如 API 密钥)。示例:

"mcpServers": {

"deepseek-mcp": {

"command": "npx",

"args": ["deepseek-mcp-server", "start"],

"env": {

"DEEPSEEK_API_KEY": "${DEEPSEEK_API_KEY}"

},

"inputs": {

"api_key": "${DEEPSEEK_API_KEY}"

}

}

}

FlowHunt 中使用 MCP

要将 MCP 服务器集成到您的 FlowHunt 工作流中,首先在流程中添加 MCP 组件,并将其连接到您的 AI 代理:

点击 MCP 组件以打开配置面板。在系统 MCP 配置部分,按如下 JSON 格式填写您的 MCP 服务器信息:

{

"deepseek-mcp": {

"transport": "streamable_http",

"url": "https://yourmcpserver.example/pathtothemcp/url"

}

}

配置后,AI 代理即可作为工具使用该 MCP,获得其全部功能和能力。请记得将 “deepseek-mcp” 替换为您的实际 MCP 服务器名称,并将 URL 换成您自己的 MCP 服务器地址。

| 部分 | 是否可用 | 详情/备注 |

|---|---|---|

| 概览 | ✅ | 在 README.md 中找到 |

| 提示模板列表 | ⛔ | 未发现提示模板 |

| 资源列表 | ⛔ | 未列出明确资源 |

| 工具列表 | ⛔ | 服务器文件中未定义工具 |

| 安全存储 API 密钥 | ✅ | 存在 .env.example,提供了说明 |

| 采样支持(评估时次要考虑) | ⛔ | 未提及 |

Roots 支持:未提及

采样支持:未提及

综上,DeepSeek MCP 服务器主要作为 DeepSeek API 的代理适配器,提供了完善的搭建及安全密钥管理文档,但缺乏明确的提示、资源或工具示例。它最适合需要在 MCP 兼容环境中轻松、匿名访问 DeepSeek 模型的用户。

该 MCP 服务器在搭建和安全性方面文档完善,但在高级 MCP 原语(如提示、资源、工具)示例方面有所欠缺。其主要价值在于便捷接入 DeepSeek 模型。项目活跃并受到社区好评。

| 是否有 LICENSE | ✅ (MIT) |

|---|---|

| 至少有一个工具 | ⛔ |

| Fork 数量 | 32 |

| Star 数量 | 242 |

DeepSeek MCP 服务器是一种代理,可将 DeepSeek 的语言模型连接到兼容 MCP 的客户端(如 FlowHunt 或 Claude Desktop)。它允许应用和代理在不暴露 API 密钥和身份给第三方服务的情况下,使用 DeepSeek 模型进行语言任务。

DeepSeek MCP 服务器作为安全代理,确保您的 API 密钥和用户身份永远不会暴露给 DeepSeek API,提供隐私和集中访问管理。

您可以使用 DeepSeek MCP 服务器进行匿名模型访问,将 DeepSeek 集成到桌面客户端,集中管理 API 使用,自动化工作流,以及快速原型开发 AI 功能。

建议使用环境变量存储您的 DeepSeek API 密钥。MCP 服务器从您的环境配置中读取密钥,确保敏感数据不会以明文暴露。

没有提供明确的提示模板或工具定义。该服务器主要作为代理,使 MCP 兼容环境下可基本使用模型。

DeepSeek MCP 服务器将 DeepSeek 的先进语言模型与兼容 MCP 的应用集成,提供安全、匿名的 API 访问,使在 Claude Desktop 和 FlowHunt 等工具中实现可扩展、保护隐私的 AI 工作流成为可能。...

Deepseek Thinker MCP 服务器将 Deepseek 模型推理集成到支持 MCP 的 AI 客户端(如 Claude Desktop),为增强型 AI 工作流提供先进的思维链输出。支持云端与本地推理,适合开发者调试、透明推理以及 AI 智能体能力提升。...

Deepseek R1 MCP 服务器可以将 DeepSeek 的高级语言模型(如 Deepseek R1 和 V3)无缝集成到 Claude Desktop 及其他支持的平台——为 AI 智能体赋予超大上下文窗口、强大推理和高级文本生成能力。...

Cookie 同意

我们使用 cookie 来增强您的浏览体验并分析我们的流量。 See our privacy policy.