模型上下文协议 (MCP) 服务器

模型上下文协议(MCP)服务器将 AI 助手与外部数据源、API 和服务连接起来,实现复杂工作流的无缝集成,并在 FlowHunt 中安全管理开发任务。...

通过 Defang MCP 服务器将 AI 工作流连接至外部数据、API 或服务,赋能上下文感知且强大的 AI 解决方案。

FlowHunt在您的内部系统和AI工具之间提供额外的安全层,让您能够精细控制从MCP服务器可访问哪些工具。托管在我们基础设施中的MCP服务器可以与FlowHunt的聊天机器人以及ChatGPT、Claude和各种AI编辑器等热门AI平台无缝集成。

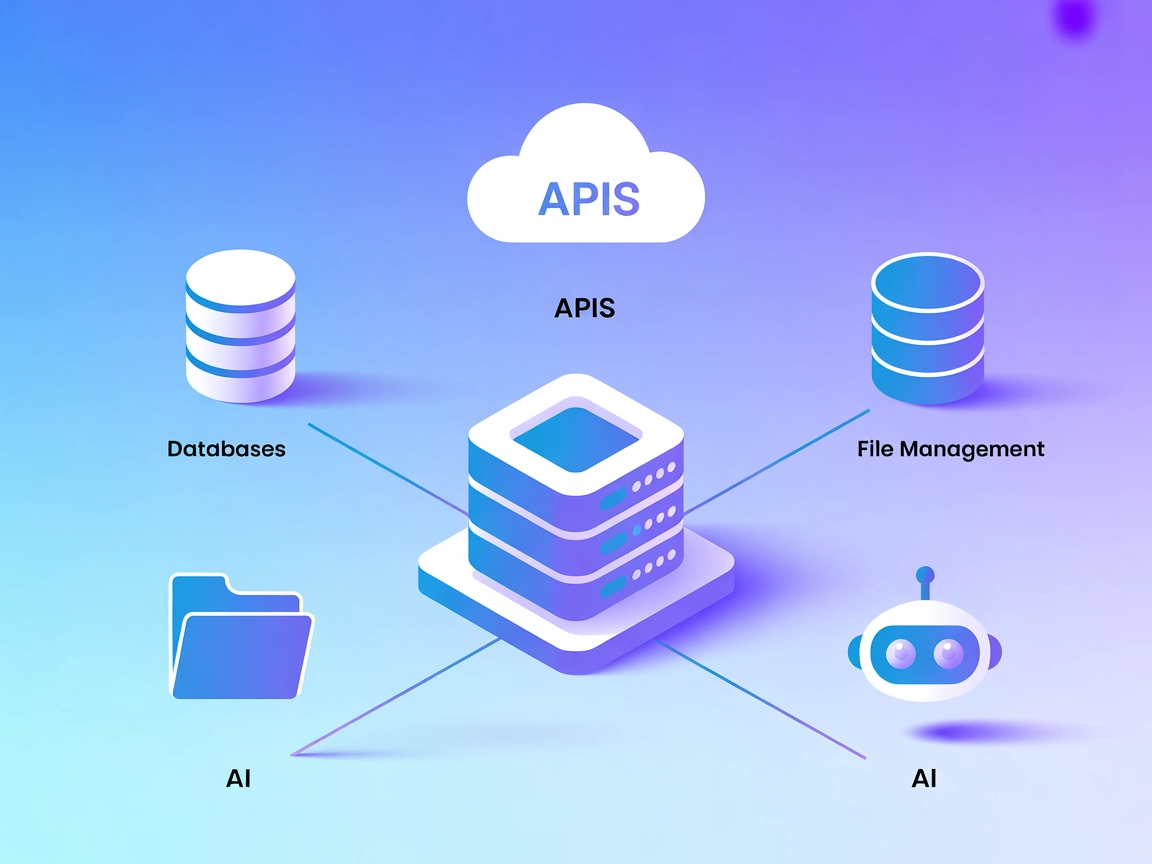

defang MCP(模型上下文协议)服务器旨在为 AI 助手与外部数据源、API 或服务之间搭建桥梁,从而增强并简化开发流程。它作为中间层,使 AI 系统能够以标准化的方式执行数据库查询、文件管理或与各类 API 的交互等任务。这种协议驱动的方法让开发者可以构建强大、具备上下文感知的 AI 功能模块,实现对外部信息和资源的访问、操作与利用,让开发过程更加高效和可靠。

在 FlowHunt 中使用 MCP

要将 MCP 服务器集成到 FlowHunt 的工作流中,请先在流程中添加 MCP 组件,并将其连接到你的 AI 代理:

点击 MCP 组件以打开配置面板。在系统 MCP 配置部分,按如下 JSON 格式填写你的 MCP 服务器信息:

{ “MCP-name”: { “transport”: “streamable_http”, “url”: “https://yourmcpserver.example/pathtothemcp/url" } }

配置完成后,AI 代理即可将该 MCP 作为工具,访问其所有功能与能力。请记得将 “MCP-name” 替换为你实际的 MCP 服务器名称(例如 “github-mcp”、“weather-api” 等),并将 URL 替换为你自己的 MCP 服务器地址。

| 部分 | 可用性 | 详情/备注 |

|---|---|---|

| 概览 | ✅ | |

| 提示词列表 | ⛔ | |

| 资源列表 | ⛔ | |

| 工具列表 | ⛔ | |

| API 密钥安全 | ⛔ | |

| 采样支持(评估中不太重要) | ⛔ |

两个表之间说明:

根据现有信息,该 MCP 服务器的文档极为简略或缺失,导致其实用性评分较低,不利于实际应用或评估。

| 是否有 LICENSE | |

|---|---|

| 是否有至少一个工具 | |

| 分叉数量 | |

| Star 数量 |

Defang MCP 服务器充当 AI 代理与外部数据源、API 或服务之间的中间层,支持标准化、协议驱动的工作流,用于构建健壮且具备上下文感知的 AI 自动化。

在 FlowHunt 流程中添加 MCP 组件,打开其配置,并按照推荐的 JSON 格式填写服务器详情。这样你的 AI 代理就能使用 Defang MCP 服务器所暴露的全部功能。

常见场景包括数据库查询、文件管理、以及将第三方 API 集成到你的 AI 自动化流程中,使其更灵活、更强大。

目前文档较少。如需进阶用法,请参考 FlowHunt 的通用 MCP 集成指南,或联系支持团队获取帮助。

请始终使用环境变量或部署平台的密钥管理功能,以避免在配置文件中暴露敏感信息。

在 FlowHunt 中使用 Defang MCP 服务器轻松集成外部数据和服务到你的 AI 代理。用极简设置构建强大且具备丰富上下文的自动化流程。

模型上下文协议(MCP)服务器将 AI 助手与外部数据源、API 和服务连接起来,实现复杂工作流的无缝集成,并在 FlowHunt 中安全管理开发任务。...

DeepSeek MCP 服务器作为安全代理,将 DeepSeek 的先进语言模型连接到兼容 MCP 的应用(如 Claude Desktop 或 FlowHunt),实现匿名 API 使用、工作流自动化和集中管理。...

DeepSeek MCP 服务器将 DeepSeek 的先进语言模型与兼容 MCP 的应用集成,提供安全、匿名的 API 访问,使在 Claude Desktop 和 FlowHunt 等工具中实现可扩展、保护隐私的 AI 工作流成为可能。...

Cookie 同意

我们使用 cookie 来增强您的浏览体验并分析我们的流量。 See our privacy policy.