AllenNLP

AllenNLP 是由 AI2 基于 PyTorch 构建的强大开源 NLP 研究库。它提供模块化、可扩展的工具、预训练模型,并可与如 spaCy 和 Hugging Face 等库轻松集成,支持文本分类、指代消解等任务。...

AllenNLP 是由 AI2 基于 PyTorch 构建的强大开源 NLP 研究库。它提供模块化、可扩展的工具、预训练模型,并可与如 spaCy 和 Hugging Face 等库轻松集成,支持文本分类、指代消解等任务。...

了解BERT(双向编码器表示,来自Transformer),这是由谷歌开发的开源机器学习框架,专为自然语言处理而设计。探索BERT双向Transformer架构如何革新AI语言理解、其在NLP、聊天机器人、自动化中的应用及关键研究进展。...

BMXNet 是基于 Apache MXNet 的二值神经网络(BNN)开源实现,支持用二值权重和激活在低功耗设备上高效部署 AI。

Caffe 是 BVLC 推出的开源深度学习框架,在构建卷积神经网络(CNN)方面以速度快和模块化著称。Caffe 广泛应用于图像分类、目标检测及其他人工智能场景,具有灵活的模型配置、高速处理能力和强大的社区支持。...

Chainer 是一个开源深度学习框架,提供了灵活、直观且高性能的神经网络平台,具有动态图 define-by-run 构建、GPU 加速和广泛的架构支持。由 Preferred Networks 开发,并得到主要科技公司的技术贡献,非常适合科研、原型开发和分布式训练,但目前已进入维护阶段。...

DALL-E 是由 OpenAI 开发的一系列文本到图像的模型,利用深度学习根据文本描述生成数字图像。了解其历史、在艺术、营销、教育等领域的应用,以及相关的伦理考量。...

DL4J(DeepLearning4J)是一个开源的、分布式的深度学习库,适用于 Java 虚拟机(JVM)。作为 Eclipse 生态系统的一部分,它支持使用 Java、Scala 及其他 JVM 语言进行可扩展的深度学习模型开发与部署。...

Dropout 是一种在人工智能,尤其是神经网络中应用的正则化技术,通过在训练过程中随机禁用神经元,促进特征学习的鲁棒性,并提升对新数据的泛化能力,从而抑制过拟合。...

Fréchet Inception Distance(FID)是一种用于评估生成模型(尤其是GANs)所生成图像质量的指标。FID通过比较生成图像与真实图像的分布,提供了更全面的图像质量与多样性度量。...

Horovod 是一个强大的开源分布式深度学习训练框架,旨在实现多 GPU 或多机器间的高效扩展。它支持 TensorFlow、Keras、PyTorch 和 MXNet,优化了机器学习模型训练的速度与可扩展性。...

Ideogram AI 是一个创新的图像生成平台,利用人工智能将文本提示转化为高质量图像。通过深度学习神经网络,Ideogram 理解文本与视觉之间的联系,使用户能够创作与描述高度匹配的图像。...

Keras 是一个功能强大且用户友好的开源高级神经网络 API,由 Python 编写,可运行于 TensorFlow、CNTK 或 Theano 之上。它支持快速实验,并以模块化和简洁性强力支持生产和科研场景。...

Apache MXNet 是一个开源深度学习框架,专为高效且灵活地训练和部署深度神经网络而设计。它以可扩展性、混合编程模式以及多语言支持而闻名,使研究人员和开发者能够构建先进的人工智能解决方案。...

PyTorch 是由 Meta AI 开发的开源机器学习框架,以其灵活性、动态计算图、GPU 加速和无缝的 Python 集成而著称。它广泛应用于深度学习、计算机视觉、自然语言处理和科研领域。...

TensorFlow 是由 Google Brain 团队开发的开源库,旨在进行数值计算和大规模机器学习。它支持深度学习、神经网络,并可在 CPU、GPU 和 TPU 上运行,简化了数据获取、模型训练和部署流程。...

Torch 是一个基于 Lua 的开源机器学习库和科学计算框架,专为深度学习和 AI 任务优化。它提供神经网络开发工具,支持 GPU 加速,并且是 PyTorch 的前身。...

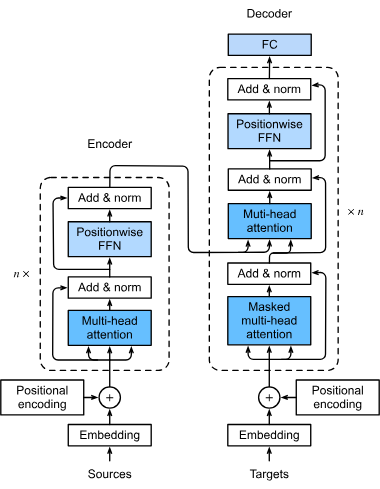

变换器是一种革命性的神经网络架构,彻底改变了人工智能,尤其是在自然语言处理领域。自2017年“Attention is All You Need”提出以来,它们实现了高效的并行处理,成为BERT和GPT等模型的基础,深刻影响了NLP、视觉等多个领域。...

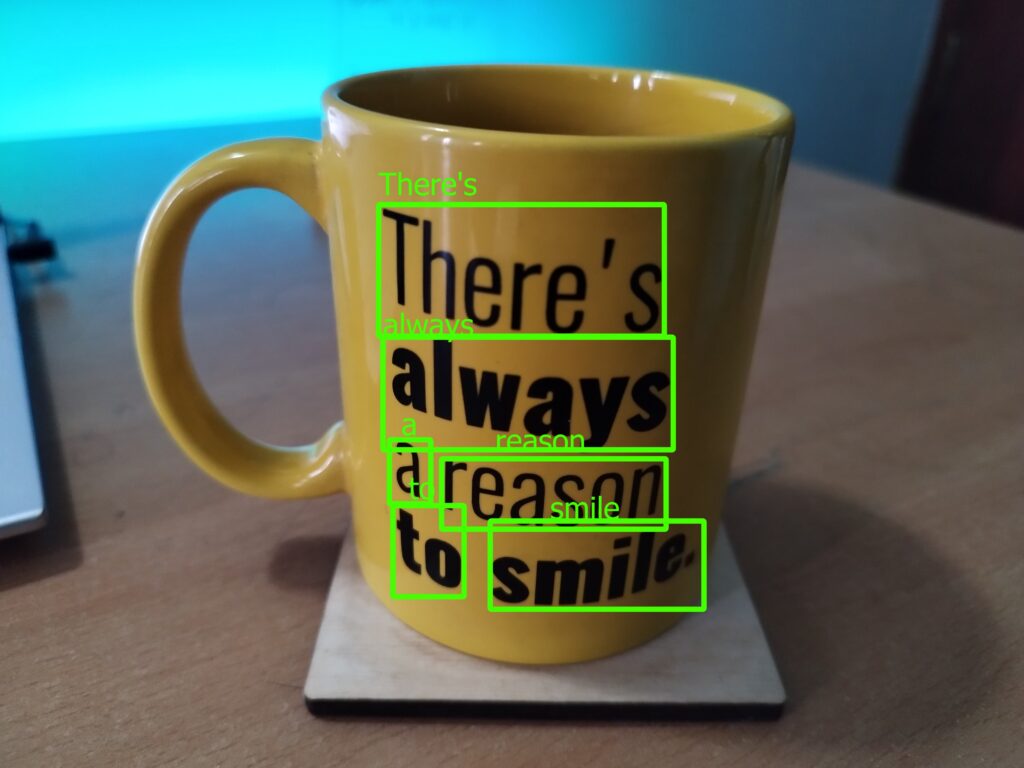

场景文字识别(STR)是光学字符识别(OCR)的一个专门分支,利用人工智能和深度学习模型,聚焦于识别和解析自然场景图像中的文字。STR 能够将复杂的现实世界文本转换为机器可读格式,广泛应用于自动驾驶、增强现实和智慧城市基础设施等领域。...

大型语言模型(LLM)是一种通过海量文本数据训练的人工智能,能够理解、生成和处理人类语言。LLM 利用深度学习和 Transformer 神经网络,驱动文本生成、摘要、翻译等多种任务,广泛应用于各行各业。...

反向传播是一种通过调整权重以最小化预测误差,用于训练人工神经网络的算法。了解其工作原理、步骤以及在神经网络训练中的基本原则。...

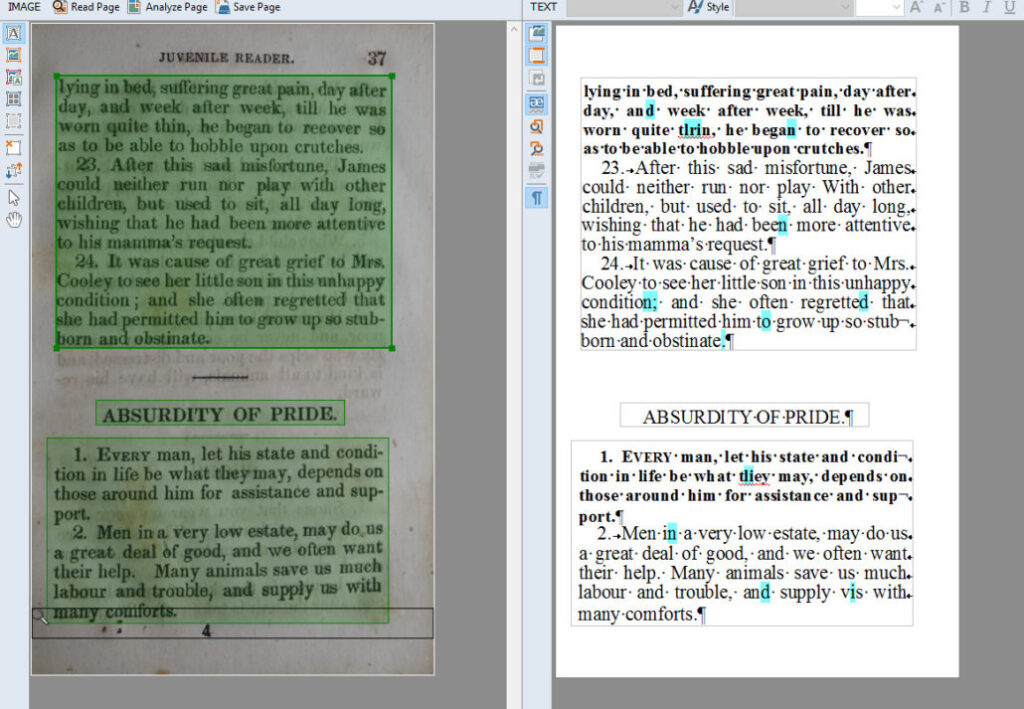

光学字符识别(OCR)是一项变革性技术,可将扫描文件、PDF或图像等文档转换为可编辑和可检索的数据。了解OCR的工作原理、类型、应用、优势、局限性,以及AI驱动OCR系统的最新进展。...

激活函数是人工神经网络的基础,通过引入非线性特性,使其能够学习复杂的模式。本文探讨了激活函数的作用、类型、挑战以及在人工智能、深度学习和神经网络中的关键应用。...

计算机视觉是人工智能(AI)领域的一个分支,专注于让计算机能够解释和理解视觉世界。通过利用来自摄像头、视频和深度学习模型的数字图像,机器能够准确识别和分类物体,并对它们“看到”的内容做出反应。...

卷积神经网络(CNN)是一种专门用于处理结构化网格数据(如图像)的人工神经网络。CNN 在处理视觉数据相关任务(包括图像分类、目标检测和图像分割)时尤为高效。它们模仿人脑的视觉处理机制,成为计算机视觉领域的基石。...

类脑计算是一种前沿的计算机工程方法,将硬件和软件元素仿照人脑与神经系统进行建模。该跨学科领域,又称为类脑工程,结合了计算机科学、生物学、数学、电子工程和物理学,以创建受生物启发的计算机系统和硬件。...

批量归一化是深度学习中的一项变革性技术,通过解决内部协变量偏移、稳定激活值,并实现更快且更稳定的训练,极大地提升了神经网络的训练过程。...

迁移学习是一种先进的机器学习技术,使得在一个任务上训练出的模型能够迁移复用到相关任务上,从而提高效率和性能,尤其是在数据稀缺的情况下。...

迁移学习是一种强大的人工智能/机器学习技术,通过对预训练模型进行适应,能够将其应用于新任务,即使数据有限,也能提升性能,并在图像识别、自然语言处理等多种应用中提高效率。...

嵌入向量是在多维空间中对数据进行密集数值表示的方法,能够捕捉语义和上下文关系。了解嵌入向量如何驱动自然语言处理、图像处理和推荐系统等 AI 任务。...

强化学习(RL)是机器学习的一个子领域,专注于训练智能体在环境中进行决策序列,通过奖励或惩罚的反馈学习最优行为。探索强化学习的关键概念、算法、应用和挑战。...

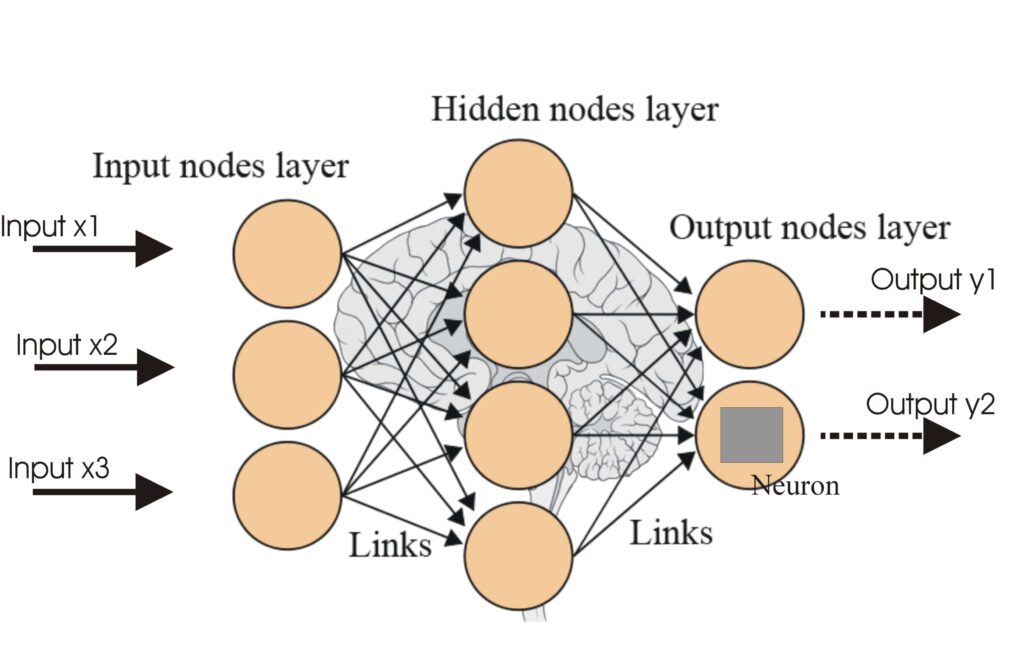

人工神经网络(ANNs)是受人脑启发的一类机器学习算法。这些计算模型由相互连接的节点或“神经元”组成,共同协作解决复杂问题。ANNs 被广泛应用于图像和语音识别、自然语言处理以及预测分析等领域。...

深度信念网络(DBN)是一种复杂的生成模型,利用深层结构和受限玻尔兹曼机(RBM),能够为监督和无监督任务(如图像和语音识别)学习数据的分层表示。...

深度学习是人工智能(AI)中机器学习的一个子集,其工作方式模仿人脑处理数据和创建用于决策的模式。它受到被称为人工神经网络的大脑结构和功能的启发。深度学习算法能够分析和解释复杂的数据关系,使其能够高精度地完成语音识别、图像分类以及复杂问题解决等任务。...

Fastai 是一个建立在 PyTorch 之上的深度学习库,提供高级 API、迁移学习和分层架构,使神经网络开发在视觉、自然语言处理、表格数据等领域变得简单。由 Jeremy Howard 和 Rachel Thomas 开发,Fastai 是开源且由社区驱动,让最前沿的人工智能技术对所有人都可及。...

神经网络,或称人工神经网络(ANN),是一种受人脑启发的计算模型,是人工智能和机器学习中进行模式识别、决策制定以及深度学习应用等任务的核心技术。...

生成式人工智能指的是一类能够生成新内容(如文本、图像、音乐、代码和视频)的人工智能算法。与传统人工智能不同,生成式人工智能基于其训练过的数据产生原创输出,实现了跨行业的创造力和自动化。...

生成式预训练变换器(GPT)是一种利用深度学习技术生成接近人类写作文本的人工智能模型。基于变换器架构,GPT采用自注意力机制实现高效文本处理与生成,彻底革新了内容创作、聊天机器人等自然语言处理(NLP)应用。...

实例分割是一项计算机视觉任务,能够以像素级精度检测并描绘图像中每一个独立的目标。与目标检测或语义分割相比,它能提供更为细致的理解,对于医学影像、自动驾驶和机器人等领域至关重要。...

AI中的收敛性是指通过迭代学习,机器学习和深度学习模型逐步达到稳定状态,确保通过最小化预测值与实际结果之间的差异,实现准确预测。这是AI在各类应用中(从自动驾驶到智慧城市)有效性与可靠性的基础。...

双向长短期记忆网络(BiLSTM)是一种先进的循环神经网络(RNN)架构,能够同时以前向和后向两种方式处理序列数据,从而增强对上下文的理解,广泛应用于自然语言处理、语音识别和生物信息学等领域。...

梯度下降是一种基本的优化算法,被广泛应用于机器学习和深度学习领域,通过迭代调整模型参数以最小化代价函数或损失函数。它对于优化神经网络等模型至关重要,并以批量、随机和小批量梯度下降等形式实现。...

了解什么是人工智能中的图像识别。它的用途、发展趋势,以及与类似技术的区别。

图像中的异常检测用于识别偏离常规的模式,这对于工业检测和医学影像等应用至关重要。了解无监督和弱监督方法、AI集成以及实际应用案例。...

模型微调通过对预训练模型进行轻微调整,使其适应新任务,从而减少对数据和资源的需求。了解微调如何利用迁移学习、不同技术、最佳实践和评估指标,高效提升NLP、计算机视觉等领域模型性能。...

稳定扩散是一种先进的文本到图像生成模型,利用深度学习根据文本描述生成高质量、照片级真实感的图像。作为一种潜变量扩散模型,它是生成式人工智能领域的重大突破,高效地融合了扩散模型与机器学习,从而生成与输入提示高度匹配的图像。...

探索人工智能和机器学习中的序列建模——利用RNN、LSTM、GRU和Transformer对文本、音频和DNA等数据序列进行预测与生成。了解关键概念、应用、挑战及最新研究进展。...

循环神经网络(RNN)是一种复杂的人工神经网络,旨在通过利用先前输入的记忆来处理序列数据。RNN 在数据顺序至关重要的任务中表现出色,包括自然语言处理(NLP)、语音识别和时间序列预测。...

医疗领域的人工智能(AI)利用机器学习、自然语言处理(NLP)和深度学习等先进算法和技术,分析复杂的医疗数据,提升诊断水平,实现个性化治疗,并提升运营效率,从而变革患者护理并加速新药研发。...

语义分割是一种计算机视觉技术,将图像划分为多个区域,对每个像素分配代表对象或区域的类别标签。通过深度学习模型(如CNN、FCN、U-Net和DeepLab),它为自动驾驶、医学影像和机器人等应用实现了细致的理解。...

长短期记忆网络(LSTM)是一种专门设计用于学习序列数据中长期依赖关系的循环神经网络(RNN)架构。LSTM网络通过利用记忆单元和门控机制来解决梯度消失问题,使其成为语言建模、语音识别和时间序列预测等任务的关键工具。...

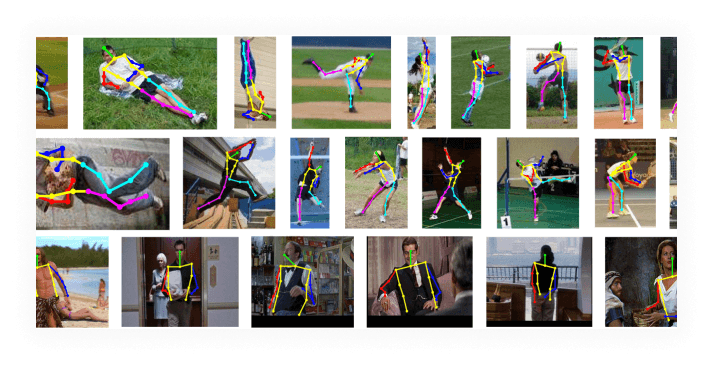

姿态估计是一种计算机视觉技术,通过识别和跟踪关键点,预测图像或视频中人物或物体的位置和朝向。它对于体育分析、机器人、游戏和自动驾驶等应用至关重要。...

自然语言处理(NLP)使计算机能够利用计算语言学、机器学习和深度学习来理解、解释和生成人的语言。NLP 支持翻译、聊天机器人、情感分析等应用,正在改变各行各业,提升人机交互体验。...