Think MCP 服务器

Think MCP 服务器为代理型 AI 工作流提供结构化推理工具,实现显式思维日志记录、策略合规、顺序决策,以及高级批判与规划。可无缝集成到 Claude、FlowHunt 或其他代理型 LLM,增强 AI 代理行为的透明度与可审计性。...

Think MCP 服务器为代理型 AI 工作流提供结构化推理工具,实现显式思维日志记录、策略合规、顺序决策,以及高级批判与规划。可无缝集成到 Claude、FlowHunt 或其他代理型 LLM,增强 AI 代理行为的透明度与可审计性。...

AI透明度是让人工智能系统的运行机制和决策过程对相关方可理解的实践。了解其重要性、关键组成部分、监管框架、实施技术、挑战及真实应用案例。...

发现 RIG 维基百科助手,这是一款专为从维基百科精准检索信息而设计的工具。非常适合研究和内容创作,能够快速提供有充分来源、可信赖的答案。用准确的数据和透明度提升您的知识。...

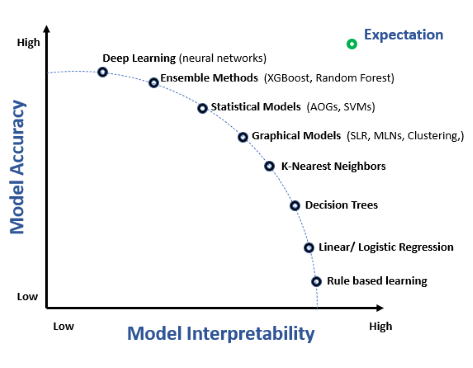

可解释人工智能(XAI)是一套旨在让人工智能模型输出结果对人类可理解的方法和流程,促进复杂机器学习系统的透明性、可解释性和责任追溯。...

了解 FlowHunt 的多来源AI答案生成器——一款强大的工具,可从多个论坛和数据库获取实时、可信的信息。无论是学术、医疗还是一般性问题,都能为您提供带有来源链接的透明答案,并可自定义工具连接以满足您的需求。...

合规报告是一种结构化且系统化的流程,使组织能够记录并展示其遵守内部政策、行业标准和监管要求的证据。它确保了风险管理、透明度以及在各个行业中的法律保护。...

AI模型的基准测试是指使用标准化数据集、任务和性能指标,对人工智能模型进行系统性的评估和比较。这有助于实现客观评估、模型对比、进展跟踪,并促进AI开发过程中的透明度与标准化。...

AI 可解释性指的是理解和解释人工智能系统所做决策与预测的能力。随着 AI 模型日益复杂,可解释性通过 LIME 和 SHAP 等技术,确保透明度、信任、合规、偏见规避以及模型优化。...

模型可解释性是指理解、解释和信任机器学习模型所做预测和决策的能力。在人工智能领域尤为重要,尤其是在医疗、金融和自动化系统等决策环节,能够弥合复杂模型与人类认知之间的鸿沟。...

了解欧洲人工智能法案如何影响聊天机器人,详细介绍风险分类、合规要求、截止日期以及违规的处罚措施,确保人工智能交互的道德性、透明度与安全性。...

人工智能(AI)的透明性指的是 AI 系统在运行过程中的开放性和清晰度,包括其决策过程、算法和数据。这对于 AI 伦理和治理至关重要,能够确保问责、信任和合规。...

人工智能监管机构是负责监督、评估和规范人工智能(AI)开发与部署的组织,确保AI的使用负责任、合乎伦理并具备透明度,同时降低如歧视、隐私侵犯和责任缺失等风险。...

人工智能监管框架是为规范人工智能技术的开发、部署和使用而制定的结构化指导方针和法律措施。这些框架旨在确保人工智能系统的运行方式符合伦理、安全,并与社会价值观保持一致。它们涵盖数据隐私、透明度、问责和风险管理等方面,在促进负责任的人工智能创新的同时,降低潜在风险。...

探索人工智能伦理准则:确保人工智能技术在开发、部署和使用过程中遵循伦理原则和框架。了解公平性、透明性、责任制、全球标准以及负责任人工智能的相关策略。...

算法透明性指的是对算法内部运作和决策过程的清晰与开放。在人工智能和机器学习领域,算法透明性对于确保问责制、信任以及符合法律和伦理标准至关重要。...